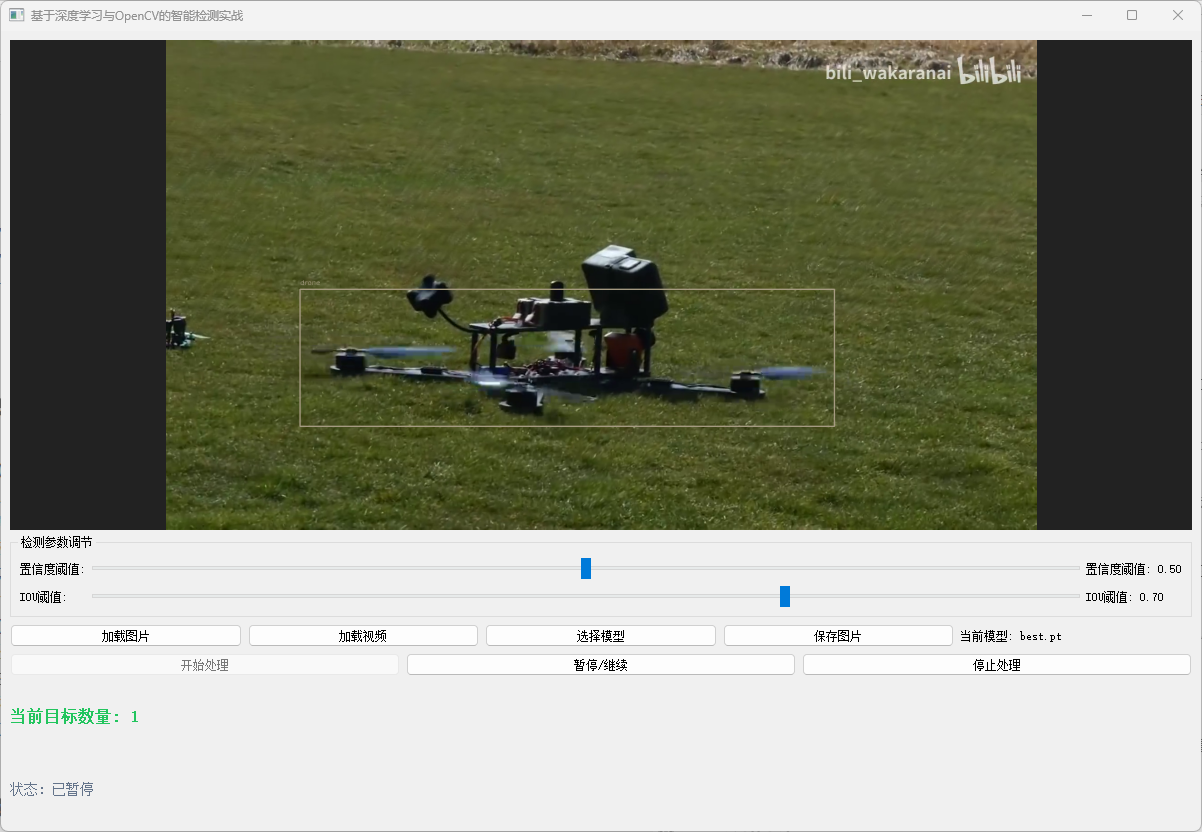

【图像算法 - 27】基于YOLOv12与OpenCV的无人机智能检测系统

1. 引言:为何需要无人机智能检测?

随着无人机技术的飞速发展和普及,其应用场景从航拍、农业扩展到物流、安防乃至军事领域。然而,无人机的“黑飞”、隐私侵犯、关键区域入侵等问题也日益凸显。传统的雷达、无线电侦测等方法成本高昂且对微型无人机效果不佳。

【图像算法 - 27】基于YOLOv12与OpenCV的无人机智能检测系统

2. 技术选型:YOLO12 + OpenCV 的黄金组合

- YOLO12 (You Only Look Once v12):

- 实时性王者: YOLO系列以其卓越的实时检测性能著称。YOLO12作为其最新迭代版本,在保持高速推理的同时,进一步提升了检测精度和小目标识别能力,非常适合流水线上的高速分拣场景。

- 高精度检测: 采用更先进的网络架构和训练策略,能够精准定位无人机及其缺陷区域,即使在复杂背景或轻微遮挡下也能保持稳定表现。

- 端到端训练: 简化了模型开发流程,从原始图像直接输出检测框和类别,易于集成与部署。

- OpenCV (Open Source Computer Vision Library):

- 图像预处理专家: 负责图像的读取、缩放、色彩空间转换(如BGR转RGB)、去噪、增强等,为YOLO12提供高质量的输入。

- 结果可视化大师: 将YOLO12输出的检测框、类别标签和置信度,以直观的彩色矩形框和文字形式叠加回原图,便于结果展示与分析。

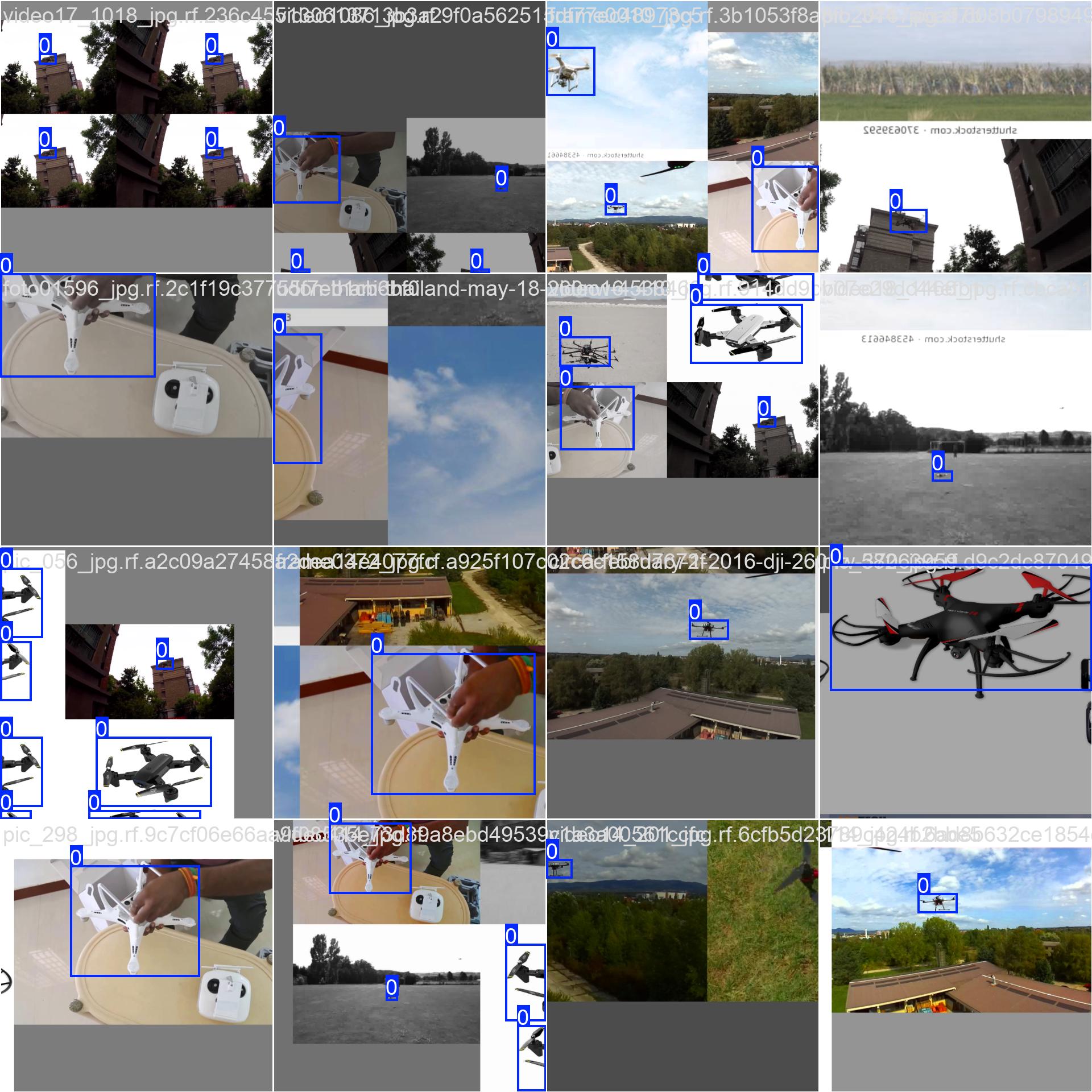

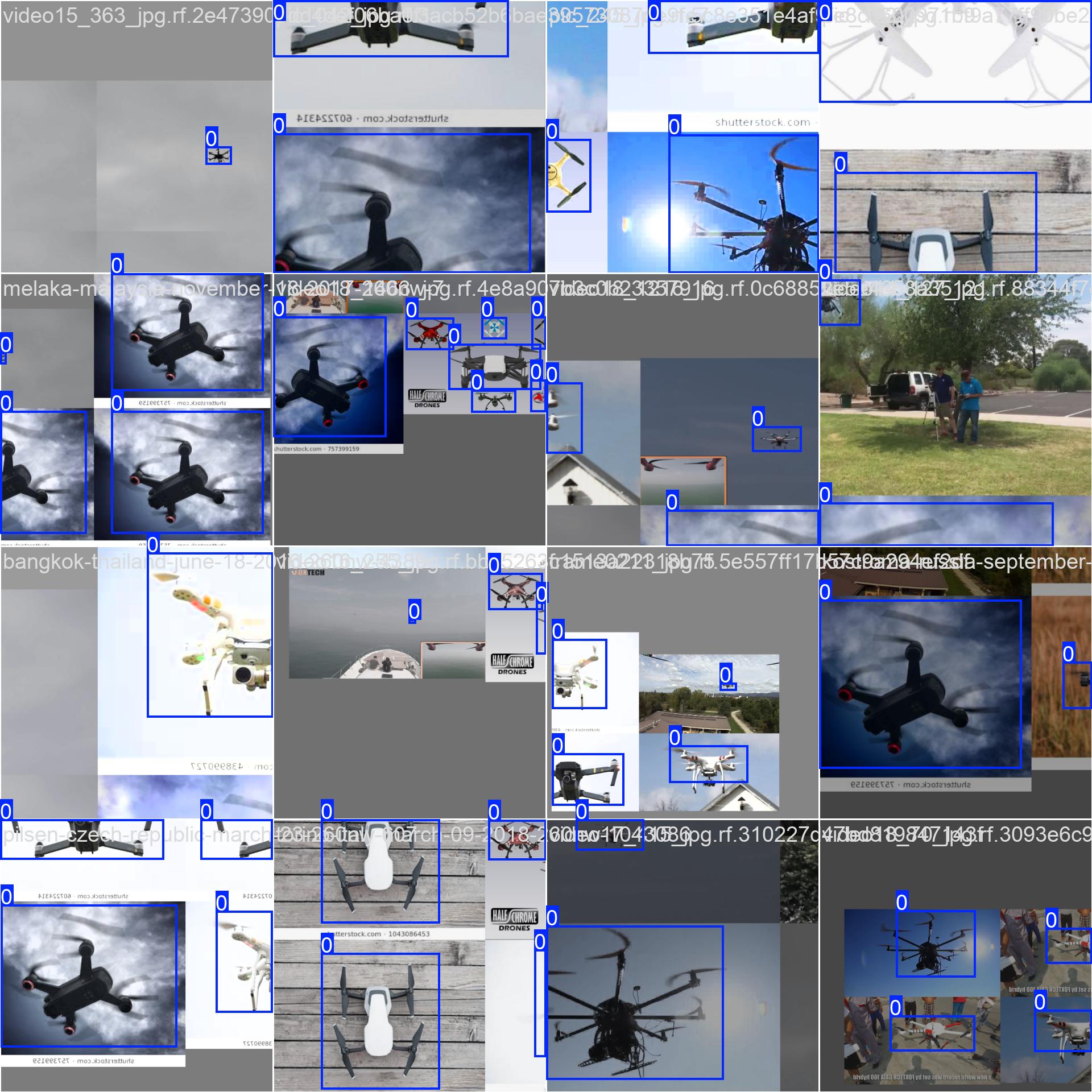

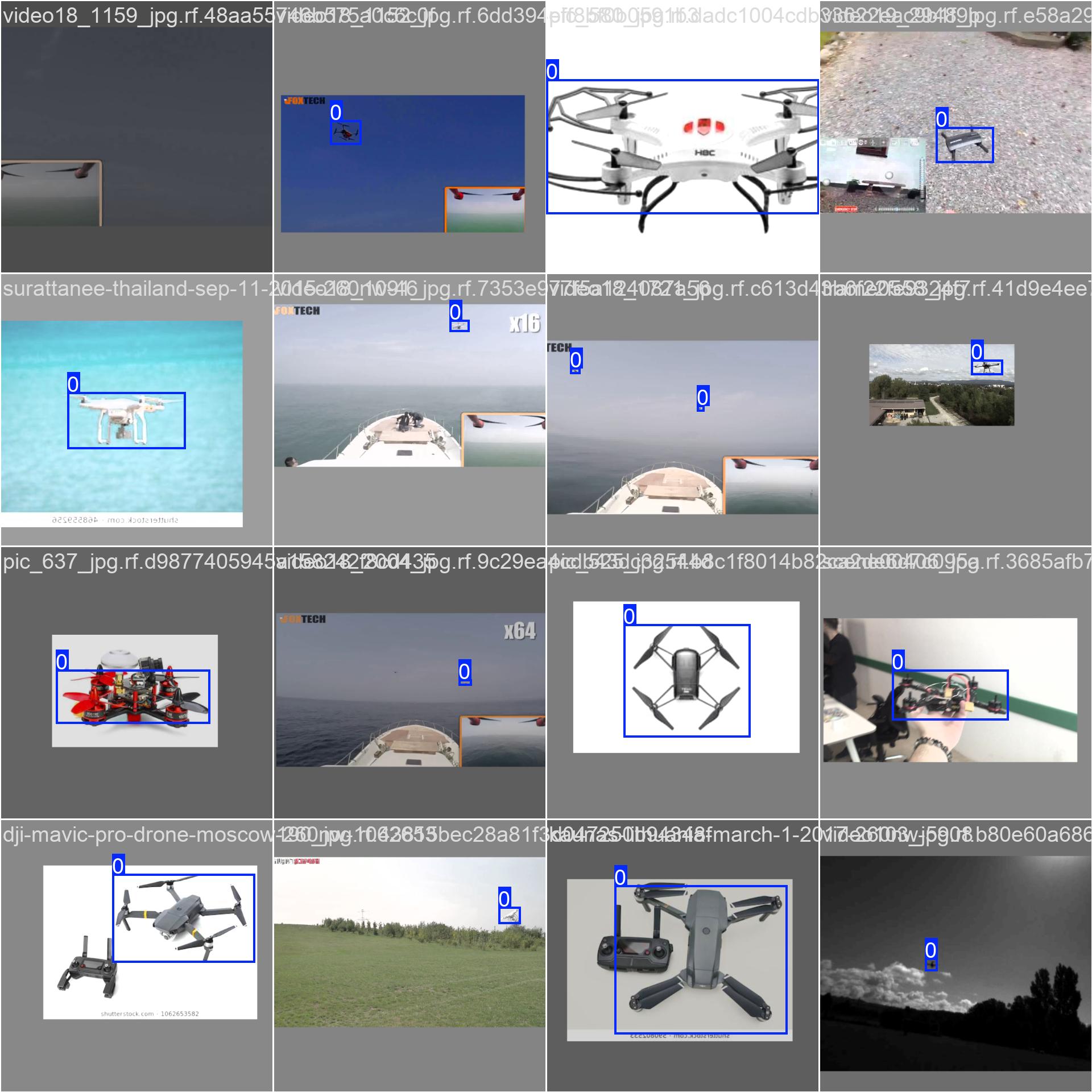

3. 数据准备:构建高质量的无人机识别数据集

“Garbage in, garbage out.” 模型的性能很大程度上取决于训练数据的质量。我们构建了一个专门用于无人机识别的数据集。

3.1 数据采集

- 来源: 网络收集资源、实地采集。

- 多样性: 不同品牌、格式、环境、背景。

- 数量: 收集了超过7000张高质量图像,确保无人机样本充足且分布均衡。

3.2 数据标注

-

工具: 使用 LabelImg、CVAT 或 Roboflow 等开源标注工具。

-

方法: 采用 矩形框 (Bounding Box) 标注。为图像中的每个无人机绘制边界框。

-

类别定义 (示例):

names:0: Drone -

格式: 保存为 YOLO 格式的

.txt文件(每行:class_id center_x center_y width height,坐标已归一化)。

3.3 数据集划分

-

按 7:2:1 的比例划分为 训练集 (train)、验证集 (val) 和 测试集 (test)。

-

创建数据配置文件 Drone.yaml

# Drone.yamlpath: /path/to/apple/datasettrain: images/trainval: images/valtest: images/testnames:0: Drone

4. 模型训练:用YOLO12“学习”识别无人机

利用Ultralytics YOLO12的API,训练过程变得异常简单。

4.1 环境准备

# 安装Ultralytics (支持YOLO12)

pip install ultralytics>=8.2.0 # 假设YOLO12在此版本或之后支持# 安装OpenCV (用于后续推理)

pip install opencv-python

4.2 开始训练

使用命令行启动训练:

yolo train \model=yolo12n.pt \ # 选择YOLO12n模型 (平衡精度与速度)data=Drone.yaml \ # 指向数据配置文件epochs=100 \ # 训练轮数imgsz=640 \ # 输入图像尺寸batch=16 \ # 批次大小 (根据GPU显存调整)device=0 \ # 使用GPU 0 (若有多卡可设为 0,1,2,3)name=xxxx\ # 训练任务名称patience=15 \ # 早停轮数lr0=0.01 \ # 初始学习率optimizer=AdamW \ # 优化器cos_lr=True # 使用余弦退火学习率

- 关键参数:

model: 可选择yolo12n(nano, 超快),yolo12s(small),yolo12m(medium),yolo12l(large),yolo12x(extra large)。根据您的硬件和精度需求选择。data: 必须正确指向您的apple_defects.yaml。epochs,imgsz,batch: 核心训练参数。name: 训练结果将保存在runs/detect/name/目录下。

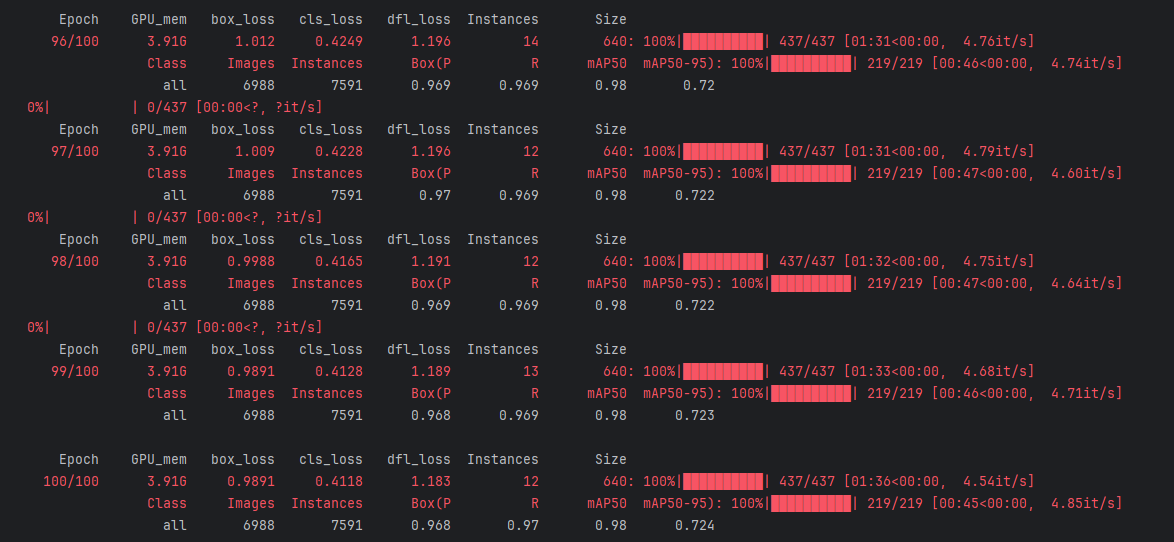

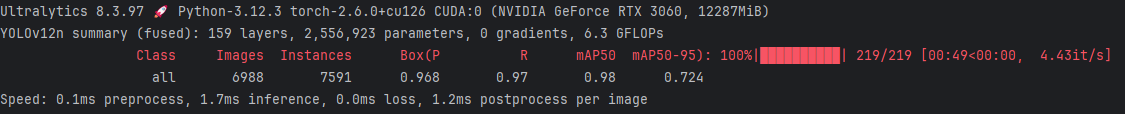

4.3 监控与评估

-

训练过程中,Ultralytics会自动在

runs/detect/xxxxx/目录生成:

results.png: 展示训练/验证损失、mAP@0.5、mAP@0.5:0.95等指标曲线。confusion_matrix.png: 分析各类别间的混淆情况。val_batch*.jpg: 验证集上的预测效果图。

-

训练结束后,使用测试集评估最终性能:

yolo val model=runs/detect/xxxxxx/weights/best.pt data=Drone.yaml -

评估结果将给出在测试集上的 mAP@0.5 和 mAP@0.5:0.95 等关键指标,反映模型的综合性能。

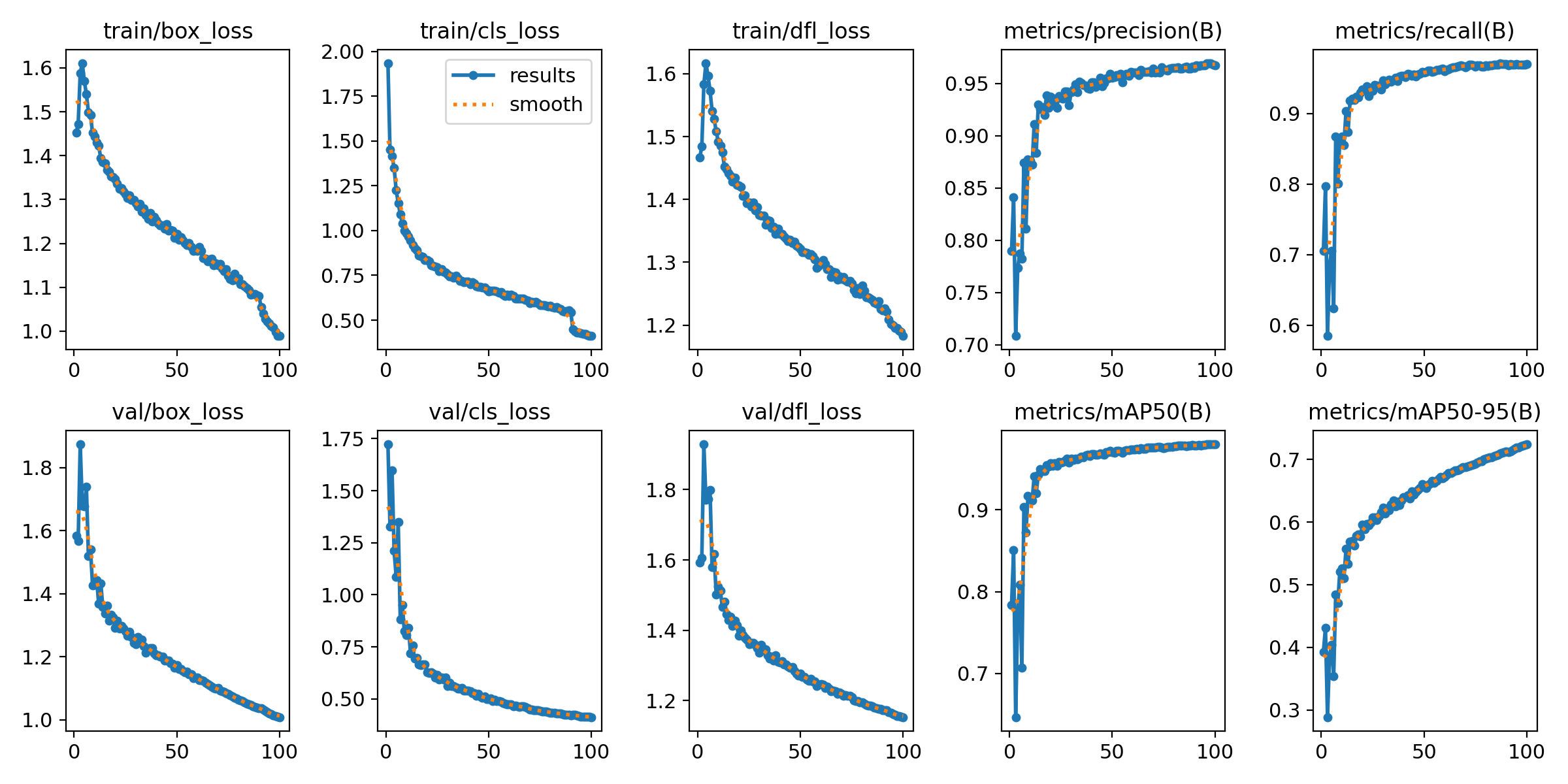

5. 推理与可视化:OpenCV展现AI慧眼

训练好的模型 (best.pt) 可用于实际检测。以下是核心代码:

import cv2

import numpy as np

from ultralytics import YOLO# --- 1. 加载训练好的YOLO12模型 ---

MODEL_PATH = 'runs/detect/xxx/weights/best.pt' # 替换为您的模型路径

model = YOLO(MODEL_PATH)# --- 2. 加载待检测的无人机图像 ---

IMAGE_PATH = 'drone.jpg' # 替换为您的测试图像路径

image = cv2.imread(IMAGE_PATH)

if image is None:raise FileNotFoundError(f"无法加载图像: {IMAGE_PATH}")

original_height, original_width = image.shape[:2]

print(f"输入图像尺寸: {original_width}x{original_height}")# --- 3. 使用YOLO12进行预测 ---

results = model.predict(source=image,imgsz=640, # 与训练时一致conf=0.5, # 置信度阈值iou=0.45, # NMS IoU阈值device=0, # 使用GPUverbose=False

)# --- 4. 处理并可视化结果 ---

result = results[0]

boxes = result.boxes

names = model.names # 获取类别名称字典# 为不同类别定义颜色 (BGR格式)

colors = {'Drone': (0, 255, 0), # 绿色 - 正常

}# 创建绘制结果的副本

annotated_image = image.copy()for box in boxes:# 获取坐标x1, y1, x2, y2 = map(int, box.xyxy[0].tolist())# 获取类别和置信度cls_id = int(box.cls[0])class_name = names[cls_id]conf = float(box.conf[0])# 选择对应颜色color = colors.get(class_name, (255, 255, 255)) # 默认白色# 绘制检测框cv2.rectangle(annotated_image, (x1, y1), (x2, y2), color, 2)# 准备标签label = f"{class_name}: {conf:.2f}"# 获取标签文本尺寸(text_width, text_height), _ = cv2.getTextSize(label, cv2.FONT_HERSHEY_SIMPLEX, 0.6, 1)# 绘制标签背景cv2.rectangle(annotated_image, (x1, y1 - text_height - 10), (x1 + text_width, y1), color, -1)# 绘制标签文字 (白色)cv2.putText(annotated_image, label, (x1, y1 - 5), cv2.FONT_HERSHEY_SIMPLEX, 0.6, (255, 255, 255), 1)# --- 5. 显示与保存结果 ---

cv2.imshow('Drone Defect Detection - YOLO12 + OpenCV', annotated_image)

cv2.waitKey(0)

cv2.destroyAllWindows()# 保存结果图像

output_path = 'drone_defect_detection_result.jpg'

cv2.imwrite(output_path, annotated_image)

print(f"检测结果已保存至: {output_path}")6. 代码详解

- 模型加载:

YOLO(MODEL_PATH)加载训练好的权重。 - 预测:

model.predict()执行推理,返回包含边界框、类别、置信度等信息的结果。 - 结果解析: 遍历

boxes,提取xyxy(左上、右下坐标)、cls(类别ID)、conf(置信度)。 - 可视化: 使用

cv2.rectangle绘制不同颜色的框,cv2.putText添加标签。

7. 挑战与解决方案

- 小目标检测难:无人机在远距离时像素占比小。

- 方案:使用更高分辨率输入、采用专门针对小目标优化的模型结构(如引入更精细的特征图)、训练时增加小目标样本。

- 复杂背景干扰:天空中的鸟、云朵、风筝易造成误检。

- 方案:使用在复杂空中场景下训练的专用数据集、调整置信度阈值、引入上下文信息或后处理规则(如根据目标运动轨迹过滤)。

- 光照变化与恶劣天气:强光、逆光、雨雾影响成像。

- 方案:图像预处理(直方图均衡化、去雾算法)、训练数据包含各种天气条件、使用红外或热成像摄像头辅助。

- 实时性要求高:需要高FPS保证及时响应。

- 方案:模型轻量化、硬件加速、降低分辨率、优化代码(如使用多线程)。

8. 展望

- 多模态融合:结合视觉、雷达、声学、无线电频谱数据,构建更鲁棒的无人机探测网络。

- 边缘智能:模型进一步轻量化,直接部署在摄像头或小型无人机上,实现分布式检测。

- 行为识别:不仅检测无人机,还能识别其飞行意图(如悬停、快速接近、徘徊),实现智能预警。

- 对抗样本防御:研究针对视觉检测系统的对抗攻击与防御机制,提升系统安全性。