在线教程 | VibeVoice-1.5B独创双Tokenizer架构实现一次性生成90分钟4人对话语音,重新定义TTS技术边界

微软最新开源的 VibeVoice-1.5B 模型,在 TTS 技术领域掀起了轩然大波,这款拥有 15 亿参数的模型,能够一次性生成长达 90 分钟的高自然度语音,并支持模拟最多 4 位不同说话者的对话,其官方盲测 MOS(平均意见分数)高达 4.5,接近真人语音质量。

VibeVoice-1.5B 的核心创新在于其独特的双 Tokenizer 架构和扩散解码技术。它基于 Qwen2.5 语言模型,通过声学 Tokenizer(采用 σ-VAE 结构,实现 3,200 倍音频压缩)和语义 Tokenizer(专注于保留文本情绪与停顿)分工协作,以仅 7.5 Hz 的超低帧率处理音频序列。在解码端,一个 1.23 亿参数的扩散解码器配合 DPM-Solver 算法,负责重构高保真音频细节。

VibeVoice-1.5B 主要面向科研与开发者社区,为播客制作、对话式 AI 以及语音内容生成等领域提供了新工具。不过需要注意的是,它目前仅支持中英文,且无法处理语音重叠或生成背景音效。微软明确强调了其研究用途,并内置了可听闻的免责声明和不可感知的水印技术,以防止技术滥用。

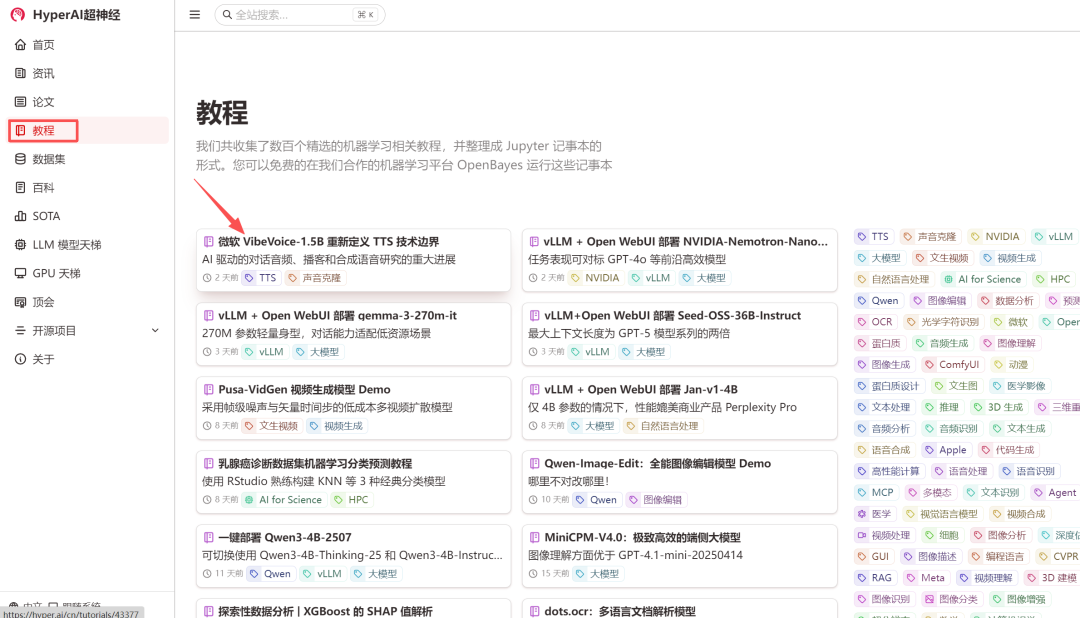

目前,「微软 VibeVoice-1.5B 重新定义 TTS 技术边界」已上线至 HyperAI超神经官网的「教程」板块,点击下方链接即可一键部署。

教程链接:

https://go.hyper.ai/6Ii8l

HyperAI超神经专属邀请链接(直接复制到浏览器打开):

https://openbayes.com/console/signup?r=Ada0322_NR0n

Demo 运行

1.进入 hyper.ai 首页后,选择「教程」页面,并选择「微软 VibeVoice-1.5B 重新定义 TTS 技术边界」,点击「在线运行此教程」。

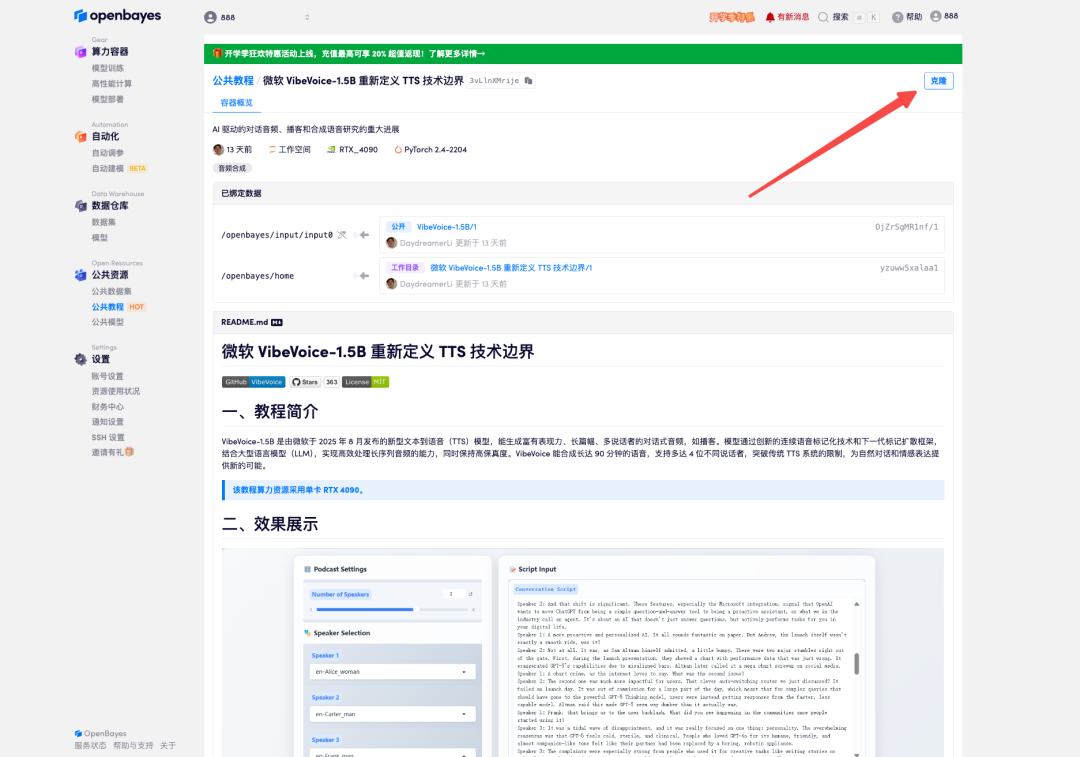

2.页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

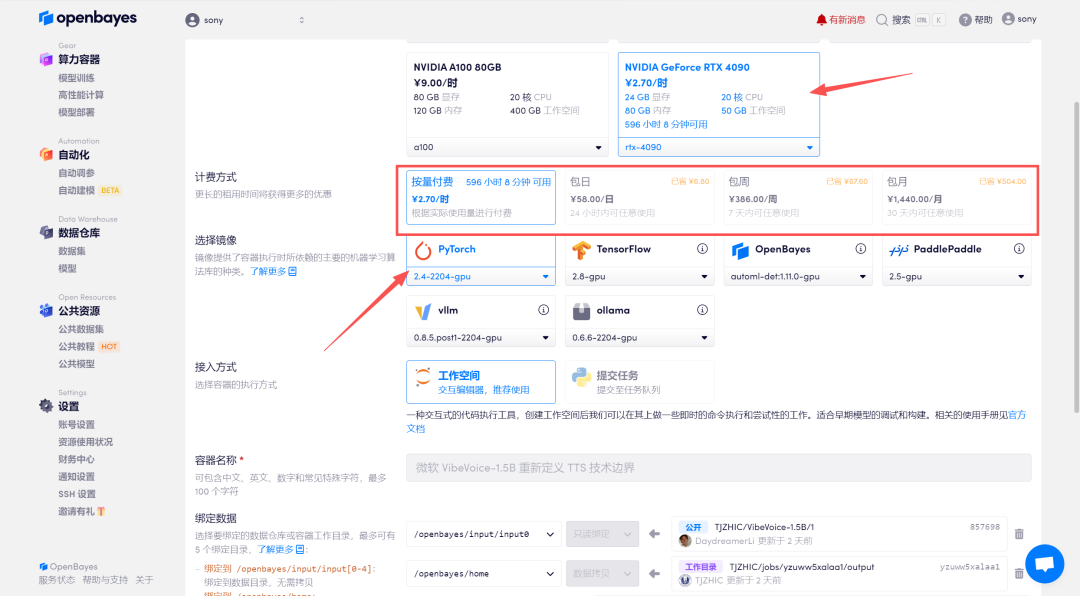

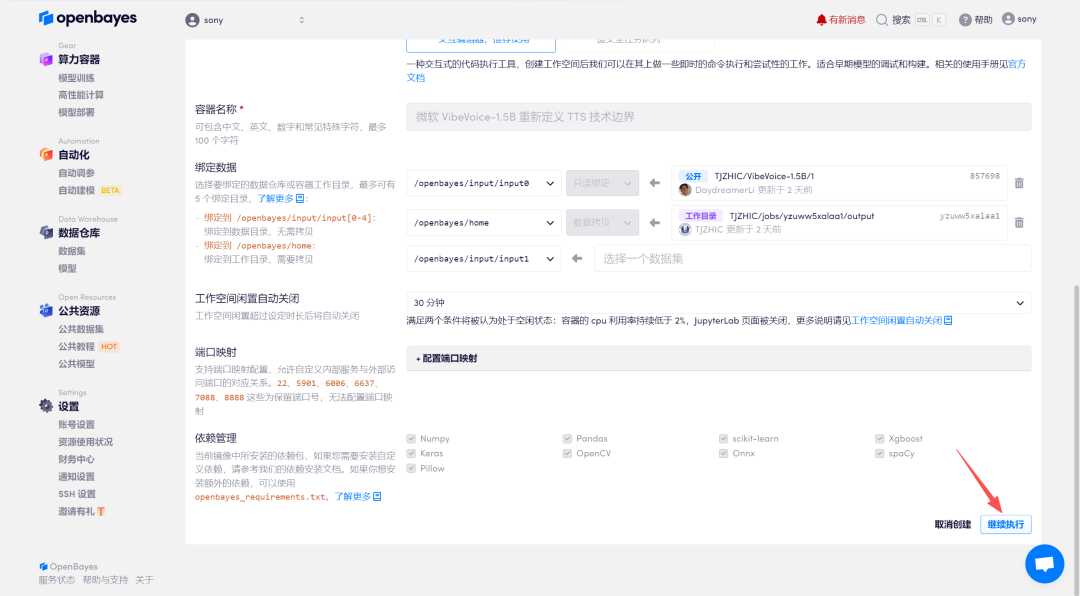

3.选择「NVIDIA GeForce RTX 4090」,OpenBayes 平台提供了 4 种计费方式,大家可以按照需求选择「按量付费」或「包日/周/月」。在选择镜像「PyTorch」后,点击「继续执行」。新用户使用下方邀请链接注册,可获得 4 小时 RTX 4090 + 5 小时 CPU 的免费时长!

HyperAI超神经专属邀请链接(直接复制到浏览器打开):

https://openbayes.com/console/signup?r=Ada0322_NR0n

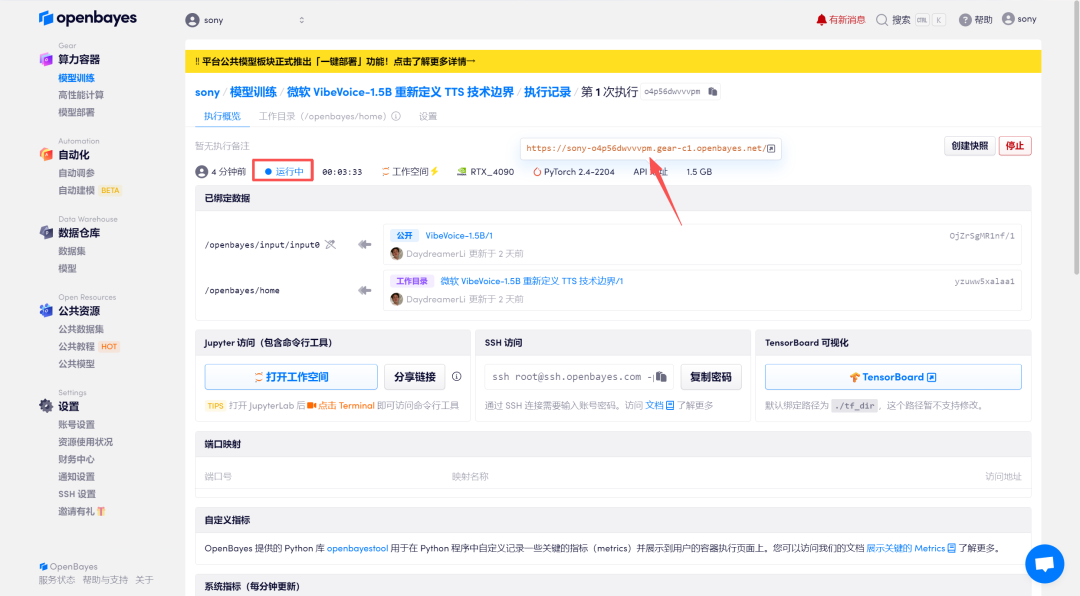

4.等待分配资源,首次克隆需等待 2 分钟左右的时间。当状态变为「运行中」后,点击「API 地址」旁边的跳转箭头,即可跳转至 Demo 页面。请注意,用户需在实名认证后才能使用 API 地址访问功能。

效果演示

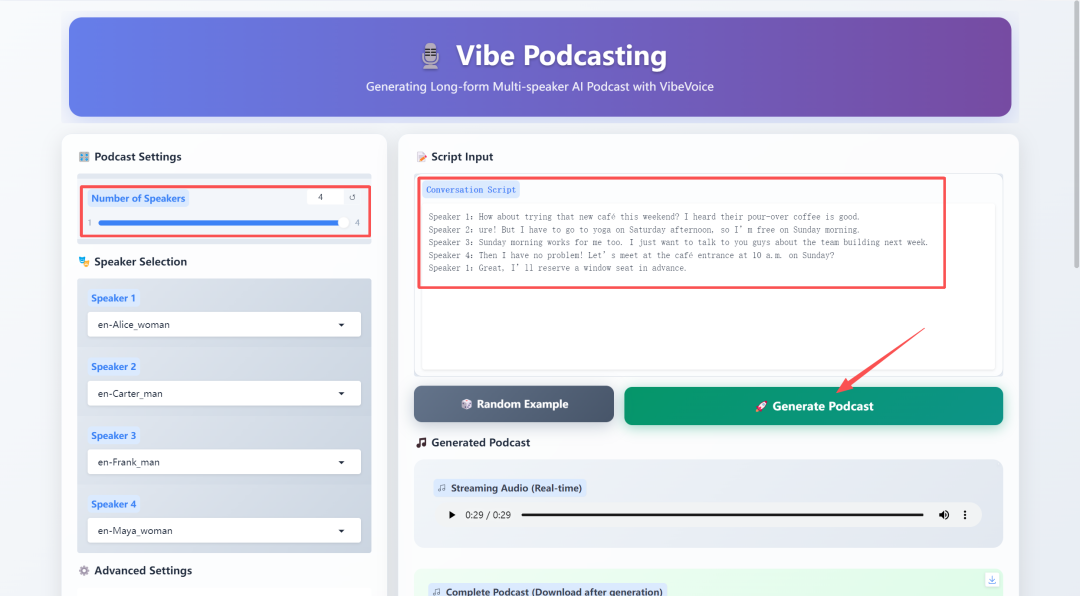

进入模型页面后,在「Number of Speakers」中选择说话人数,「Speaker 1-4」设置说话人,「Conversation Script」中输入对话文本,最后点击「Generate Podcast」生成。

笔者以四人对话为例,生成了一段语音:

*prompt:

Speaker 1: How about trying that new café this weekend? I heard their pour-over coffee is good.

Speaker 2:Sure! But I have to go to yoga on Saturday afternoon, so I’m free on Sunday morning.

Speaker 3: Sunday morning works for me too. I just want to talk to you guys about the team building next week.

Speaker 4:Then I have no problem! Let’s meet at the café entrance at 10 a.m. on Sunday?

Speaker 1:Great, I’ll reserve a window seat in advance.

这就是本期推荐的教程,欢迎大家亲自上手体验 ⬇️

教程链接:https://go.hyper.ai/6Ii8l