【AI论文】Story2Board:一种无需训练的富有表现力故事板生成方法

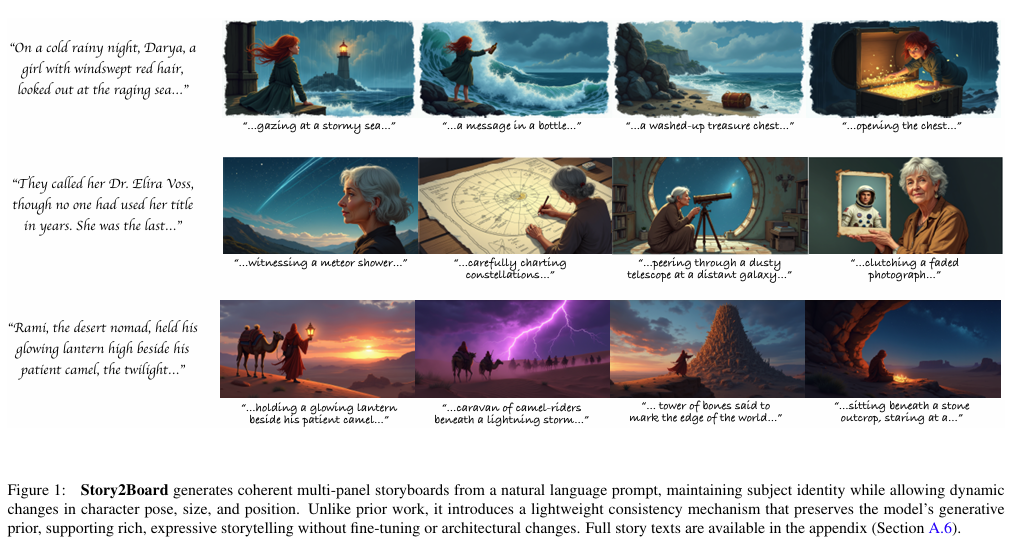

摘要:我们提出Story2Board——一种无需训练即可从自然语言生成富有表现力故事板的框架。现有方法仅狭隘地关注主体身份,而忽略了视觉叙事的关键要素,如空间构图、背景演变和叙事节奏。为解决这一问题,我们引入了一个轻量级一致性框架,该框架由两个部分组成:潜在面板锚定(Latent Panel Anchoring),用于在各面板间保留共享的角色参考;互惠注意力值混合(Reciprocal Attention Value Mixing),用于在具有强互惠注意力的标记对之间柔和地融合视觉特征。这些机制无需对模型架构进行改动或微调,即可增强生成故事板的一致性,使最先进的扩散模型能够生成视觉多样且连贯的故事板。在生成过程中,我们利用现成的语言模型将自由形式的故事转换为具体的面板级提示。为进行评估,我们提出了“丰富故事板基准测试(Rich Storyboard Benchmark)”,该基准包含一系列开放领域叙事,旨在除一致性外,评估布局多样性和基于背景的叙事能力。此外,我们还引入了一项新的场景多样性指标,用于量化故事板中的空间和姿态变化。定性评估、定量评估以及用户研究均表明,与现有基线方法相比,Story2Board生成的故事板更具动态性、连贯性和叙事吸引力。Huggingface链接:Paper page,论文链接:2508.09983

研究背景和目的

研究背景:

随着文本到图像(Text-to-Image, T2I)扩散模型的快速发展,视觉内容创作领域经历了革命性的变革。这些模型能够根据自然语言提示生成高质量、连贯的图像,极大地提高了创作效率和灵活性。然而,当这些技术应用于更复杂的视觉叙事形式,如故事板生成时,仍存在显著挑战。故事板不仅是简单的图像序列,而是结构化的视觉叙事,需要跨越时间演变来描绘角色、环境和情感节奏,同时保持空间和语义上的一致性。

现有的故事板生成方法往往过于关注角色身份的一致性,而忽视了视觉叙事的关键方面,如空间构图、背景演变和叙事节奏。这导致生成的故事板在视觉上缺乏多样性和表现力,更像是幻灯片展示而非富有表现力的视觉叙事。因此,开发一种能够生成视觉上多样且连贯的故事板的方法,成为当前研究的重要方向。

研究目的:

本研究旨在提出一种无需训练的框架——Story2Board,用于从自然语言描述中生成富有表现力的故事板。具体目标包括:

- 保持角色身份一致性:在生成的故事板中保持主要角色的视觉身份一致。

- 增强空间构图和背景演变:通过动态场景构建,增强故事板的空间深度和背景丰富性。

- 提高叙事表现力:使生成的故事板在视觉上更加多样和连贯,能够更好地传达叙事内容。

- 无需额外训练或架构修改:通过轻量级的一致性机制,直接应用于预训练的T2I扩散模型,避免复杂的训练过程或模型修改。

研究方法

为了实现上述目标,本研究提出了Story2Board框架,该框架主要包括以下几个关键组成部分:

- 轻量级一致性机制:

- 潜在面板锚定(Latent Panel Anchoring, LPA):通过为每个面板提供一个共享的参考描述,利用模型的自注意力机制在去噪过程中保持视觉一致性。具体来说,每个面板的生成都基于一个共同的参考面板,该参考面板描述了故事中所有重复出现的角色或对象。

- 互惠注意力值混合(Reciprocal Attention Value Mixing, RA VM):通过在对应标记对之间柔和地混合视觉特征,增强跨面板的一致性。RA VM利用双向注意力分数识别语义上对齐的标记对,并在这些标记对之间传播纹理和样式信息,从而在保持场景多样性的同时增强角色一致性。

- 提示分解:

- 使用现成的大语言模型(如GPT-4o)将自由形式的自然语言故事分解为共享的参考面板提示和一系列场景级别的面板提示。这些提示随后被联合渲染,以生成连贯的故事板。

- 评估基准和指标:

- 引入了Rich Storyboard Benchmark,这是一个包含100个开放领域故事提示的集合,每个提示都分解为七个详细描述的场景级别提示。该基准旨在评估故事板在布局灵活性、背景细节和叙事表现力方面的能力。

- 提出了Scene Diversity指标,用于量化故事板中角色外观的变化,包括大小、位置和姿势的变化,从而更全面地评估视觉叙事的灵活性。

研究结果

通过在Rich Storyboard Benchmark和DS-500基准上的广泛实验,本研究取得了以下主要结果:

- 定性评估:

- Story2Board生成的故事板在角色一致性、提示对齐和场景多样性方面表现出色。与基线方法相比,Story2Board能够支持更多样化的框架和角色定位,同时保持连贯且视觉丰富的环境。

- 基线方法往往在某些方面表现过度:如StoryDiffusion倾向于将角色置于中心位置,IC-LoRA重复构图模板,而OminiControl经常忽略偏离中心的角色。

- 定量评估:

- 在Rich Storyboard Benchmark上,Story2Board在提示对齐(VQAScore)和角色一致性(DreamSim)方面均优于基线方法。同时,在场景多样性方面也表现出色,显著高于其他方法。

- 在DS-500基准上的评估也表明,Story2Board在保持较高角色一致性的同时,实现了具有竞争力的提示对齐性能。

- 用户研究:

- 通过大规模的用户研究,验证了Story2Board在整体偏好、提示对齐、角色一致性、背景丰富性和场景多样性方面的优势。尽管在某些特定指标上(如提示对齐和背景丰富性),其他基线方法可能略胜一筹,但Story2Board在整体表现上更为平衡,更受用户青睐。

研究局限

尽管Story2Board在生成富有表现力的故事板方面取得了显著进展,但仍存在一些局限性:

- 注意力纠缠问题:

- 扩散模型中的注意力纠缠现象(如对象融合、语义错误分配)可能导致生成图像中出现不自然的属性绑定。尽管Story2Board的方法能够在一定程度上传播一致性,但无法完全纠正这些已存在于模型原生注意力结构中的问题。

- 对预训练模型的依赖:

- Story2Board的性能高度依赖于底层预训练T2I扩散模型的能力。如果预训练模型在生成高质量、连贯图像方面存在局限性,那么Story2Board的表现也会受到影响。

- 复杂场景下的表现:

- 在处理包含大量角色或复杂空间布局的场景时,Story2Board可能会遇到挑战。尽管LPA和RA VM机制能够在一定程度上增强一致性,但在极端复杂的场景下,仍可能无法完全满足需求。

未来研究方向

针对上述局限性,未来的研究可以从以下几个方面展开:

- 改进注意力机制:

- 探索更先进的注意力机制,以减少或消除注意力纠缠现象。例如,可以研究基于图神经网络的注意力机制,以更精确地控制信息在标记之间的传播。

- 优化预训练模型:

- 通过改进预训练T2I扩散模型的架构或训练策略,提高其生成高质量、连贯图像的能力。例如,可以引入更多的视觉叙事数据来增强模型的叙事理解能力。

- 处理复杂场景:

- 针对包含大量角色或复杂空间布局的场景,研究更有效的场景分解和角色跟踪方法。例如,可以结合目标检测和跟踪算法,以更精确地管理场景中的多个角色和对象。

- 多模态故事板生成:

- 探索结合文本、音频和视频等多模态信息的故事板生成方法。通过整合多种模态的信息,可以生成更加丰富和生动的视觉叙事。

- 用户交互和个性化:

- 研究用户交互和个性化在故事板生成中的应用。通过允许用户对生成的故事板进行微调或提供反馈,可以进一步提高生成结果的满意度和实用性。

- 评估指标和基准的扩展:

- 开发更全面和细致的评估指标和基准,以更准确地评估故事板生成方法的性能。例如,可以引入针对叙事连贯性、情感表达和视觉吸引力的评估指标。

总之,本研究提出的Story2Board框架为从自然语言描述中生成富有表现力的故事板提供了一种有效的方法。未来的研究可以在此基础上进一步探索和改进,以推动视觉叙事技术的发展和应用。