【Agent博客分享】从多Agent问题到新的上下文工程方法

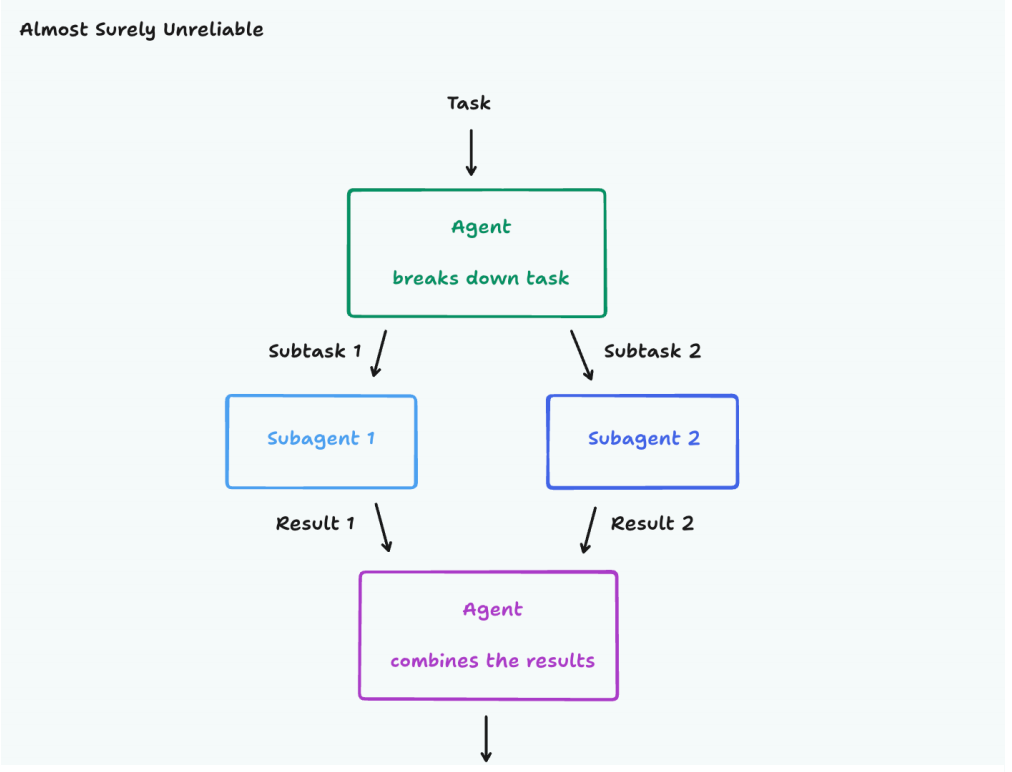

在构建大型语言模型(LLM)智能体的浪潮中,一个极具诱惑力的架构设计——多智能体(Multi-Agent)系统——正变得越来越流行。像AutoGen和OpenAI Swarm这样的框架,都在积极推广一种理念:将一个复杂的任务分解,交给多个专门的、并行的“子智能体”去处理,最后再将结果汇总。这种模仿人类团队协作的模式,在理论上似乎能带来更高的效率和模块化。

然而,来自Cognition AI(现象级AI软件工程师Devin的创造者)的首席科学家Walden Yan却在其博客中讨论了一个反向思考:“不要构建多智能体”,系统性地剖析了为何当前的多智能体架构在实践中往往是“几乎注定不可靠的”(Almost Surely Unreliable),并提出了两条构建可靠智能体的核心原则——**上下文工程(Context Engineering)**的基石。

1. 引言:多智能体的现实遭遇

LLM Agent的相当于当前的Web开发的早期阶段,如同当年从原始HTML/CSS到React.js的范式飞跃,当前的Agent构建领域也正迫切需要一套经过实践检验的、可靠的设计哲学或原则。

多智能体架构,承诺通过“分而治之”和并行化来提升效率,就像一个项目经理将任务分