ComfyUI ControlNet 保姆级教程:开箱即用的示例工作流,精准控制AI图像生成

在AI图像生成领域,Stable Diffusion虽强大,但传统方式下用户往往难以精确控制生成内容的结构与细节——直到ControlNet的出现改变了这一局面。然而,对于很多初学者来说,节点式操作界面如ComfyUI的门槛依然不低。为此,我们推出了comfyui_controlnet_example示例项目,通过提供即插即用的工作流模板,帮助用户轻松实现基于ControlNet的精准图像生成控制。

comfyui_controlnet_example通过一系列现成的ComfyUI工作流示例,系统性地演示如何利用ControlNet技术,使AI生成的图像严格遵循用户指定的结构条件(如边缘轮廓、人体姿态、深度信息等),彻底解决传统Stable Diffusion模型生成结果“不可控”的痛点。

核心亮点

1. 开箱即用,无需从零搭建

提供精心设计、可直接导入的 .json 格式工作流文件,每个文件已预配置完整的节点连接(包括Stable Diffusion主模型、ControlNet模型、预处理器、采样器等)。无需理解复杂节点逻辑,导入ComfyUI即可一键运行。

2. 覆盖多种控制场景

示例包含ControlNet最典型的应用方向,适合不同需求的使用者:

-

边缘控制(Canny):通过边缘图控制生成图像的轮廓结构;

-

姿态控制(OpenPose):依据人体骨骼图精准生成对应姿态的人物;

-

草图控制(Scribble):将手绘涂鸦转化为真实感图像;

-

深度控制(Depth):利用深度图引导生成具备合理空间层次的场景。

3. 附赠参数调优指南

每个示例不仅可运行,还包含关键参数的说明与推荐值(如ControlNet权重、采样步数、CFG Scale等),明确解释参数作用与效果影响,帮助用户快速理解如何调试出最佳结果。

4. 新手友好,降低入门门槛

附带从环境配置到模型加载的详细说明,包括:

-

模型安装应放置的路径;

-

每个输入/输出节点的作用;

-

常见生成问题的排查方法。

即便你是刚接触ComfyUI或ControlNet的新手,也能快速复现效果,高效上手。

5. 易于扩展与自定义

所有工作流均具备高度可定制性:你可以替换自己的线稿、姿态图或深度图,也可更换不同风格的SD模型,快速适配个人项目需求,扩展性极强。

使用场景

-

希望快速验证ControlNet效果的个人开发者;

-

想要在商业设计、概念创作、角色设定等场景中控制图像结构的内容创作者;

-

ComfyUI 初学者,希望理解节点流程与控制逻辑的学习者;

-

需要将ControlNet技术集成到工作流中的项目团队。

操作步骤

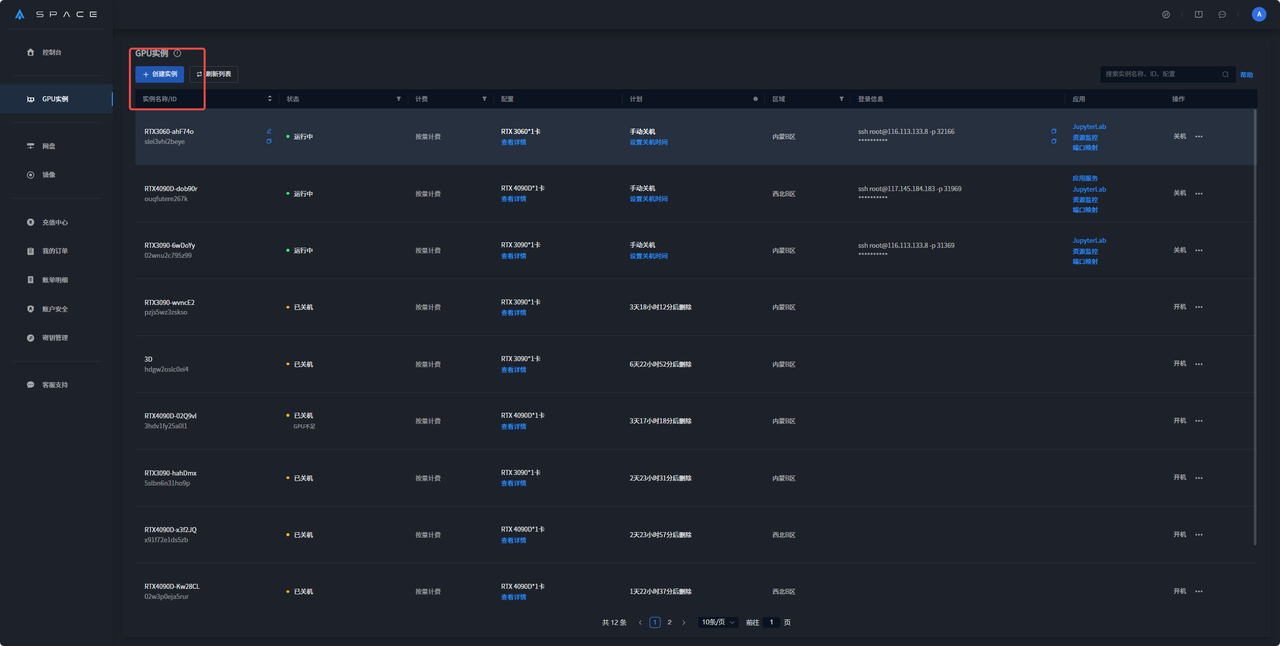

1.在GPU实例界面中选择创建实例星海智算-GPU算力云平台

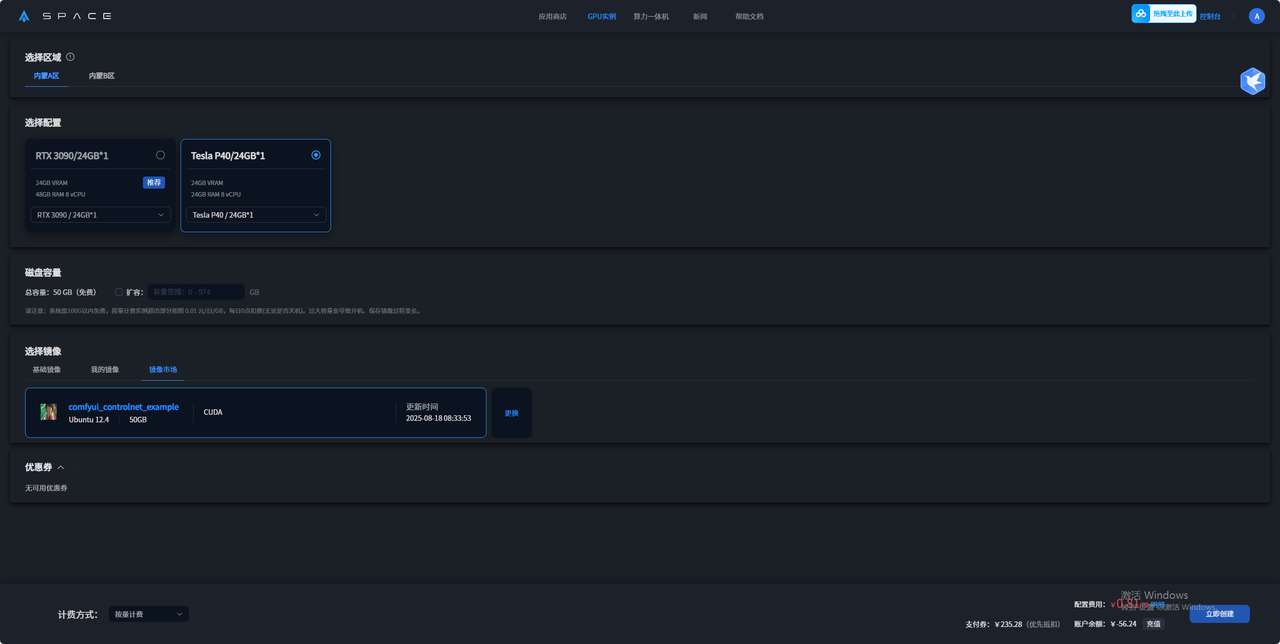

2.选择好所在区域、所需配置、计费方式后在镜像市场搜索comfyui_controlnet_example镜像

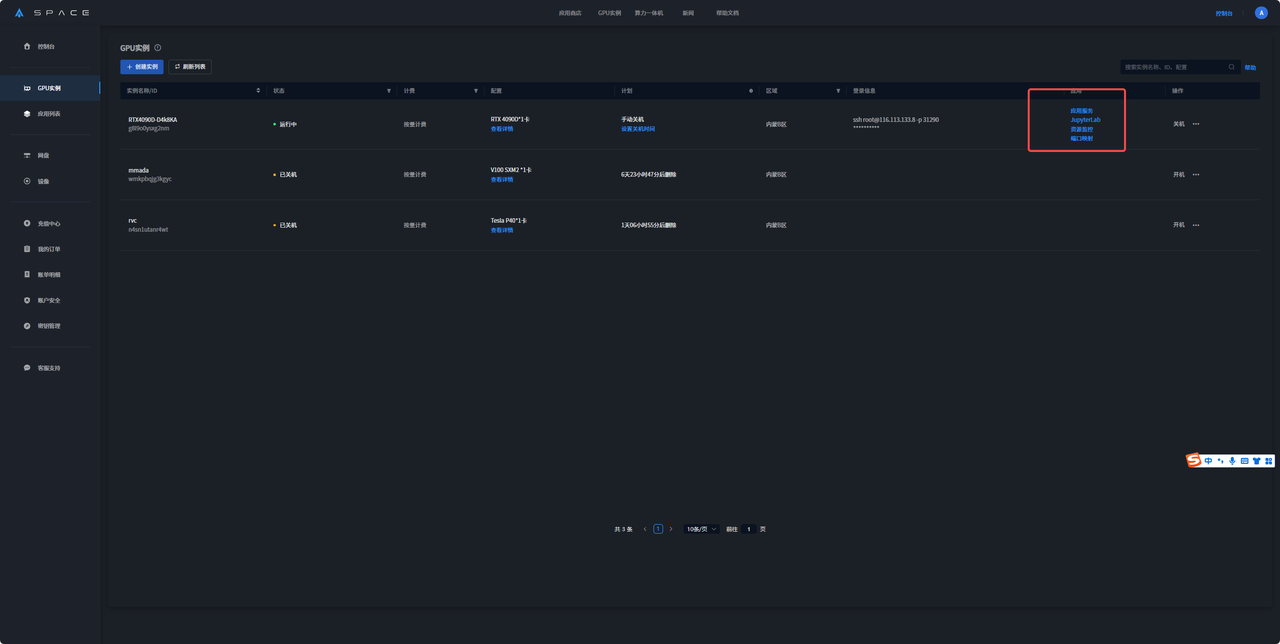

3.开机后等模型加载几分钟 点击应用服务

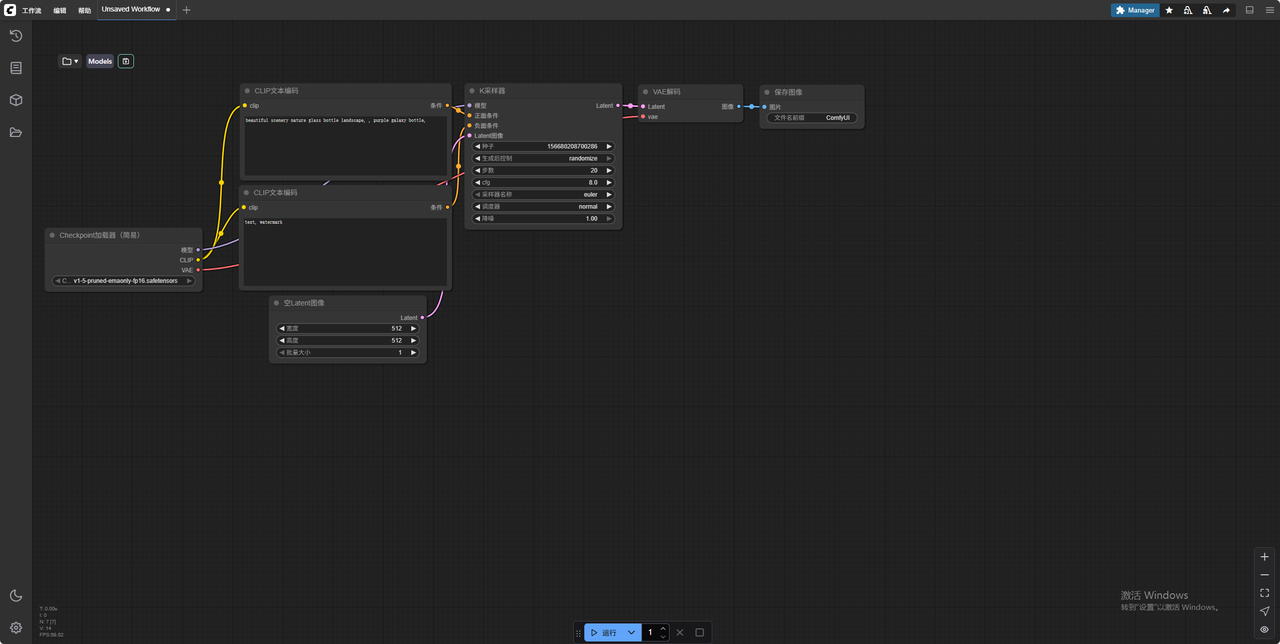

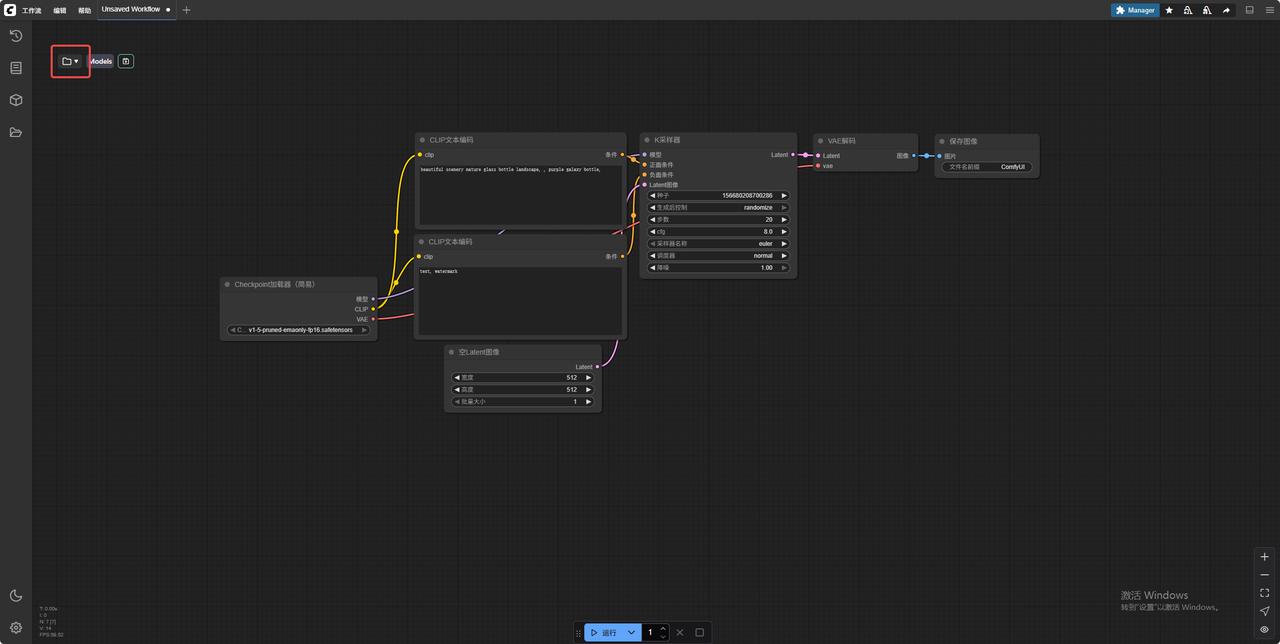

打开界面如下:

5.点击文件夹图标

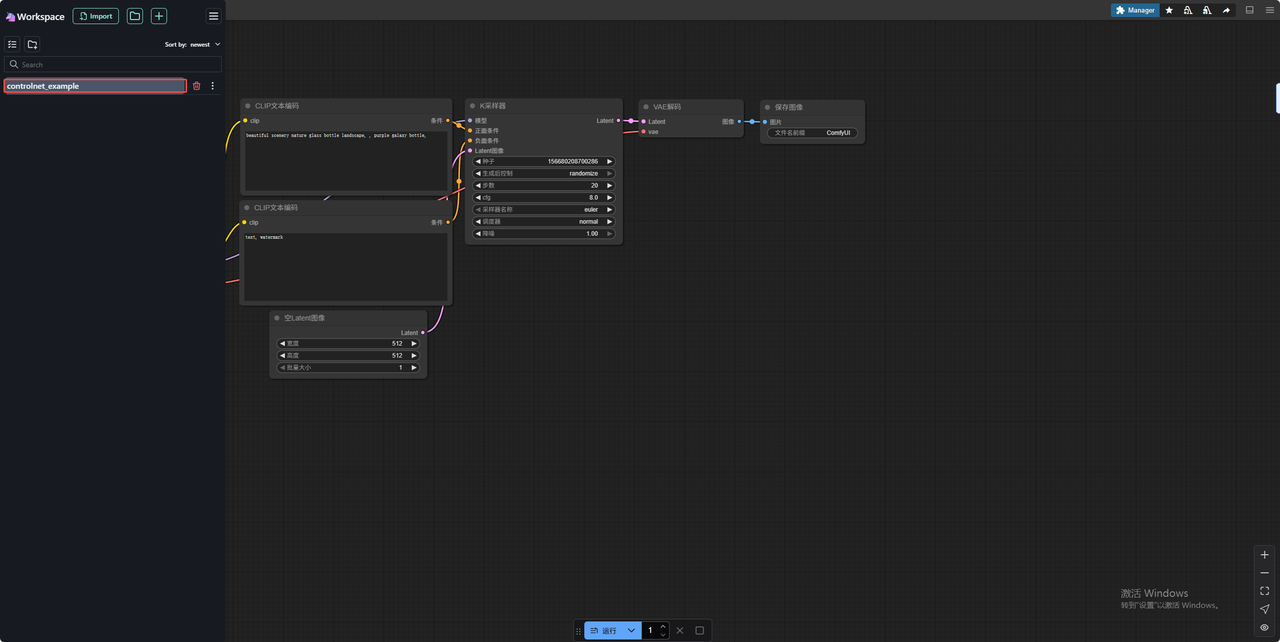

6.选择工作流

打开界面如下

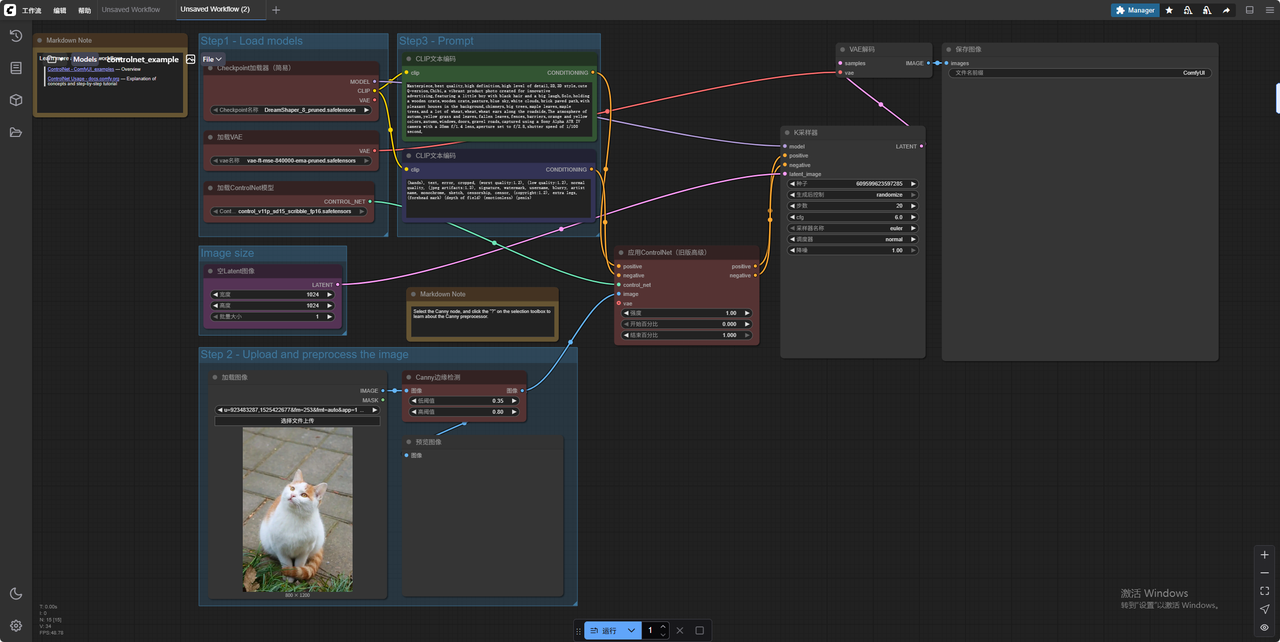

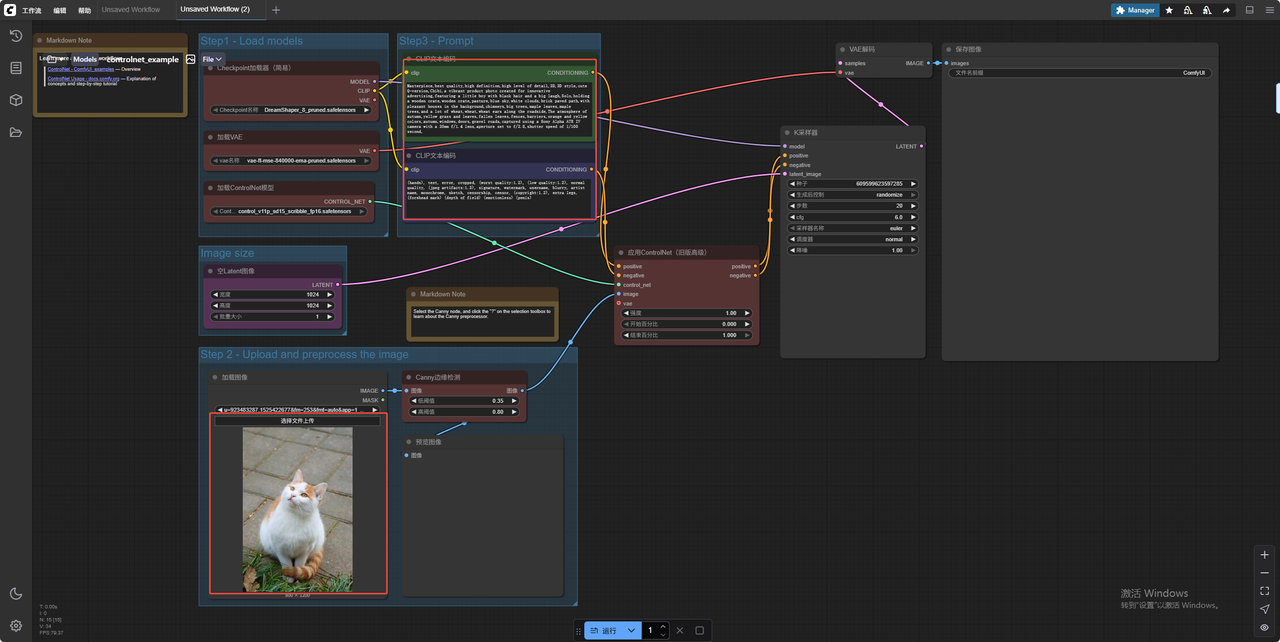

7.上传图片、输入提示词 点击运行

8.生成结果