深度学习:概念、特点和发展史

前言:前面分享了机器学习,接下来进行深度学习分享。

本文目录:

- 一、什么是深度学习

- 二、深度学习特点

- 三、深度学习核心概念

- 四、常见的深度学习模型

- 五、深度学习应用场景

- 六、深度学习发展历史

一、什么是深度学习

深度学习(Deep Learning)是机器学习的分支,是一种以人工神经网络为架构,对数据进行特征学习的算法。深度学习中的形容词“深度”是指在网络中使用多层。

传统机器学习算术依赖人工设计特征,并进行特征提取,而深度学习方法不需要人工,而是依赖算法自动提取特征。

深度学习模仿人类大脑的运行方式,从经验中学习获取知识。这也是深度学习被看做黑盒子,可解释性差的原因。

深度学习尤其擅长处理高维数据,如图像和文本。

二、深度学习特点

多层非线性变换:深度学习模型由多个层次组成,每一层都应用非线性激活函数对输入数据进行变换。较低的层级通常捕捉到简单的特征(如边缘、颜色等),而更高的层级则可以识别更复杂的模式(如物体或面部识别)。

自动特征提取:与传统机器学习算法不同,深度学习能够自动从原始数据中学习到有用的特征,而不需要人工特征工程。这使得深度学习在许多领域中表现出色。

大数据和计算能力:深度学习模型通常需要大量的标注数据和强大的计算资源(如GPU)来进行训练。大数据和高性能计算使得深度学习在图像识别、自然语言处理等领域取得了显著突破。

可解释性差:深度学习模型内部的运作机制相对不透明,被称为“黑箱”,这意味着理解模型为什么做出特定决策可能会比较困难。这对某些应用场景来说是一个挑战。

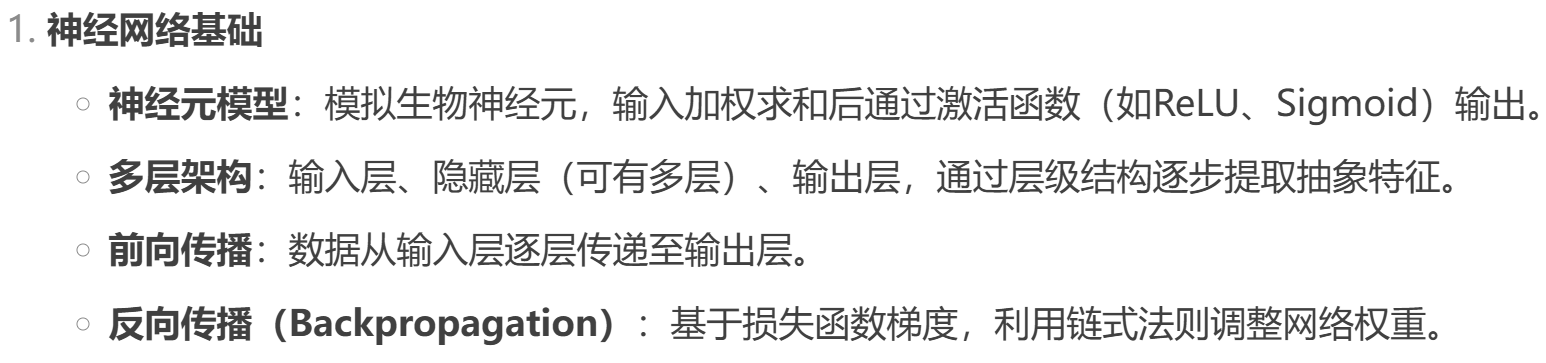

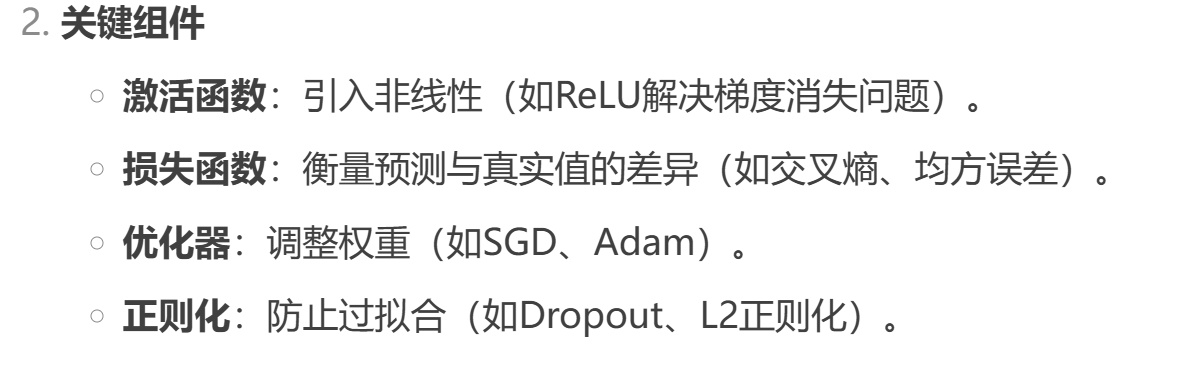

三、深度学习核心概念

四、常见的深度学习模型

- 卷积神经网络 (Convolutional Neural Networks, CNN):

- 主要用于图像处理任务,如图像分类、目标检测、图像分割等。

- 特点是使用卷积层来自动提取图像中的局部特征,并通过池化层减少参数数量,提高计算效率。

- 循环神经网络 (Recurrent Neural Networks, RNN):

- 适用于处理序列数据,例如自然语言处理(NLP)、语音识别等。

- RNN具有记忆功能,可以处理输入数据的时间依赖性,但标准RNN难以捕捉长期依赖关系。

- 自编码器 (Autoencoders):

- 一种无监督学习模型,通常用于降维、特征学习或者异常检测。

- 自编码器由编码器和解码器两部分组成,前者将输入压缩成一个较低维度的表示,后者尝试从这个低维表示重建原始输入。

- 生成对抗网络 (Generative Adversarial Networks, GAN):

- 包含两个子网络:生成器和判别器。生成器负责创建看起来真实的假样本,而判别器则试图区分真假样本。

- GAN广泛应用于图像生成、视频合成等领域。

- Transformer:

- 主要用于自然语言处理(NLP)任务,尤其是机器翻译、文本生成等。

- Transformer摒弃了传统的递归结构,采用自注意力机制(self-attention),使得它能够并行处理整个句子的信息,在机器翻译、文本摘要等任务中表现出色。

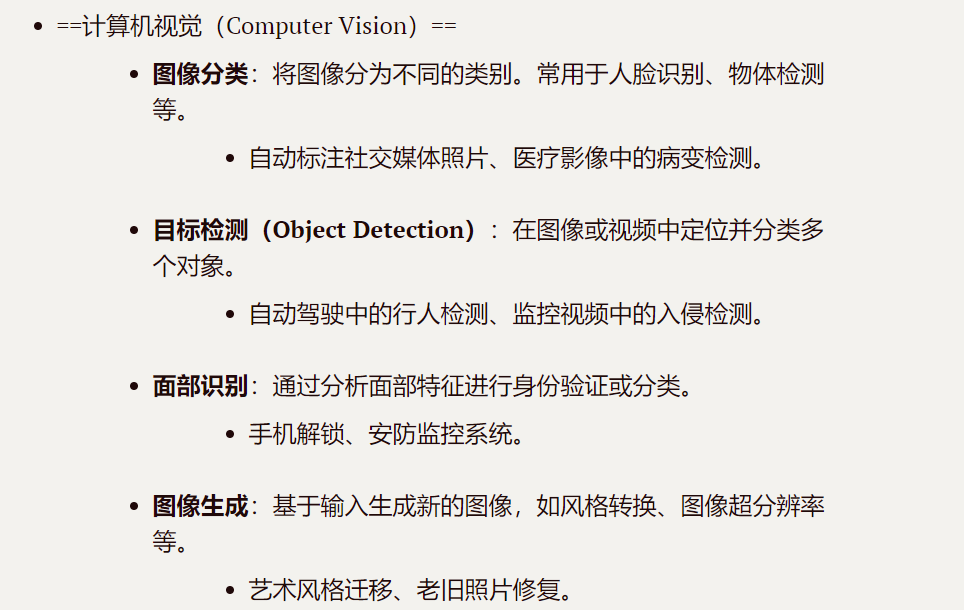

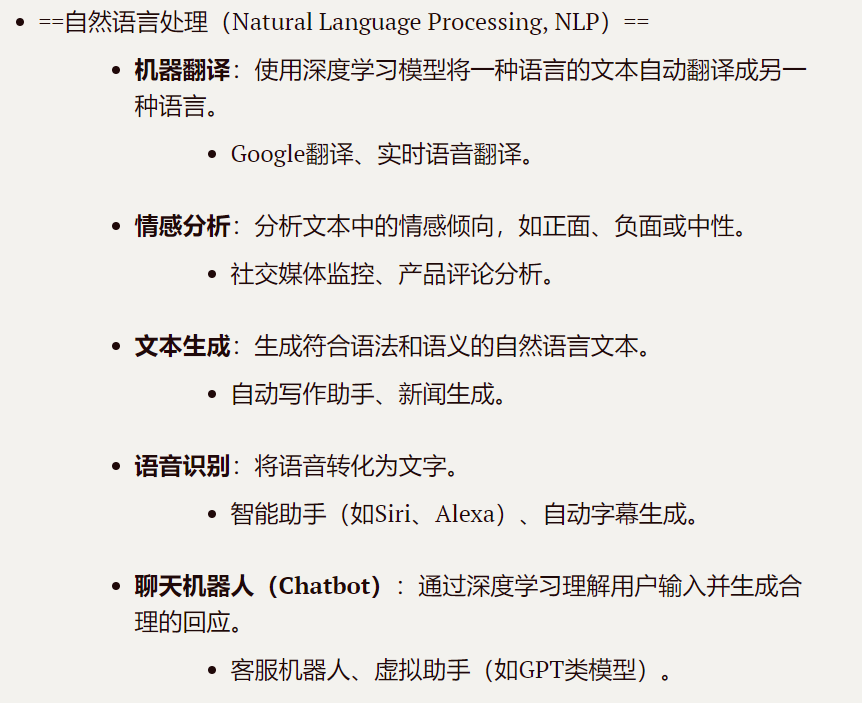

五、深度学习应用场景

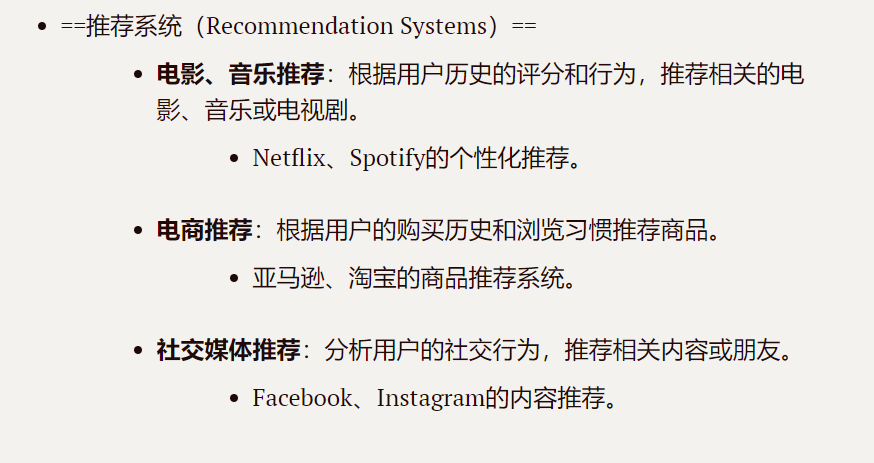

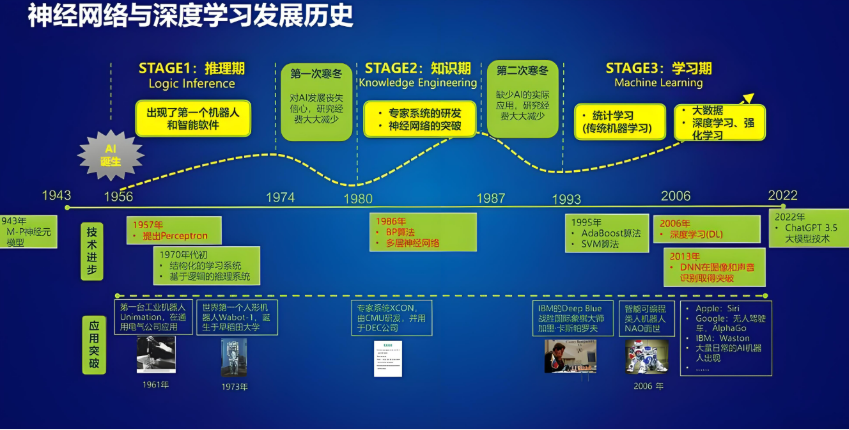

六、深度学习发展历史

最后,深度学习当前挑战:

今天关于深度学习的分享到此结束。