马斯克杀入AI编程!xAI新模型Grok Code Fast 1发布,深度评测:速度、价格与API上手指南

AI 编程的赛道,又迎来一位重量级玩家——马斯克的 xAI。

就在最近,xAI 悄然发布了一款专为编码而生的新模型:Grok Code Fast 1。这款模型最初以代号“Sonic”在内部流传,如今正式亮相,便凭借其 256K 超长上下文、惊人的速度和极具竞争力的价格,迅速在开发者社区掀起波澜。

更重要的是,它目前已在多个平台开放限时免费试用!这究竟是 xAI 的一次炫技,还是将改变我们编程方式的又一利器?本文将为你带来全方位的深度解析和上手指南。

01. 背景:不止是快,更是为“AI 代理”而生

Grok Code Fast 1 并非凭空出世。它是 xAI Grok 产品线中的一个垂直变体,与通用的 Grok-3 或 Grok-4 不同,它的目标非常明确:专注并优化代理式编码(Agentic Coding)任务。

什么是代理式编码?简单来说,就是让 AI 不再仅仅是一个代码补全或问答工具,而是成为一个能够理解复杂任务、自主规划步骤、调用外部工具(如 API、数据库)、并最终交付完整解决方案的智能代理。

为了实现这个目标,xAI 将 Grok Code Fast 1 的核心定位为“快、准、省”:

- 快 (Fast) :为实时交互和高频任务设计,减少开发者等待时间。

- 准 (Accurate) :继承 Grok 系列的强大推理能力,并针对编码场景进行微调。

- 省 (Economical) :提供极具吸引力的定价,降低企业和个人开发者的使用门槛。

发布后,xAI 迅速将其推向主流生态,目前已集成到 OpenRouter、Poe、Vercel AI Gateway,甚至进入了 GitHub Copilot 的公共预览版。这种开放的姿态,无疑是 xAI 在 AI 代理时代抢占开发者心智的重要一步。

02. 核心特性:是什么让它与众不同?

Grok Code Fast 1 的强大之处,在于其专为开发者痛点设计的一系列功能。

1. 代理式编码支持 (Agentic Coding)

这是它的核心亮点。它能处理复杂的工作流,例如:

“分析我们项目的用户反馈数据库,找出TOP 3的功能需求,并为这些需求生成初步的 API 设计和 Python 实现代码。”

在这个任务中,它需要分解问题、查询数据库(通过函数调用)、分析数据、最后再生成代码,这已经远远超出了传统代码生成器的范畴。

2. 可见推理痕迹 (Visible Reasoning Traces)

这是开发者梦寐以求的功能!在给出最终答案前,Grok Code Fast 1 会展示它的“思考过程”。它就像给 AI 的大脑装上了一个“监视器”,让你能清楚地看到:

- 它是如何理解你的问题的?

- 它计划分几步来解决?

- 每一步的推理依据是什么?

这种透明度极大地提升了 AI 的可控性和可调试性。当结果不符合预期时,你可以根据推理痕迹快速定位问题,并优化你的提示词(Prompt)。

3. 强大的可控性与工具使用 (Steerability & Function Calling)

模型提供了高度可调的行为机制。你可以通过 Prompt 精确控制其输出风格、代码规范和解决方案的侧重点。同时,它原生支持函数调用和外部工具集成,可以轻松连接你的 API、数据库或任何内部系统,构建强大的自动化工作流。

4. 256K 超长上下文窗口

256,000 tokens 的上下文长度意味着什么?

- 轻松处理整个代码库:你可以把一个中小型项目的所有核心代码都喂给它,让它进行重构、添加新功能或修复深层 Bug。

- 理解复杂文档:无论是厚厚的 API 文档还是项目需求书,它都能完整消化,并在此基础上进行开发。

- 长链条推理:在复杂的调试过程中,它不会因为对话过长而“忘记”前面的关键信息。

5. 结构化输出 (Structured Outputs)

模型可以稳定地以 JSON 等格式返回响应,这对于需要进行程序化解析和集成的应用场景至关重要,让 AI 的输出能无缝对接到你的开发工具链中。

03. 性能与技术规格:它到底有多能打?

尽管 xAI 未公布模型的具体参数规模,但从其表现来看,它无疑是基于百亿级参数的大模型,并在海量高质量代码和推理数据上进行了深度微调。

- 上下文长度:256,000 tokens

- 知识截止日期:可能与 Grok 3 相似(2024年11月)

- 性能表现:根据第三方平台(如 Rival)的初步评测,Grok Code Fast 1 在编码生成、视觉数学推理和文档问答等基准测试中,表现优于或持平于 Claude 3.5 Sonnet 和 GPT-4-Turbo,但在响应速度和成本上优势明显。

xAI 官方声称,在企业级任务中,该模型结合其独特的缓存输入令牌机制,最高可将成本降低 20%-50%。

04. 如何上手?API 访问与定价指南

心动不如行动,接入 Grok Code Fast 1 非常简单。

访问方式

- 官方 API:通过 xAI 官网申请 API 密钥,其接口与 OpenAI API 兼容,迁移成本极低。

- 第三方平台:

- OpenRouter / Poe:最便捷的体验入口。

- Vercel AI Gateway:方便 Web 开发者集成。

- GitHub Copilot Pro:已在公共预览版中提供,值得关注。

3.国内开发者:获取Grok Code Fast 1获取APIkey uiuiAPI.com

-

关键点说明 API连接: 以下模型版本都可使用UIUI API的OpenAI兼容接口(

https://sg.uiuiapi.com/v1/chat/completions) -

注意事项: 用户需要在UIUI API Token页面](

https://sg.uiuiapi.com/console/token)创建自己的API Token

Python API 调用示例

如果你熟悉 OpenAI 的库,那么上手 Grok Code Fast 1 几乎是零成本。

import os

from openai import OpenAI# 推荐使用环境变量设置 API Key

# export XAI_API_KEY='YOUR_XAI_API_KEY'client = OpenAI(api_key=os.environ.get("XAI_API_KEY"),base_url="https://uiuiapi地址/v1"

)MODEL_NAME = "grok-code-fast-1"response = client.chat.completions.create(model=MODEL_NAME,messages=[{"role": "system", "content": "You are a helpful assistant that specializes in writing Python code."},{"role": "user", "content": "Write a Python function to check if a number is prime."}]

)print(response.choices[0].message.content)

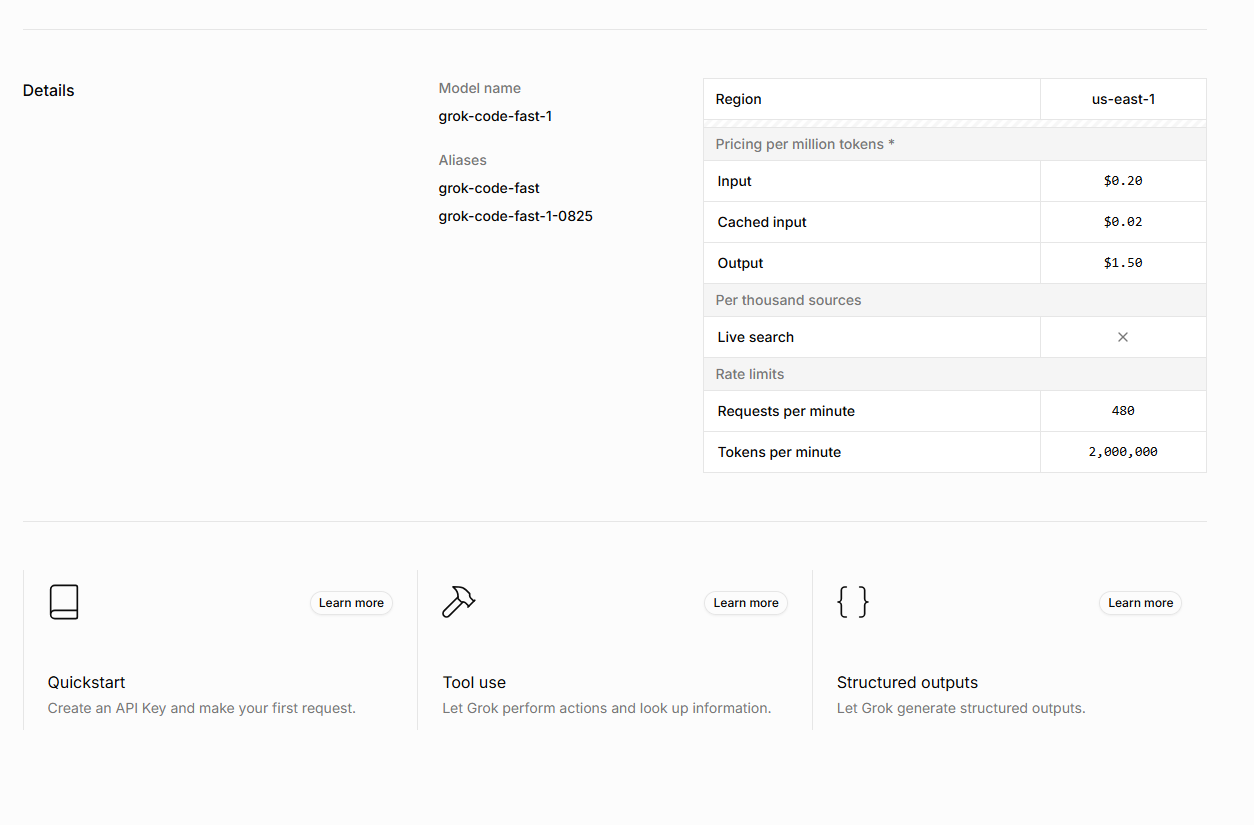

定价策略

Grok Code Fast 1 的定价极具竞争力,尤其是其输入 Token 缓存机制,对重复查询或上下文复用场景非常友好。

- 输入令牌:$0.20 / 1M tokens

- 缓存输入令牌:$0.02 / 1M tokens (便宜 90%!)

- 输出令牌:$1.50 / 1M tokens

- 速率限制:480 请求/分钟,2,000,000 tokens/分钟

05. 横向对比:它与 GPT-4, Claude 3.5 Sonnet 有何不同?

为了让你更清晰地了解它的定位,我们将其与市面上主流的编码模型进行一个简单对比。

| 特性 | Grok Code Fast 1 | GPT-4o / Turbo | Claude 3.5 Sonnet |

|---|---|---|---|

| 核心优势 | 速度、成本、代理式编码、推理透明 | 通用能力强、多模态、生态成熟 | 速度快、性价比高、视觉能力强 |

| 上下文 | 256K | 128K | 200K |

| 响应速度 | 极快 | 较快 | 极快 |

| 成本 | 极低 | 较高 | 较低 |

| 推理痕迹 | 原生支持 | 不支持 | 不支持 |

| 最佳场景 | 实时编码、自动化工作流、AI 代理开发 | 复杂通用任务、创意生成、多模态应用 | 高速文本处理、代码生成、视觉分析 |

简单来说,如果你追求极致的通用能力和多模态,GPT-4o 仍是首选。如果你需要顶级的速度和视觉能力,Claude 3.5 Sonnet 是强有力的竞争者。

而 Grok Code Fast 1 则在编码代理这个垂直赛道上开辟了一条新路径,它更像一个为专业开发者定制的、追求极致效率和可控性的工具。

界智通(jieagi)结语:AI 编程进入“代理”时代

Grok Code Fast 1 的发布,不仅仅是又一个强大的代码模型,它更是一个信号:AI 编程正在从“辅助工具”向“智能代理”进化。它将速度、经济性与前所未有的透明度融为一体,让开发者从被动地“使用”AI,转向主动地“驾驭”AI。

随着 xAI 生态的不断完善,我们有理由相信,未来将有更多强大的工具集成到这个模型中,构建出更复杂的自动化开发系统。

对于我们开发者而言,这是一个不容错过的机会。趁着限时免费,赶紧去亲自上手体验一下吧!

你对 Grok Code Fast 1 有什么看法?你认为它会改变你的工作流吗?欢迎在评论区留言讨论!