强强联合:OpenAI正式登陆AWS!

今日, AWS宣布将首次通过Amazon Bedrock和Amazon SageMaker AI平台提供OpenAI开源模型,使客户能够快速便捷地构建生成式AI应用。OpenAI最新发布的两款开源基础模型——gpt-oss-120b和gpt-oss-20b——将为各类组织提供更强大的人工智能技术,并通过全球覆盖最广、应用最广泛的AWS云平台向数百万客户开放,从而扩大OpenAI领先技术的影响力。

在Amazon Bedrock平台上运行的OpenAI模型的性价比是同类Gemini模型的3倍、DeepSeek-R1模型的5倍,以及同类OpenAI o4模型的2倍。这一举措延续了AWS对模型多样化的承诺:Choice matters,说到做到!既丰富了Amazon Bedrock现有全托管模型的广泛选择,又通过Amazon SageMaker JumpStart平台提供访问入口,进一步巩固了AWS在提供创新生成式AI技术以满足客户需求方面的领先优势。

新闻原文链接:https://www.aboutamazon.com/news/aws/openai-models-amazon-bedrock-sagemaker

博客链接:https://aws.amazon.com/blogs/machine-learning/gpt-oss-models-from-openai-are-now-available-on-sagemaker-jumpstart/

最新Claude 混合推理模型上线Amazon Bedrock!

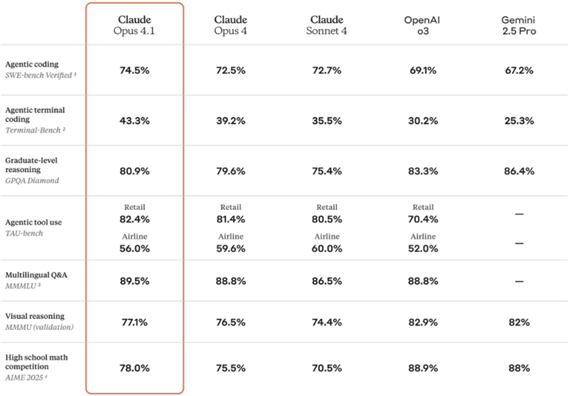

AWS宣布Anthropic公司最新一代模型Claude Opus 4.1和Claude Sonnet 4已在Amazon Bedrock正式上线。这类新型混合推理模型(可在近实时响应与深度思考模式间切换)为编码、高级推理和多步骤工作流树立了新标杆,不仅能持续处理复杂的长周期任务,更能驱动AI智能体实现"数小时工作分钟级完成"的突破性效能。

通过将Claude Opus 4.1和Claude Sonnet 4接入Amazon Bedrock,AWS进一步扩展了客户的人工智能选择,使其能基于Anthropic最先进的模型构建更优质、更具变革性的应用,同时享受企业级安全防护与负责任的AI治理框架。

新闻原文链接:https://www.aboutamazon.com/news/aws/anthropic-claude-4-opus-sonnet-amazon-bedrock

结合亚马逊CEO Andy Jassy财报电话会的观点

决定AI竞赛最终胜负的,并非一时的冲刺速度,而是全面的战略耐力。

“现在谈论输赢为时过早” Jassy的核心论点是,当前的AI市场格局远未成型。他表示:“我认为现在谈论AI还为时过早。”他将当前的市场形容为“非常头重脚轻(top heavy)”,即少数大型基础模型的训练和少数几个大规模生成式AI应用(如聊天机器人和代码助手)占据了绝大部分算力消耗。Jassy认为,绝大多数企业的AI应用仍处于试点或开发阶段,尚未进入大规模生产部署。他强调,随着市场走向成熟,客户的需求将变得更加多样化,届时AWS的优势将得以体现。他试图传达的信息是,评判AI竞赛的座次不能只看起跑阶段,而应着眼于更长远的未来。

全栈布局:从自研芯片到AI应用。

底层硬件与算力:Jassy强调,AI成本的80%至90%最终将来自推理(inference),而非训练。为此,AWS除了与英伟达保持深度合作外,还大力投入自研芯片。他高调亮出其第二代AI芯片Trainium2,称其“性价比比其他GPU供应商高出30%到40%”,并已成为Anthropic等公司新一代模型训练的支柱。他认为,这种成本优势将在客户大规模部署AI应用时变得至关重要。

中层模型与工具:在模型服务层,Jassy指出,AWS的Bedrock平台因提供多样化的第三方和自研模型选择而“增长非常可观”。同时,为了解决企业在构建和部署AI代理(agents)时遇到的困难,AWS推出了开源工具Strands和安全部署框架AgentCore,旨在降低开发门槛,加速应用落地。

顶层应用:Jassy还列举了AWS直接推出的AI应用,如帮助企业进行大型机现代化改造的AWS Transform和新发布的AI编程助手Kiro,以此证明AWS不仅提供基础设施,也在为客户创造直接的应用价值。

庞大客户基础是最终护城河。Jassy的另一个关键论点是AWS庞大的现有生态系统所构成的强大护城河。他提醒投资者,生成式AI的推理工作负载,最终将像计算、存储和数据库一样,成为云服务的一个基础构建模块。

“人们最终会希望将这些AI应用运行在他们其他应用和数据所在的地方,”Jassy说。“而在AWS上运行的应用和数据,远比其他任何地方都多。”他认为,这种与客户现有IT架构的深度绑定,将使AWS在AI应用规模化普及时,拥有天然的客户粘性优势。对于AWS业务的未来,Jassy表示乐观,他相信随着更多企业重启上云进程以及AI应用的规模化部署,加上产能瓶颈的逐步缓解,AWS业务将迎来新的增长动力。