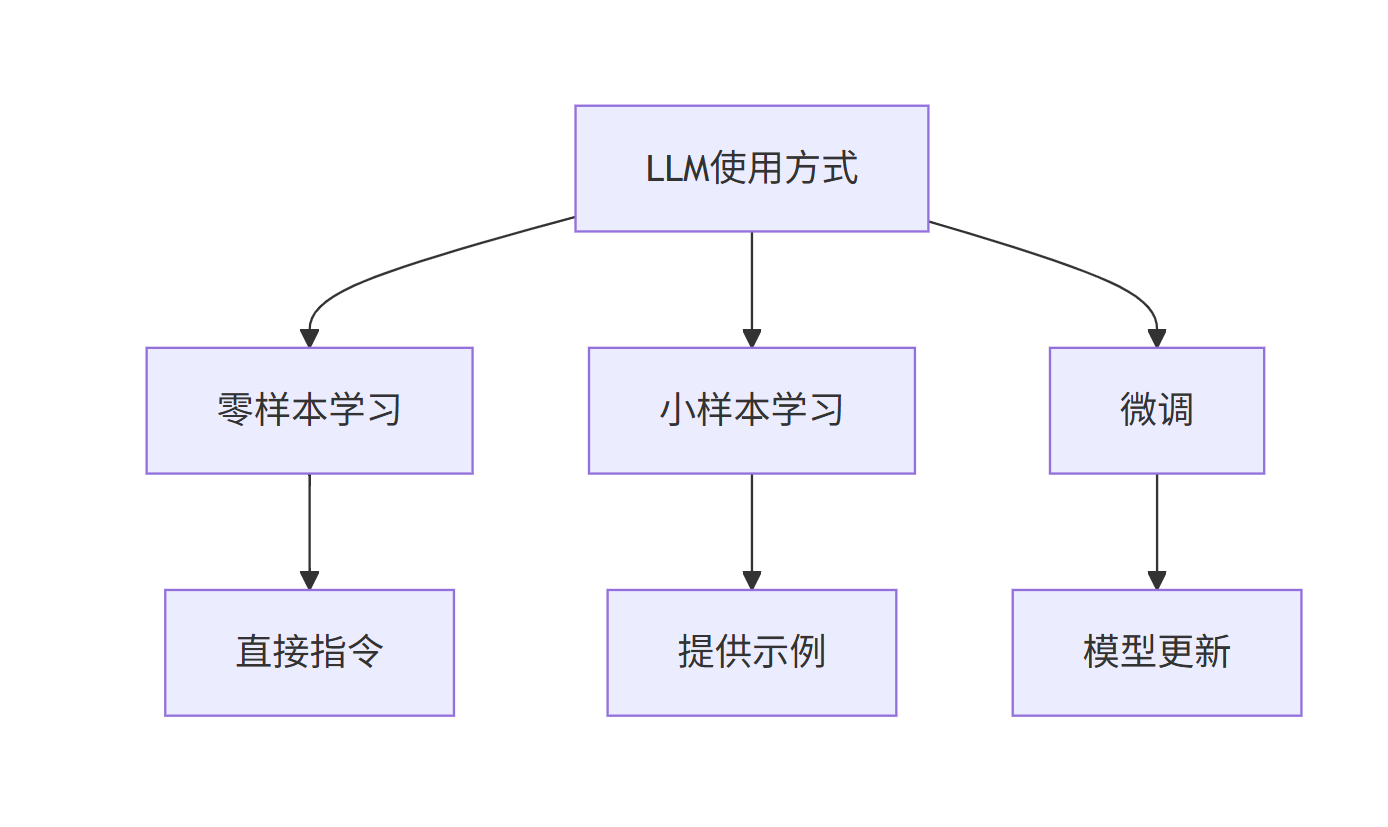

一文分清:零样本、小样本、微调,使用 LLM 的三种方式

使用大语言模型就像雇佣一名新员工:你可以直接下达指令,提供几个例子让他模仿,或者进行专业培训让他成为领域专家。这三种方式对应着LLM的三种核心使用方法。

核心概念一览

零样本学习:直接下达指令

什么是零样本学习?

零样本学习要求模型在没有见过任何示例的情况下,直接完成新任务。

# 零样本的基本模式

用户输入 = "任务指令"

模型输出 = 模型理解并执行(用户输入)# 不需要提供任何例子!

实际应用示例

# 情感分析

零样本提示 = """

判断以下评论的情感倾向:正面、负面或中立。评论:这部电影的视觉效果很棒,但剧情太拖沓了。

情感倾向:

"""# 模型输出:"中立" 或 "混合"# 文本分类

零样本提示 = """

将以下文本分类到合适类别:科技、体育、娱乐、财经文本:OpenAI发布了新一代语言模型,在多项测试中表现优异。

类别:

"""# 模型输出:"科技"

零样本的优势与局限

| 优势 | 局限 |

|---|---|

| 使用简单,直接提问 | 复杂任务效果有限 |

| 无需准备训练数据 | 输出风格不可控 |

| 快速验证想法 | 专业领域准确率低 |

| 成本最低 | 需要精心设计提示词 |

小样本学习:提供示范案例

什么是小样本学习?

小样本学习通过提供少量示例(通常1-10个),让模型理解任务模式。

# 小样本学习的基本模式

小样本提示 = """

任务描述

示例1输入 → 示例1输出

示例2输入 → 示例2输出

...

示例N输入 → 示例N输出新输入 → ?

"""

实际应用示例

# 情感分析(小样本版本)

小样本提示 = """

根据示例判断评论的情感倾向。示例1:

评论:这个产品质量太差了,完全不值这个价钱。

情感:负面示例2:

评论:服务态度很好,物流也很快。

情感:正面示例3:

评论:一般般吧,没什么特别的感觉。

情感:中立现在请判断:

评论:画面精美,演员演技在线,但故事逻辑有问题。

情感:

"""# 模型输出:"混合" 或 "中立偏负面"

更复杂的小样本应用

# 代码生成小样本示例

小样本提示 = """

根据示例将自然语言转换为Python代码。示例1:

输入:计算列表的平均值

输出:

def calculate_average(numbers):return sum(numbers) / len(numbers)示例2:

输入:检查字符串是否是回文

输出:

def is_palindrome(s):return s == s[::-1]现在请转换:

输入:找出列表中的最大值

输出:

"""# 模型能够生成正确的函数代码

小样本学习的优势

微调:定制专属模型

什么是微调?

微调是在特定数据集上继续训练基础模型,使其适应特定领域或任务。

# 微调的基本过程

def 微调模型(基础模型, 训练数据):for 输入, 期望输出 in 训练数据:当前输出 = 基础模型(输入)损失 = 计算损失(当前输出, 期望输出)更新模型参数(损失)return 微调后的模型

微调的实际场景

# 医疗领域微调示例

微调数据 = [{"input": "患者主诉头痛、发热,体温38.5℃,应该考虑什么?","output": "可能考虑上呼吸道感染、流感等,建议进一步检查血常规"},{"input": "高血压患者用药注意事项?", "output": "应定期监测血压,遵医嘱服药,注意低盐饮食,避免突然停药"}# ... 数千个类似的医疗问答对

]# 微调后的模型在医疗咨询中表现更好

微调的三个层次

1. 全参数微调

全参数微调 = {"描述": "更新模型所有权重参数","数据需求": "大量高质量数据(万级以上)","计算成本": "非常高","效果": "最好,但容易过拟合","适用场景": "重大业务需求,有充足资源"

}

2. 参数高效微调(PEFT)

LoRA微调 = {"描述": "只训练少量附加参数,冻结原模型","数据需求": "中等数据(千级)", "计算成本": "中等","效果": "接近全参数微调","适用场景": "大多数业务场景"

}

3. 适配器微调

适配器微调 = {"描述": "在模型中插入小型适配器层","数据需求": "较少数据(百级)","计算成本": "较低","效果": "良好","适用场景": "资源有限的情况"

}

三种方式对比分析

技术特性对比

对比表 = {"零样本学习": {"数据需求": "无","准备时间": "分钟级", "计算成本": "最低","灵活性": "最高","准确性": "基础任务良好","适用阶段": "探索期、简单任务"},"小样本学习": {"数据需求": "少量示例(1-100个)","准备时间": "小时级","计算成本": "低", "灵活性": "高","准确性": "中等复杂任务良好","适用阶段": "原型开发、中等复杂任务"},"微调": {"数据需求": "大量标注数据(千级以上)","准备时间": "天到周级","计算成本": "高","灵活性": "较低","准确性": "专业任务优秀", "适用阶段": "生产环境、专业领域"}

}

可视化对比

实际选择指南

决策流程图

def 选择使用方式(任务需求, 可用资源):if 任务需求.复杂度 == "低" and 可用资源.数据 == 0:return "零样本学习"elif 任务需求.复杂度 == "中" and 可用资源.数据 < 1000:return "小样本学习"elif 任务需求.复杂度 == "高" and 可用资源.数据 > 1000:return "微调"else:return "从小样本开始,逐步评估"

行业应用示例

客服机器人

客服场景 = {"零样本": "处理简单FAQ,如'营业时间''地址'","小样本": "处理常见问题,提供3-5个回答示例", "微调": "专业领域客服,使用历史对话数据训练"

}

代码助手

代码助手场景 = {"零样本": "基础代码补全,简单函数生成","小样本": "特定框架代码,提供API使用示例","微调": "公司内部代码规范,专用库函数"

}

内容创作

内容创作场景 = {"零样本": "通用文案写作,头脑风暴","小样本": "品牌风格文案,提供风格示例", "微调":专业领域写作,如法律文件、学术论文"

}

进阶技巧与最佳实践

小样本学习的示例选择

def 选择小样本示例(任务类型, 多样性要求):示例选择策略 = {"分类任务": "选择每个类别的代表性样本","生成任务": "选择不同风格和长度的样本", "推理任务": "选择展示不同推理路径的样本"}return 筛选示例(示例池, 示例选择策略[任务类型])

微调的数据准备

微调数据准备清单 = ["数据质量:人工审核确保准确性","数据规模:千级以上标注样本", "数据分布:覆盖所有预期场景","数据清洗:去除噪声和矛盾数据","数据分割:训练集/验证集/测试集"

]

混合使用策略

# 实际项目中的混合策略

def 混合策略(项目需求):# 先用零样本验证想法初步结果 = 零样本测试(项目需求.核心任务)if 初步结果.满意度 > 0.7:# 效果不错,用小样本优化return 小样本优化(项目需求, 收集少量示例())else:# 需要专业能力,考虑微调return 评估微调可行性(项目需求)

成本与效益分析

经济成本对比

| 方面 | 零样本 | 小样本 | 微调 |

|---|---|---|---|

| 数据成本 | 无 | 低(标注少量示例) | 高(大量标注数据) |

| 计算成本 | 仅推理成本 | 仅推理成本 | 训练+推理成本 |

| 时间成本 | 即时 | 小时级准备 | 天级到周级 |

| 维护成本 | 无 | 低 | 中到高 |

效果收益对比

未来发展趋势

技术演进方向

未来趋势 = {"零样本": "更强大的基础模型,减少对示例的依赖","小样本": "更智能的示例选择和提示词优化", "微调": "更高效的参数高效微调技术","混合方法": "根据任务动态选择最佳方式"

}

新兴范式

新兴技术 = {"提示词学习": "将微调转化为提示词优化","模型融合": "组合不同微调版本的模型","持续学习": "模型能够不断从新数据中学习","元学习": "学习如何快速适应新任务"

}

结语:选择合适的工具

三种使用方式如同工匠的工具箱:

- 零样本是瑞士军刀:简单通用,随时可用

- 小样本是专业工具套装:针对特定任务,效果更好

- 微调是定制工具:完全匹配需求,性能最优