编排之神--Kubernetes中的网络通信-Flannel插件及Calico插件演练

9.Kubernetes中的网络通信

9.1 Kubernetes通信整体架构

- k8s通过CNI接口接入其他插件来实现网络通讯。

- 目前比较流行的插件有flannel,calico等

- CNI插件存放位置:

/etc/cni/net.d/8.3-flannel.conflist

- 插件使用的解决方案如下:

- 虚拟网桥,虚拟网卡,多个容器共用一个虚拟网卡进行通信。

- 多路复用:MacVLAN,多个容器共用一个物理网卡进行通信。

- 硬件交换:SR-LOV,一个物理网卡可以虚拟出多个接口,这个性能最好。

- 容器间通信:

- 同一个pod内的多个容器间的通信,通过lo即可实现pod之间的通信

- 同一节点的pod之间通过cni网桥转发数据包。

- 不同节点的pod之间的通信需要网络插件支持

- pod和service通信:

- 通过iptables或ipvs实现通信,ipvs取代不了iptables,因为ipvs只能做负载均衡,而做不了nat转换

- pod和外网通信:

- iptables的MASQUERADE

- Service与集群外部客户端的通信;

- (ingress、nodeport、loadbalancer)

9.2 flannel网络插件

9.2.1 插件组成

| 插件 | 功能 |

|---|---|

| VXLAN | 即Virtual Extensible LAN(虚拟可扩展局域网),是Linux本身支持的一种网络虚拟化技术。VXLAN可以完全在内核态实现封装和解封装工作,从而通过“隧道”机制,构建出覆盖网络(Overlay Network) |

| VTEP | VXLAN Tunnel End Point(虚拟隧道端点),在Flannel中 VNI的默认值是1,这也是为什么宿主机的VTEP设备都叫flannel.1的原因 |

| Cni0 | 网桥设备,每创建一个pod都会创建一对 veth pair。其中一端是pod中的eth0,另一端是Cni0网桥中的端口(网卡) |

| Flannel.1 | TUN设备(虚拟网卡),用来进行 vxlan 报文的处理(封包和解包)。不同node之间的pod数据流量都从overlay设备以隧道的形式发送到对端 |

| Flanneld | flannel在每个主机中运行flanneld作为agent,它会为所在主机从集群的网络地址空间中,获取一个小的网段subnet,本主机内所有容器的IP地址都将从中分配。同时Flanneld监听K8s集群数据库,为flannel.1设备提供封装数据时必要的mac、ip等网络数据信息 |

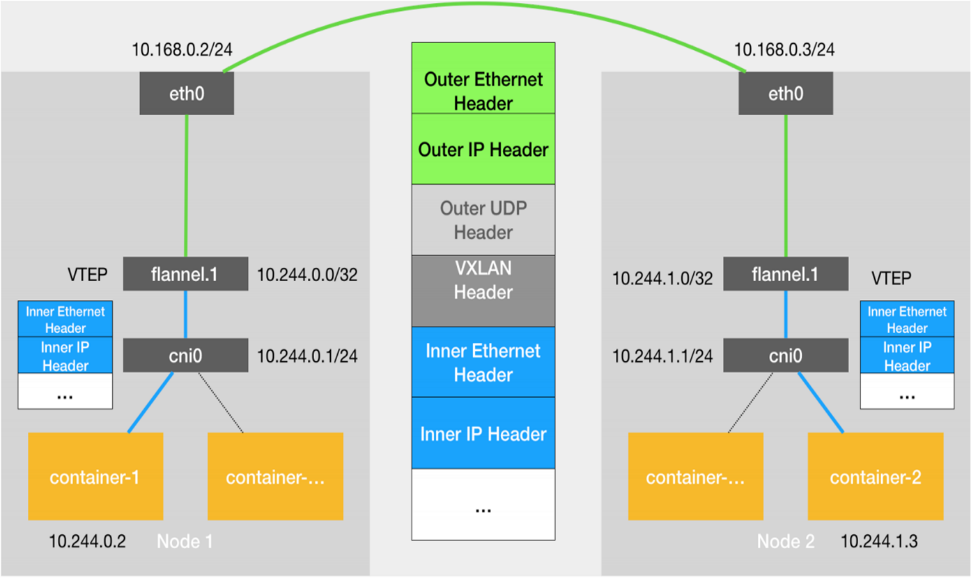

9.2.2 flannel跨主机通信原理

- 当容器发送IP包,通过veth pair 发往cni网桥,再路由到本机的flannel.1设备进行处理。

- VTEP设备之间通过二层数据帧进行通信,源VTEP设备收到原始IP包后,在上面加上一个目的MAC地址,封装成一个内部数据帧,发送给目的VTEP设备。

- 内部数据桢,并不能在宿主机的二层网络传输,Linux内核还需要把它进一步封装成为宿主机的一个普通的数据帧,承载着内部数据帧通过宿主机的eth0进行传输。

- Linux会在内部数据帧前面,加上一个VXLAN头,VXLAN头里有一个重要的标志叫VNI,它是VTEP识别某个数据桢是不是应该归自己处理的重要标识。

- flannel.1设备只知道另一端flannel.1设备的MAC地址,却不知道对应的宿主机地址是什么。在linux内核里面,网络设备进行转发的依据,来自FDB的转发数据库,这个flannel.1网桥对应的FDB信息,是由flanneld进程维护的。

- linux内核在IP包前面再加上二层数据帧头,把目标节点的MAC地址填进去,MAC地址从宿主机的ARP表获取。

- 此时flannel.1设备就可以把这个数据帧从eth0发出去,再经过宿主机网络来到目标节点的eth0设备。目标主机内核网络栈会发现这个数据帧有VXLAN Header,并且VNI为1,Linux内核会对它进行拆包,拿到内部数据帧,根据VNI的值,交给本机flannel.1设备处理,flannel.1拆包,根据路由表发往cni网桥,最后到达目标容器。

# 默认网络通信路由

[root@k8s-master ~]# ip r# 桥接转发数据库

[root@k8s-master ~]# bridge fdb# arp列表

[root@k8s-master ~]# arp -n

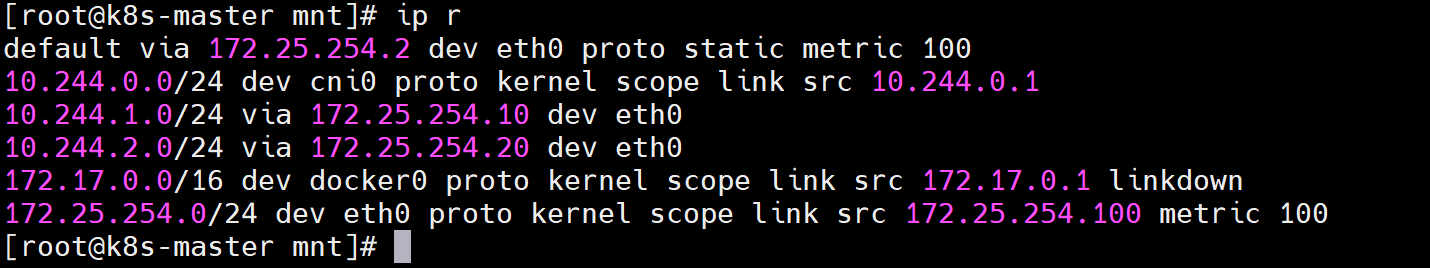

9.2.3 flannel支持的后端模式

| 网络模式 | 功能 |

|---|---|

| vxlan | 报文封装,默认模式 |

| Directrouting | 直接路由,跨网段使用vxlan,同网段使用host-gw模式 |

| host-gw | 主机网关,性能好,但只能在二层网络中,不支持跨网络 如果有成千上万的Pod,容易产生广播风暴,不推荐 |

| UDP | 性能差,不推荐 |

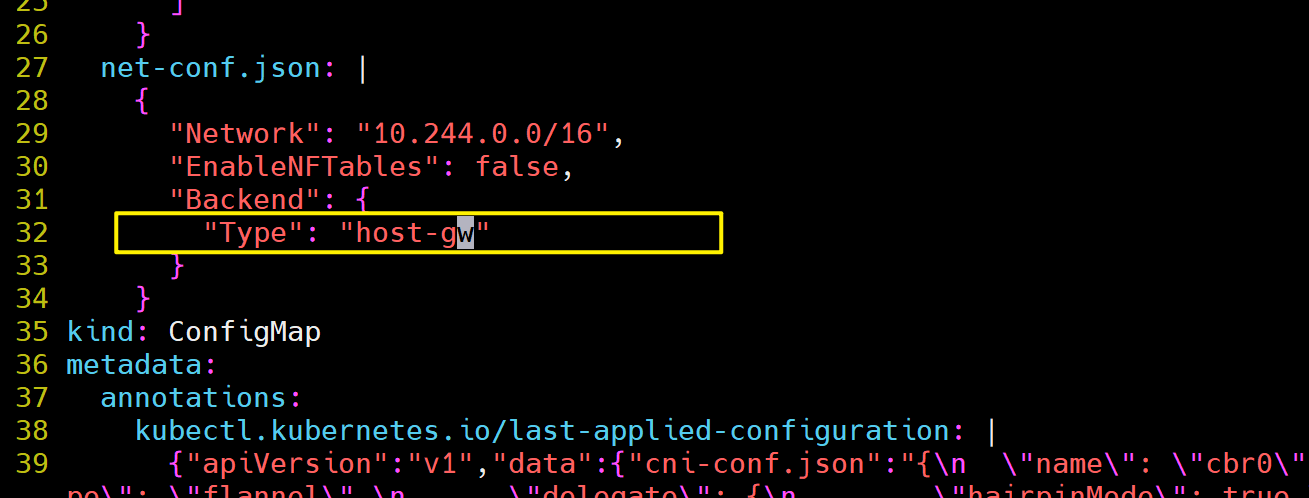

9.2.3.1 更改flannel的默认模式

[root@k8s-master ~]# kubectl -n kube-flannel edit cm kube-flannel-cfg

apiVersion: v1

data:cni-conf.json: |{"name": "cbr0","cniVersion": "0.3.1","plugins": [{"type": "flannel","delegate": {"hairpinMode": true,"isDefaultGateway": true}},{"type": "portmap","capabilities": {"portMappings": true}}]}net-conf.json: |{"Network": "8.3.244.0.0/16","EnableNFTables": false,"Backend": {"Type": "host-gw" #更改内容}}# 重启pod

[root@k8s-master ~]# kubectl -n kube-flannel delete pod --all[root@k8s-master ~]# ip r

9.3 Calico网络插件

官网:

https://docs.projectcalico.org/getting-started/kubernetes/self-managed-onprem/onpremises

Calico 是一个开源的容器网络解决方案,主要应用于 Kubernetes、OpenShift、Docker 等容器编排平台;

作为 Container Network Interface (CNI) 插件来提供网络连接和网络安全策略。

它的核心设计目标是提供高性能、可扩展且安全的网络,特别适合大规模的生产环境部署。

# 主要优势:

1.高性能: 纯三层路由模式提供接近物理网络的性能。

2.强大的网络策略: 业界领先的 Kubernetes NetworkPolicy 实现,支持更复杂的策略规则(如命名空间选择器、服务账户选择器、端口范围、拒绝规则、策略优先级等)。

3.可扩展性: 通过 BGP 和路由反射器,能够支持超大规模集群(数千节点)。

4.灵活性: 支持多种网络后端(纯 BGP、IPIP、VXLAN)以适应不同底层基础设施。

5.云原生集成: 与 Kubernetes API 深度集成,管理方式原生(使用 kubectl)。

6.跨集群/混合云连接: Calico 的企业版(Tigera Secure)和部分开源组件(如 calicoctl 结合 BGP)支持跨 Kubernetes 集群或连接容器网络与传统 VM/物理网络。

7.活跃的社区和生态系统: 由 Tigera 公司主导开发,拥有庞大的用户群体和活跃的社区支持。

8.丰富的可视化和监控(企业版更强): 提供网络流量、策略执行情况的可视化工具(如 Calico Enterprise UI/Felix 指标)。

9.3.1 Calico简介

- 纯三层的转发,中间没有任何的NAT和overlay,转发效率最好。

- Calico仅依赖三层路由可达。

- Calico较少的依赖性使它能适配所有 VM、Container、白盒或者混合环境场景。

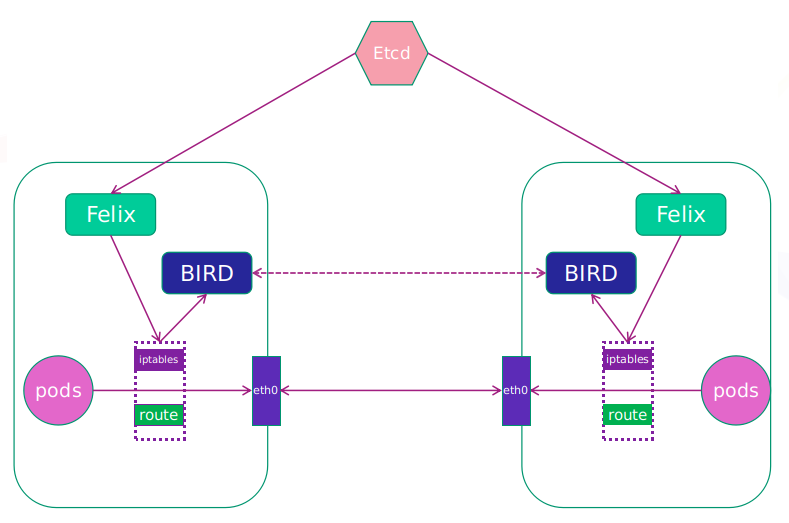

9.3.2 Calico网络架构

- Felix:

- 监听ECTD中心的存储获取事件,用户创建pod后,Felix负责将其网卡、IP、MAC都设置好,然后在内核的路由表里面写一条,注明这个IP应该到这张网卡。同样如果用户制定了隔离策略,Felix同样会将该策略创建到ACL中,以实现隔离。

- BIRD:

- 一个标准的路由程序,边界网关路由;

- 它会从内核里面获取哪一些IP的路由发生了变化,然后通过标准BGP的路由协议扩散到整个其他的宿主机上,让外界都知道这个IP在这里,路由的时候到这里

9.3.3 部署Calico

- 删除flannel插件

[root@k8s-master ~]# kubectl delete -f kube-flannel.yml

- 删除所有节点上flannel配置文件,避免冲突

[root@k8s-master & node1-2 ~]# rm -rf /etc/cni/net.d/xxxxxxx # xxx:这里需要自己tab补齐

- (可选)下载部署文件

# 如果使用的是资源包里面的内容,这里建议上传而不是下载

[root@k8s-master calico]# curl https://raw.githubusercontent.com/projectcalico/calico/v3.28.1/manifests/calico-typha.yaml -o calico.yaml

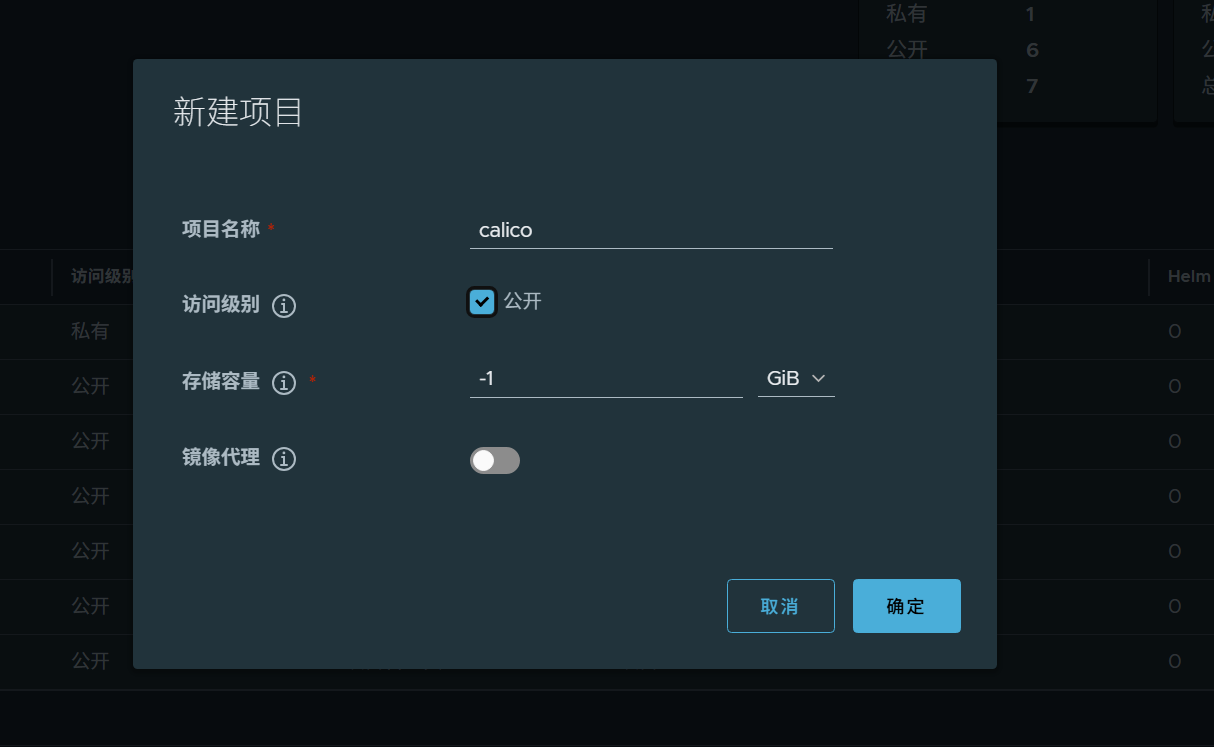

- (可选)下载镜像上传至仓库:

# 这里建议使用资源包里面的内容,并上传至harbor仓库,并建立calico项目

[root@k8s-master mnt]# docker load -i calico-3.28.1.tar

[root@k8s-master mnt]# docker tag calico/cni:v3.28.1 reg.dhj.org/calico/cni:v3.28.1

[root@k8s-master mnt]# docker tag calico/node:v3.28.1 reg.dhj.org/calico/node:v3.28.1

[root@k8s-master mnt]# docker tag calico/kube-controllers:v3.28.1 reg.dhj.org/calico/kube-controllers:v3.28.1

[root@k8s-master mnt]# docker tag calico/typha:v3.28.1 reg.dhj.org/calico/typha:v3.28.1

[root@k8s-master mnt]# docker push reg.dhj.org/calico/cni:v3.28.1

[root@k8s-master mnt]# docker push reg.dhj.org/calico/node:v3.28.1

[root@k8s-master mnt]# docker push reg.dhj.org/calico/kube-controllers:v3.28.1

[root@k8s-master mnt]# docker push reg.dhj.org/calico/typha:v3.28.1

# 如果执意使用镜像拉取的话,真的不推荐(除了生产环境中)

[root@k8s-master ~]# docker pull docker.io/calico/cni:v3.28.1

[root@k8s-master ~]# docker pull docker.io/calico/node:v3.28.1

[root@k8s-master ~]# docker pull docker.io/calico/kube-controllers:v3.28.1

[root@k8s-master ~]# docker pull docker.io/calico/typha:v3.28.1

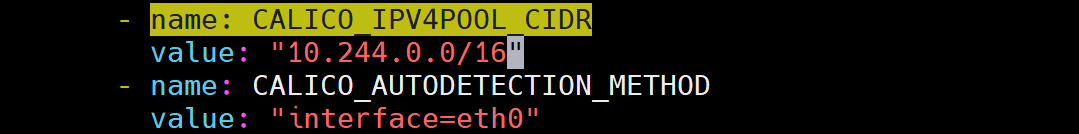

- 更改yml设置

[root@k8s-master calico]# vim calico.yaml

4835 image: calico/cni:v3.28.1

4835 image: calico/cni:v3.28.1

4906 image: calico/node:v3.28.1

4932 image: calico/node:v3.28.1

5160 image: calico/kube-controllers:v3.28.1

5249 - image: calico/typha:v3.28.14970 - name: CALICO_IPV4POOL_IPIP

4971 value: "Never"4999 - name: CALICO_IPV4POOL_CIDR

5000 value: "8.3.244.0.0/16" # 这里使用的是自己的cluster网段(下面有查看网段的命令)

5001 - name: CALICO_AUTODETECTION_METHOD

5002 value: "interface=eth0"[root@k8s-master calico]# kubectl apply -f calico.yaml

[root@k8s-master calico]# kubectl -n kube-system get pods

# 查看集群网段

[root@k8s-master ~]# cat /etc/kubernetes/manifests/kube-controller-manager.yaml | grep cidr

- 测试

[root@k8s-master mnt]# kubectl run web --image myapp:v1

pod/web created

[root@k8s-master mnt]# kubectl get pods -o wide

web 1/1 Running 0 10s 10.244.169.128 k8s-node2 <none> <none>

[root@k8s-master mnt]# curl 10.244.169.128

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>