scikit-learn/sklearn学习|广义线性回归 Logistic regression的三种成本函数

【1】引言

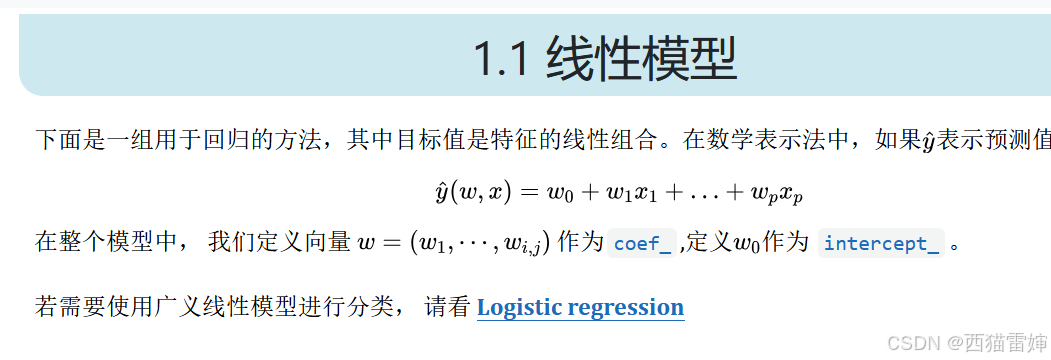

前序学习进程中,已经对线性回归和岭回归做了初步解读。

实际上, Logistic regression是一种广义的线性模型,在对线性分类的进一步学习前,有必要了解 Logistic regression。

【2】Logistic regression的3种成本函数

点击下方链接直达官网学习教程:logistic regression

Logistic regression是Logistic回归所使用的算法,包括的成本函数有3种,具体为:

L2L2L2正则化成本函数:

min12wTw+C∑i=1nlog(exp(−yi(XiTw+c))+1)\min\frac{1}{2}w^Tw+C\sum_{i=1}^{n}log(exp(-y_{i}(X_{i}^Tw+c))+1)min21wTw+Ci=1∑nlog(exp(−yi(XiTw+c))+1)

L1L1L1正则化成本函数:

min∣∣w∣∣1+C∑i=1nlog(exp(−yi(XiTw+c))+1)\min||w||_{1}+C\sum_{i=1}^{n}log(exp(-y_{i}(X_{i}^Tw+c))+1)min∣∣w∣∣1+Ci=1∑nlog(exp(−yi(XiTw+c))+1)

弹性网正则化成本,结合了L2L2L2正则化和L1L1L1正则化的成本函数:

min1−ρ2wTw+ρ∣∣w∣∣1+C∑i=1nlog(exp(−yi(XiTw+c))+1)\min\frac{1-\rho}{2}w^Tw+\rho||w||_{1}+C\sum_{i=1}^{n}log(exp(-y_{i}(X_{i}^Tw+c))+1)min21−ρwTw+ρ∣∣w∣∣1+Ci=1∑nlog(exp(−yi(XiTw+c))+1)

显然,当ρ=1\rho=1ρ=1时,弹性网正则化等价于L1L1L1正则化

当ρ=0\rho=0ρ=0时,弹性网正则化等价于L2L2L2正则化。

【3】总结

学习了Logistic regression的3种成本函数。