卫朋:AI 硬件产品怎么做?——小智AI原理解析

目录

简介

硬件连接

与服务端交互

AI 理解语音后控制硬件

作者简介

简介

小智 AI 现在已经成为了一款强大的智能平台,能够实现对多种外设的智能控制。

当然如果有基础的开发能力,也可以自行搭建服务端。

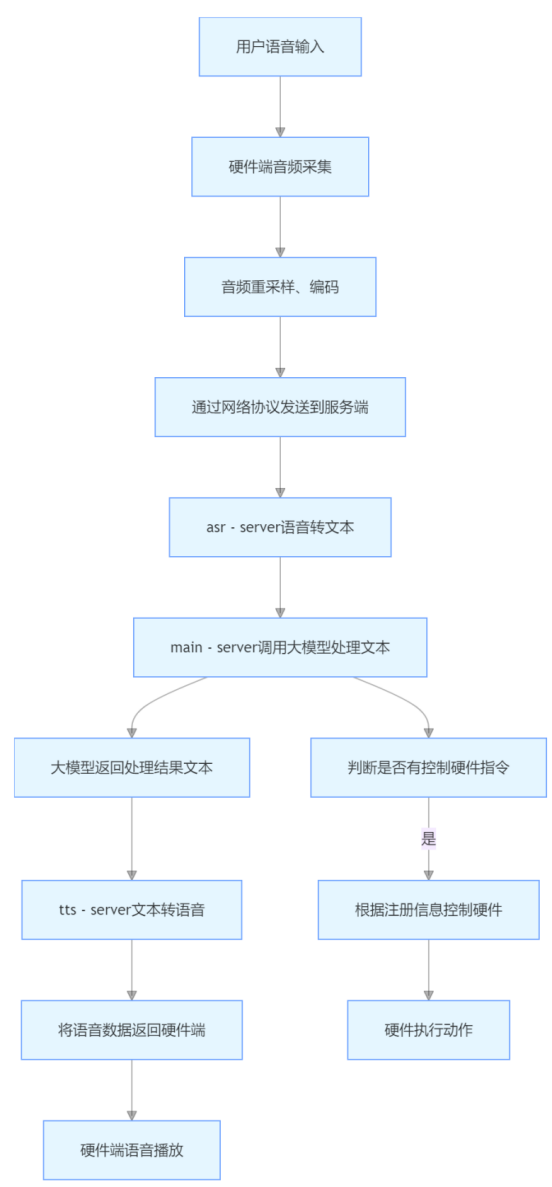

下面这张图展示的是小智AI控制硬件的一个完整过程:

下面简单解释一下:

硬件连接

以常见的 ESP32 - S3 开发板为例:

1、电源连接

-

此外 5V 还直接给功放和 RGB 灯供电。

-

5V 电压通过 LDO 线性稳压实现 3.3V 输出,3.3V 电源分别给主控 ESP32、SD 卡、数字麦克风和屏幕供电;

-

通过 Type - C 接口输入 5V 电压,实现锂电池充电和 USB 电源自动切换;

2、音频输入输出连接

-

音频输出可使用 es8311 等芯片连接喇叭。

-

也有开发板连接多个麦克风如 es7210 连接 3 个 MIC,MIC1 和 MIC2 接收人说话的声音,MIC3 连接 es8311 的输出用于回声消除。

-

音频输入可使用如 INMP441 数字麦克风(I2S 接口);

3、其他外设连接

-

以及 OLED/LCD 显示屏(如 SPI 接口的 240x320 TFT_ST7789 LCD)用于显示交互内容。

-

还可连接 BLE 蓝牙透传模块用于小程序通信;

-

连接 SG90 舵机实现角度控制;

-

如连接 WS2812 彩灯作为氛围灯;

与服务端交互

1、通信协议

支持 WebSocket 或 MQTT + UDP 两种方式。

2、交互过程

硬件端将音频采集后进行重采样、Opus 编码等处理,

然后通过选定的通信协议将数据发送到服务器。

服务器端接收到数据后进行相应处理,如语音活动监测、语音转文本等,处理完再将结果返回给硬件端。

服务端调用 AI

1、服务端组件

-

main - server(主服务,负责协调语音识别、大模型、语音合成等各种服务,并对接后端数据库)。

-

tts - server(提供音色管理、音色克隆、语音合成等服务,对接本地部署的语音模型);

-

asr - server(提供语音活动监测、语音转文本、说话人识别等服务);

2、调用过程

-

最后将语音数据返回给硬件端进行播放。

-

得到回复文本后,再调用tts - server将文本合成为语音,

-

然后将文本信息发送给所集成的大语言模型(如 Qwen2.5、DeepSeek、豆包 API 等)进行理解和处理,

-

main - server在接收到硬件端发送的语音数据后,会调用asr - server将语音转为文本,

AI 理解语音后控制硬件

1、设备驱动与注册

开发者需完成硬件设备的底层驱动编写,然后通过调用相关函数将设备的属性和可执行指令注册到小智 AI 系统中。

例如,

对于舵机,通过AddNumberProperty注册当前角度值属性,通过AddMethod注册设置角度的方法;

对于氛围灯,注册当前颜色属性和设置颜色的方法。

2、控制过程

当 AI 理解语音指令后,若指令是控制硬件设备的,

如 “把灯变成红色”“将舵机角度设为 90 度”,

就会根据注册的方法找到对应的设备和指令,

然后发送相应的控制信号到硬件设备,

硬件设备根据接收到的信号执行相应动作,

如舵机转动到指定角度,氛围灯显示指定颜色。

作者简介

卫朋,《硬件产品经理》作者,人人都是产品经理受邀专栏作家,CSDN认证博客专家、嵌入式领域优质创作者,阿里云开发者社区专家博主。