基于LocalAI与cpolar技术协同的本地化AI模型部署与远程访问方案解析

文章目录

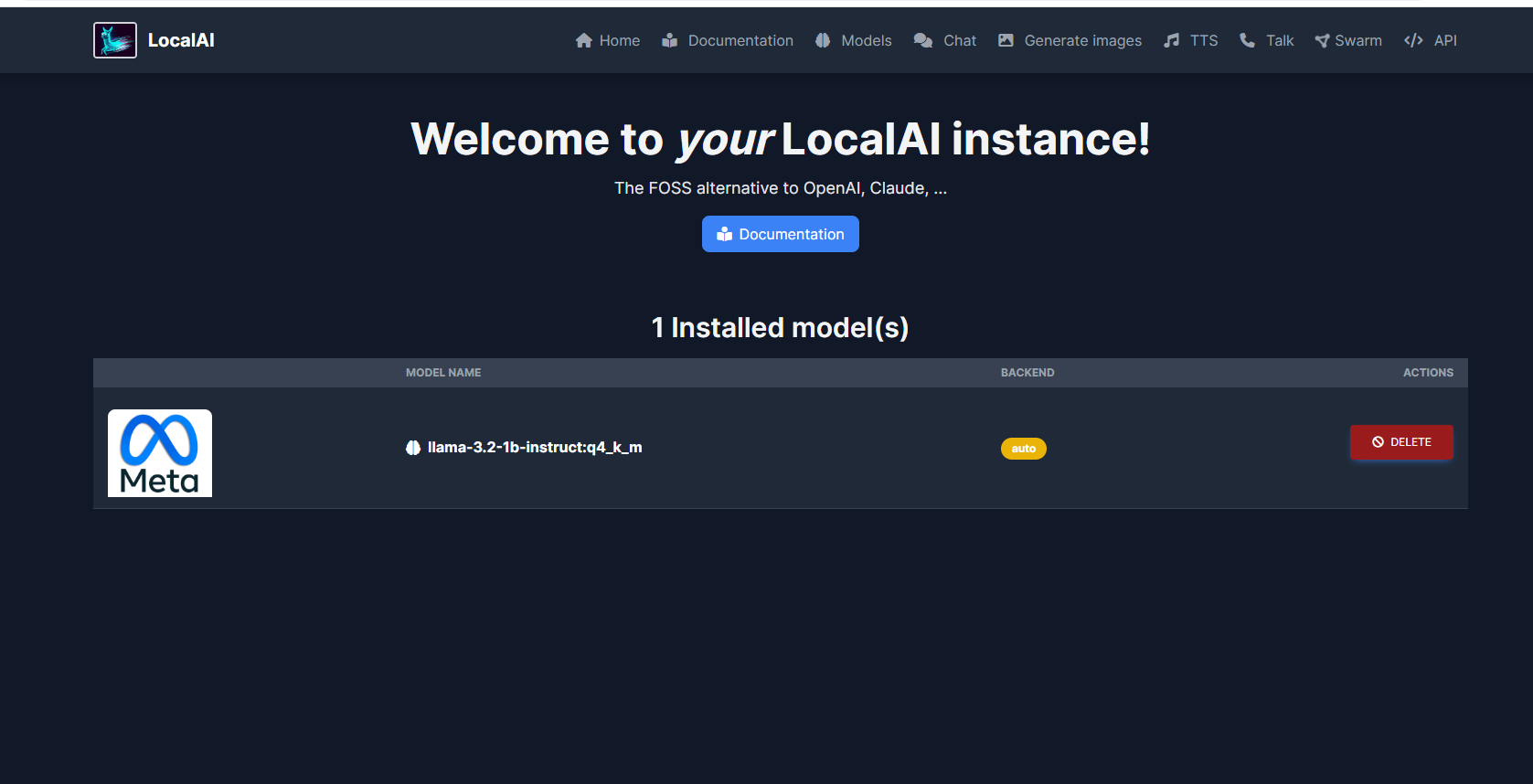

- 前言

- 1. Docker部署

- 2. 简单使用演示

- 3. 安装cpolar内网穿透

- 4. 配置公网地址

- 5. 配置固定公网地址

前言

各位极客朋友们!今天要向大家推荐一套创新性的本地部署方案——LocalAI技术架构。这款开源工具包能够将普通配置的笔记本电脑转化为具备强大算力的AI工作站,轻松实现大模型推理及多媒体内容生成。最令人惊喜的是,您无需进行昂贵的硬件升级,即便是搭载入门级显卡的设备也能流畅运行。当我们将LocalAI与内网穿透解决方案cpolar进行技术整合后,无论是居家办公还是移动场景,都能实现远程无缝访问AI项目。这种技术组合不仅提升了数据安全性,更让AI开发突破物理空间限制,让我们一起探索这套高效协作的本地化AI部署方案吧!

【视频教程】

支持CPU推理运行的开源AI神器LocalAI本地安装与远程使用教程

1. Docker部署

本例使用Ubuntu 22.04进行演示,使用Docker进行部署,如果没有安装Docker,可以查看这篇教程进行安装:《Docker安装教程——Linux、Windows、MacOS》

安装好Docker后,打开终端执行这行命令启动容器即可:

sudo docker run -ti --name local-ai -p 8080:8080 localai/localai:latest-cpu

这里使用的镜像是仅使用CPU来运行的镜像,如果大家有Nvidia显卡的好GPU,也可以使用下方命令拉取支持N卡的镜像来运行容器:

sudo