MCP+Deepseck王炸组合 | 附实战操作及其MCPserver | 可替代Manus,实现AGI

MCP介绍

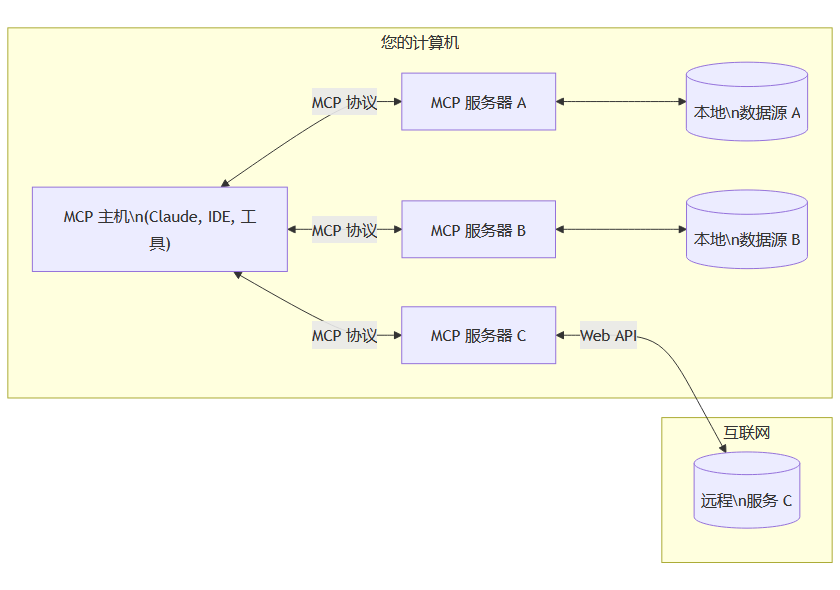

MCP 是一个开放协议,它为应用程序向 LLM 提供上下文的方式进行了标准化。你可以将 MCP 想象成 AI 应用程序的 USB-C 接口。就像 USB-C 为设备连接各种外设和配件提供了标准化的方式一样,MCP 为 AI 模型连接各种数据源和工具提供了标准化的接口。

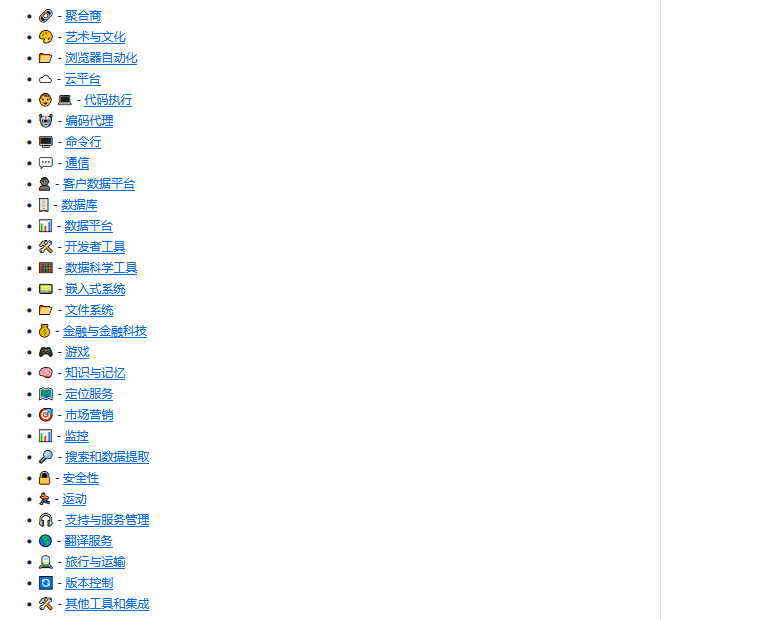

MCP免费server获取

MCP servers download

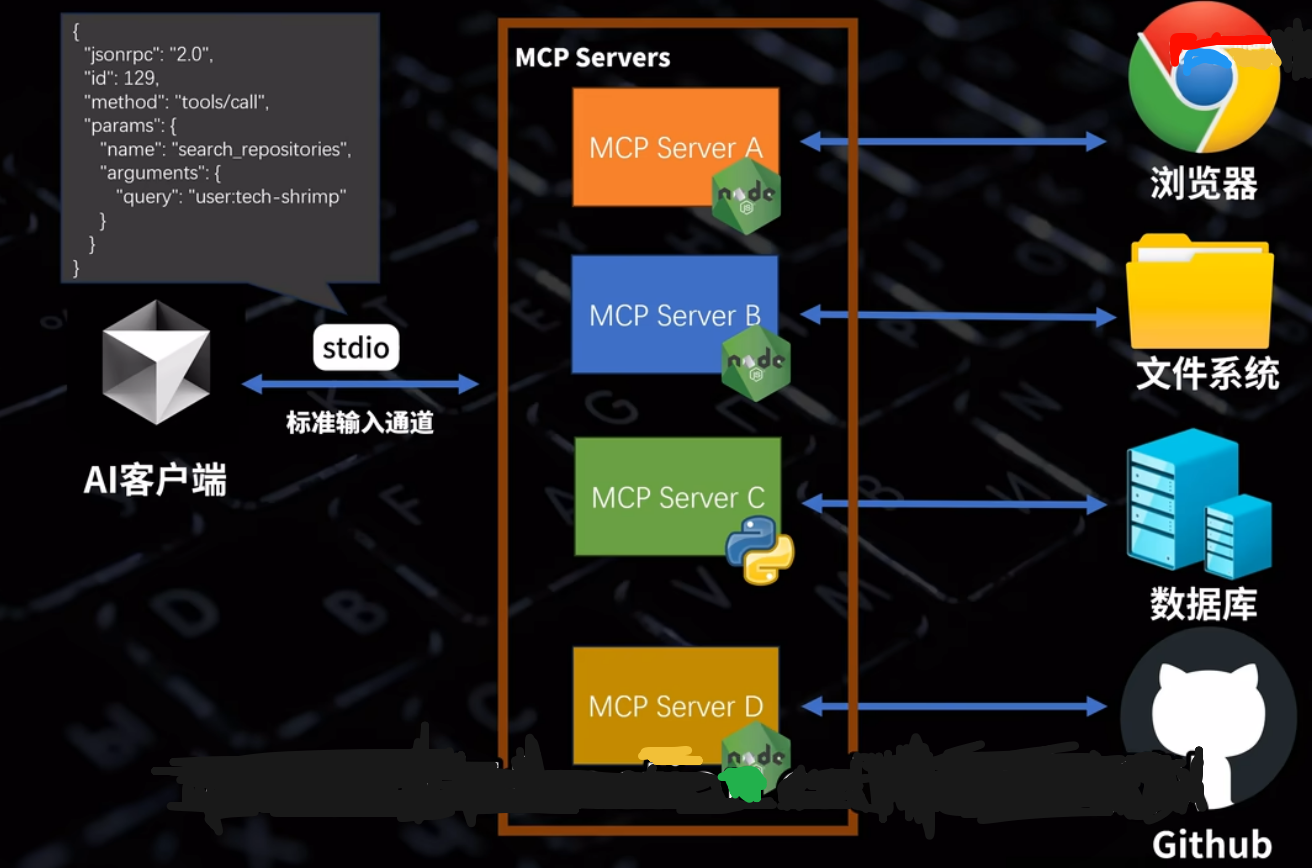

通用架构

MCP 核心采用客户端-服务器架构,主机应用可以连接多个服务器:

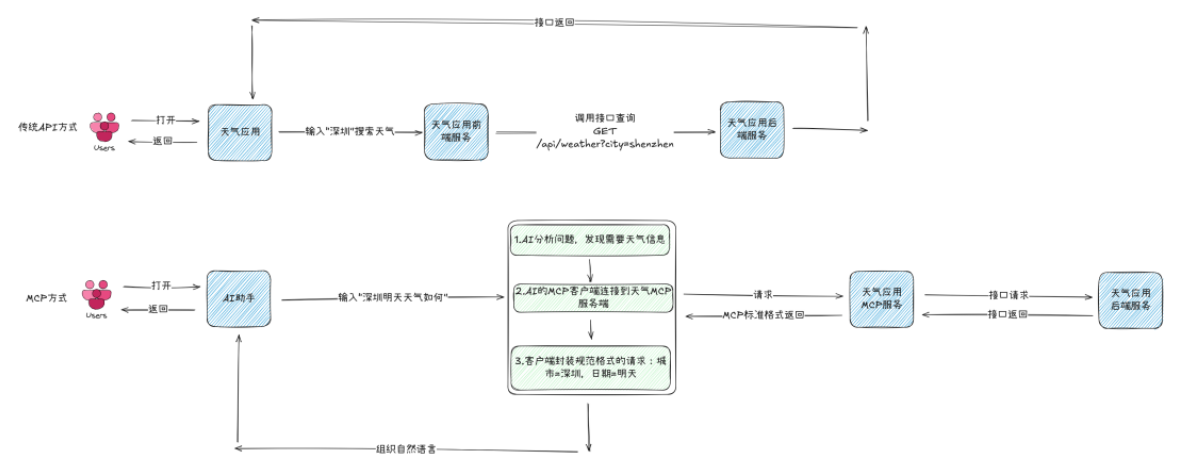

我们假设开发了一个天气服务,用户想要查询深圳的天气,这里分别以传统API方式和MCP方式进行对比:

MCP结合Deepseck实战

🛠️ 使用 VS Code 和 Node.js 配置 Cline 与 MCP Server 教程(以 GitHub 为例)

📦 准备工作

-

安装 Visual Studio Code

-

安装 Node.js

🧩 第一步:在 VS Code 中安装 Cline 插件

-

打开 VS Code

-

前往侧边栏的“扩展”(Extensions)面板

-

搜索

cline并点击安装

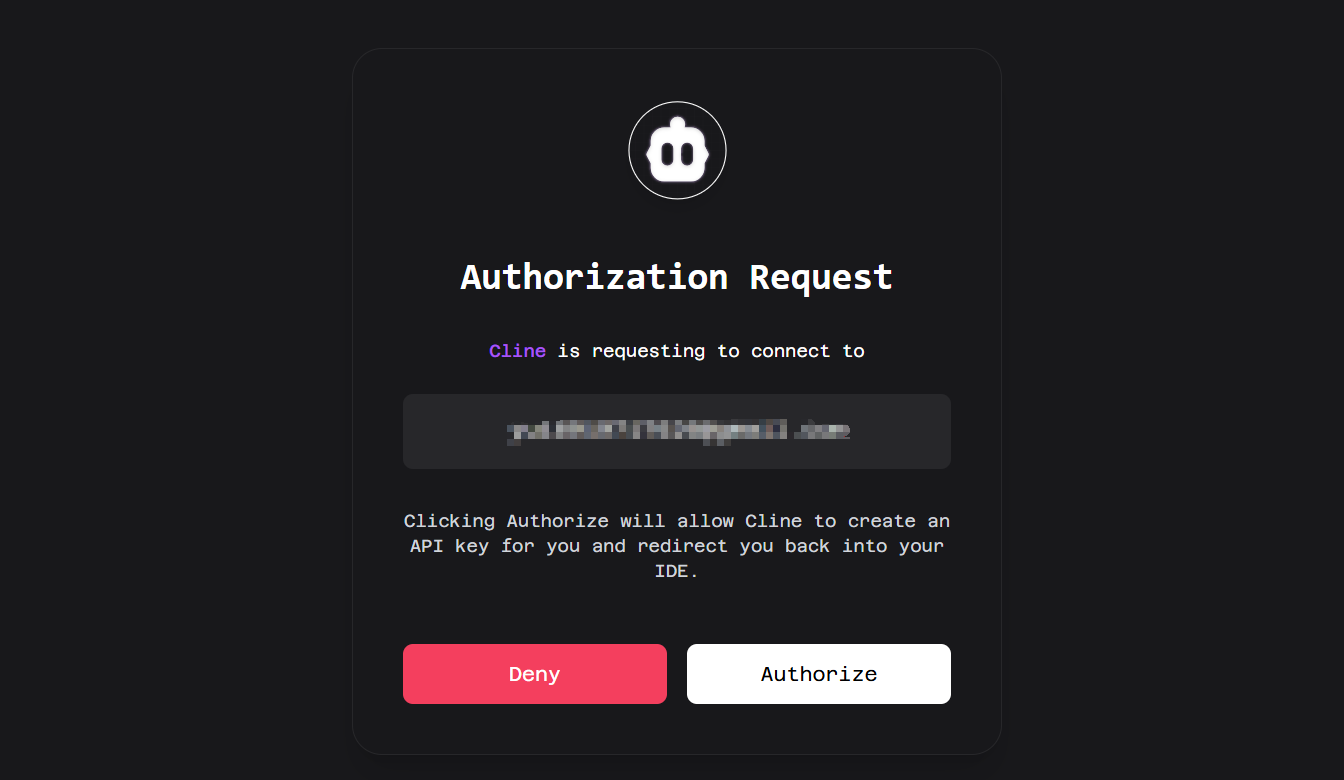

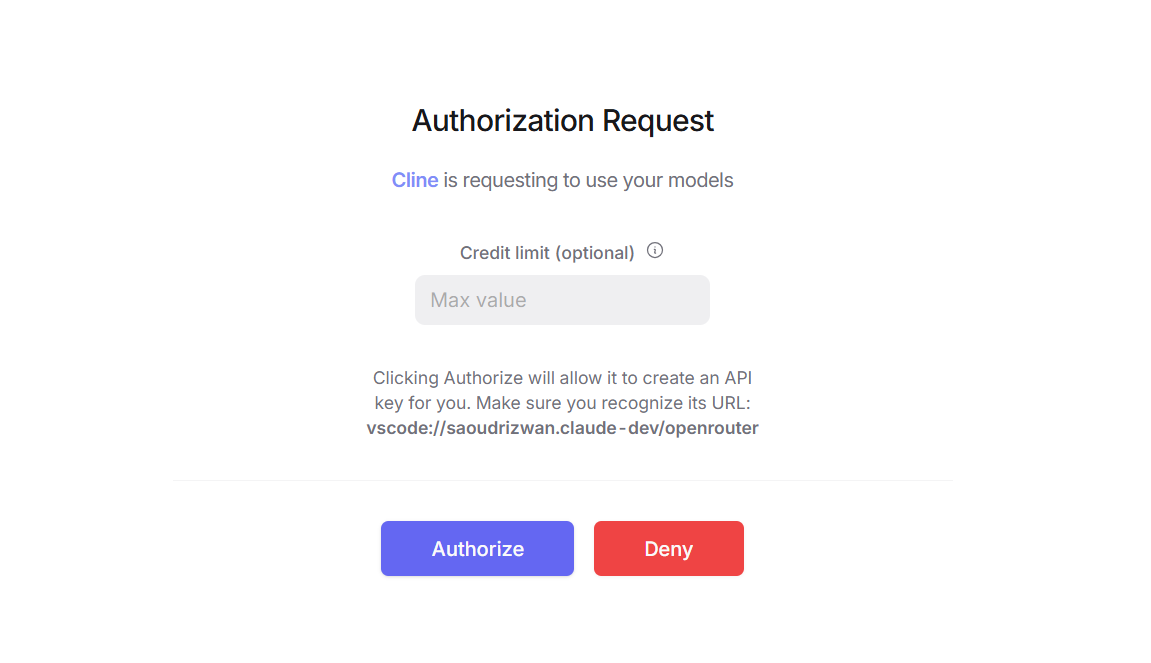

点击授权,重定向至vscode中

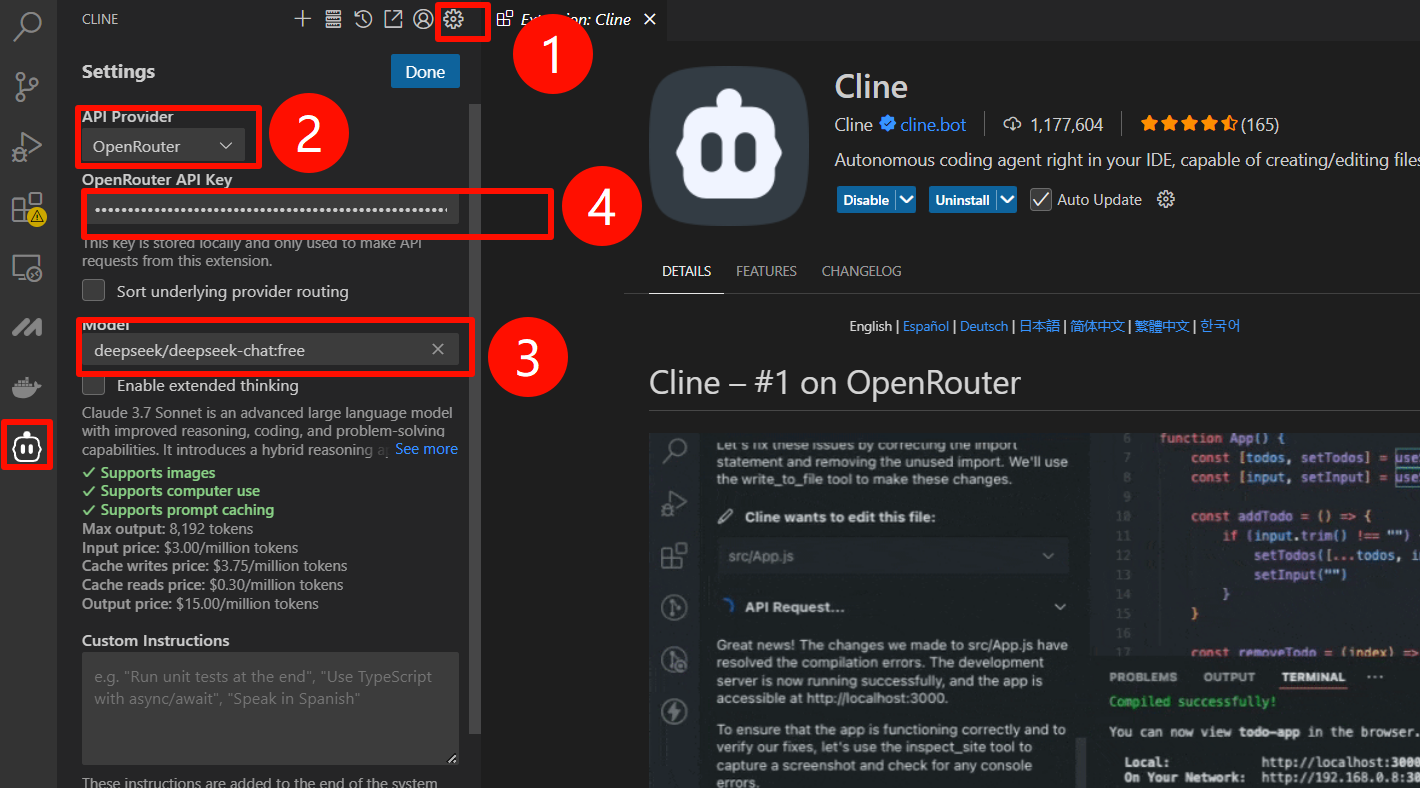

🔗 第二步:配置模型来源及 API

-

打开命令面板(

Ctrl+Shift+P或Cmd+Shift+P) -

选择

Cline: Open Settings - 在配置页面中设置模型来源,例如:

-

OpenAI API

-

本地大模型(如 Ollama、Qwen、ChatGLM 等)

-

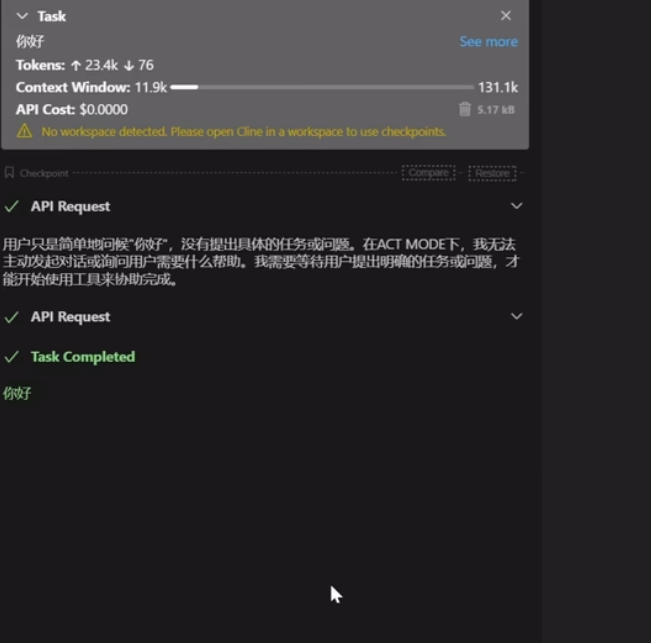

✅ 第三步:测试 Cline 是否配置成功

-

在任意文件中打开命令面板

-

选择

Cline: Ask a Question -

输入问题,例如:

Hello, how are you? -

如果返回有效答案,说明配置成功 ✅

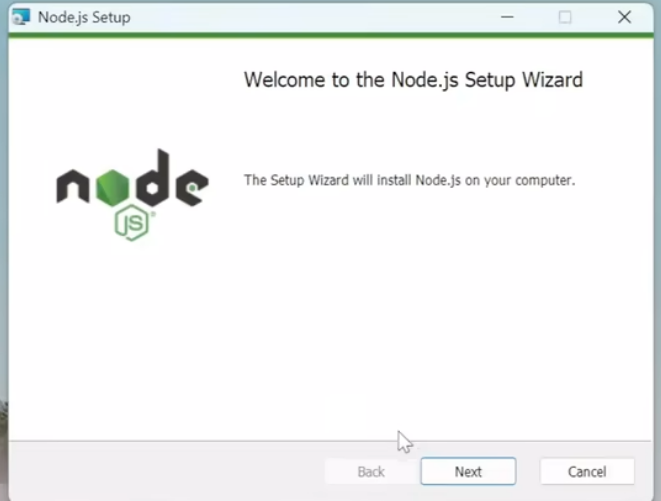

📥 第四步:安装 Node.js(如未安装)

-

前往 Node.js 官网

-

下载并安装 LTS 版本

-

打开终端或命令行,验证是否安装成功:

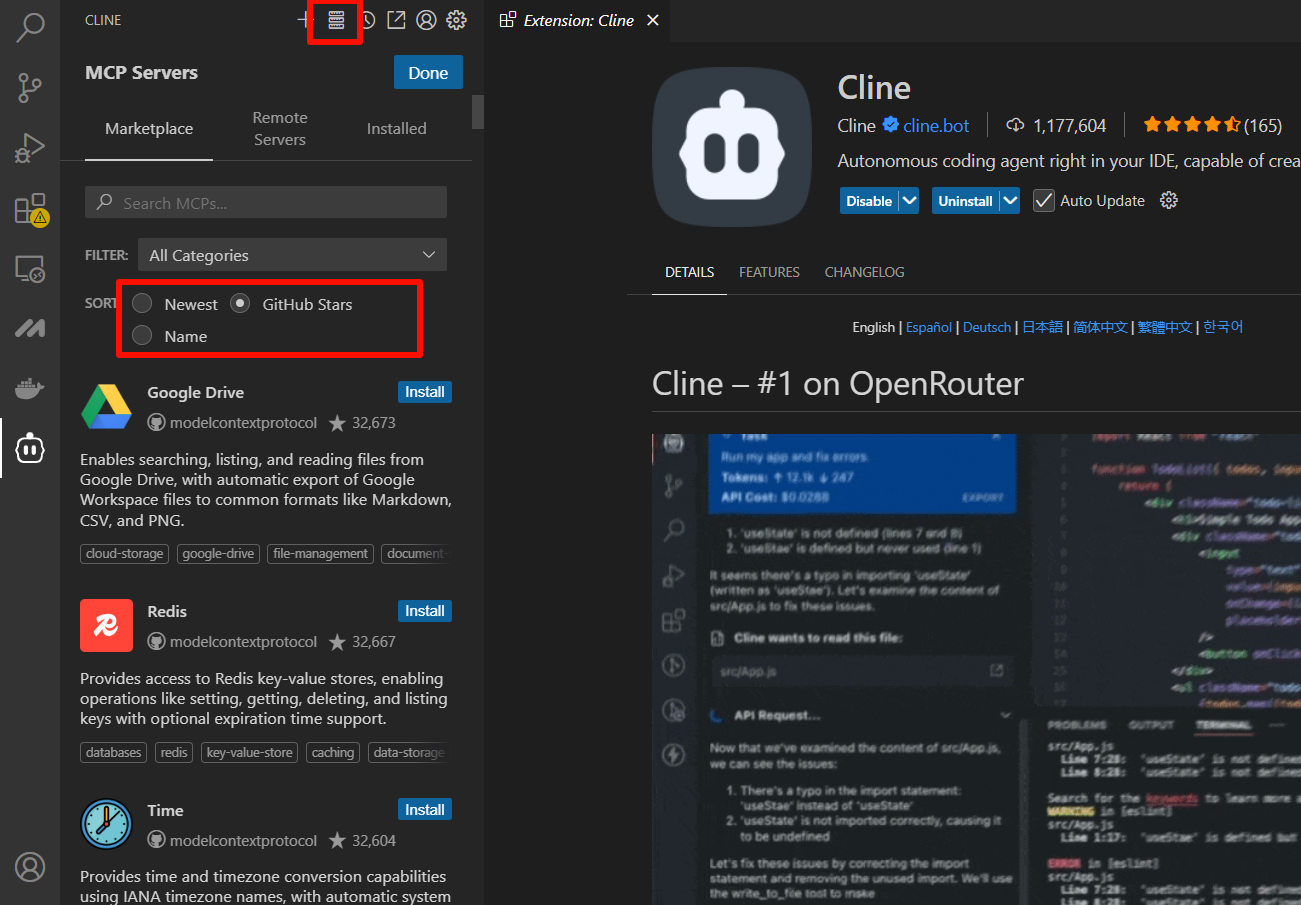

🛍️ 第五步:在 Cline 应用商城中搜索 MCP Server

-

打开 Cline 应用面板

-

点击

Marketplace -

搜索

MCP Server(此处以 GitHub 模型为例) -

选择

@modelcontextprotocol/server-github并点击安装

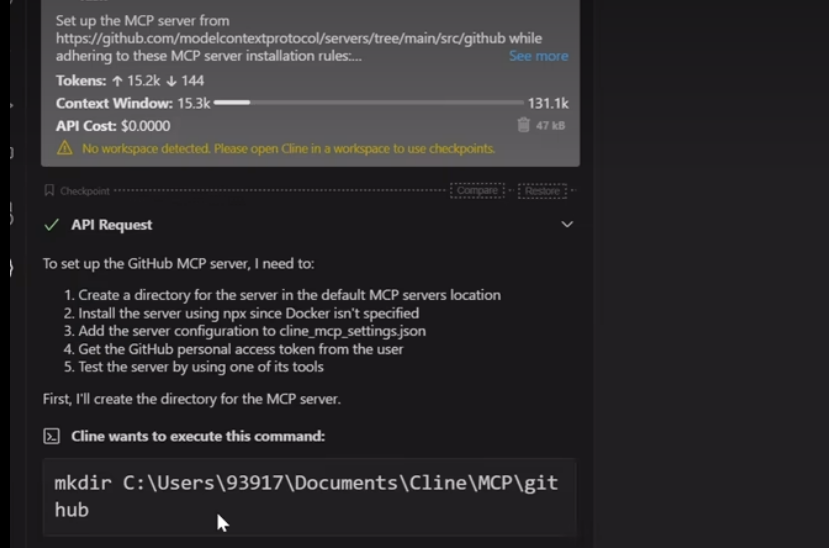

🏗️ 第六步:根据提示创建运行环境

-

点击安装后的

MCP Server应用 -

根据提示设置环境变量(例如 GitHub Token)

-

Cline 会自动运行相关命令,完成环境部署

其中配置文件内容如下

{

"mcpServers": {

"github.com/modelcontextprotocol/servers/tree/main/src/github": {

"command": "cmd",

"args": [

"/c",

"npx",

"-y",

"@modelcontextprotocol/server-github"

],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "ghp_***********************" // 敏感令牌已隐藏

},

"disabled": false,

"autoApprove": []

}

}

}

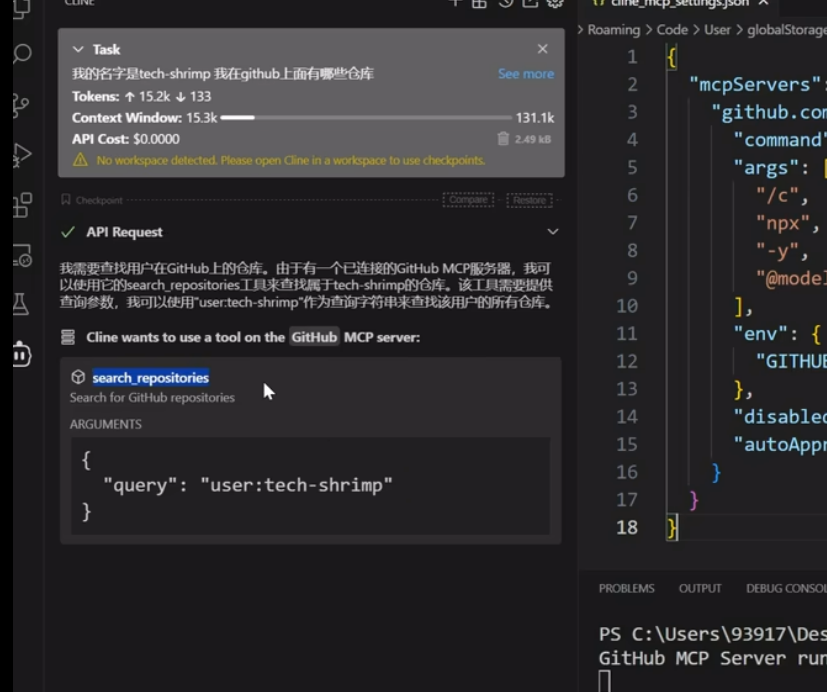

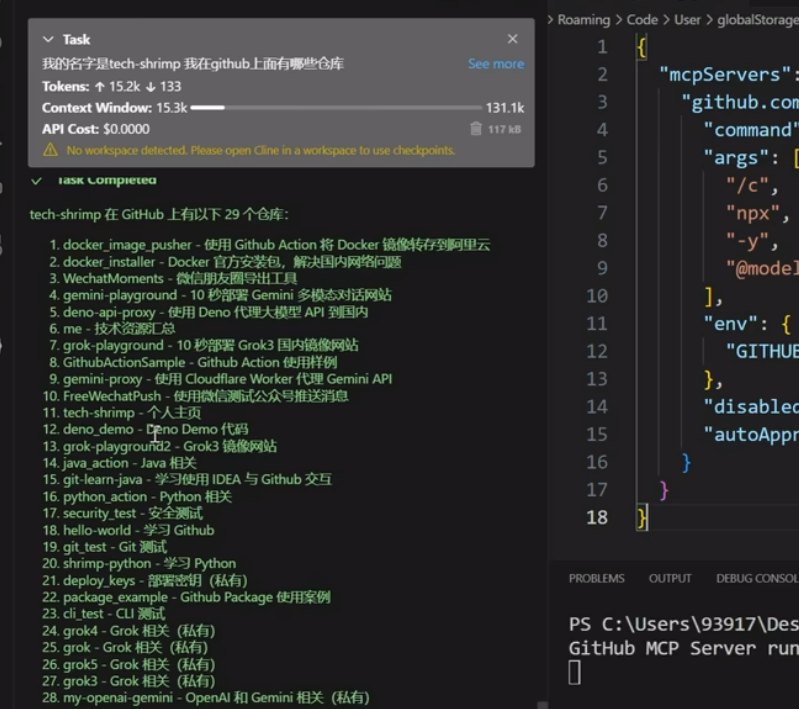

🧪 第七步:测试 MCP Server 是否生效

-

提出与该 MCP Server 相关的问题,例如: 询问具体仓库

-

如果能够得到有效回答,说明 MCP Server 配置成功 🎉