在本地部署LangManus

1.简介

LangManus 是一个社区驱动的 AI 自动化框架,它建立在开源社区的杰出成果之上。我们的目标是将语言模型与专用工具相结合,用于网页搜索、爬虫和 Python 代码执行等任务,同时回馈促成这一目标的社区。

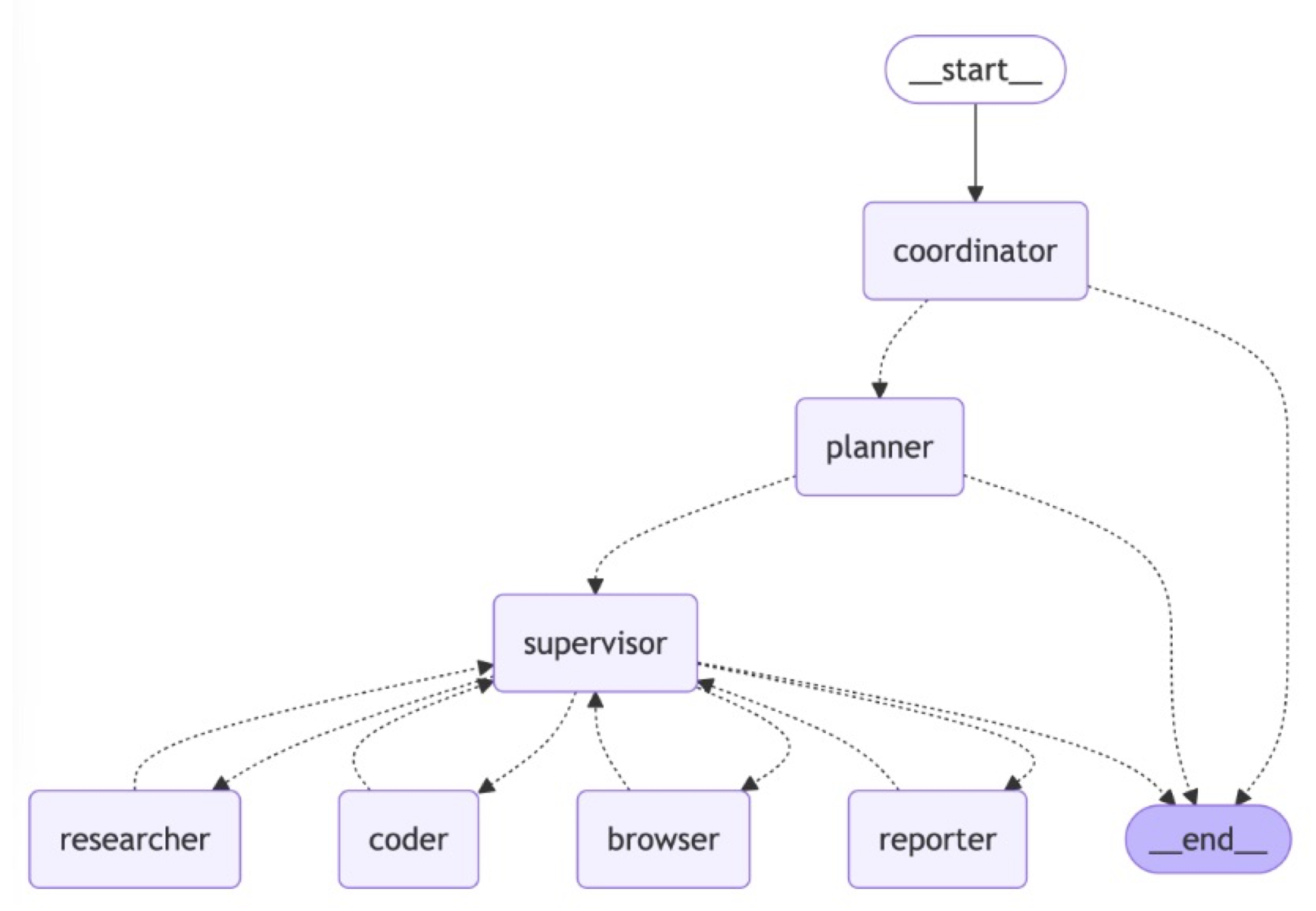

该系统由以下协同工作的代理组成:

- 协调器——处理初始交互和路由任务的入口点

- 规划器——分析任务并制定执行策略

- 主管——监督和管理其他代理的执行

- 研究员——收集和分析信息

- 程序员 - 处理代码生成和修改

- 浏览器——执行网页浏览和信息检索

- 报告器——生成工作流结果的报告和摘要

2.下载

git clone https://github.com/langmanus/langmanus.git

3. 创建激活虚拟环境

uv python install 3.12

uv venv --python 3.12

4. 安装依赖

source .venv/bin/activate

cd langmanus

uv sync

5. 配置环境变量

cp .env.example .env

# 编辑 .env 文件,填入你的 API 密钥

# Reasoning LLM (for complex reasoning tasks)

REASONING_API_KEY=ollama

REASONING_BASE_URL=http://localhost:11434/v1

REASONING_MODEL=llama3.2

# Non-reasoning LLM (for straightforward tasks)

BASIC_API_KEY=ollama

BASIC_BASE_URL=http://localhost:11434/v1

BASIC_MODEL=llama3.2

# Vision-language LLM (for tasks requiring visual understanding)

VL_API_KEY=ollama

VL_BASE_URL=http://localhost:11434/v1

VL_MODEL=llama3.2-vision

# Application Settings

DEBUG=True

APP_ENV=development

# Add other environment variables as needed

TAVILY_API_KEY=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

6. 运行

uv run main.py

7. 启动API服务

启动 API 服务器

make serve

或直接运行

uv run server.py