每天五分钟深度学习:基于dropout(随机失活)解决神经网络过拟合

本文重点

前面我们介绍了正则化技术,它可以帮助我们解决神经网络的过拟合问题,本文我们介绍在神经网络中另外一种经典的解决过拟合问题的方法,这个方法就是Dropout(随机失活)

Dropout的原理

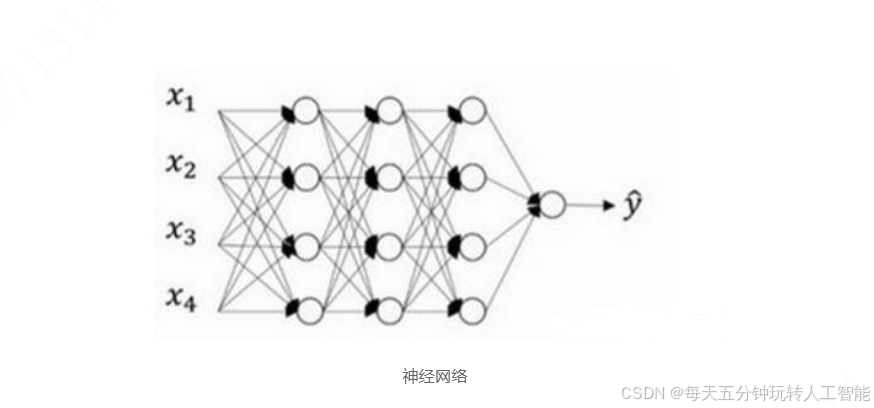

如上图所示,我们有一个神经网络,假如现在这个神经网络存在过拟合的问题,现在我们使用dropout来解决这个问题。它的原理是这样的:

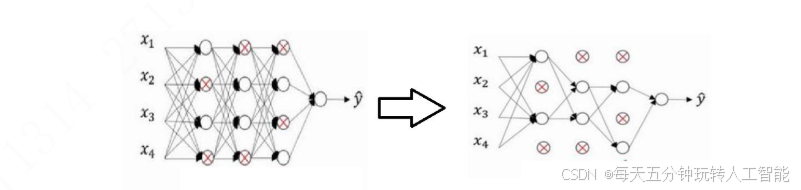

Dropout会遍历这个神经网络的每一层,并且设置消除神经网络中结点的概率。假设神经网络中的每一层的每一个结点被消除的概率是0.5(50%的可能性被消除或者保留),假如这个结点被消除了,那么就需要删除掉神经网络中从该结点进出的连线,最终我们可以得到一个结点更少,规模更小的神经网络,然后我们使用反向传播算法来训练这个神经网络。过程如下所示:

如上所示,带有红叉的就表示dropout消除的,然后去掉消除的神经网络结点和它的连线,那么此时它的网络模型就如右所示了,神经网络变得简化无比。我们知道过拟合的问题是因为神经网络过于复杂,那么模型变得简单的,是不是过拟合问题就被解决了。

细节问题

在训练的时候,我们每次喂入神经