阿里云开源通义 DeepResearch!轻量级 AI 代理性能对标 OpenAI,系统性技术创新赋能研究能力

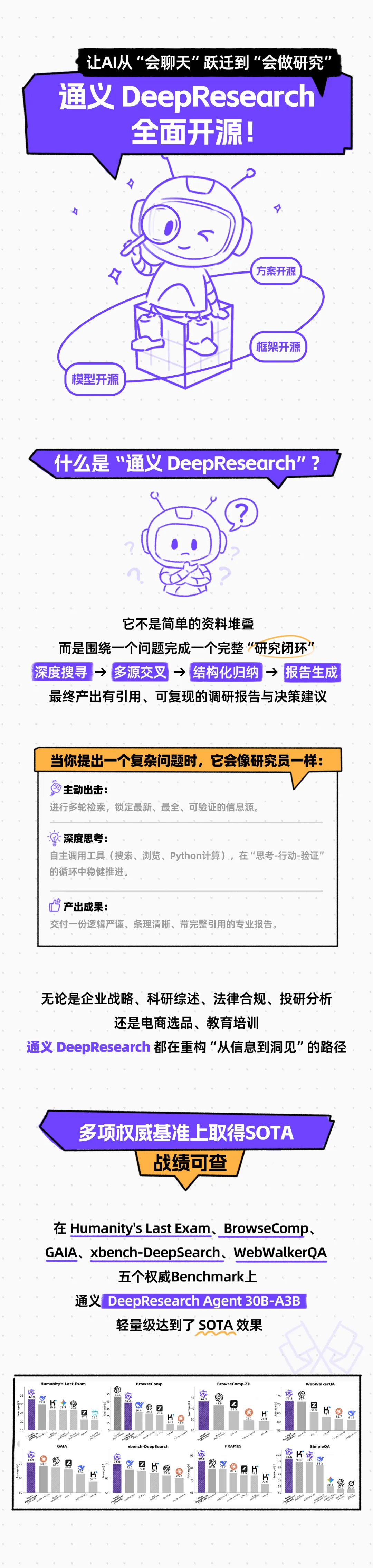

近日,阿里云通义实验室对外宣布开源通义 DeepResearch,这款轻量级 AI 代理凭借出色的性能,实现了与 OpenAI 深度研究工具的比肩,在信息检索和推理领域展现出强劲实力。为让 AI 真正具备 “做研究” 的能力,通义 DeepResearch 团队围绕数据、Agent 范式、训练、基础设施(Infra)、Test Time Scaling 开展系统性创新,所有技术方案均已开源,其开源资源同步在多个平台上线,欢迎全球开发者共建。

轻量级参数设计实现高性能突破

通义 DeepResearch 在参数配置上颇具亮点,其整体参数规模达 300 亿,而实际激活参数为 30 亿。这一轻量化的参数设计,不仅在资源占用上更具优势,还能实现出色性能,成功达成对标 OpenAI 的突破。这种高效的参数利用模式,打破了人们对高参数与高性能必然绑定的固有认知,为轻量级 AI 代理的发展提供了新方向,也让更多开发者能够轻松部署和使用先进的 AI 研究工具。

权威基准测试验证技术实力

在权威基准测试中,通义 DeepResearch 的表现同样可圈可点。以 Humanity's Last Exam 测试为例,该 AI 代理获得了 32.9 分的优异成绩。这一分数充分证明了其在复杂任务处理、知识掌握与运用等方面的卓越能力,也让行业看到了阿里云在 AI 技术研发上的深厚积累与突出实力。对于需要可靠 AI 研究助手的用户来说,这样的测试成绩无疑是重要的参考依据。

系统性技术创新:打造 AI 研究能力核心支撑

1. 全流程合成数据方案:突破智能体能力上限

通义 DeepResearch 自研行业领先的全流程合成数据方案,无需任何人类干预即可构造超越人类水平的数据集,为智能体能力提升奠定基础。

- 增量预训练数据(Agentic CPT):首次提出在 Agent 模型训练中加入智能体增量预训练阶段,提供支持大规模扩展的预训练数据合成方案 AgentFounder [1],与后训练过程中产生的数据形成 “数据飞轮”。数据重组和问题构建基于知识文档、爬虫数据、知识图谱及后训练轨迹数据,以实体为锚定构建开放世界知识记忆,生成多风格(问题,答案)对;动作合成则基于多风格问题和历史轨迹,构建规划、推理、决策三类动作数据,离线探索推理 - 动作空间,无需额外商业工具 API 调用。

- 后训练数据合成:团队经多代方案迭代,从 WebWalker 的网页点击轨迹逆向合成 QA 对、WebDancer 的搜索式问题难度升级,到 WebSailor 的图结构复杂问题合成、WebShaper 的系统化可控方案,在保证数据高质量的同时实现可扩展性。

- SailorFog-QA 系列数据生成:针对 WebSailor Level3 任务,先从真实网站通过随机游走构建含复杂关系的知识图谱,再采样子图生成问答,最后通过信息模糊化制造难度,确保问题真实性与非线性结构。

- 形式化建模(WebShaper):以实体集合为 QA 基本构成,以实体关系操作为难度单元,通过合并、模糊化等原子操作逐步提升 QA 复杂度,实现难度可控化。

- PhD-Level 学科合成数据自动化生成:基于百万级多学科知识库(含网页、学术论文、电子书),经 “预处理(浓缩核心语义信息块)→种子生成(组合信息块生成多源依赖 QA)→迭代式复杂度升级(造题 Agent 用工具扩展知识、深化抽象、强化事实、构建计算任务)” 流程,形成难度持续提升的 “良性循环”。

2. 多模态 Agent 推理范式:适配复杂研究场景

团队对深度研究型智能体的推理范式展开广泛探索,最终模型支持多种推理形式,满足不同研究需求。

- ReAct 模式:遵循 “思考 - 行动 - 观察” 循环,通过多轮迭代解决问题,依托 128K 上下文长度处理大量交互轮次,实现环境交互可扩展性。选择该模式受 “The Bitter Lesson” 启发,以可扩展计算的通用方法提升模型适用性,为训练有效性提供清晰基准。

- 深度模式(Iterative Deep-Research Paradigm [3]):提出以 “综合与重构” 动态循环取代单一膨胀上下文,将复杂研究任务解构为多个 “研究回合”。每回合流程包括:重构精简工作区(基于上回合报告和工具响应生成轻量工作区)→执行 “思考(内部分析反思,不带入下一回合)- 综合(提炼关键信息到核心报告)- 行动(调用工具或输出答案)”,实现 “严谨状态维护”;同时推出 Research-Synthesis 框架,并行多个 IterResearch Agent 探索同一问题,整合报告结论,提升答案准确性与研究路径覆盖率。

3. Agent 模型训练流程优化:打通全链路闭环

团队重新设计 Agent 模型训练流程,构建 “Agentic CPT→Agentic SFT→Agentic RL” 端到端循环,为 AI Agent 提供无缝训练路径,其中强化学习(RL)环节对行为与高阶目标一致性至关重要:

- RL 算法优化:基于 GRPO 进行定制,采用 on-policy 训练范式确保学习信号与模型能力匹配,使用 token 级策略梯度损失函数;通过留一法降低优势估计方差,筛选负样本(排除未生成最终答案的超长样本)避免 “格式崩溃”;增大 batch size 和 group size 替代动态采样,平衡方差与监督信号效率。

- 训练动态表现:奖励(reward)持续上升,策略熵维持高位,模型持续探索避免过早收敛,这得益于 Web 环境非平稳性促进的稳健自适应策略,无需显式熵正则化。

- 关键认知:数据质量和训练环境稳定性比算法更关键 —— 直接用 BrowseComp 测试集训练效果远差于合成数据,因合成数据分布更一致,而人工标注数据噪声多、规模有限,难以提炼可学习的潜在分布。

4. 高稳定基础设施(Infra):支撑高效训练与运行

针对工具训练智能体的需求,构建高度稳定高效的基础设施体系:

- 仿真训练环境:用离线维基百科数据库和自定义工具套件替代实时 Web API,结合 SailorFog-QA-V2 专属数据,降低开发成本、提升速度与一致性,加速研究迭代。

- 稳定高效工具沙盒:开发统一沙盒,通过结果缓存、失败重试、饱和式响应处理并发与故障,为智能体提供鲁棒交互环境,避免工具错误破坏学习轨迹。

- 自动数据管理:以数据为核心驱动力,结合训练动态实时优化数据,通过全自动合成与数据漏斗调整训练集,形成 “数据生成 - 模型训练” 正向循环,保障训练稳定与性能提升。

- 基于策略的异步框架:在 rLLM 之上实现异步 RL 训练推理框架,多 Agent 实例并行与环境交互,独立生成轨迹,提升训练效率。

超长上下文支持拓展应用边界

通义 DeepResearch 支持 128K 超长上下文,这一特性使其在应对复杂任务时游刃有余。无论是多日行程规划,需要整合不同时间段、不同地点的各类信息;还是法律文档分析,要求精准捕捉复杂条款中的关键信息与逻辑关系,这款 AI 代理都能高效处理。128K 超长上下文 AI 技术的应用,为用户提供了精准、全面的解决方案,进一步拓展了 AI 技术在实际场景中的应用边界。

实际应用落地:赋能多领域生产力提升

目前通义 DeepResearch 已赋能多个阿里巴巴内部应用,成为提升效率、创造价值的 “生产力引擎”:

- 高德地图 AI 原生出行 Agent:与高德地图深度共建,推出全球首个 AI 原生出行 Agent,预置专属地图 API、实时天气查询、交通状况监测工具,可结合实时场景提供精准建议(如晚高峰避开拥堵路线前往机场)。

- 通义法睿法律智能体:注入 “通义法睿” 打造法律研究优化智能体,自动检索法条、类案和裁判文书并深度归纳分析。在与 OpenAI、Claude 等国际顶尖模型的对比中,其 “法条引用相关性”“案例引用相关性” 两项关键指标全面领先,综合表现最优,验证了复杂推理场景硬实力。

开源资源全面开放:助力开发者共建生态

阿里云此次开源通义 DeepResearch 的所有技术方案,为全球 AI 开发者社区提供宝贵资源。目前,通义 DeepResearch 的模型、框架和方案均已全面开源,用户可通过以下平台获取:

- GitHub:https://tongyi-agent.github.io

- Hugging Face:https://huggingface.co/Alibaba-NLP/Tongyi-DeepResearch-30B-A3B

- 魔搭社区:https://modelscope.cn/models/iic/Tongyi-DeepResearch-30B-A3B

- 技术博客:https://tongyi-agent.github.io/blog/introducing-tongyi-deep-research/

此外,通义 DeepResearch 拥有丰富的 DeepResearch Agent 家族,相关技术细节可参考系列论文:

[1] Scaling Agents via Continual Pre-training:https://arxiv.org/pdf/2509.13310

[2] WebSailor-V2: Bridging the Chasm to Proprietary Agents via Synthetic Data and Scalable Reinforcement Learning:https://arxiv.org/pdf/2509.13305

[3] WebResearcher: Unleashing unbounded reasoning capability in Long-Horizon Agents:https://arxiv.org/pdf/2509.13309

[4] WebWeaver: Structuring Web-Scale Evidence with Dynamic Outlines for Open-Ended DeepResearch:https://arxiv.org/pdf/2509.13312

[5] Towards General Agentic Intelligence via Environment Scaling:https://arxiv.org/pdf/2509.13311

[6] ReSum: Unlocking Long-Horizon Search Intelligence via Context Summarization:https://arxiv.org/pdf/2509.13313

[7] WebWalker: Benchmarking LLMs in Web Traversal:https://arxiv.org/pdf/2501.07572

[8] WebDancer: Towards Autonomous Information Seeking Agency:https://arxiv.org/pdf/2505.22648

[9] WebSailor: Navigating Super-human Reasoning for Web Agent:https://arxiv.org/pdf/2507.02592

[10] WebShaper: Agentically Data Synthesizing via Information-Seeking Formalization:https://arxiv.org/pdf/2507.15061

[11] WebWatcher: Breaking New Frontier of Vision-Language DeepResearch Agent:https://arxiv.org/pdf/2508.05748