开源AI红队工具“Red AI Range“助力发现、分析与缓解AI系统漏洞

开源AI红队平台Red AI Range(RAR)正在改变安全专业人员评估和强化AI系统的方式。该平台通过模拟真实攻击场景,利用容器化架构和自动化工具,简化了AI特有漏洞的发现、分析和缓解流程。

**核心功能**

1. 武器库/目标按钮可快速启动隔离的AI测试容器

2. 记录功能、状态仪表盘和编排文件导出优化工作流程

3. 培训模块结合远程GPU代理实现AI红队测试规模化

通过将RAR集成到关键基础设施测试流程中,组织可以在攻击者利用漏洞前,主动发现机器学习模型、数据处理流程和部署配置中的弱点。

架构设计强化AI漏洞评估

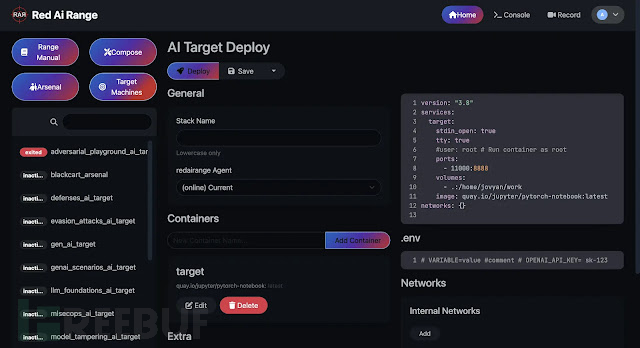

Red AI Range的核心是先进的Docker-in-Docker实现,可在多个AI框架间隔离冲突依赖。RAR的docker-compose.yml定义了以下服务:

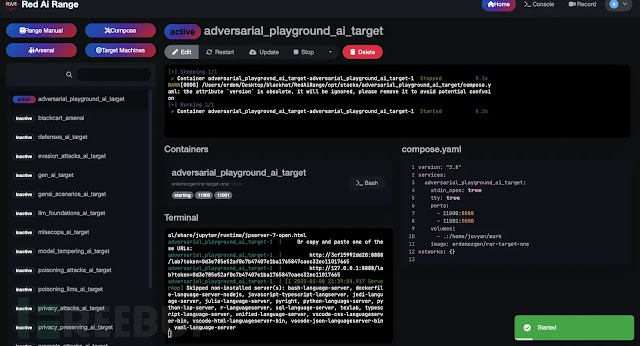

这种配置确保每个模拟的AI目标和测试工具都在独立容器中运行,保持环境一致性并支持快速重置到基线状态。通过Web界面中的"武器库"和"目标"按钮,红队成员可以部署漏洞扫描器、对抗攻击框架和故意设置漏洞的AI模型,每个堆栈名称后附加_arsenal或_ai_target以便清晰识别。

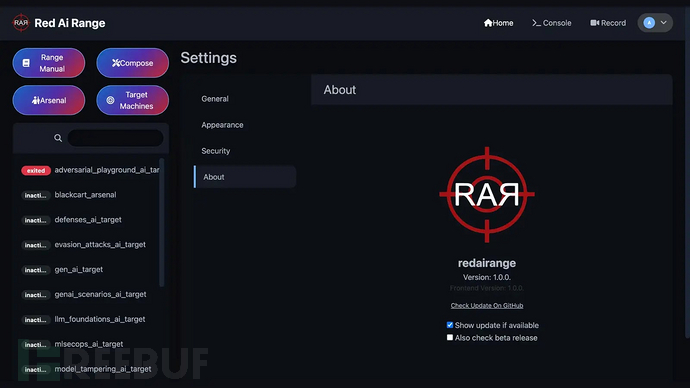

容器启动后,RAR的交互式仪表盘会显示实时活动状态(包括活跃、退出和非活跃环境),并提供将运行实例转换为可重用Docker Compose文件的控制功能。集成的会话记录器可有效捕获红队演练的视频记录和时间戳日志,便于全面的测试后分析和知识传递。该工具可在GitHub上获取。

集成培训模块

除了核心部署能力外,Red AI Range还提供了一套全面的培训模块,涵盖从基础AI安全概念到高级对抗技术的知识。模块主题包括投毒攻击(如干净标签后门注入)和规避方法(如投影梯度下降[PGD]攻击和Carlini & Wagner[C&W]攻击)。

每个模块都提供Jupyter Notebook教程,使从业者能够在受控环境中通过代码示例进行交互式实验。RAR还支持远程代理架构,允许团队在AWS上的GPU主机或本地GPU集群上分配测试工作负载。中央RAR控制台与远程代理之间的安全认证确保可以无缝协调大规模漏洞评估,特别是针对LLM或高计算量模型的评估。代理通过基于令牌的握手注册后,会出现在代理控制面板中进行部署编排。

通过将AI特有漏洞、自动化工具和培训资源整合到统一框架中,Red AI Range使安全团队能够提升其AI红队操作水平。随着企业在关键系统中持续采用AI技术,将RAR集成到常规安全工作流程中,对于发现隐藏风险、完善缓解策略以及维护AI驱动服务的可信度至关重要。