手势手语检测和识别1:手势手语数据集说明(含下载链接)

一. 前言

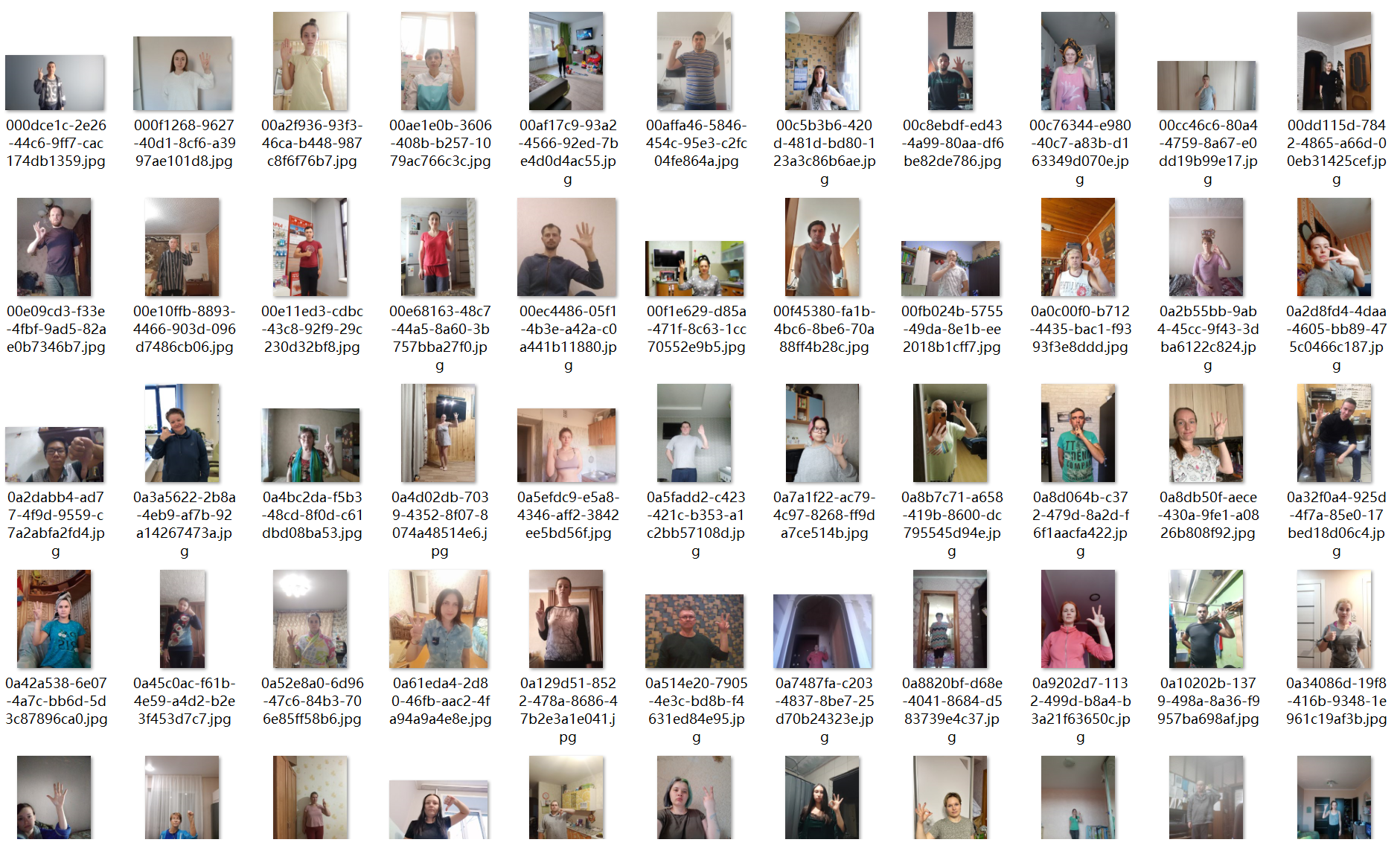

本篇博客是《手势手语检测和识别》系列文章之《手势手语数据集说明(含下载链接)》,网上有很多手势手语数据集的数据,百度一下,一搜一大堆,但质量参差不齐,很多不能用,即使一个一个的看也会浪费很多时间才有可能辨别出有用的数据集。为了方便你我他,本博客将分享一个由我自己整理的手势手语数据,可直接应用到目标检测算法比如yolo系列中,当然也可以应用到分类模型中,数据集总共有20000张图片,并包含它的高质量标注文件。数据质量非常高,甚至可应用到工业落地的项目中。

二. 手势手语类别说明

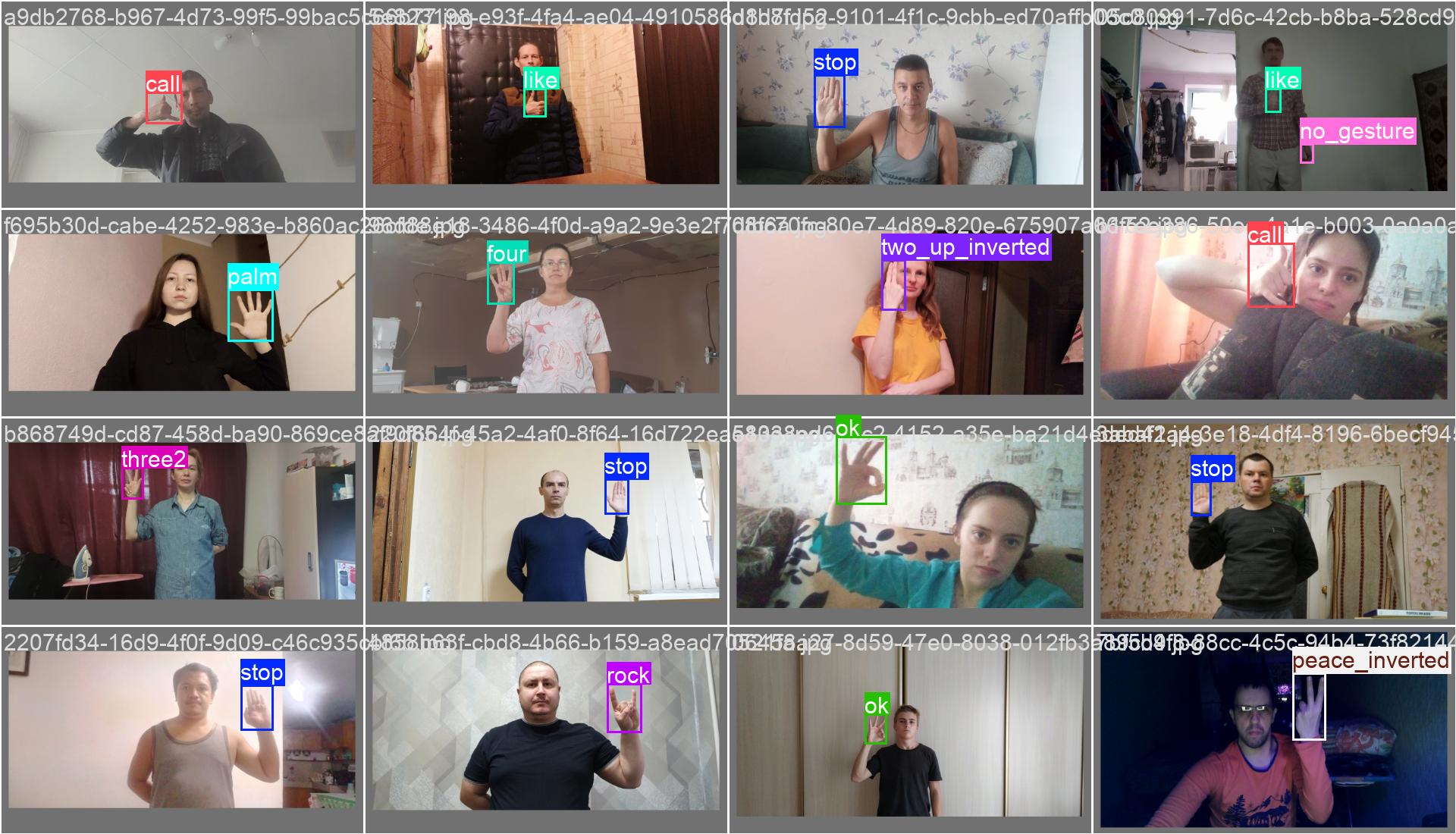

在手势手语检测识别算法开发中,我们需要定义手势手语的行为类别;项目将手势手语状态分为19种,names: ['stop', 'stop_inverted', 'peace_inverted', 'four', 'mute', 'no_gesture', 'call', 'peace', 'one', 'rock', 'three', 'three2', 'palm', 'ok', 'like', 'two_up_inverted', 'two_up', 'dislike', 'fist'],为了便于大家理解,下面给出实际应用中的效果图:

三. 手势手语数据集下载

数据包含内容:

手势手语数据集,数据集总共有20000张图片,其中测试集2000张,训练集18000张,都有相应的标注文件

四. 深度学习YOLOv11神经网络实现手势手语检测和识别

参考文章,Pytorch实现手势手语检测和识别(含手势手语数据集、训练代码和测试代码):手势手语检测和识别2:基于深度学习YOLOv11神经网络实现手势手语检测和识别(含训练代码和数据集)-CSDN博客

五. 基于GUI交互界面实现手势手语检测和识别

参考文章:基于GUI交互界面实现手势手语检测和识别(含手势手语数据集、训练代码,测试代码和GUI交互界面(支持图片、文件夹、摄像头和视频功能)):手势手语检测和识别3:基于深度学习YOLOv11神经网络实现手势手语检测和识别(含训练代码、数据集和GUI交互界面)-CSDN博客

项目完整文件下载请见演示与介绍视频的简介处给出:➷➷➷

基于深度学习YOLOv11神经网络实现手势手语检测和识别(含训练代码、数据集和GUI交互界面)_哔哩哔哩_bilibili