图神经网络分享系列-SDNE(Structural Deep Network Embedding) (一)

目录

一、摘要

二、介绍

1、网络表示学习的挑战

2、现有方法局限

3、深度模型解决方案

1、邻近性联合学习

2、半监督架构设计

4、方法概述

5、主要贡献

三、相关工作

1、深度神经网络表示学习

2、网络嵌入

图神经系列概览:图神经网络分享系列-概览-CSDN博客

一、摘要

网络嵌入是学习网络中节点低维表示的重要方法,旨在捕捉并保持网络结构。现有网络嵌入方法几乎都采用浅层模型。然而由于底层网络结构具有高度复杂性,浅层模型难以捕获高度非线性的网络结构,导致生成的网络表示次优。因此,如何找到能有效捕捉高度非线性网络结构并同时保持全局与局部特征的方法,成为亟待解决的重要问题。

针对该问题,本文提出结构深度网络嵌入方法SDNE。具体而言,设计了一个具有多层非线性函数的半监督深度模型,从而能够捕捉高度非线性的网络结构。通过联合利用一阶邻近度与二阶邻近度来保持网络拓扑特征:二阶邻近度通过无监督组件捕捉全局网络结构,一阶邻近度作为监督信息用于保持局部网络结构。在半监督深度模型中联合优化这两个组件,使得方法既能保持网络局部与全局特征,又对稀疏网络具有鲁棒性。

在五个真实网络(包括语言网络、引文网络及三个社交网络)上的实验表明:相较于基线方法,本方法能显著提升原始网络的重构效果,并在多标签分类、链接预测和可视化三大应用任务上取得实质性性能提升。

二、介绍

如今,网络无处不在,许多现实应用需要挖掘这些网络中的信息。例如,推特(Twitter)的推荐系统旨在从社交网络中挖掘用户偏好的推文;在线广告定向投放常需将用户聚类为社交网络中的社群。因此,挖掘网络信息至关重要,而核心问题之一是如何学习有效的网络表示[5]。一种主流方法是将网络嵌入低维空间,即为每个节点学习向量表示,目标是在嵌入空间中重构网络。这使得信息检索[34]、分类[15]和聚类[20]等任务可直接在低维空间进行。

1、网络表示学习的挑战

- 高非线性:如[19]所述,网络底层结构具有高度非线性,设计能捕捉此类结构的模型极具挑战性。

- 结构保持:网络嵌入需保留原始结构以支持分析任务,但节点相似性同时依赖局部和全局结构[24],如何兼顾二者是一大难点。

- 稀疏性:现实网络往往极度稀疏[21],仅利用有限观测边难以达到理想效果。

2、现有方法局限

早期网络嵌入方法采用浅层模型(如IsoMAP[29]、LE[1]、LINE[26]),但其表达能力有限[2],难以捕捉复杂非线性结构[30]。虽然部分方法引入核技术[32],但如[36]指出,核方法仍属浅层模型,对非线性结构的刻画不足。

3、深度模型解决方案

受深度学习在图像[15]、文本[25]和音频[10]领域成功的启发,本文提出一种深度模型,通过多层非线性函数将数据映射到高度非线性的潜在空间,从而有效捕捉网络非线性结构。

1、邻近性联合学习

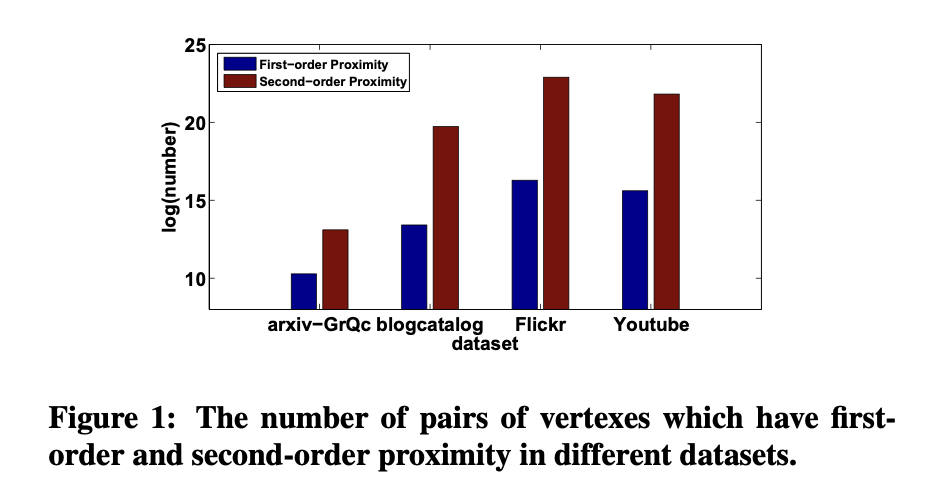

为解决结构保持和稀疏性问题,模型联合利用一阶邻近性(直接相连节点的局部相似性)和二阶邻近性(邻域结构的全局相似性)。一阶邻近性因网络稀疏性易缺失真实连接,而二阶邻近性能通过大量邻域相似对提供更全面的结构信息(如图1所示)。

2、半监督架构设计

采用半监督框架:无监督部分重构二阶邻近性以保持全局结构,监督部分以一阶邻近性作为监督信号保留局部结构。该设计使学习到的表示能同时兼顾局部与全局特征,并对稀疏网络具有鲁棒性。

4、方法概述

实验在五个真实世界网络数据集和四个实际应用场景中展开。结果表明,与基线方法相比,该方法生成的表示能显著更好地重构原始网络,并在多种任务和不同网络(包括高度稀疏网络)上取得实质性提升。这表明,通过高度非线性空间学习到的表示能有效保留网络结构,并对稀疏网络具有鲁棒性。

5、主要贡献

提出一种名为SDNE(Structural Deep Network Embedding)的结构化深度网络嵌入方法,将数据映射到高度非线性潜在空间以保留网络结构,且对稀疏网络具有鲁棒性。据已知研究,这是首次尝试利用深度学习学习网络表示。

设计一种半监督架构的深度模型,同时优化一阶邻近性和二阶邻近性。所学习的表示能保留网络局部与全局结构,并在稀疏网络中表现稳定。

在五个真实数据集和四种应用场景中进行了广泛评估。结果表明,该方法在多标签分类、网络重构、链接预测和可视化任务中均显著优于基线方法。特别地,当标注数据稀缺时,该方法相比基线可提升20%性能;某些情况下仅需60%的训练样本即可达到更优效果。

三、相关工作

1、深度神经网络表示学习

表示学习一直是机器学习的重要问题,许多研究致力于为样本学习有效的表示。深度神经网络的最新进展表明,其具备强大的表示能力,能为多种数据类型生成有用的表示。例如,一项研究提出七层卷积神经网络用于图像分类的表示生成;另一项工作提出多模态深度模型,通过学习图像-文本统一表示实现跨模态检索任务。

然而,针对网络数据(尤其是网络表示学习)的深度学习研究仍较少。已有工作包括利用受限玻尔兹曼机进行协同过滤、采用深度自编码器实现图聚类,以及提出异构深度模型完成异构数据嵌入。本研究与这些工作的差异体现在两方面:目标不同,本工作聚焦于学习低维且保持结构的网络表示,使其可跨任务复用;方法差异,本工作同时考虑顶点间的一阶和二阶相似性以保留局部与全局网络结构,而现有方法仅关注单一阶次信息。

2、网络嵌入

本工作解决网络嵌入问题,旨在学习网络的低维表示。早期方法如局部线性嵌入(LLE)和等距映射(IsoMAP)基于特征向量构建亲和图(affinity graph),并通过求解主导特征向量作为网络表示。近期研究设计了分别捕获局部和全局结构的损失函数,并进一步扩展至高阶信息利用。尽管这些方法取得成效,但均采用浅层模型,难以有效捕捉网络中的高度非线性结构。

此外,部分方法虽尝试通过一阶和高阶相似性保留网络结构,却以分离方式学习表示并简单拼接,这显然不如在统一架构中同时建模局部与全局结构高效。DeepWalk结合随机游走和Skip-gram模型学习网络表示,虽经验性有效,但缺乏明确目标函数阐明如何保持网络结构,且易仅保留二阶相似性。本方法通过显式目标函数设计,同时保留一阶与二阶相似性,从而兼顾局部与全局结构。

本篇内容就到这里,下一篇会详细介绍核心算法和网络架构。

传送门:图神经网络分享系列-SDNE(Structural Deep Network Embedding) (二)-CSDN博客