DINOv2 vs DINOv3 vs CLIP:自监督视觉模型的演进与可视化对比

近年来,自监督学习在计算机视觉领域取得了巨大进展,推动了无需人工标注即可学习强大视觉表示的视觉基础模型(Vision Foundation Models)的发展。其中,DINOv2 和 CLIP 是两个极具影响力的代表性工作,而最新的 DINOv3 则标志着该方向的又一次重大突破。

本文将简要介绍这三项工作的背景与核心思想,提供论文与代码资源,并通过一个直观的特征可视化实验,对比它们在真实场景下的表现差异。

一、背景介绍:DINOv2、DINOv3 与 CLIP

1. CLIP(Contrastive Language–Image Pre-training)

- 论文链接:https://arxiv.org/abs/2103.00020

- 官方主页/代码:https://github.com/openai/CLIP

CLIP 由 OpenAI 提出,是多模态自监督学习的里程碑。它通过在互联网规模的图像-文本对上进行对比学习,使模型能够理解图像内容与自然语言之间的对应关系。其核心思想是:将图像和文本映射到同一语义空间,使得匹配的图文对距离更近,不匹配的更远。

优点:

- 支持零样本分类(Zero-shot Classification),无需微调即可迁移到新任务。

- 泛化能力强,在多种下游任务中表现优异。

局限:

- 依赖大量带噪声的图文对数据。

- 图像特征偏向全局语义,缺乏细粒度的密集特征(dense features),难以用于分割、检测等需要像素级理解的任务。

2. DINOv2(Self-supervised Vision Transformers with no labels)

- 论文链接:https://arxiv.org/abs/2304.07193

- 官方代码:https://github.com/facebookresearch/dinov2

DINOv2 是 Meta 提出的纯自监督视觉模型,不依赖任何标签或文本信息。它基于 Vision Transformer 架构,采用自蒸馏(self-distillation)策略训练:用学生网络预测教师网络的输出,教师网络权重由学生滑动平均得到。

DINOv2 的关键贡献在于:

- 学习高质量的密集特征表示,适用于语义分割、深度估计等密集预测任务。

- 在多种下游任务中超越有监督预训练模型,且无需微调。

局限:

- 虽然特征质量高,但在极长训练周期下可能出现特征退化问题。

- 对分辨率变化和模型缩放的灵活性仍有提升空间。

3. DINOv3(Scaling Self-Supervised Vision Transformers to 1B Images)

- 论文链接:https://arxiv.org/abs/2508.10104

- 官方代码:https://github.com/facebookresearch/dinov3

DINOv3 是 DINO 系列的最新演进,旨在实现“通用视觉基础模型”的愿景。它通过三大创新进一步提升了自监督学习的上限:

- 大规模扩展(Scaling):精心准备的数据集和优化策略,支持在超过10亿图像上训练更大模型。

- Gram Anchoring:提出的新方法,有效缓解了长期训练中密集特征图退化的问题,显著提升特征稳定性。

- 后处理增强灵活性:引入分辨率自适应、模型缩放和文本对齐策略,使模型更具部署灵活性。

核心成果:

- 无需微调,在各类视觉任务上全面超越此前的自监督、弱监督乃至部分监督模型。

- 提供 DINOv3 模型套件,覆盖不同尺寸与计算需求,适配多样化的应用场景。

- 密集特征质量达到新高度,尤其在细粒度结构感知方面表现突出。

二、核心要点总结

| 特性 | CLIP | DINOv2 | DINOv3 |

|---|---|---|---|

| 训练方式 | 图文对比学习 | 自蒸馏(无标签) | 自蒸馏 + Gram Anchoring |

| 是否需要文本 | 是 | 否 | 可选(支持后对齐) |

| 特征类型 | 全局特征为主 | 高质量密集特征 | 更稳定、高质量密集特征 |

| 零样本能力 | 强(天然支持) | 弱(需额外对齐) | 支持后对齐,灵活性高 |

| 下游任务适用性 | 分类、检索 | 分割、检测、深度估计等 | 全面覆盖,无需微调 |

| 模型扩展性 | 中等 | 较好 | 极佳(支持大模型/大数据) |

| 特征退化问题 | 不显著 | 存在(长期训练) | 通过 Gram Anchoring 解决 |

💡 一句话总结:

- CLIP 是多模态先驱,擅长语义对齐;

- DINOv2 是自监督密集特征标杆;

- DINOv3 是 DINO 系列的全面升级,解决了长期训练退化问题,实现了更高性能、更强泛化、更广适用性的统一。

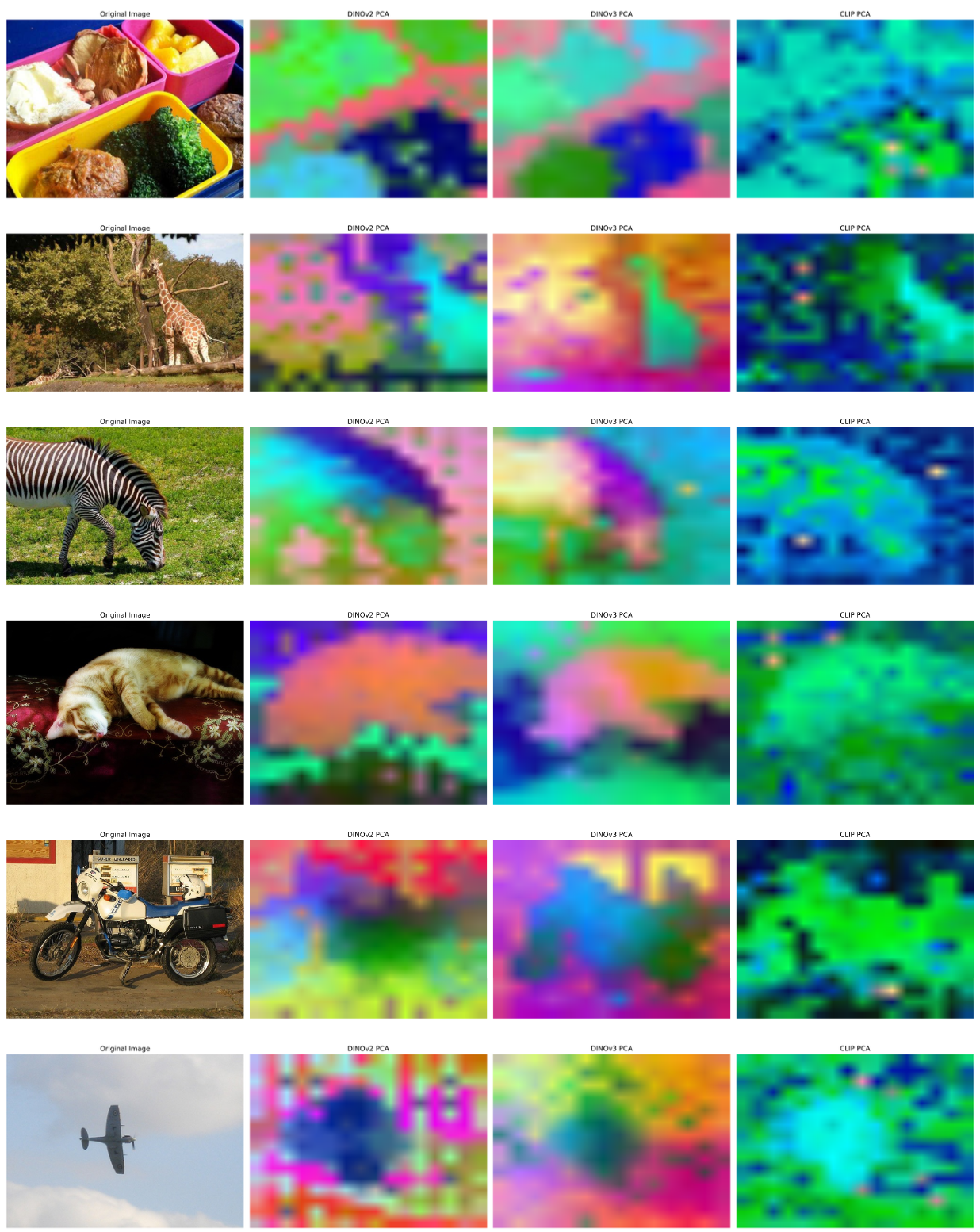

三、可视化实验:PCA 特征降维对比

为了直观感受三者在特征表达上的差异,我们设计了一个简单的可视化实验:

实验设置

- 使用 CLIP ViT-L/16、DINOv2-giant 和 DINOv3-giant 模型。

- 输入同一张复杂场景图像(包含多种物体、纹理和结构)。

- 提取每个模型的 patch-level 特征图(即每个图像块的特征向量)。

- 将所有 patch 特征进行 PCA 降维至3维,映射为 RGB 颜色空间进行可视化。

🔍 注:颜色不代表真实色彩,而是特征差异的可视化表达。颜色越相似,表示特征越接近;颜色差异大,表示语义或结构区分明显。

四、结语

DINOv3 的发布不仅是 DINO 系列的迭代升级,更是自监督视觉模型迈向“通用视觉基础模型”的关键一步。它证明了仅靠图像本身,通过合理的算法设计和大规模训练,就能学到媲美甚至超越多模态模型的高质量视觉表示。

未来,随着 DINOv3 模型套件的广泛应用,我们有望看到更多无需微调、即插即用的视觉系统,在机器人、自动驾驶、遥感、医疗影像等领域发挥重要作用。

而 CLIP 与 DINOv3 的结合路径——例如用 DINOv3 学习密集特征,再通过少量图文数据对齐语言空间——或许正是通向真正通用视觉智能的一条光明之路。

📌 资源汇总:

| 模型 | 论文链接 | 官方代码/主页 |

|---|---|---|

| CLIP | arXiv:2103.00020 | GitHub - OpenAI CLIP |

| DINOv2 | arXiv:2304.07193 | GitHub - Meta DINOv2 |

| DINOv3 | arXiv:2508.10104 | GitHub - Meta DINOv3 |