第1.9节:神经网络与深度学习基础

🏆作者简介,黑夜开发者,CSDN领军人物,全栈领域优质创作者✌,CSDN博客专家,阿里云社区专家博主,2023年6月CSDN上海赛道top4。

🏆数年电商行业从业经验,历任核心研发工程师,项目技术负责人。

🏆本文已收录于PHP专栏:智能时代:人人都要知道的AI课

🎉欢迎 👍点赞✍评论⭐收藏

各位朋友大家好,欢迎来到我的最新专栏《智能时代:人人都要知道的AI课》,人工智能已经不再是科幻电影中的遥远概念,而是正在深刻改变我们每个人的生活。从ChatGPT的爆火,到自动驾驶的普及,从智能家居的便利,到医疗AI的突破——AI技术正在以惊人的速度重塑我们的世界,今天我们讲【神经网络与深度学习基础】。

文章目录

- 🚀一、引言

- 🚀二、神经网络的基本概念

- 🔎2.1 什么是神经网络

- 🔎2.3 人工神经元模型

- 🚀三、激活函数详解

- 🔎3.1 激活函数的作用

- 🔎3.2 常用激活函数

- Sigmoid函数

- ReLU函数

- Softmax函数

- 🚀四、神经网络结构

- 🔎4.1 基本结构组成

- 🔎4.2 前馈神经网络

- 🚀五、反向传播算法

- 🔎5.1 什么是反向传播

- 🔎5.2 梯度下降原理

- 🔎5.3 梯度消失与梯度爆炸

- 🚀六、深度学习基础

- 🔎6.1 什么是深度学习

- 🔎6.2 深度学习的优势

- 🔎6.3 深度学习的挑战

- 🚀七、常见神经网络架构

- 🔎7.1 卷积神经网络(CNN)

- 🔎7.2 循环神经网络(RNN)

- 🔎7.3 生成对抗网络(GAN)

- 🚀八、训练技巧与优化

- 🔎8.1 数据预处理

- 🔎8.2 正则化技术

- 🔎8.3 优化算法

- 🚀九、实际应用案例

- 🔎9.1 图像分类

- 🔎9.2 文本分类

- 🔎9.3 推荐系统

- 🚀十、发展趋势与展望

- 🔎10.1 技术发展趋势

- 🔎10.2 应用领域拓展

- 🔎10.3 挑战与机遇

- 🚀十一、学习建议

- 🔎11.1 学习路径

- 🔎11.2 实践建议

- 🚀十二、总结

🚀一、引言

神经网络和深度学习是人工智能领域的核心技术,它们通过模拟人脑的工作方式,实现了从简单模式识别到复杂智能决策的跨越。从1950年代的感知机,到2010年代的深度学习革命,再到今天的大模型时代,神经网络技术经历了翻天覆地的变化。

🚀二、神经网络的基本概念

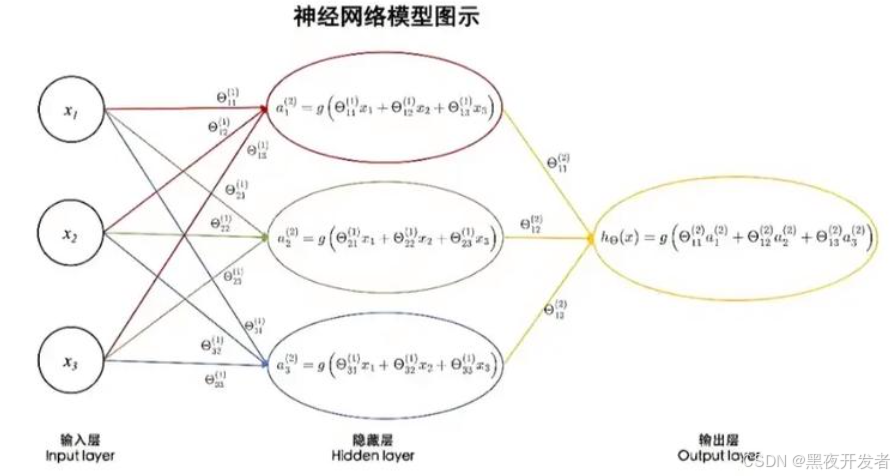

神经网络是一种模仿生物神经元结构的计算模型,由多层“神经元”(数学计算单元)组成,通过权重连接传递信息,例如,处理28×28像素的手写数字图像时,输入层包含784个神经元(对应像素值),后续层通过权重计算逐步提取特征,最终输出分类结果

🔎2.1 什么是神经网络

神经网络是一种模仿生物神经系统的计算模型,由大量相互连接的神经元组成。

核心思想:

通过模拟人脑神经元的工作方式,构建能够学习和适应的计算系统。

ir合同扑通扑通【】图痛【】6y

- 轴突:输出信号

- 突触:神经元之间的连接

工作原理:

输入信号 → 加权求和 → 激活函数 → 输出信号

🔎2.3 人工神经元模型

数学表示:

y = f(Σ(w_i * x_i) + b)y'y'y'y'y'y'y'y'y'y'y'y'y'y

- `w_i`:权重

- `b`:偏置

- `f()`:激活函数

- `y`:输出**Python实现示例**:

```pythony有有有有有有有有有有有有有有有有由于i和我i我就问问今晚i今晚i文化就无所谓

import numpy as npdef artificial_neuron(inputs, weights, bias, activation_function):# 计算加权和weighted_sum = np.dot(inputs, weights) + bias# 应用激活函数output = activation_function(weighted_sum)return output# 示例:使用sigmoid激活函数

def sigmoid(x):return 1 / (1 + np.exp(-x))# 测试神经元

inputs = np.array([0.5, 0.3, 0.8])

weights = np.array([0.2, 0.4, 0.1])

bias = 0.1

output = artificial_neuron(inputs, weights, bias, sigmoid)

print(f"神经元输出: {output}")

🚀三、激活函数详解

🔎3.1 激活函数的作用

激活函数为神经网络引入非线性,使其能够学习复杂的模式。

主要作用:

- 引入非线性变换

- 控制神经元输出范围

- 解决梯度消失问题

- 增加模型表达能力

🔎3.2 常用激活函数

Sigmoid函数

数学公式:

f(x) = 1 / (1 + e^(-x))

特点:

- 输出范围:[0, 1]

- 平滑连续

- 容易梯度消失

- 适合二分类问题

ReLU函数

数学公式:

f(x) = max(0, x)

特点:

- 计算简单

- 解决梯度消失

- 稀疏激活

- 最常用的激活函数

Softmax函数

数学公式:

f(x_i) = e^(x_i) / Σ(e^(x_j))

特点:

- 输出概率分布

- 适合多分类

- 输出和为1

- 常用于输出层

🚀四、神经网络结构

🔎4.1 基本结构组成

输入层:

- 接收原始数据

- 不进行任何计算

- 神经元数量等于特征维度

隐藏层:

- 进行特征变换

- 可以有多层

- 每层神经元数量可调

输出层:

- 产生最终预测

- 神经元数量等于输出维度

- 激活函数根据任务选择

🔎4.2 前馈神经网络

结构特点:

- 信息单向流动

- 无循环连接

- 最基础的神经网络

数学表示:

h_1 = f_1(W_1 * x + b_1)

h_2 = f_2(W_2 * h_1 + b_2)

...

y = f_out(W_out * h_n + b_out)

🚀五、反向传播算法

🔎5.1 什么是反向传播

反向传播是训练神经网络的核心算法,通过计算梯度来更新网络参数。

核心思想:

从输出层开始,反向计算每一层的梯度,然后更新权重和偏置。

🔎5.2 梯度下降原理

目标:最小化损失函数

J(θ) = (1/m) * Σ(L(y_pred, y_true))

参数更新:

θ = θ - α * ∇J(θ)

其中:

θ:网络参数α:学习率∇J(θ):损失函数梯度

🔎5.3 梯度消失与梯度爆炸

梯度消失:

- 深层网络中的梯度接近零

- 导致早期层学习缓慢

- 解决方法:ReLU激活函数、残差连接

梯度爆炸:

- 梯度值过大

- 导致训练不稳定

- 解决方法:梯度裁剪、权重初始化

🚀六、深度学习基础

🔎6.1 什么是深度学习

深度学习是机器学习的一个分支,使用多层神经网络来学习数据的层次化表示。

核心特征:

- 多层非线性变换

- 自动特征学习

- 端到端学习

- 强大的表示能力

🔎6.2 深度学习的优势

自动特征提取:

- 无需手工设计特征

- 学习层次化表示

- 适应不同任务

强大的表达能力:

- 理论上可以逼近任意函数

- 处理高维数据

- 学习复杂模式

端到端学习:

- 从原始数据到最终输出

- 减少中间步骤

- 提高学习效率

🔎6.3 深度学习的挑战

数据需求:

- 需要大量训练数据

- 数据质量要求高

- 标注成本高

计算资源:

- 需要强大的计算能力

- 训练时间长

- 硬件要求高

可解释性:

- 黑盒模型

- 难以理解决策过程

- 调试困难

🚀七、常见神经网络架构

🔎7.1 卷积神经网络(CNN)

适用场景:

- 图像处理

- 计算机视觉

- 模式识别

核心组件:

- 卷积层:提取局部特征

- 池化层:降维和不变性

- 全连接层:分类决策

🔎7.2 循环神经网络(RNN)

适用场景:

- 序列数据处理

- 自然语言处理

- 时间序列预测

核心特点:

- 具有记忆能力

- 处理变长序列

- 参数共享

🔎7.3 生成对抗网络(GAN)

适用场景:

- 图像生成

- 数据增强

- 风格迁移

核心思想:

- 生成器:生成假数据

- 判别器:区分真假数据

- 对抗训练

🚀八、训练技巧与优化

🔎8.1 数据预处理

标准化:

def normalize(X):mean = np.mean(X, axis=0)std = np.std(X, axis=0)return (X - mean) / std

数据增强:

- 图像:旋转、翻转、缩放

- 文本:同义词替换、回译

- 音频:添加噪声、变速

🔎8.2 正则化技术

Dropout:

def dropout(X, keep_prob):mask = np.random.binomial(1, keep_prob, size=X.shape) / keep_probreturn X * mask

L2正则化:

def l2_regularization(weights, lambda_reg):reg_term = (lambda_reg / (2 * m)) * sum(np.sum(w**2) for w in weights)return reg_term

早停法:

- 监控验证集性能

- 防止过拟合

- 自动停止训练

🔎8.3 优化算法

随机梯度下降(SGD):

def sgd_update(weights, grads, learning_rate):for w, dw in zip(weights, grads):w -= learning_rate * dwreturn weights

Adam优化器:

- 自适应学习率

- 动量优化

- 广泛使用

🚀九、实际应用案例

🔎9.1 图像分类

MNIST手写数字识别:

# 数据加载

from tensorflow.keras.datasets import mnist

(x_train, y_train), (x_test, y_test) = mnist.load_data()# 模型构建

model = Sequential([Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),MaxPooling2D((2, 2)),Conv2D(64, (3, 3), activation='relu'),MaxPooling2D((2, 2)),Flatten(),Dense(128, activation='relu'),Dense(10, activation='softmax')

])# 训练

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

model.fit(x_train, y_train, epochs=5, validation_data=(x_test, y_test))

🔎9.2 文本分类

情感分析:

from transformers import AutoTokenizer, AutoModelForSequenceClassification# 加载预训练模型

tokenizer = AutoTokenizer.from_pretrained("bert-base-chinese")

model = AutoModelForSequenceClassification.from_pretrained("bert-base-chinese")# 文本处理

text = "这部电影真的很棒!"

inputs = tokenizer(text, return_tensors="pt")

outputs = model(**inputs)

predictions = torch.nn.functional.softmax(outputs.logits, dim=-1)

🔎9.3 推荐系统

协同过滤:

import torch

import torch.nn as nnclass MatrixFactorization(nn.Module):def __init__(self, num_users, num_items, embedding_dim):super().__init__()self.user_embeddings = nn.Embedding(num_users, embedding_dim)self.item_embeddings = nn.Embedding(num_items, embedding_dim)def forward(self, user_ids, item_ids):user_emb = self.user_embeddings(user_ids)item_emb = self.item_embeddings(item_ids)return torch.sum(user_emb * item_emb, dim=1)

🚀十、发展趋势与展望

🔎10.1 技术发展趋势

自监督学习:

- 减少标注依赖

- 利用数据本身结构

- 提高学习效率

注意力机制:

- Transformer架构

- 全局依赖建模

- 并行计算

神经架构搜索(NAS):

- 自动设计网络结构

- 减少人工调参

- 提高模型性能

🔎10.2 应用领域拓展

多模态学习:

- 结合多种数据类型

- 统一表示学习

- 跨模态理解

边缘计算:

- 模型压缩

- 移动端部署

- 实时推理

联邦学习:

- 分布式训练

- 隐私保护

- 协作学习

🔎10.3 挑战与机遇

技术挑战:

- 模型可解释性

- 鲁棒性提升

- 效率优化

- 泛化能力

应用机遇:

- 个性化服务

- 智能决策

- 自动化系统

- 创新应用

🚀十一、学习建议

🔎11.1 学习路径

初学者:

- 掌握数学基础(线性代数、微积分、概率论)

- 学习Python编程

- 理解基本概念和原理

进阶者:

- 深入学习经典算法

- 实践项目开发

- 关注最新研究进展

高级者:

- 参与开源项目

- 发表研究论文

- 推动技术发展

🔎11.2 实践建议

项目实践:

- 从简单任务开始

- 逐步增加复杂度

- 注重实际效果

理论学习:

- 理解数学原理

- 掌握算法细节

- 关注最新进展

工具使用:

- 熟悉主流框架(PyTorch、TensorFlow)

- 掌握开发工具

- 了解部署方法

🚀十二、总结

神经网络和深度学习是人工智能领域最重要的技术之一,它们通过模拟人脑的工作方式,实现了强大的学习和推理能力。

关键要点:

- 神经网络:模仿生物神经元的计算模型

- 深度学习:使用多层神经网络进行特征学习

- 反向传播:训练神经网络的核心算法

- 应用广泛:从图像识别到自然语言处理

发展趋势:

- 模型规模不断扩大

- 算法不断优化

- 应用场景日益丰富

- 技术门槛逐渐降低

作为AI学习者,我们应该:

- 打好基础:掌握数学和编程基础

- 勤于实践:多动手做项目

- 持续学习:跟上技术发展

- 关注应用:解决实际问题

深度学习的未来充满无限可能,让我们一起探索这个智能时代的美好前景!

思考题:

- 你认为深度学习的最大优势是什么?

- 在你的项目中,你会选择哪种神经网络架构?

- 如何解决深度学习中的过拟合问题?

以上问题欢迎大家评论区留言讨论,我们下期见。