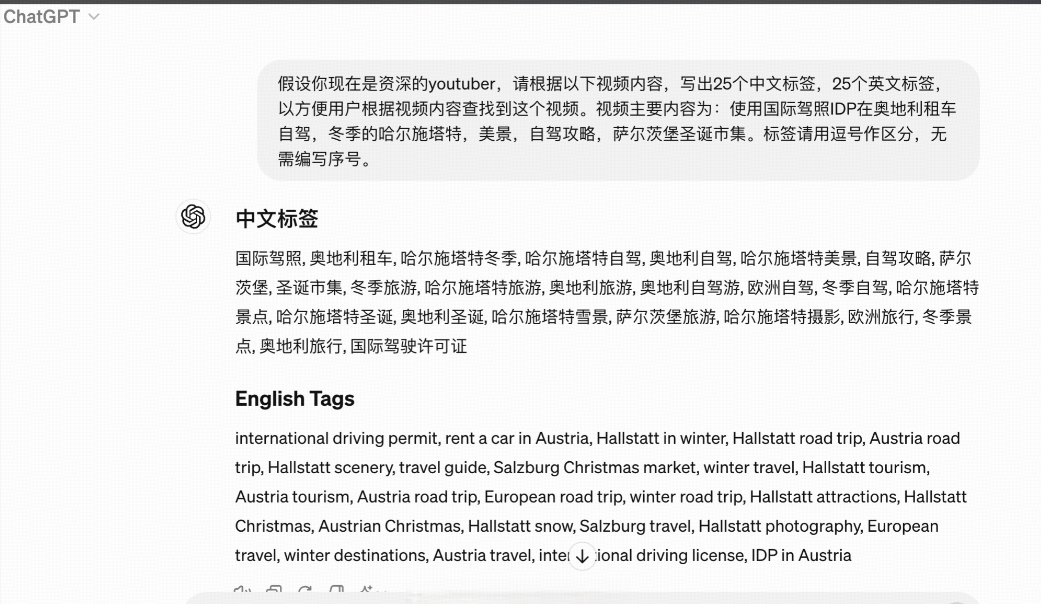

【OpenAI】ChatGPT-4o 全能AI-omni的详细介绍+API KET的使用教程!

文章目录

- ChatGPT-4o 是 OpenAI 于 2024 年 5 月 14 日发布的一款多模态大模型,其中 “o” 代表 “omni”,意为 “全能”。接下来看看详细的参数介绍吧!

- 模型架构与参数

- 模型特点

- 功能优势

- 基准测试与场景化验证

- 1、多模态基准数据集

- 2、实时交互场景测试

- 对比分析与泛化能力评估

- 1、竞品横向对比

- 2、泛化能力验证

- 什么是 OpenAI Key?

- 1. 定义与本质

- 2. OpenAI Key 的核心作用

- 3.OpenAI API Key的使用场景

- 通过“OpenAI官网”获取API Key(国外)

- 1、访问OpenAI官网

- 2、生成API Key

- 3、使用 OpenAI API代码

- 通过“能用AI”获取API Key(国内)

- 1、访问能用AI工具

- 2、生成API Key

- (1).可以调用的模型

- (2).Python示例代码(基础)

- (3).Python示例代码(高阶)

- 更多文章

ChatGPT-4o 是 OpenAI 于 2024 年 5 月 14 日发布的一款多模态大模型,其中 “o” 代表 “omni”,意为 “全能”。接下来看看详细的参数介绍吧!

模型架构与参数

ChatGPT-4o 的核心架构基于 Transformer v3 改进版,采用 96 层 Encoder-Decoder 结构,各层间通过残差连接与层归一化技术,保障信息流畅传递。它配备 128 个注意力头,总参数达 1750 亿个,这一规模为其强大的性能奠定基础。在上下文窗口方面,输入最大支持 128,000 tokens,约合 9.6 万字中文或 12.8 万字英文,输出窗口最大 16,384 tokens,约 1.2 万字中文,使得长文本处理游刃有余。

模型特点

-

多模态融合先锋:ChatGPT-4o 打破模态壁垒,能接收文本、音频、图像任意组合输入,并实时生成对应形式输出。无论是分析一张复杂图表,还是理解一段包含音频旁白的视频,它都能精准处理,为用户提供全面反馈。

-

实时交互 “快枪手”:音频交互延迟最短 232 毫秒,平均 320 毫秒,几乎与人类即时交流无异;文本交互平均响应时间 320 毫秒,短句最快 150 毫秒;图像交互延迟约 800 毫秒。这种高效响应让用户对话过程行云流水,无需漫长等待。

-

性能价格双优化:性能上,在传统文本、推理、编码基准测试中,它与 GPT-4 Turbo 旗鼓相当,多模态处理能力更胜一筹。处理速度比 GPT-4 Turbo 快 2 倍,速率限制提高 5 倍,达每分钟 1000 万 token,而价格却下降 50%,大幅提升性价比。

功能优势

-

语言精通大师:支持 50 种语言处理,无论是复杂的学术文献翻译,还是不同语种间商务谈判辅助,它都能轻松应对,且速度与质量双优,打破语言交流障碍。

-

视觉理解专家:图像识别精度极高,能从医学影像中精准定位病灶,在工业检测中识别产品瑕疵,还能依据文字描述生成高质量图像,为设计师、艺术家提供创意灵感与初稿。

-

音频处理行家:语音识别能力卓越,在嘈杂环境也能准确识别语音内容,词错误率较 Whisper-v3 降低 18%,低资源语言错误率降低 25%。语音合成效果自然,200+ 种语音风格可选,语速可调节,MOS 自然度评分达 4.8/5.0,用于有声读物制作、智能客服语音回复等场景十分出色。

基准测试与场景化验证

1、多模态基准数据集

-

视觉-语言:使用 VQA(视觉问答)、MMMU(跨学科图文问答)、ChartQA(数据图表分析)等测试图文理解能力。例如,在 MMMU 中,模型需解析 mRNA 疫苗图解并生成医学解释,准确率达 92% 表明专业领域融合能力达标。

-

音频-文本:通过 EGO4D-EXO 数据集验证语音交互延迟(如平均 320 毫秒),并使用 MLS 翻译基准测试语音翻译质量。

-

复杂推理:MathVista(数学可视化问题)和 All-Angles Bench(跨视角物体追踪)可暴露模型在空间推理和多模态动态处理中的短板。例如,ChatGPT-4o 在 All-Angles Bench 中跨视角追踪错误率超 50%,显示其空间想象力需提升。

2、实时交互场景测试

在视频会议、智能客服等场景中,评估以下指标:

-

响应延迟:语音输入至输出的平均延迟需 ≤ 500 毫秒,文本交互最快 150 毫秒。

-

上下文保持率:在 10 轮以上对话中,模型需准确回忆前序多模态信息(如图像内容、语音指令),保持率 ≥ 95%。

-

多轮流畅度:人工标注对话逻辑连贯性,避免出现 “答非所问” 或 “重复内容”,流畅率需 ≥ 90%。

对比分析与泛化能力评估

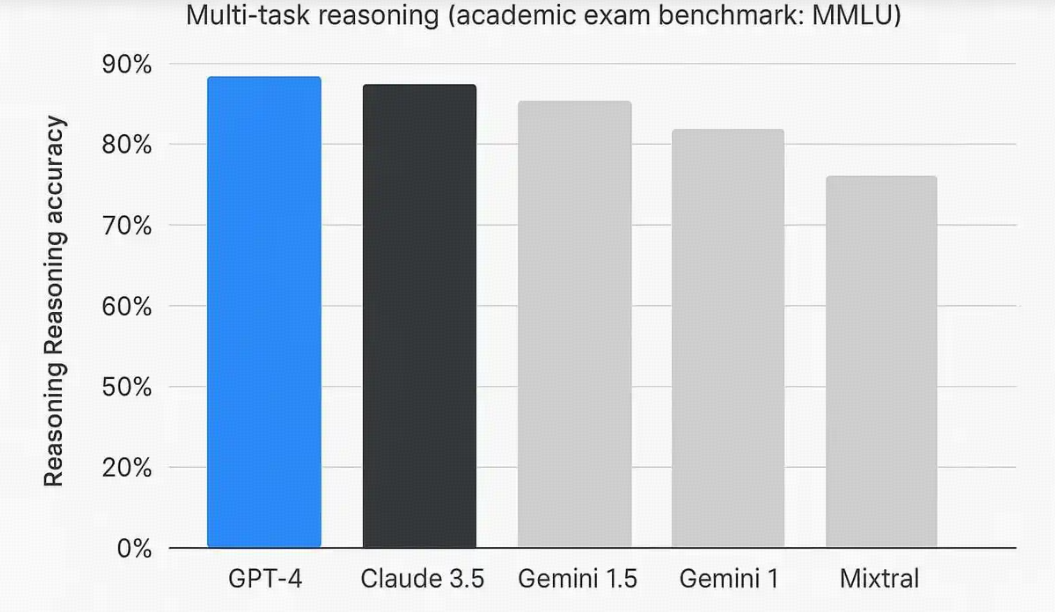

1、竞品横向对比

-

多模态生成质量:与 Gemini Pro、豆包 V5.2 等模型对比图文互生、视文生成得分。例如,ChatGPT-4o 在图文问答中准确率达 92%,但视文生成质量略逊于 Gemini Pro(4.3 分 vs 4.5 分)。

-

实时交互表现:在 AGI-Eval 评测中,ChatGPT-4o 的平均排名(2.2)高于智谱清言(2.9),但中文理解仍存在局部偏差。

2、泛化能力验证

-

低资源语言处理:测试斯瓦希里语等小语种的语音识别和翻译效果,ChatGPT-4o 的错误率较 Whisper-v3 降低 25%。

-

跨领域迁移:在未训练过的场景(如工业质检、法律文书解析)中,评估模型能否快速适配。例如,通过少量标注数据微调后,模型需从产品 X 光片中识别焊点缺陷,准确率 ≥ 85%。

什么是 OpenAI Key?

1. 定义与本质

OpenAI Key(又称 “OpenAI API Key”),是 OpenAI 为开发者提供的身份认证凭证,本质上是一串由字母、数字和特殊符号组成的唯一字符串(例如:sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx)。

当开发者通过 OpenAI API 调用模型服务时,需要在请求中携带这串 Key,OpenAI 服务器通过验证 Key 的有效性,来确认开发者的身份、判断其是否拥有调用权限,并统计 API 的使用量(用于计费)。简单来说,OpenAI Key 就像是开发者访问 OpenAI 模型能力的“钥匙”,没有 Key 则无法通过 API 使用 OpenAI 的技术服务。

2. OpenAI Key 的核心作用

-

身份验证

OpenAI 通过 Key 识别开发者身份,确保只有注册并获得授权的用户才能调用 API,防止未授权访问与滥用。 -

权限控制

不同类型的 Key 对应不同的权限,例如:免费账号的 Key 有调用次数、模型类型限制(如无法调用 GPT-4);付费账号的 Key 可解锁更多模型、更高调用额度,且支持自定义 API 参数(如上下文窗口长度、响应速度)。 -

用量统计与计费

OpenAI 根据 Key 的调用记录统计开发者使用 API 的次数(按 “token” 计费,token 是模型处理文本的基本单位,1 个 token 约等于 0.75 个英文单词或 2 个中文字符),并根据用量从开发者绑定的支付方式中扣费(免费账号通常有初始额度,如 5 美元,用完后需升级付费)。 -

资源管理

开发者可创建多个 Key,为不同的项目、应用分配独立的 Key,便于区分不同场景的 API 使用情况,也能在某个 Key 泄露时快速删除,避免影响其他项目。

3.OpenAI API Key的使用场景

- 自动化集成:将OpenAI的文本生成能力集成到现有应用、网站或服务中,实现流程自动化。

- 专属大模型应用:利用API Key创建个性化的AI应用,如智能客服、内容推荐系统等。

- 数据分析与处理:通过API调用进行自然语言处理,提升数据分析的智能化水平。

无论你身处哪个领域,掌握API Key的获取与使用,都能为你的项目增添无限可能。

通过“OpenAI官网”获取API Key(国外)

1、访问OpenAI官网

在浏览器中输入OpenAI官网的地址,进入官方网站主页。

https://www.openai.com

- 点击右上角的“Sign Up”进行注册,或选择“Login”登录已有账户。

- 完成相关的账户信息填写和验证,确保账户的安全性。

登录后,导航至“API Keys”部分,通常位于用户中心或设置页面中。

2、生成API Key

- 在API Keys页面,点击“Create new key”按钮。

- 按照提示完成API Key的创建过程,并将生成的Key妥善保存在安全的地方,避免泄露。🔒

3、使用 OpenAI API代码

现在你已经拥有了 API Key 并完成了充值,接下来是如何在你的项目中使用 GPT-4.0 API。以下是一个简单的 Python 示例,展示如何调用 API 生成文本:

import openai

import os# 设置 API Key

openai.api_key = os.getenv("OPENAI_API_KEY")# 调用 GPT-4.0 API

response = openai.Completion.create(model="gpt-4.0-turbo",prompt="鲁迅与周树人的关系。",max_tokens=100

)# 打印响应内容

print(response.choices[0].text.strip())

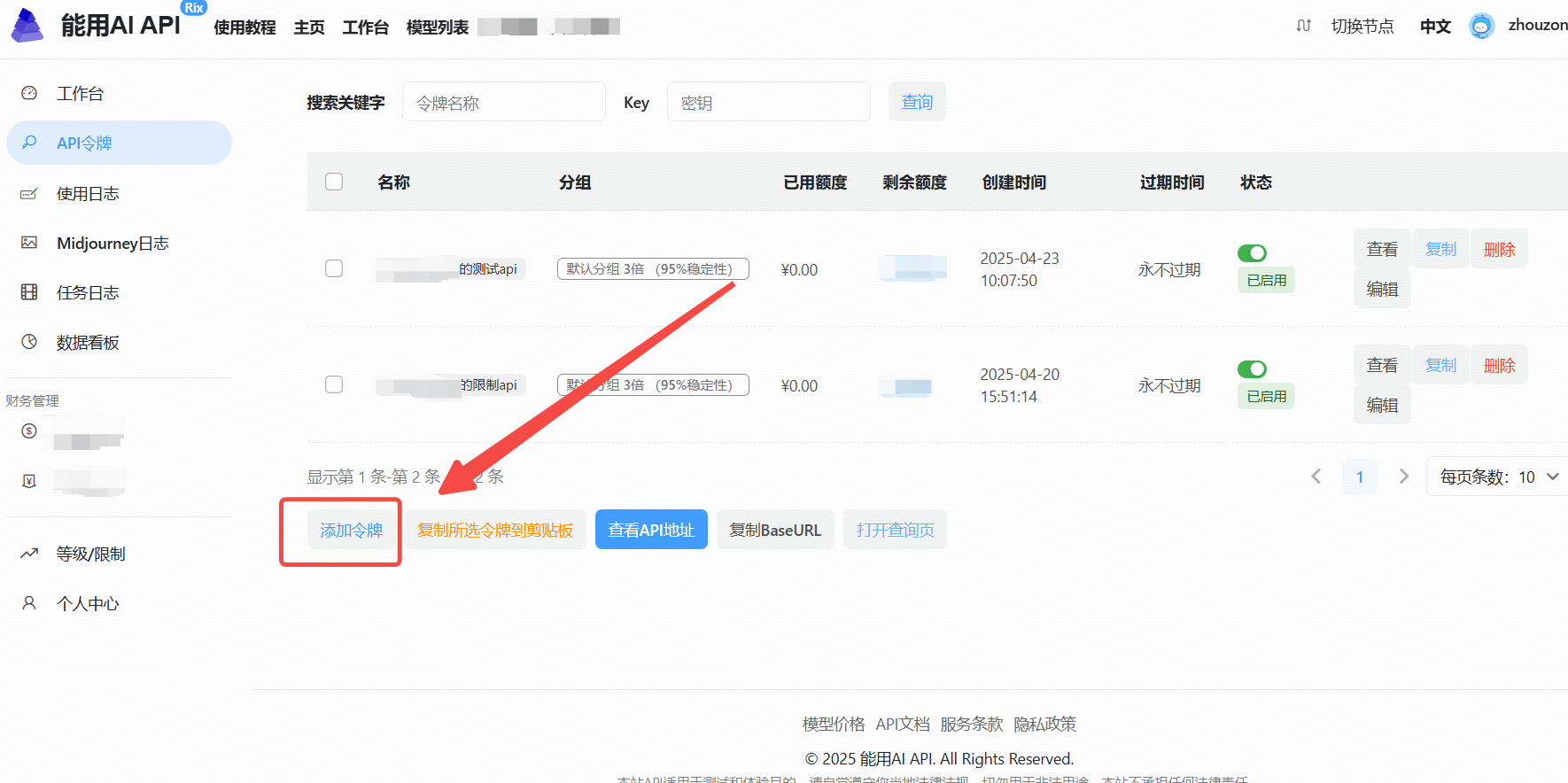

通过“能用AI”获取API Key(国内)

针对国内用户,由于部分海外服务访问限制,可以通过国内平台“能用AI”获取API Key。

1、访问能用AI工具

在浏览器中打开能用AI进入主页

https://ai.nengyongai.cn/register?aff=PEeJ

登录后,导航至API管理页面。

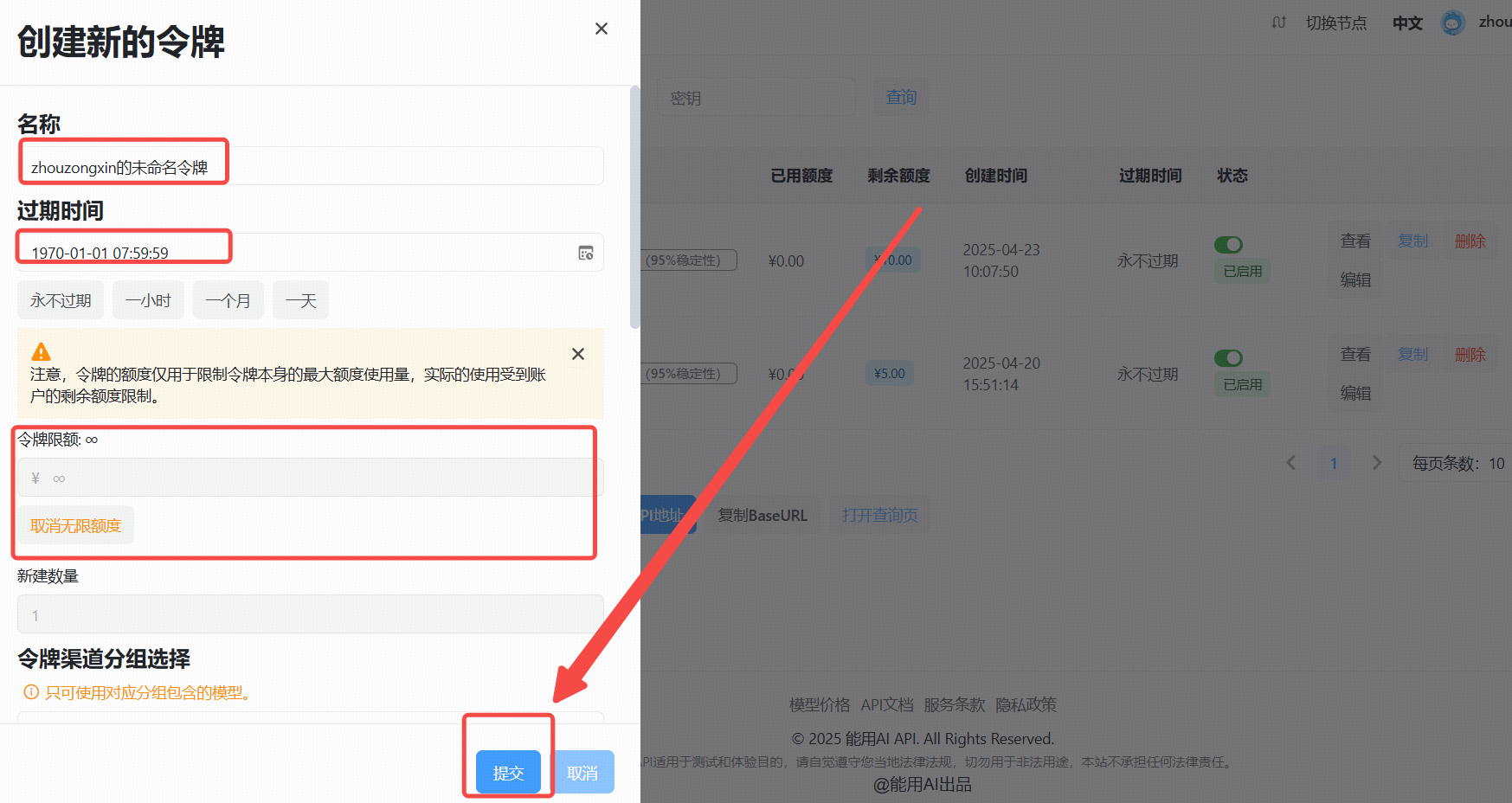

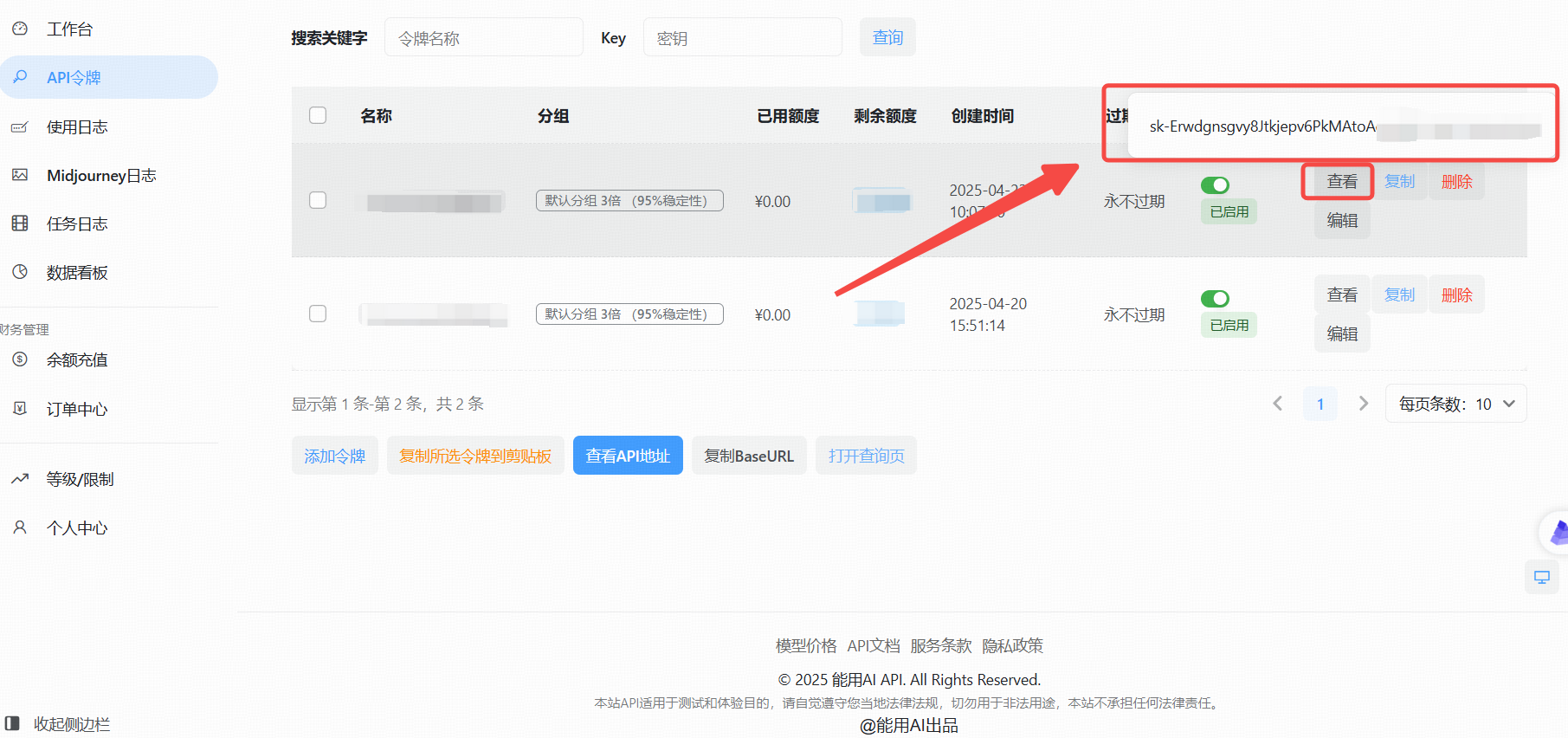

2、生成API Key

- 点击“添加令牌”按钮。

- 创建成功后,点击“查看KEY”按钮,获取你的API Key。

###/3、使用OpenAI API的实战教程

拥有了API Key后,接下来就是如何在你的项目中调用OpenAI API了。以下以Python为例,详细展示如何进行调用。

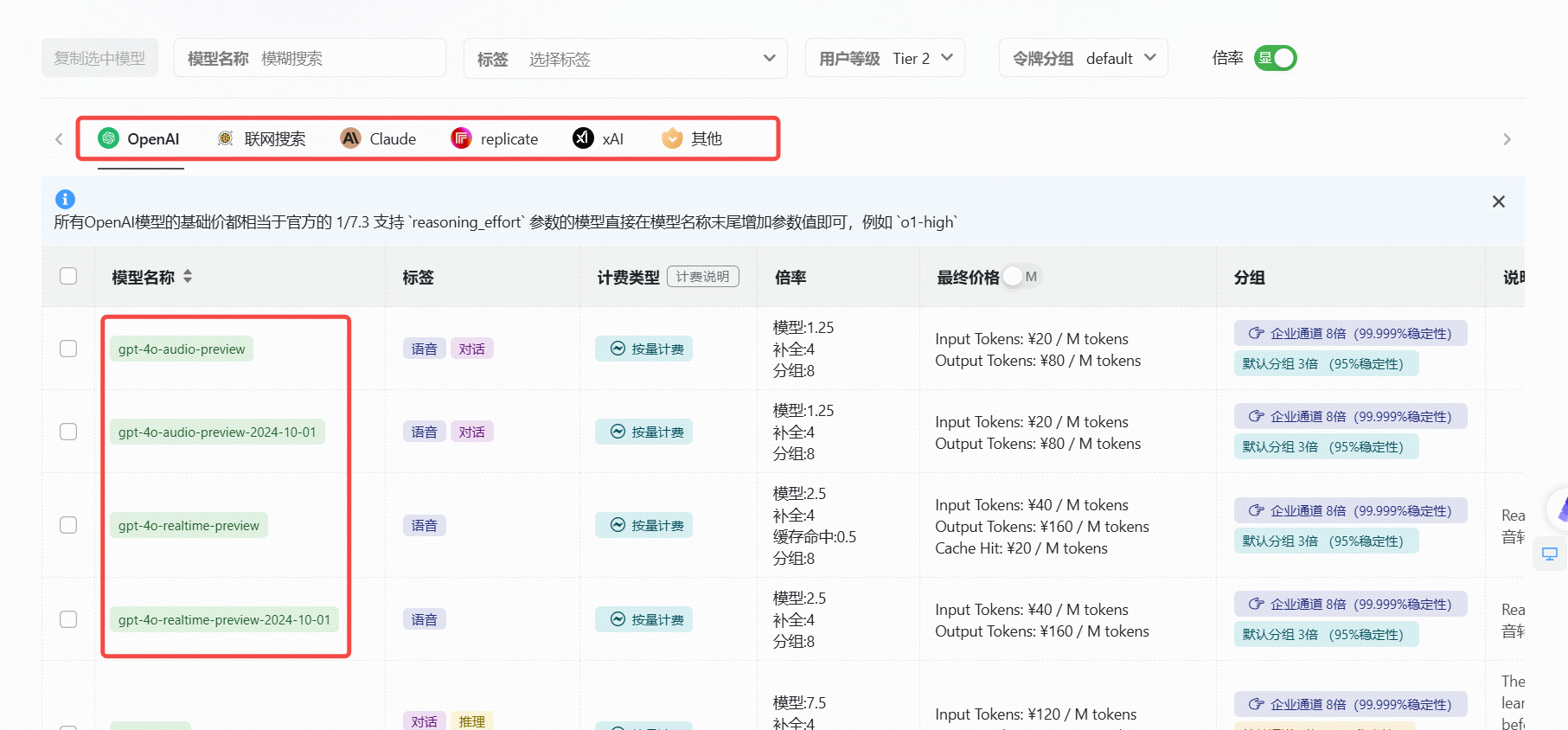

(1).可以调用的模型

gpt-3.5-turbo

gpt-3.5-turbo-1106

gpt-3.5-turbo-0125

gpt-3.5-16K

gpt-4

gpt-4-1106-preview

gpt-4-0125-preview

gpt-4-1106-vision-preview

gpt-4-turbo-2024-04-09

gpt-4o-2024-05-13

gpt-4-32K

claude-2

claude-3-opus-20240229

claude-3-sonnet-20240229

(2).Python示例代码(基础)

基本使用:直接调用,没有设置系统提示词的代码

from openai import OpenAI

client = OpenAI(api_key="这里是能用AI的api_key",base_url="https://ai.nengyongai.cn/v1"

)response = client.chat.completions.create(messages=[# 把用户提示词传进来content{'role': 'user', 'content': "鲁迅为什么打周树人?"},],model='gpt-4', # 上面写了可以调用的模型stream=True # 一定要设置True

)for chunk in response:print(chunk.choices[0].delta.content, end="", flush=True)

在这里插入代码片

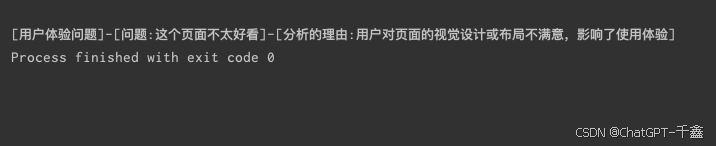

(3).Python示例代码(高阶)

进阶代码:根据用户反馈的问题,用GPT进行问题分类

from openai import OpenAI# 创建OpenAI客户端

client = OpenAI(api_key="your_api_key", # 你自己创建创建的Keybase_url="https://ai.nengyongai.cn/v1"

)def api(content):print()# 这里是系统提示词sysContent = f"请对下面的内容进行分类,并且描述出对应分类的理由。你只需要根据用户的内容输出下面几种类型:bug类型,用户体验问题,用户吐槽." \f"输出格式:[类型]-[问题:{content}]-[分析的理由]"response = client.chat.completions.create(messages=[# 把系统提示词传进来sysContent{'role': 'system', 'content': sysContent},# 把用户提示词传进来content{'role': 'user', 'content': content},],# 这是模型model='gpt-4', # 上面写了可以调用的模型stream=True)for chunk in response:print(chunk.choices[0].delta.content, end="", flush=True)if __name__ == '__main__':content = "这个页面不太好看"api(content)

通过这段代码,你可以轻松地与OpenAI GPT-4.0模型进行交互,获取所需的文本内容。✨

更多文章

【IDER、PyCharm】免费AI编程工具完整教程:ChatGPT Free - Support Key call AI GPT-o1 Claude3.5

【VScode】VSCode中的智能编程利器,全面揭秘ChatMoss & ChatGPT中文版