MM-2025 | 北航双无人机协作助力视觉语言导航!AeroDuo:基于空中双机系统的无人机视觉语言导航

- 作者:Ruipu Wu1^{1}1, Yige Zhang1^{1}1, Jinyu Chen1^{1}1, Linjiang Huang1^{1}1, Shifeng Zhang2^{2}2, Xu Zhou2^{2}2, Liang Wang3^{3}3, Si Liu1^{1}1

- 单位:1^{1}1北航,2^{2}2深信服,3^{3}3中科院自动化所

- 论文标题:AeroDuo: Aerial Duo for UAV-based Vision and Language Navigation

- 论文链接:https://arxiv.org/abs/2508.15232v1

主要贡献

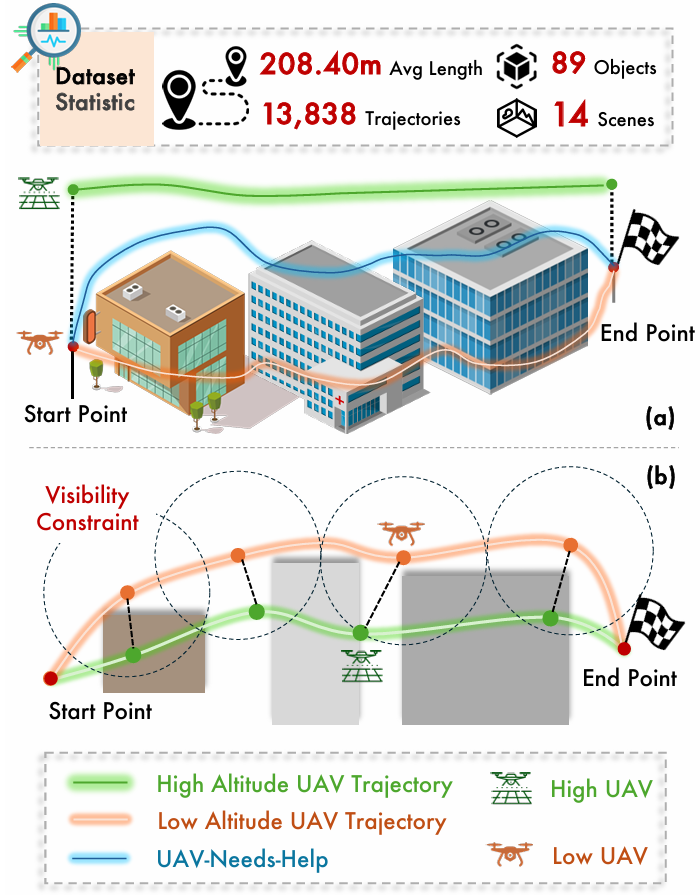

- 提出了新的无人机视觉语言导航任务——双高度无人机协作视觉语言导航(DuAl-VLN),通过双无人机协作来解决单无人机在复杂环境下的导航挑战,为无人机视觉语言导航领域提供了新的思路和方向。

- 构建了HaL-13k数据集,包含13838条协同的高低无人机演示轨迹,以及目标导向的语言指令,为该任务的研究提供了丰富的数据支持,有助于推动相关算法的发展。

- 提出了AeroDuo框架,其中高海拔无人机集成了多模态大型语言模型(Pilot-LLM)用于目标推理,低海拔无人机采用轻量级多阶段策略用于导航和目标定位,通过高效的协作机制,实现了显著优于单无人机方法的导航成功率,为无人机在复杂环境下的自主导航提供了一种有效的解决方案。

研究背景

- 视觉语言导航(VLN)任务旨在使自主智能体能够基于自然语言指令进行导航,近年来受到广泛关注。然而,与地面智能体相比,无人机(UAV)的VLN任务更具挑战性,因为无人机的导航轨迹更长,运动自由度更高,现有的方法往往依赖于迭代的人机对话、详细的路线描述或实时的人工协助,限制了操作效率。

- 为了充分发挥无人机的高机动性优势,同时保持学习的可管理性,本文提出了双高度无人机协作视觉语言导航(DuAl-VLN)任务,通过高低两架无人机的协作,利用它们各自的优势来实现更高效的导航。

双高度无人机协作视觉语言导航

任务定义

- 任务目标:在每个导航任务开始时,低海拔无人机(UlU_lUl)和高海拔无人机(UhU_hUh)分别初始化在不同的位置,但水平坐标相同,高海拔无人机的初始高度更高。系统接收一个目标导向的语言指令,描述目标的方向、特征以及周围环境的上下文。任务的目标是让低海拔无人机在一定时间内到达目标位置,同时避免与障碍物发生碰撞。

- 时间步长差异:低海拔无人机和高海拔无人机的决策时间步长分别为 t 和 τ,且 τ > t,这反映了两者在推理频率上的差异。

- 多模态输入与轨迹调整:在每个时间步长,低海拔无人机捕获前视视觉图像和全方位点云数据,高海拔无人机捕获鸟瞰图观察和激光雷达点云图。基于这些多模态输入,无人机通过预测后续航点序列或速度剖面来动态调整飞行轨迹。

- 成功与失败判定:如果低海拔无人机在距离目标位置 d 的范围内停止,则认为导航任务成功;如果低海拔无人机在超出导航时间上限之前未到达目标,或者无人机与障碍物发生碰撞,则认为导航任务失败。

HaL-13k 数据集

为了推进双高度无人机协作视觉语言导航(DuAl-VLN)任务的研究,论文基于 OpenUAV 平台构建了 HaL-13k 数据集,该数据集提供了真实的无人机传感器数据、多样化的环境以及动态的飞行特性,为研究提供了丰富的数据支持。

数据集特点

- 轨迹对生成:数据集包含 13838 对同步的双高度轨迹,每对轨迹都标注有目标导向的语言指令,用于搜索目标,而无需详细的路线描述或实时人工协助。

- 低海拔无人机路径规划:首先从点云构建占用图,然后使用 A* 算法计算符合占用约束的优化导航路径。

- 高海拔无人机路径采样:随机采样飞行路径,确保高海拔无人机对低海拔无人机的路线保持全程视觉覆盖,从而维持最佳的观测视角。

验证集划分

为了严格评估模型对新环境和不熟悉目标的泛化能力,论文将验证集划分为未见地图集和未见目标集。

- 未见地图集:包含未出现在训练数据中的环境,从这些环境中提取所有相关轨迹进行测试,共得到 175 个测试场景。

- 未见目标集:包含来自训练熟悉的场景的轨迹,但在测试时引入了训练期间从未遇到过的物体类别,产生 175 个测试场景。

AeroDuo

AeroDuo 概述

AeroDuo 是一个双高度无人机协作视觉语言导航(VLN)框架,旨在通过高海拔无人机和低海拔无人机的协作,提高无人机在复杂环境中的导航成功率和效率。

- 框架组成:

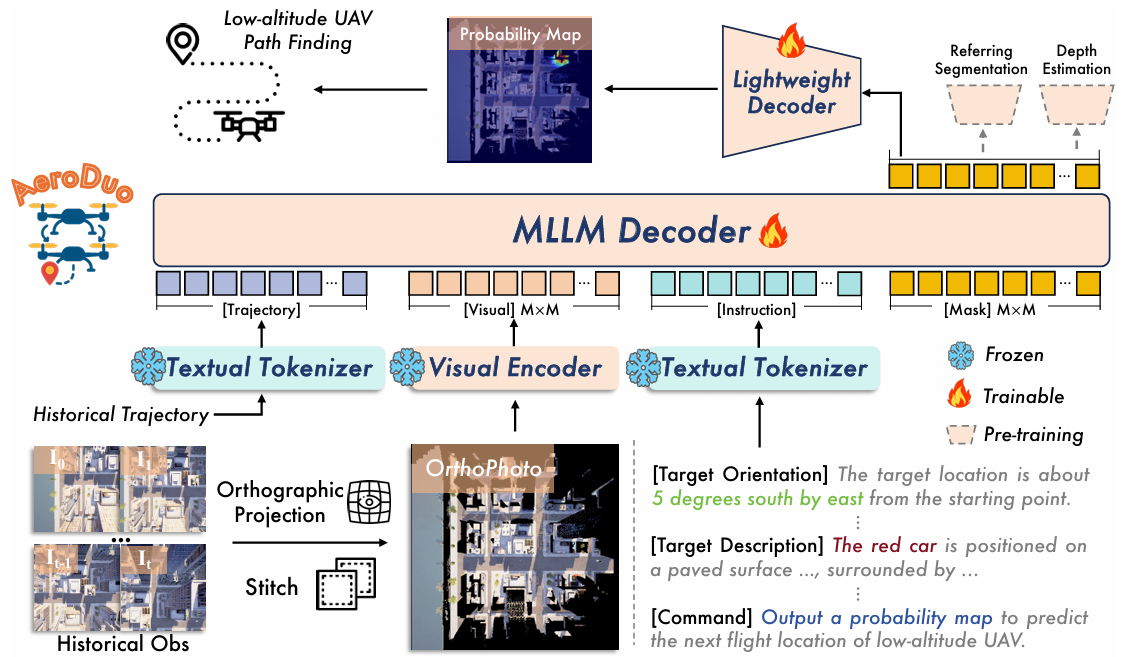

- 高海拔无人机(UhU_hUh):配备 Pilot-LLM(多模态大型语言模型),负责处理全局信息,预测目标位置的概率分布图,并生成环境深度信息。

- 低海拔无人机(UlU_lUl):采用 Multi-Stage Pathfinder(MSP),基于高海拔无人机提供的信息进行环境探索和目标定位。

- 协作流程:

- 高海拔无人机在每个时间步长 τ 接收到低海拔无人机的探索请求后,启动决策阶段。

- 高海拔无人机通过 Pilot-LLM 预测目标位置的概率分布图 MτM_\tauMτ 和环境深度信息 D^hτ\hat{D}_h^\tauD^hτ,并将这些信息传输给低海拔无人机。

- 低海拔无人机利用 MτM_\tauMτ 和 D^hτ\hat{D}_h^\tauD^hτ 进行环境探索,通过 MSP 完成导航任务。

- 低海拔无人机在完成探索后,请求高海拔无人机提供新的目标信息,继续导航过程。

高海拔无人机的 Pilot-LLM

全局地图构建

高海拔无人机的鸟瞰图观察需要整合到一个全局地图中,以提供统一的空间坐标系统和历史观测的全局视角。

- 从累积的点云 Vh1:τV_h^{1:\tau}Vh1:τ 重建地面环境的高程图。

- 使用无人机的轨迹 phτp_h^\tauphτ 估计机载 RGB 相机的外参,并将鸟瞰图观察 Ih1:τI_h^{1:\tau}Ih1:τ 重新投影到地面平面。

- 将重新投影的视图拼接在一起,生成全局正射影像地图 GτG_\tauGτ。

- 同时,计算全局深度图 D^hτ\hat{D}_h^\tauD^hτ。

Gτ,D^hτ=ortho(Ih1:τ,ph1:τ,Vh) G_\tau, \hat{D}_h^\tau = \text{ortho}(I_h^{1:\tau}, p_h^{1:\tau}, V_h) Gτ,D^hτ=ortho(Ih1:τ,ph1:τ,Vh)

Pilot-LLM 模型

- 输入:

- 全局正射影像地图 GτG_\tauGτ:通过视觉编码器 fvf_vfv 转换为视觉令牌 G~τ\tilde{G}_\tauG~τ。

- 历史轨迹 ph1:τp_h^{1:\tau}ph1:τ:投影到 GτG_\tauGτ 的坐标系中,生成轨迹嵌入 XpτX_p^\tauXpτ。

- 导航指令 XXX:通过 LLM 的文本编码器生成嵌入 X~\tilde{X}X~。

- 输出:目标位置的概率分布图 MτM_\tauMτ。

- 方法:

- 使用特殊可学习令牌 MMM 来预测目标位置的概率分布图,而不是直接预测目标位置的精确坐标。

- 每个令牌对应正射影像地图中的一个独特空间坐标。

- 通过轻量级掩码解码器 fmf_mfm 解码特征 M~τ\tilde{M}_\tauM~τ,生成目标位置的概率分布图:

Mτ=sigmoid(fm(M~τ)) M_\tau = \text{sigmoid}(f_m(\tilde{M}_\tau)) Mτ=sigmoid(fm(M~τ))

- 优势:

- 目标位置应表示为一个可行区域,而不是单个坐标点,保留了无人机的探索能力。

- 通过预测地图,可以增强 Pilot-LLM 的空间建模能力,通过引入辅助任务(如指代分割和深度估计)来进一步提升性能。

低海拔无人机的多阶段寻路

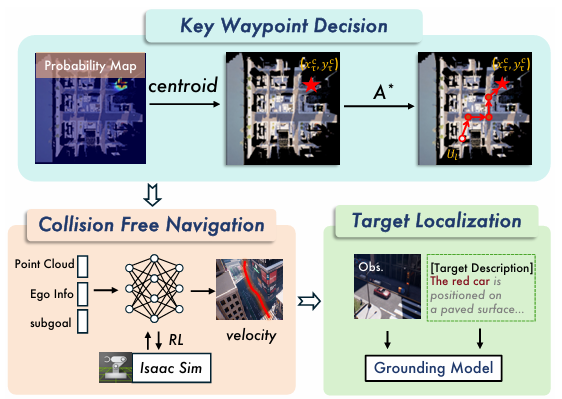

关键航点决策

低海拔无人机根据高海拔无人机提供的目标位置概率分布图 MτM_\tauMτ 确定子目标。

- 计算概率分布图的质心,以减少异常值带来的误差:

[xcτ,ycτ]=∑i∑jMτ(i,j)⋅[i,j]∑i∑jMτ(i,j) [x_c^\tau, y_c^\tau] = \frac{\sum_i \sum_j M_\tau(i,j) \cdot [i, j]}{\sum_i \sum_j M_\tau(i,j)} [xcτ,ycτ]=∑i∑jMτ(i,j)∑i∑jMτ(i,j)⋅[i,j] - 将质心坐标转换为全局坐标系中的预测终点 [x^cτ,y^cτ,zlt][\hat{x}_c^\tau, \hat{y}_c^\tau, z_l^t][x^cτ,y^cτ,zlt]。

- 基于全局深度图 D^hτ\hat{D}_h^\tauD^hτ 构建占用图 occτ\text{occ}_\tauoccτ,并使用 A* 算法优化导航路径,生成关键航点序列 QτQ_\tauQτ。

occτ=u(D^hτ−Δzτ) \text{occ}_\tau = u(\hat{D}_h^\tau - \Delta z_\tau) occτ=u(D^hτ−Δzτ)

其中,Δzτ\Delta z_\tauΔzτ 表示高海拔和低海拔无人机之间的高度差,u(⋅)u(\cdot)u(⋅) 是单位阶跃函数。

无碰撞导航

仅依赖于计算出的关键航点可能导致碰撞。

- 使用基于强化学习的无碰撞导航器,接收点云数据 VtlV_t^lVtl、子目标 pkτp_k^\taupkτ 和自身状态信息(当前位置 ptlp_t^lptl 和当前速度 vtlv_t^lvtl)。

- 采用 3D 射线投射策略对点云数据进行编码,然后输入多层感知机(MLP)预测后续速度 vt+1lv_{t+1}^lvt+1l。

- 使用 PPO 算法进行训练,奖励函数包括障碍物回避、速度波动惩罚和减少到目标距离的激励。

- 使用 Isaac Sim 作为训练模拟器,加速训练过程。

目标定位

- 在沿关键航点序列导航过程中,低海拔无人机持续使用 GroundingDINO 检测目标,一旦检测到目标即终止探索。

- 如果目标检测的置信度超过预设阈值,则认为目标已成功定位。

Pilot-LLM 训练过程

预训练阶段

增强 Pilot-LLM 的视觉和地理空间建模能力。

- 在 RefCOCO 数据集上进行指代分割和深度估计训练,提升模型的视觉感知能力。

- 使用 Depth Anything v2 生成深度图用于训练。

- 在 BEV 图像上进行指代分割训练,生成 850,894 个图像-文本对,以增强模型对 BEV 图像的理解能力。

- 进行深度估计训练,提升模型的空间推理能力。

微调阶段

进一步训练 Pilot-LLM 基于语言指令定位探索区域。

- 初始化掩码解码器的参数为预训练阶段中分割解码器的参数。

- 采样高海拔和低海拔无人机的航点对,以生成训练的真值标签。

- 对于低海拔无人机,使用未来时间步长 t+kt+kt+k 的位置作为目标,生成高斯分布的概率分布图,并应用占用掩码抑制不可行区域,最后对概率分布图进行归一化处理。

- 对于高海拔无人机,目标是预测其航向和步长,采用类似的方法生成真值标签。

实验

实验设置

框架实现细节

- Pilot-LLM:基于 Qwen2-VL 的视觉投影器和 LLM 主干构建,掩码预测头由两个线性层和两个上采样层组成,用于扩展输出分辨率。

- 优化器:使用 AdamW 优化器,学习率调度器为余弦调度器,初始学习率为 (5 \times 10^{-5})。

- 训练策略:在训练过程中,冻结视觉投影器,使用低秩适应(LoRA)对 MLLM 进行微调。掩码和深度预测任务分别使用二元交叉熵损失和均方误差损失进行优化。

- 低海拔无人机控制频率:低海拔无人机的操作频率为 10Hz,每个时间步长为 0.1 秒。

评估指标

- SR(成功率):测量 UAV 在目标 20 米半径范围内成功停止的任务百分比。

- SPL(路径长度加权成功率):结合任务成功与路径效率,通过低海拔 UAV 的实际路径长度与最优路径长度的比值乘以成功率来计算。

- SST(搜索时间加权成功率):测量导航时间效率,计算公式为 SST=S×(T∗max(T,T∗))\text{SST} = S \times \left(\frac{T^*}{\max(T, T^*)}\right)SST=S×(max(T,T∗)T∗),其中 TTT 为目标搜索模拟时间,T∗T^*T∗ 为真实轨迹的导航时间。

- OSR(Oracle 成功率):测量 UAV 是否沿着轨迹到达目标 20 米半径范围内,即使它没有在最终目的地停下来。

- NE(导航误差):测量停止位置与目标位置之间的距离。

- 主要评估指标:SST 和 SR。

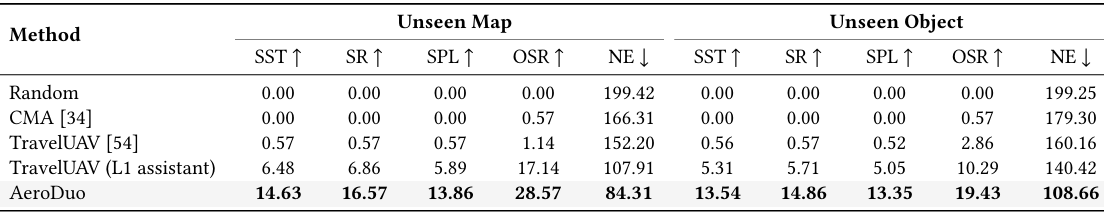

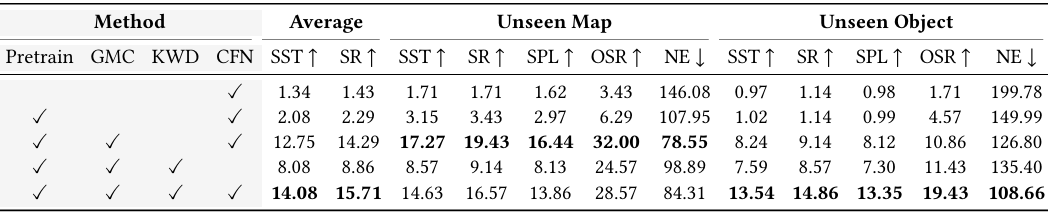

主要对比

比较基线

- Random:UAV 随机选择四个可能方向中的一个动作:前进、左转、右转、上升或下降。

- CMA(Cross-Modal Attention):AerialVLN 中提出的导航模型,使用双向 LSTM 同时处理视觉输入和指令理解,预测接下来的五个航点用于导航。

- TravelUAV:基于 LLM 的 UAV 导航模型,LLM 预测长期航点,而 LSTM 模型填充中间航点。

- TravelUAV (L1 Assistant):TravelUAV 的改进版本,增加了 L1 级助手,提供基于真实轨迹的指导。在每一步中,助手通过比较 UAV 的位置和方向与真实轨迹,帮助预测下一个动作,确保 UAV 保持在正确的路径上。

实验结果

- 单 UAV 方法的局限性:现有的单 UAV 方法(如 CMA 和 TravelUAV)在真实飞行条件下的目标导向 VLN 任务中成功率较低,经常无法到达目标区域,这突显了它们在空间场景理解和真实世界障碍物回避方面的局限性。

- AeroDuo 的优势:AeroDuo 在所有评估指标上均显著优于这些单 UAV 方法,在未见地图和未见目标的验证集上分别达到了 16.57% 和 14.86% 的成功率,以及 14.63% 和 13.54% 的搜索时间加权成功率,证明了双高度无人机协作在复杂真实世界环境中的优势,标志着仅使用目标描述指令的实用 UAV-VLN 系统向前迈进了一大步。

消融研究

- MLLM 预训练:预训练阶段显著提升了 Pilot-LLM 的性能,使其能够更好地理解 BEV 图像和语言指令。

- 全局地图构建(GMC):通过整合历史观测构建全局地图,显著提高了目标位置预测的准确性。

- 关键航点决策(KWD):通过计算目标概率分布的质心来确定子目标,有效减少了异常值带来的误差,提高了导航的可靠性。

- 无碰撞导航(CFN):基于强化学习的无碰撞导航器显著提高了低海拔无人机在复杂环境中的导航安全性。

- 综合效果:结合所有这些技术,AeroDuo 在未见地图和未见目标的验证集上分别达到了 14.63% 和 13.54% 的搜索时间加权成功率,以及 16.57% 和 14.86% 的成功率,证明了这些技术在提高导航性能方面的协同效应。

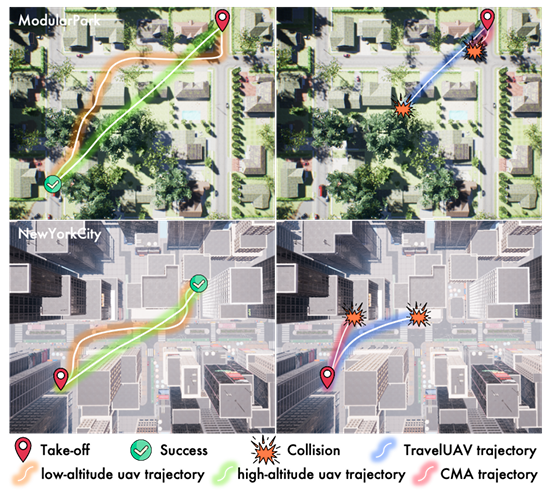

定性分析

- 轨迹可视化:

- AeroDuo 的优势:与单 UAV 基线方法(如 CMA 和 TravelUAV)相比,AeroDuo 能够更准确地定位目标区域,并在较长的时间范围内规划飞行路径,同时避免碰撞。

- 碰撞问题:CMA 和 TravelUAV 方法在搜索过程中都出现了碰撞,导致大多数任务失败。

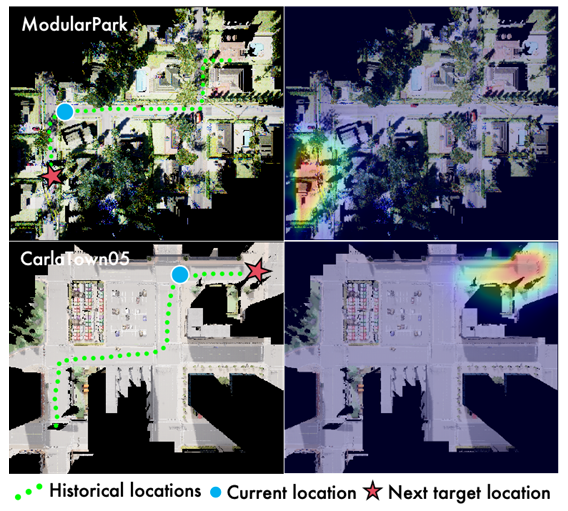

- 目标概率图预测:

- AeroDuo 的能力:AeroDuo 能够根据提供的指令有效识别目的地,这突显了该方法在从正射影像地图中解释环境以及将观测结果与复杂环境对齐方面的强大能力。

- 可视化示例:展示了 AeroDuo 预测的目标概率图,证明了其在复杂环境中的导航能力。

结论与未来工作

- 结论:

- 本文提出的双高度无人机协作视觉语言导航任务(DuAl-VLN)以及AeroDuo框架,在无人机视觉语言导航领域取得了显著的成果。

- 通过高低无人机的协作,有效提高了导航的成功率和效率,为无人机在复杂环境下的自主导航提供了一种新的方法。

- 未来工作:

- 未来的工作将集中在优化执行效率和进一步提高模型的泛化能力等方面,以推动无人机视觉语言导航技术的发展和应用。