嵌入式与机器视觉的交叉点:构建智能化设备的实时视频通路

引言:智能化时代的技术交叉

人工智能正以前所未有的速度渗透进人类社会:从火车站刷脸进站的便捷体验,到智能语音伴护机器人带来的情感陪伴,再到辅助驾驶与无人驾驶逐渐成为现实,人们对智能化的接受度与依赖度日益提高。支撑这些场景的并非单一技术,而是多个学科与领域的交叉与融合:嵌入式控制系统保证设备能稳定运转,机器视觉让机器能够“看懂世界”,深度学习与计算机视觉模型赋予其理解与推理能力,ROS 操作系统与边缘 AI则让分布式的感知与决策能够快速落地。

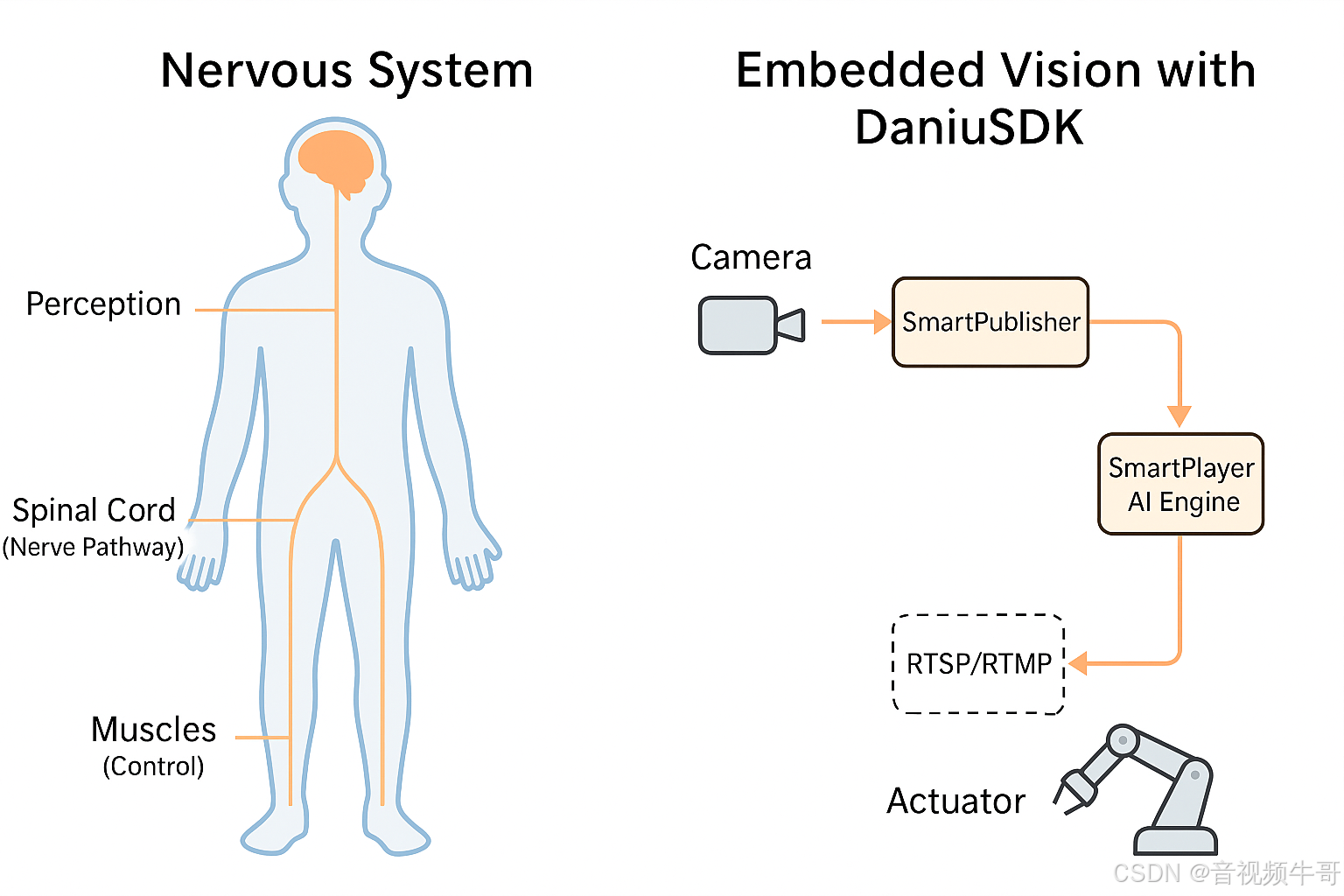

如果把一个智能系统比作一个有机体,嵌入式系统就是“骨骼与肌肉”,驱动执行器完成精确的动作控制;机器视觉是“眼睛与大脑”,从视频和图像中提取环境信息并做出决策。但这两者之间仍然需要一条稳定、快速、低延迟的“神经系统”,来保证感知与执行能够实时闭环。

这正是大牛直播 SDK的价值所在:它为嵌入式系统与机器视觉之间提供了毫秒级低延迟的音视频链路。无论是无人机的避障飞行、智慧交通的实时监控,还是工业机器人对传送带物品的精准分拣,大牛直播 SDK 都是将“眼睛与大脑”和“骨骼与肌肉”高效连接起来的神经中枢基座,让智能系统真正具备感知—传输—决策—控制的全链路闭环能力。

二、嵌入式与机器视觉:智能系统的双核心

在智能系统的设计中,嵌入式系统与机器视觉是两大不可或缺的支柱。

-

嵌入式系统的使命,是把数字世界的计算能力与物理世界的执行控制结合起来。它就像人体的“骨骼与肌肉”,通过电机、传感器、执行器的协同,让设备能够按照预定逻辑稳定运行。嵌入式开发者需要精通 RTOS/Linux 调度、驱动开发、硬件接口协议(GPIO/I²C/SPI)、低功耗优化 等能力,从而保证设备的长时间稳定工作。

-

机器视觉则为系统打开了“感知之眼”。它的核心是从海量图像与视频数据中提取出有价值的信息,识别目标、测量尺寸、检测缺陷或执行场景理解。无论是传统的 图像处理与模式识别,还是当下火热的 深度学习模型(CNN、Transformer、YOLO 系列),都是让机器具备环境感知能力的关键。

两者看似分工不同,但在实际应用中往往相辅相成:没有嵌入式系统的支撑,视觉算法只能停留在“实验室推理”;没有机器视觉的输入,嵌入式设备就无法做出智能决策。真正的智能化设备,必须是二者的深度融合。

三、嵌入式视觉的交叉点:大牛直播SDK的作用

随着物联网与边缘计算的发展,嵌入式视觉(Embedded Vision) 成为了嵌入式与机器视觉的关键交汇点。它要求设备不仅能“看得见”,还要“看得快”,并能即时把感知转化为动作。

在这一链路中,除了嵌入式系统和视觉算法外,还必须有一条低延迟、高可靠的视频传输通道,作为“神经系统”将“眼睛”和“肌肉”紧密连接。

大牛直播SDK(DaniuSDK)正是这一环节的核心基座:

Android平台RTMP直播播放器延迟测试

-

实时数据采集与推流

借助 SmartPublisher 模块,嵌入式相机或传感器捕获的原始视频流,可以在本地设备上被高效编码(H.264/H.265),并通过 RTSP/RTMP 协议实时推送出去。其延迟可稳定控制在 100–200 ms,为嵌入式视觉提供了真正可用的“毫秒级传感通路”。

安卓轻量级RTSP服务采集摄像头,PC端到安卓拉取RTSP流

-

低延迟播放与监控

SmartPlayer 模块能够在嵌入式终端、手机、PC 甚至 Unity3D 环境中快速拉流,实现毫秒级的首屏秒开与实时画面展示。对于无人机避障、远程机器人操控、工业巡检等场景,这意味着控制端能“所见即所得”。

Android平台Unity3D下RTMP播放器延迟测试

-

边缘协同与轻量服务

SDK 内置的 SmartRTSPServer 与 SmartRTSPGateway,让嵌入式设备本身也能成为“轻量级流媒体服务节点”。这意味着前端摄像头不仅能本地推流,还能直接在边缘节点完成转发、分发,甚至无缝对接到 GB28181 国标平台,提升了系统级集成度。 -

与 AI 模型的接口融合

SDK 提供 音视频数据回调接口,支持开发者把实时流直接接入 TensorFlow Lite、ONNX Runtime、YOLO 系列模型等 AI 推理框架。通过 GPU/NPU 的加速,视觉算法可以直接运行在 Jetson Nano、RK3588 等嵌入式硬件上,与大牛直播SDK的传输链路无缝结合,形成完整的 感知—传输—推理—控制闭环。

换句话说,大牛直播SDK并不只是一个“视频播放器”或“推流工具”,而是嵌入式视觉系统的神经网络基础设施:它打通了设备端与感知端的实时交互,使得从“摄像头采集”到“算法决策”再到“执行器动作”的链路真正实现可控、稳定、低延迟。

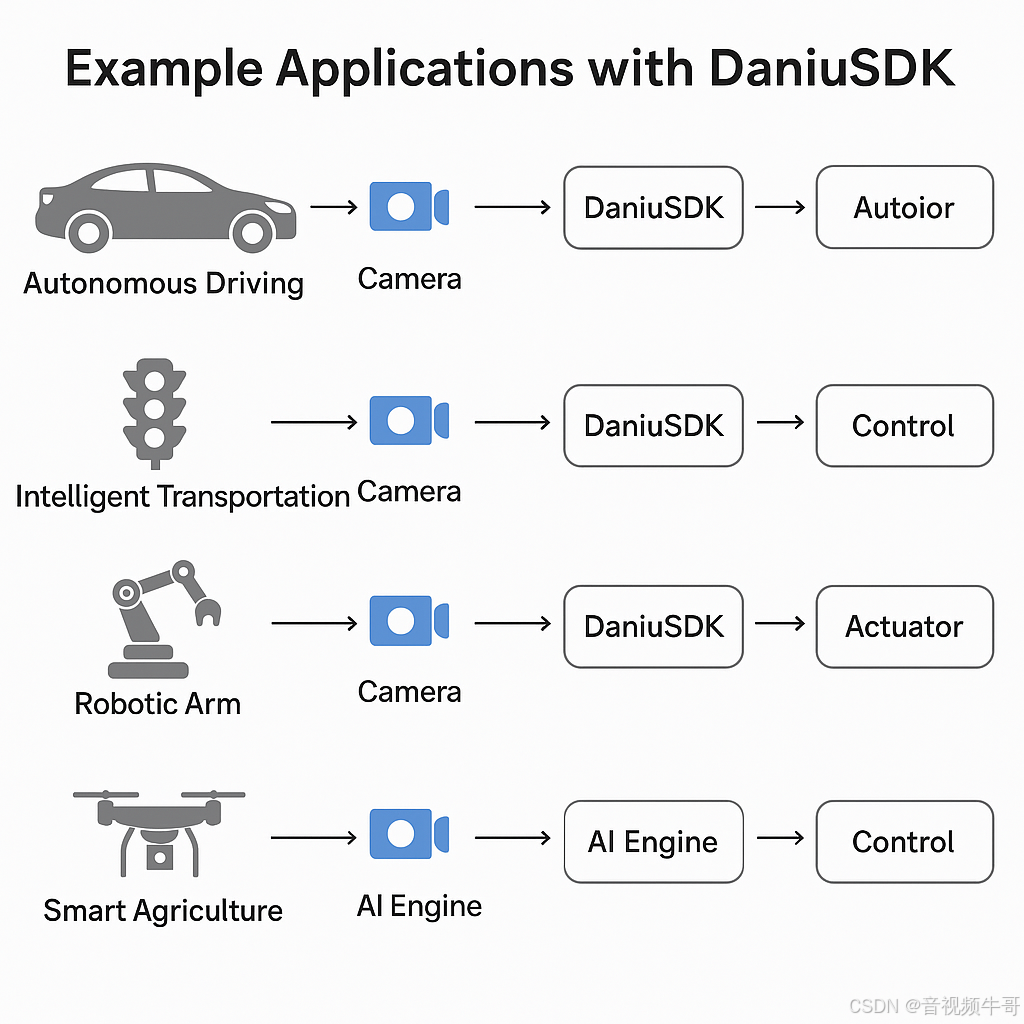

四、典型应用场景:从无人驾驶到智慧农业

嵌入式视觉并不是停留在实验室的概念,而是已经在各行各业中被广泛应用。而大牛直播SDK凭借毫秒级低延迟链路和跨平台的工程化能力,正在成为这些应用落地的关键技术之一。

1. 无人驾驶与辅助驾驶

在自动驾驶系统中,车载摄像头和激光雷达会实时采集环境信息。大牛直播SDK的 SmartPublisher 模块能将多路相机视频快速推流至车载计算平台或边缘服务器,供 视觉识别模型(如车道线检测、目标追踪)实时分析。延迟被压缩在 200ms 以内,保证车辆能在高速行驶中即时做出避障和转向决策。

2. 智慧交通

在智慧交通场景下,路口监控摄像头通过大牛直播SDK内置的 轻量级 RTSP 服务,将实时画面低延迟推送至边缘计算节点。算法可以第一时间识别车流量、行人过街行为和交通违规情况,并将结果传递给指挥平台或交管信号灯,形成“实时感知—即时调度”的闭环。

3. 工业机器人与智能制造

在生产线上,机械臂需要通过视觉系统识别传送带上的物体,并完成分拣、装配等操作。大牛直播SDK的 低延迟播放器(SmartPlayer) 可以将相机采集到的画面即时传回控制台,同时数据回调接口可接入 AI 缺陷检测模型,实现毫秒级的“发现缺陷—执行剔除”。这类场景对延迟极度敏感,SDK 的性能优势直接决定了系统是否能稳定运行。

4. 智慧农业与无人机作业

在农业领域,植保无人机通过大牛直播SDK将实时航拍画面推送至远程操作终端,AI 模型对作物长势、病虫害分布进行分析,并即时反馈喷洒策略。SDK 的跨平台能力保证了视频链路在移动端(iOS/Android)与桌面端(Windows/Linux)都能无缝查看,真正实现“在田间地头的实时智能决策”。

五、职业发展与实践建议

嵌入式与机器视觉的融合不仅推动了产业的升级,也为工程师提供了新的职业路径。结合大牛直播SDK的使用经验,可以给出以下几点建议:

-

关注前沿趋势

边缘 AI 与嵌入式视觉正成为大势所趋。工程师需要学习如何将 视觉模型轻量化(量化、剪枝、蒸馏),并高效部署到嵌入式平台。大牛直播SDK提供了实时数据回调接口,可以直接作为训练—推理—部署的桥梁。 -

明确发展定位

-

视觉算法工程师:需精通数学与深度学习算法,同时熟悉 SDK 提供的音视频接口,才能在真实系统中完成模型接入。

-

嵌入式工程师:需掌握底层驱动、RTOS/Linux 系统开发,同时理解视频链路,利用 SDK 的轻量 RTSP/RTMP 服务模块,实现端到端的数据传输。

-

嵌入式视觉工程师:二者兼备,能够基于大牛SDK构建从相机采集到执行控制的完整闭环,是最稀缺也最具前景的岗位方向。

-

-

打牢编程与系统基础

无论是 C/C++ 驱动开发,还是 Python 深度学习,都必须扎实掌握。SDK 的跨平台特性要求开发者能在不同语言和环境中自由切换。 -

注重实践与项目经验

从小型循迹小车、树莓派摄像头识别,到 Jetson Nano 上运行 YOLO 模型,再到 SDK 驱动的无人机避障、工业分拣机器人,只有通过不断的实战项目,才能真正把理论与 SDK 的能力结合,积累系统级的开发经验。

六、结语:嵌入式视觉与大牛直播SDK的未来

嵌入式与机器视觉的结合,正在让智能系统从“可用”走向“好用”。从无人驾驶到智慧交通,从工业机器人到智慧农业,几乎所有智能化设备都需要一条稳定、低延迟、跨平台的视频链路,去连接“眼睛”与“肌肉”,支撑感知—决策—执行的闭环。

大牛直播SDK凭借 全自研内核、毫秒级低延迟、跨平台覆盖、模块化架构,在这一链路中扮演了“神经系统”的关键角色。它不仅让开发者能够快速构建可靠的视频传输通道,更通过 SmartPublisher、SmartPlayer、SmartRTSPServer、SmartRTSPGateway、GB28181 接入 等模块,为嵌入式视觉系统提供了可组合、可扩展的技术基座。

未来,随着 边缘 AI、5G/6G 通信、H.266/AV1 编解码 技术的成熟,嵌入式视觉将进一步向“小型化、低功耗、高智能”演进。大牛直播SDK也将在这个过程中不断进化,从实时传输的工具,成长为 智能感知与实时决策的基础设施,帮助开发者打造更加智能、高效、可信赖的下一代嵌入式系统。

📎 CSDN官方博客:音视频牛哥-CSDN博客