机器学习—线性回归

一·线性回归

线性回归是利用数理统计中回归分析,来确定两种或两种以上变量间相互依赖的定量关系的一种统计分析方法。

相关关系:包含因果关系和平行关系

因果关系:回归分析【原因引起结果,需要明确自变量和因变量】

平行关系:相关分析【无因果关系,不区分自变量和因变量】

二·一元线性回归模型理论

一元线性回归模型表达式为:y=β0+β1x+ε

其中:

0.

为模型参数,用于刻画自变量 x 与因变量 y 线性关系的截距和斜率 。

为误差项,代表除线性因素外,由随机因素导致的误差 。

| 工资(x) | 贷款额度(y) |

|---|---|

| 4000 | 10000 |

| 8000 | 12000 |

| 5000 | 8000 |

| 3000 | 10000 |

| 6000 | 15000 |

| 7000 | ? |

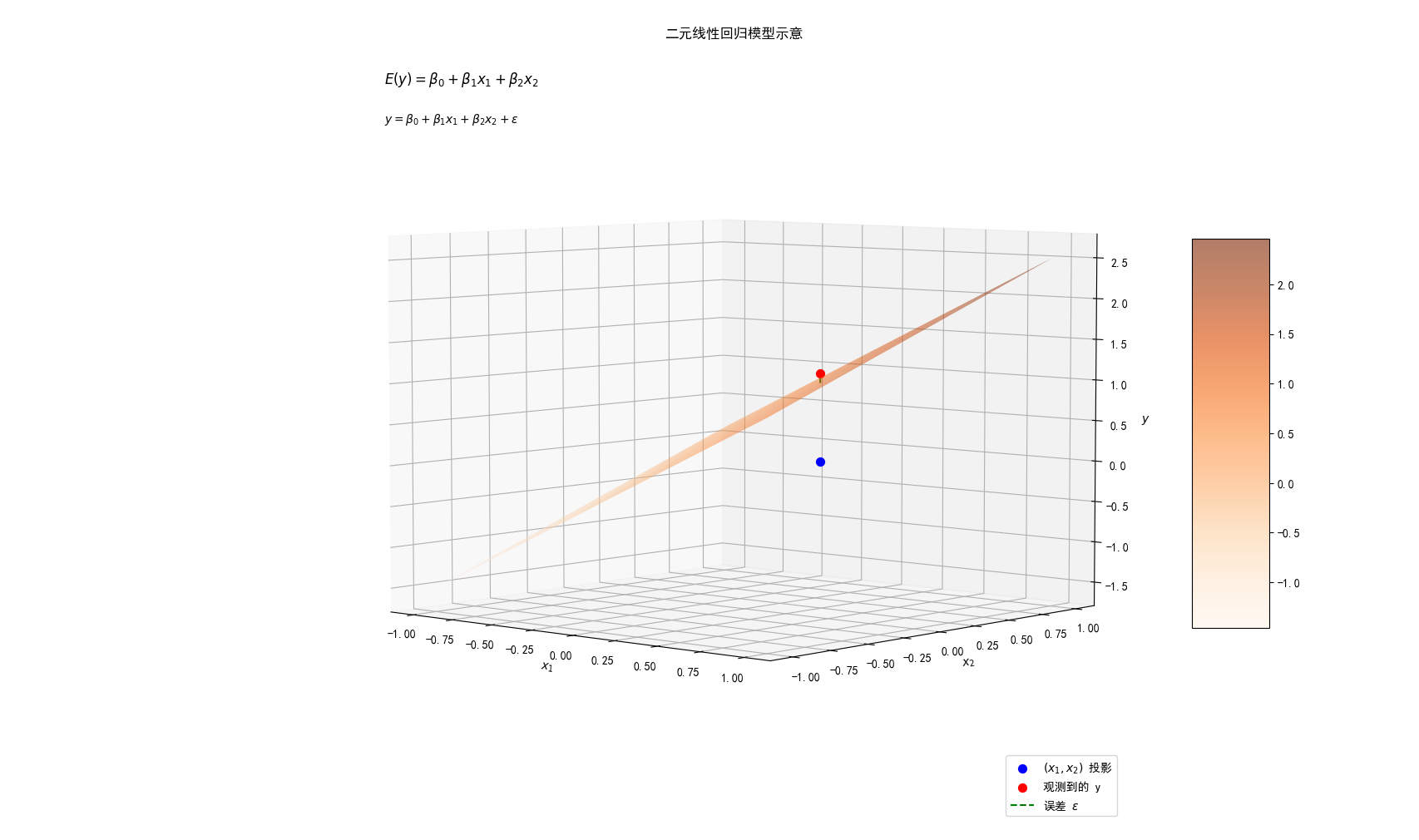

三·多元线性回归模型

多元线性回归模型:

y=β0+β1x1+β2x2+ε

其中:

β0·β1·β2是模型参数。

是误差项。

误差项:除线性因素外的随机因素所产生的误差。

四·误差项分析

1. 误差项可以省略吗?

答:误差项不可省略,误差是必然产生的。并且由于产生了误差项,我们便可以基于误差的特点来进行对线性回归的参数估计的。

2. 误差项有什么特点?

答:独立同分布。

独立:每个样本点都是独立的;例:贷款,每个人与每个人之间是没有联系的,贷多少钱完全基于你的工资。

同分布:同分布就是我的这套估计体系是我人民银行的估计体系,每个人都是服从我的分布体系,不会使用别人的估计体系,也就是说每个样本点都处于同一个分布函数下。

误差项分析

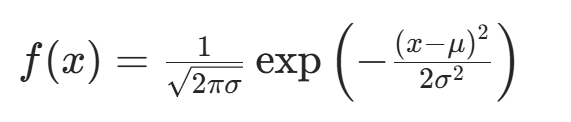

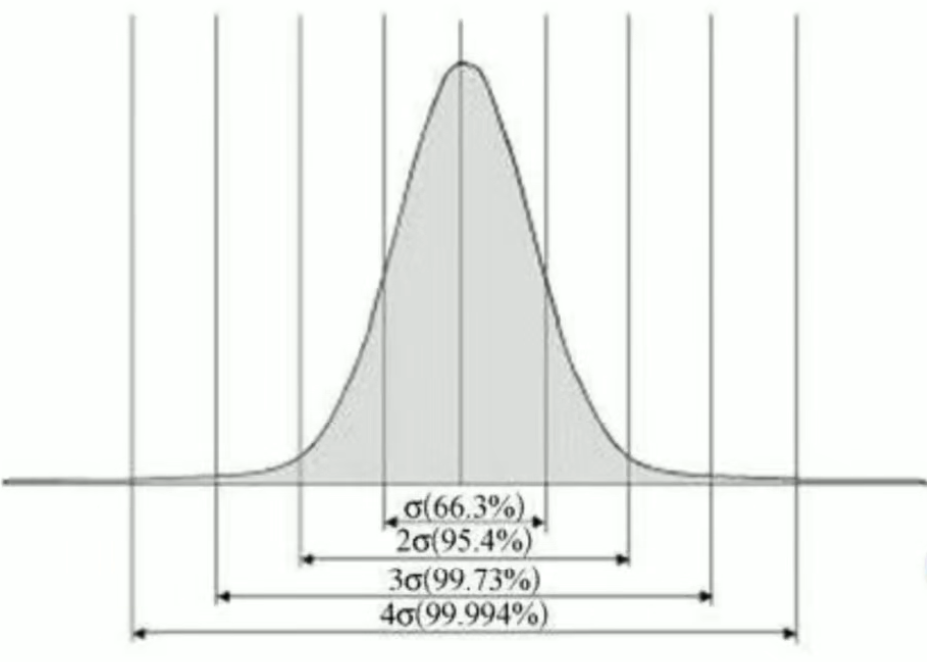

3. 误差项满足高斯分布。

高斯分布:

又称为正态分布,概率密度函数为:

对参数问题的估计就转化成了对误差项的分析。

1. 期望为 0;

2. 方差相同,为