Towards Low Light Enhancement with RAW Images 论文阅读

利用 RAW 图像实现低光增强

摘要

在本文中,我们首次进行了基准研究,详细阐述了在低光增强中使用 RAW 图像的优越性,并提出了一种新颖的替代方案,以更灵活和实用的方式利用 RAW 图像。受对典型图像处理流程的全面考虑启发,我们开发了一个新的评估框架——因子化增强模型 (FEM),该框架将 RAW 图像的属性分解为可测量的因子,并提供了一个工具,用于实证探索 RAW 图像的属性如何影响增强性能。实证基准结果表明,数据的线性度 (Linearity) 和元数据中记录的曝光时间 (Exposure Time) 起着最关键的作用,在各种指标上都比以 sRGB 图像作为输入的方法带来了显著的性能提升。基于基准结果获得的见解,我们开发了一个 RAW 引导的曝光增强网络 (REENet),它在实际应用中通过仅在训练阶段使用 RAW 图像的方式,权衡了 RAW 图像的优势和不可获取性。REENet 将 sRGB 图像投影到线性 RAW 域中,利用相应的 RAW 图像施加约束,以降低建模训练的难度。之后,在测试阶段,我们的 REENet 不依赖于 RAW 图像。实验结果不仅证明了 REENet 优于最先进的基于 sRGB 的方法,而且证明了 RAW 引导和所有组件的有效性。

I. 引言

低光环境会导致成像中出现一系列退化,包括强烈的噪声、低可见度、色彩偏差等。更复杂的拍摄设备和先进的专用摄影系统在一定程度上需要付出高昂代价来减轻这种退化。现代数码相机通过调整拍摄参数来努力解决这个问题,但也会带来伴随的问题。例如,高ISO会引入放大的噪声,而长曝光时间会导致模糊。因此,通过软件增强低光图像是经济且理想的选择。

在大多数应用中,有两种图像被用作增强方法的输入:RAW 图像 [1, 2, 3, 4];以及RGB 图像 [5, 6, 7, 8, 9, 10],这些图像是通过若干处理(如去马赛克、白平衡、色调映射)从原始图像处理而来的,考虑到了人类视觉偏好和系统要求、存储限制。正如这些流行工作 [1, 2, 11] 中所报告的,以 RAW 数据作为输入的低光增强方法通常比那些以 sRGB 数据作为输入的方法获得显著优越的性能。一方面,与 sRGB 图像相比,RAW 数据具有两个固有优势:1) 原始性 (Primitive):RAW 数据几乎直接从传感器获取,并记录与硬件和拍摄设置相关的元数据,而 sRGB 图像已经为人类视觉偏好和系统要求进行了处理,这不可避免地导致了信息丢失。2) 线性 (Linear):由于 RAW 数据由传感器直接捕获,RAW 数据在不同曝光级别下的关系保持线性,而在 sRGB 域中,这种依赖关系由于处理系统的处理而是非线性的。

另一方面,在实际应用中,从实际应用中获取 RAW 图像可能更加困难。首先,RAW 图像包含丰富的信息,存储成本高昂,因此许多设备选择仅存储 sRGB 图像。其次,从用户角度来看,RAW 图像灾难性的显示依赖于一系列专业的处理操作和专业知识。因此,更多休闲用户更喜欢使用便携设备 [12]、手机,而不是用于拍摄的高级设备(如数码单反相机)。因此,更用户友好的基于 sRGB 图像的应用正在成为一种趋势。使用 RAW 数据的优缺点将在第 III-B 节详细说明。

基于以上讨论,揭示了两个关键问题:

- RAW 文件的哪些属性真正有助于低光图像增强?

- 是否存在一种替代方法来利用 RAW 文件进行实际应用,而无需改变现有的常用图像处理系统?例如,我们能否充分利用 RAW 文件的优势,但在测试时摆脱它们?

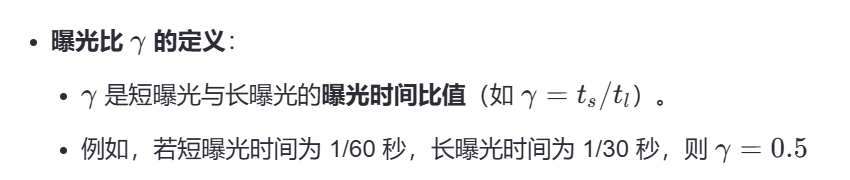

为了解决这两个问题,我们从一项基准研究开始。围绕图像处理流程的步骤,我们用一个新提出的因子化曝光模型 (FEM) 来描述低光图像增强。FEM 将低光图像增强的模糊性分解为几个可测量的因子,例如在图像采集处理前模拟曝光时间调整。受益于该框架,我们比较了几种使用不同输入和引导组合的 RAW 数据利用方案,以揭示 RAW 数据的哪些关键属性对低光图像增强有真正贡献。基准测试结果表明,在所有因子中,数据的线性度 (Linearity) 和元数据中记录的曝光时间 (Exposure Time) 在定量测量中起着最重要的作用。受此见解启发,提出了一种新颖的 RAW 引导的曝光增强网络 (REENet),以展示一条替代路径,该路径不仅利用了 RAW 图像,而且对基于 sRGB 的应用非常友好。与以前的基于 RAW 的方法不同,我们的 REENet 将处理后的 sRGB 图像作为输入,并仅在训练过程中采用 RAW 图像作为引导,而在测试过程中摆脱它们。大量的实验结果表明,我们的方法在定量和定性上都优于最先进的基于 sRGB 的方法。

本工作的贡献总结如下:

- 据我们所知,我们的工作是首次在低光增强中定量阐述使用 RAW 图像(不同输入/不同监督)优越性的基准研究。通过详细分析,基准测试结果揭示了有意义的见解,这启发我们探索新的路径来填补基于 sRGB 和基于 RAW 的方法之间的空白。

- 我们遵循图像处理流程,引入了一个新提出的因子化曝光模型 (FEM),用几个导致模糊性的可测量因子(例如,在处理前的图像采集中模拟曝光时间调整)来描述低光增强过程,用于对 RAW 图像的特征及其利用方式进行基准测试。

- 受基准测试见解的启发,我们进一步提出了一种新颖的用于低光增强的 RAW 引导曝光增强网络 (REENet),该网络在训练阶段仅需要 RAW 图像作为输入。实验结果表明,当 RAW 输入图像不可用时,所提出的方法优于最先进的基于 sRGB 的方法。

本文的其余部分组织如下。第 II 节简要回顾了相关的基于 sRGB 和基于 RAW 的工作。第 III 节展示了针对所提出的称为因子化增强模型的评估框架的各种方法的基准测试结果。第 IV 节介绍了所提出的 RAW 引导曝光增强网络,并提供了比较的实验结果和消融研究。结论总结在第 V 节。

II. 文献综述

A. 基于 sRGB 的方法

早期的方法主要以 sRGB 图像作为输入。传统的直方图均衡化 (histogram equalization) 方法通过操纵图像的直方图来拉伸其动态范围来调整光照,可以是全局的 [16, 17] 或局部自适应的 [18, 19, 20, 5]。这些方法可以有效调整图像对比度,但无法改变局部区域的视觉结构,不可避免地导致曝光不足/过度以及放大噪声。

反去雾 (Inverted dehazing) 方法 [21, 22, 7] 将低光图像反转为雾图,通过去雾算法提高可见度,然后将处理结果反转为输出。尽管在某些情况下取得了优异的性能,但这些方法缺乏令人信服的物理解释。

基于统计模型 (Statistical model) 的方法针对图像的理想属性进行优化,例如感知质量度量 [23]、像素间关系 [24]、物理光照模型 [25] 以及成像或视觉感知引导模型 [26]。这些方法在它们关注的方面表现出卓越的有效性。由于在注入视觉属性方面缺乏灵活性,这些方法无法处理图像被强烈噪声淹没的极端低光环境。

基于 Retinex 模型 (Retinex model) 的方法 [27, 8, 28, 29, 30, 31] 将图像分离为两个表示,即反射率和光照层,然后分别用精心设计的增强方法来增强这两个层。[32, 33] 中的工作通过鲁棒约束和显式噪声项丰富了基于 Retinex 模型的方法,这有助于更好地捕获和抑制噪声。

自 2017 年以来,低光增强进入了深度学习时代 [9]。基于深度学习 (Deep learning) 的方法通过设计新的架构和训练损失 [34, 35, 36, 37, 38, 10, 39],带来了出色的增强性能和注入各种先验和约束的灵活性。然而,这些方法的性能依赖于配对训练图像的分布,这实际上限制了模型的泛化性。最近,使用非配对数据的基于学习的增强方法,例如 EnlightenGAN [40]、Zero-DCE [41] 和 DRBN [42],分别通过 CycleGAN、自学习曲线调整和质量引导,部分摆脱了这个问题。此外,还有许多工作 [43, 44, 45, 46] 致力于解决组合任务,例如 HDR 和盲图像恢复,其中低光增强只是这些流程中的一个组成部分。

然而,由于图像处理系统在处理 RAW 图像为 sRGB 图像时引入了非线性并丢弃了一些细粒度信息,从 sRGB 图像进行增强是高度不适定的,在极暗条件下难以提供理想的结果。此外,大多数这些方法旨在同时恢复光照(估计曝光水平)和细节信号(抑制噪声和揭示细节)。相比之下,在我们的工作中,我们的目标是获得具有更长曝光时间的图像,其中除了曝光水平之外的维度上的性能受到更多关注,并且期望的曝光水平可能不是唯一的,可以在测试时由用户给出。

B. 基于 RAW 的方法

一些工作致力于通过构建可学习的 RAW 图像处理流程 [1, 2, 11] 或将 sRGB 图像“反处理(unprocessing)”回 RAW 域以进行更有效的增强过程 [3, 4, 15, 47, 48] 来提高图像质量。RAW 图像中的信号值完全依赖于传感器捕获的光子数量,并且在不同曝光级别下彼此之间具有线性相关性。这一特性降低了操纵图像像素信号的难度,并有助于建模和增强低光图像/视频。在 [1] 中,Chen 等人提出了一种新颖的可学习处理策略,用于在极暗的室内/夜间环境中捕获的 RAW 数据,并构建了 See-in-the-Dark (SID) 数据集,这是第一个提供短/长曝光 RAW 配对的数据集。后续的基于 RAW 的方法 [4, 13, 15] 开发了更先进的架构,以进一步提高 SID 上的低光增强性能。在 [13] 中,设计了一个新的深度网络用于图像增强,在将 RAW 图像转换为最终的高感知质量图像方面提供了最先进的结果。在 [15] 中,Zhu 等人提出了一个多曝光融合模块,将生成的多曝光图像与一组曝光比相结合,然后采用边缘增强模块生成具有清晰边缘的高质量结果。[4] 中的工作也采用了包含注意力的两阶段框架上下文编码块来处理不同阶段低/高频信息的恢复。[14] 中的工作专注于抑制在低光条件下捕获的 RAW 图像的噪声,并通过所提出的噪声模型合成更真实的数据来提高训练模型的能力。[2, 11] 中的工作更进一步,专注于低光视频增强。在 [11] 中,创建了一个新颖的暗光 RAW 视频(DRV)数据集,包含静态场景中的配对低/正常光 RAW 图像和动态场景中的非配对低光 RAW 图像,并与 VBM4D 联合构建了一个充分考虑泛化性和时间一致性的新深度网络,以有效增强低光视频同时抑制噪声。在 [2] 中,Jiang 和 Zeng 开发了一种新颖的光学系统,用于在同一场景捕获低/正常光视频,即 See-Moving-Objects-in-the-Dark (SMOID) 数据集,并构建了一个可学习的时空变换,将 RAW 视频转换为正常光 sRGB 视频。

尽管在基于学习的方法中采用 RAW 图像带来了巨大的性能飞跃,但尚不清楚 RAW 数据的哪些属性贡献了这些增益。此外,RAW 文件的不可获取性限制了它们的应用范围。在本文中,我们旨在定量地对利用 RAW 图像的方式进行基准测试,并且与基于 RAW 的方法不同,我们探索了一种替代方法来利用 RAW 文件进行实际应用,而无需改变现有的 ISP 系统。

III. 低光图像增强中 RAW 数据利用的基准测试

A. 动机

自然地,以低光 sRGB 图像作为输入图像的低光图像增强问题是高度不适定的。相比之下,从 RAW 图像恢复则模糊性(不确定性)要小得多,特别是当 RAW 文件的元数据中的曝光比提供了关于光照的大量信息时。为了从 RAW 利用的角度比较不同方法,我们制定了图像处理流程,并提出了一种新视角,将低光图像增强视为因子化增强模型 (FEM) 的框架,该框架将这种模糊性分解为几个可测量的因子,并有助于比较 RAW 文件的各种属性对低光图像增强的影响。

B. RAW 文件的特性

具有图像处理流程的现代数字拍摄系统将传感器数据处理成视觉上更愉悦、噪声更少的图像,该图像被存储为 RGB 文件(例如 JPEG 或 PNG 格式的 sRGB 图像)。与处理后的 sRGB 图像相比,RAW 文件具有以下良好特性:

- 访问元数据 (Access to meta-data)。在图像采集过程中,相机会将拍摄参数记录为原始传感器数据 dsensd^{sens}dsens 的元数据 dmetad^{meta}dmeta。受硬件影响,传感器数据是高度相机特定的,例如采用不同的黑电平、饱和度、镜头畸变,并由相机特定的真实世界噪声模型 [14] 建模。一个 RAW 文件 frawf_{raw}fraw 由传感器数据 dsensd^{sens}dsens 和元数据 dmetad^{meta}dmeta 组成。

-

数据线性度 (Linearity of data)。在线性图像中,像素值与真实世界的信号直接相关,即传感器上该位置接收到的光子数量,因此在不同曝光级别下保持线性相关。为了从传感器数据 dsensd^{sens}dsens 恢复线性 RAW 数据 (linear RAW data) yrawy^{raw}yraw,应用硬件校准操作 Fcalt(⋅)F_{calt}\left(\cdot\right)Fcalt(⋅),例如线性化和镜头校准。理论上完美的校准可以将传感器数据与其捕获设备解耦,使校准后的信号线性依赖于真实世界的信号:

yraw=Fcalt(dmeta,dsens,α) ,(1)y^{raw}=F_{calt}(d^{meta},d^{sens},\alpha)\,, (1)yraw=Fcalt(dmeta,dsens,α),(1)注意,由于传感器数据 dsensd^{sens}dsens 是离散存储的,恢复的 yrawy^{raw}yraw 也是离散的。由于硬件引起的噪声和偏差的分布非常复杂且依赖于数据 [14],完美的校准很难获得。

- 细粒度量化级别 (Fine-grained quantization level)(即更丰富的强度和颜色)。大多数 RAW 文件包含非常丰富的信息,因为它们具有高分辨率和宽信号范围,捕获了更细粒度的强度和颜色。然而,RAW 图像存储成本高,并且对人类视觉(一种非线性感知系统)显示不友好,这限制了 RAW 图像的应用范围。处理系统的最终输出通常是 8 位 sRGB 图像。

当 RAW 文件被处理成最终的 sRGB 图像时,上述特性就消失了。大多数图像处理系统服务于人类视觉感知质量,因此执行了基于人类视觉的连续调整阶段,例如白平衡、色调映射和伽马校正。标准的 sRGB 系统生成一个非线性 sRGB 图像 ysrgby^{srgb}ysrgb 如下:

fsrgb=Fproc(dmeta,yraw,β) ,(2)f^{srgb}=F_{proc}(d^{meta},y^{raw},\beta)\,, (2)fsrgb=Fproc(dmeta,yraw,β),(2)

其中 Fproc(⋅)F_{proc}(\cdot)Fproc(⋅) 表示处理阶段,β\betaβ 表示配置。在第 III-C 节中,我们将对 Fproc(⋅)F_{proc}(\cdot)Fproc(⋅) 进行更详细的分析。处理后,获得一个非线性的 8 位图像 fsrgbf^{srgb}fsrgb。请注意,元数据也可能可用于 sRGB 文件,例如 JPEG 格式中的 EXIF 或直接从数码相机获得的耦合元数据文件。在更常见的情况下,例如在互联网和社交网络上的图像,或经过后处理或编辑的图像,完美的元数据几乎不可用。因此,在我们的论文中,最终版本的所提方法不依赖于最终 sRGB 文件中的元数据访问。然而,为了使我们的论文更全面,我们也讨论了 sRGB 文件是否耦合了记录的完美元数据的情况,以了解它如何有益于增强。

总结一下,RAW 文件的特性包括访问元数据、数据的线性度以及细粒度的量化级别(即更丰富的强度和颜色)。当 RAW 文件通过图像处理系统投影到最终的 sRGB 图像时,这些属性就消失了。

C. 图像处理流程

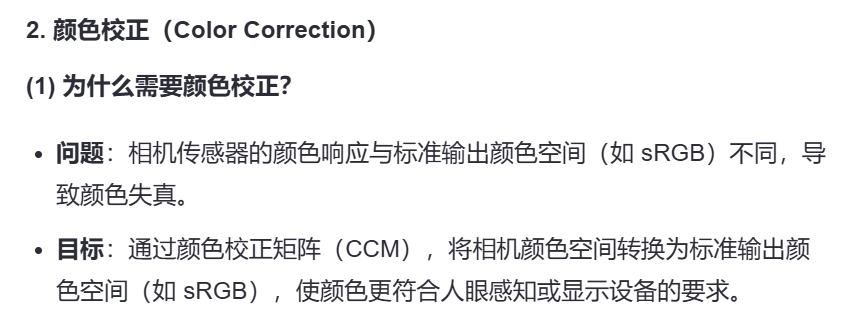

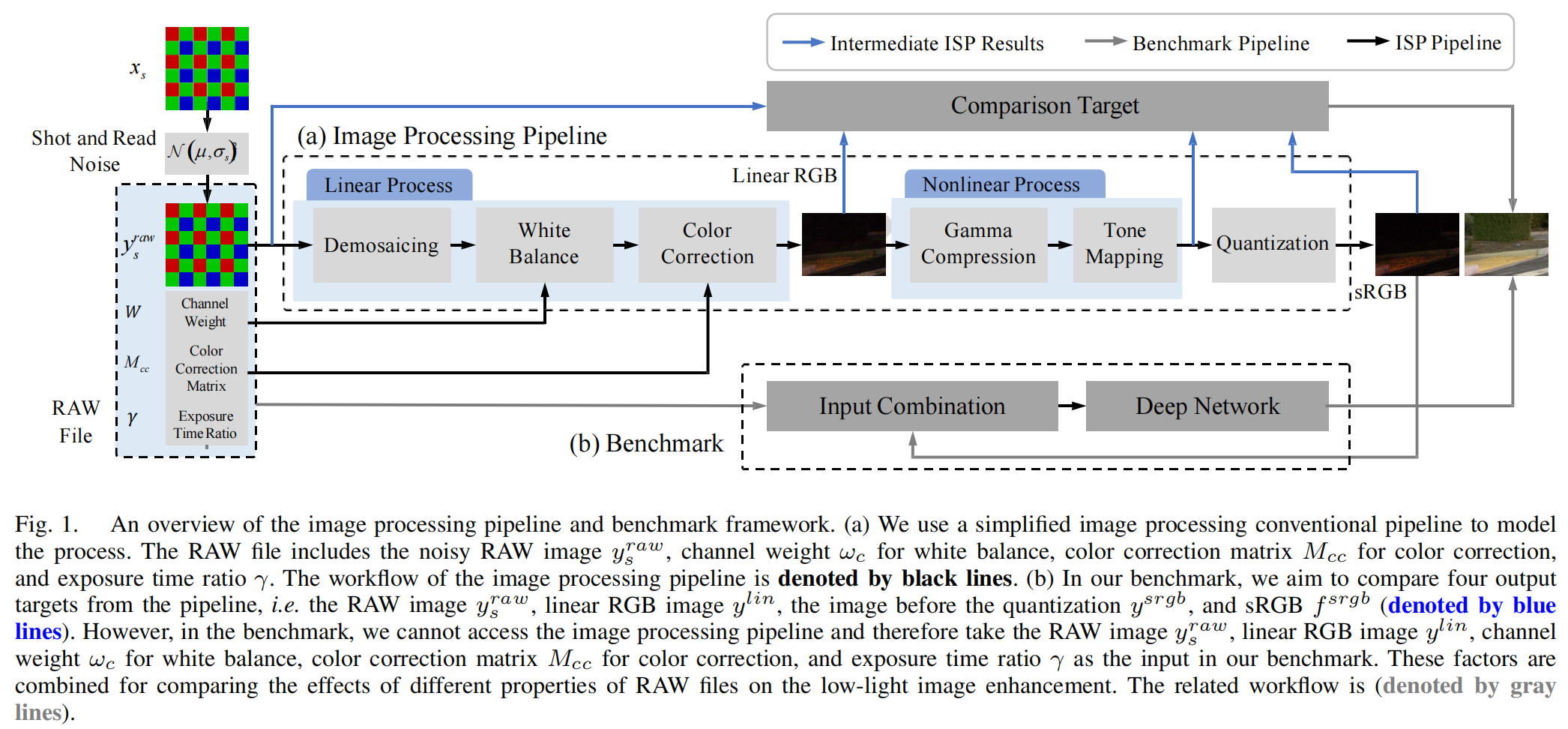

图 1: 图像处理流程和基准框架概述。(a) 我们使用一个简化的传统图像处理流程来建模该过程。RAW 文件包括带噪声的 RAW 图像 ytrawy^{raw}_{t}ytraw、用于白平衡的通道权重 ωc\omega_{c}ωc、用于颜色校正的颜色校正矩阵 MccM_{cc}Mcc 以及曝光时间比 γ\gammaγ。图像处理流程的工作流由黑线表示。(b) 在我们的基准测试中,我们旨在比较流程中的四个输出目标,即 RAW 图像 ytrawy^{raw}_{t}ytraw、线性 RGB 图像 yliny^{lin}ylin、量化前的图像 ysrgby^{srgb}ysrgb 和 sRGB 图像 fsrgbf^{srgb}fsrgb(由蓝线表示)。然而,在基准测试中,我们无法访问图像处理流程,因此将 RAW 图像 ytrawy^{raw}_{t}ytraw、线性 RGB 图像 yliny^{lin}ylin、用于白平衡的通道权重 ωc\omega_{c}ωc、用于颜色校正的颜色校正矩阵 MccM_{cc}Mcc 和曝光时间比 γ\gammaγ 作为我们基准测试的输入。这些因子组合起来用于比较 RAW 文件的不同属性对低光图像增强的影响。相关工作流程(由灰线表示)。

在本节中,我们将描述等式 (2) 中的图像处理流程 Fproc(⋅)F_{proc}\left(\cdot\right)Fproc(⋅)。由于每种相机中处理系统的具体流程和配置是商业机密,在我们的讨论中,我们将这些细节视为黑盒。尽管如此,传统的图像处理系统 [47] 也有助于建立一个简洁的数学模型,如图 1(a) 所示,我们可以利用它作为框架来评估有益于低光图像增强的 RAW 属性,如图 1(b) 所示。请注意,基准测试中用作最终目标的所有 sRGB 图像都是由 Libraw 处理的,这在我们讨论中被视为黑盒。我们定义的简化处理流程,包括一个简化的去马赛克模块,仅提供 RAW 域中的中间监督,实际上不影响基准测试结果 。

散粒噪声和读出噪声 (Shot and Read Noise)。RAW 文件中记录的真实世界信号混杂着物理引起的噪声。与 sRGB 相比,RAW 域中的噪声模型很少受到处理流程中非线性的干扰。RAW 域中的传感器噪声由两部分组成:散粒噪声和读噪声 [49]。通过使用固定的光圈和 ISO,无噪声信号 xxx 的值与曝光时间呈线性相关。具体来说,为了模拟在低光条件下的拍摄,我们使用短曝光时间,那么 RAW 域中的传感器数据 ysrawy^{raw}_{s}ysraw 可以表示为:

ysraw=xs+nshot(xs)+nread ,(3)y^{raw}_{s}=x_{s}+n_{shot}(x_{s})+n_{read}\,,(3)ysraw=xs+nshot(xs)+nread,(3)

其中 xsx_{s}xs 是无噪声的短曝光 RAW 图像,ysrawy^{raw}_{s}ysraw 是带噪声的版本,nshotn_{shot}nshot 和 nreadn_{read}nread 分别是散粒噪声和读出噪声。下标 sss 在此表示短曝光 (short-exposure)。如 [50] 中简化的,

ysraw≃xs+n(xs) ,n(xs)[i]∼N(0,σs2[i]) ,σs2[i]=λshotxs[i]+λread ,(4)\begin{split} y^{raw}_{s}&\simeq x_{s}+n(x_{s})\,, \\ n(x_{s})[i]&\sim\mathcal{N}(0,\sigma_{s}^{2}[i] )\,,\\ \sigma_{s}^{2}[i]&=\lambda_{shot}x_{s}[i]+ \lambda_{read}\,,\end{split}(4)ysrawn(xs)[i]σs2[i]≃xs+n(xs),∼N(0,σs2[i]),=λshotxs[i]+λread,(4)

其中 λshot\lambda_{shot}λshot 和 λread\lambda_{read}λread 表示相机的噪声水平,iii 表示位置,[⋅][\cdot][⋅] 返回位置 iii 的值。

去马赛克 (Demosaicing)。由于传感器只能捕获光子,无法感知色光,为了感知色度信息,相机中的像素被覆盖着按特定图案排列的彩色滤光片,例如 R-G-G-B 拜耳模式。去马赛克是处理阶段之一,有助于重建全尺寸彩色图像。在我们的实现中,R-G-G-B 模式通过平均绿色通道并采用双线性插值将分辨率上采样到 m×n×3m\times n\times 3m×n×3 来转换为 RGB 通道。

白平衡和颜色校正 (White Balance and Color Correction)。由于经过滤光片的传感器数据受到环境光色温的影响,相机应用白平衡在正常光照下生成视觉上令人愉悦的图像。在这个阶段,三个通道乘以权重 wc(c=r,g,b)w_{c}\left(c=r,g,b\right)wc(c=r,g,b),这些权重是从 RAW 文件中获取的。请注意,在低光条件下获得的光度测量可能不准确 [11],这些权重(由 w~c\widetilde{w}_{c}wc 表示)通常存在偏差,需要额外的校准。该模块形式化为:

yswb=ysraw∘W^ ,ylwb=ylraw∘W ,W^=[[[w~r,w~g,w~b]]]1×1×3 ,W=[[[wr,wg,wb]]]1×1×3 ,(5)\begin{split}& y^{wb}_{s}=y^{raw}_{s}\circ\widehat{W}\,,\\ & y^{wb}_{l}=y^{raw}_{l}\circ W\,,\\ &\widehat{W}=\left[\left[\left[\widetilde{w}_{r},\widetilde{w}_{g}, \widetilde{w}_{b}\right]\right]\right]_{1\times 1\times 3}\,,\\ & W=\left[\left[\left[w_{r},w_{g},w_{b}\right]\right]\right]_{1 \times 1\times 3}\,,\end{split}(5)yswb=ysraw∘W,ylwb=ylraw∘W,W=[[[wr,wg,wb]]]1×1×3,W=[[[wr,wg,wb]]]1×1×3,(5)

其中 ∘\circ∘ 表示逐元素乘积,下标 sss 和 lll 分别表示短曝光 (short-exposure) 和长曝光 (long-exposure)。

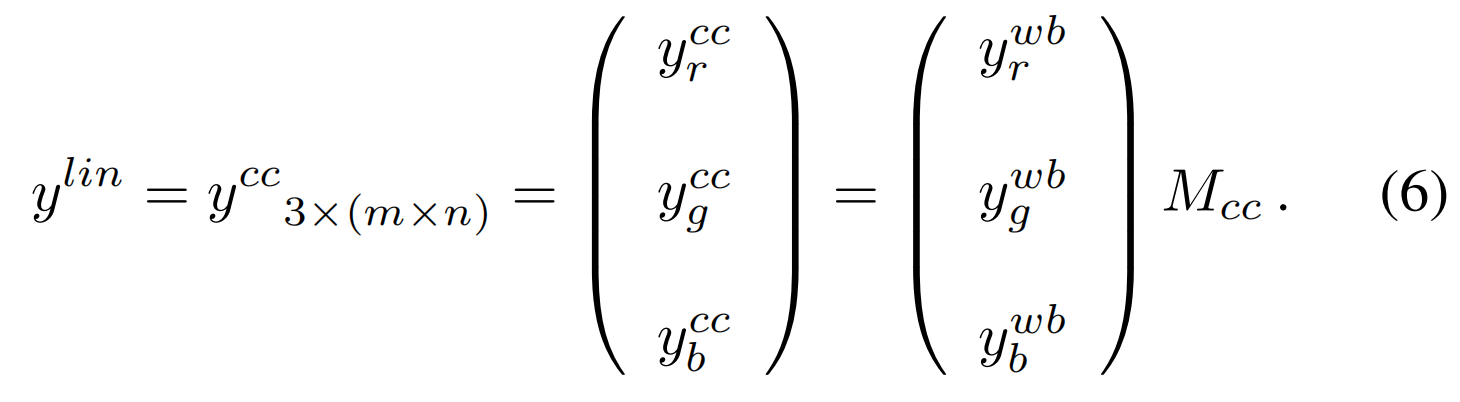

随后进行颜色校正,采用一个 3×33\times 33×3 颜色校正矩阵 (CCM) 将相机的颜色空间转换为输出颜色空间(即 sRGB)。我们从 RAW 文件的元数据中获取 CCM MccM_{cc}Mcc。具体来说,将相机颜色空间转换为 XYZ 颜色空间的矩阵通常记录在 RAW 文件或处理系统的配置文件中(例如存储在 EXIF 中),而将 XYZ 颜色空间转换为 sRGB 颜色空间的矩阵参数是固定的。该模块形式化为:

为方便起见,yccy^{cc}ycc 等价地表示为 yliny^{lin}ylin。我们将把 yrawy^{raw}yraw 转换为 yliny^{lin}ylin 的过程称为线性处理 (linear process) 。

伽马压缩和色调映射 (Gamma Compression and Tone Mapping)。为了使图像更好地被人眼感知,进一步执行非线性过程,包括伽马压缩以及色调映射 [47]。为简单起见,跳过关于这两个阶段的更多细节。我们使用一个函数 σ(⋅)\sigma(\cdot)σ(⋅) 来表示由这两个阶段组成的非线性处理 (nonlinear process),如下所示:

ysrgb=σ(ycc) ,(7)y^{srgb}=\sigma(y^{cc})\,,(7)ysrgb=σ(ycc),(7)

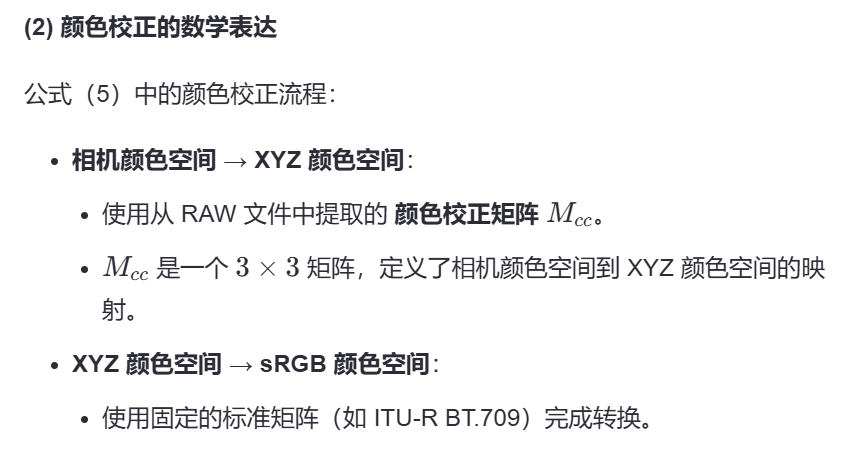

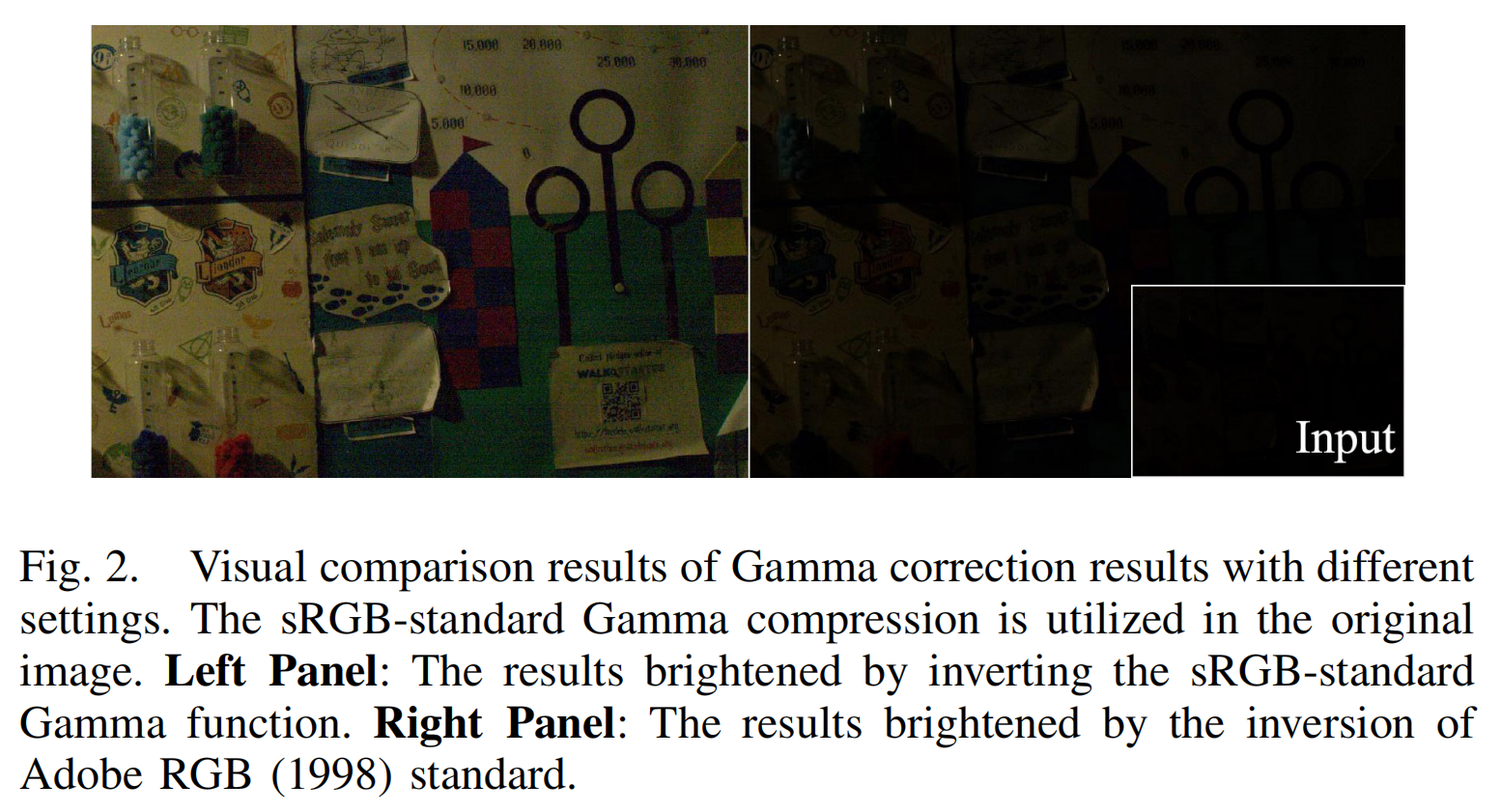

这些非线性过程为创建低光图像增强的逆映射引入了相当大的模糊性。例如,如图 2 所示,如果我们无法准确获得伽马压缩函数,通过反转两个伽马函数增亮的图像之间会产生巨大差距。这表明,对于不同的低光图像,应自适应地采用适当的反伽马函数。增亮的图像是通过依次进行反伽马压缩、乘以曝光时间比、再进行伽马压缩的操作生成的。

图 2: 不同设置的伽马校正结果的视觉比较。原始图像使用了 sRGB 标准伽马压缩。左面板:通过反转 sRGB 标准伽马函数进行增亮的结果。右面板:通过反转 Adobe RGB (1998) 标准进行增亮的结果。

量化 (Quantization)。最后,量化 Q(⋅)Q(\cdot)Q(⋅) 将具有更细粒度量化级别的数据转换为 8 位,以获得更紧凑的表示以节省存储空间,如下所示:

fsrgb=Q(ysrgb) ,(8)f^{srgb}=Q(y^{srgb})\,,(8)fsrgb=Q(ysrgb),(8)

D. 评估框架:因子化增强模型 (FEM)

也因为这句话“在线性图像中,像素值与真实世界的信号直接相关,即传感器上该位置接收到的光子数量,因此在不同曝光级别下保持线性相关”,所以公式可以用那么简单的式子来表示

对于基准测试,我们将低光增强视为在捕获过程中放大曝光时间的模拟,这具有简洁的数学形式,并为低光图像的精确可控增强过程提供了便利。当曝光放大 γ\gammaγ 倍时,相应的长曝光数据 ylrawy_{l}^{raw}ylraw(通常由于高信噪比 (SNR) 而近似为无噪声)可以表示如下:

ylraw≃xl=γxs ,(9)y_{l}^{raw}\simeq x_{l}=\gamma x_{s}\,,(9)ylraw≃xl=γxs,(9)

其中 xsx_{s}xs, xlx_{l}xl 和 ylraw∈Rm×n×1y_{l}^{raw}\in R^{m\times n\times 1}ylraw∈Rm×n×1 分别是在短曝光拍摄下无任何噪声的潜在辐射值、在长曝光拍摄下的值,以及用长曝光时间捕获的测量噪声值。

因此,如果在正常光照环境下给出了曝光比,低光增强本质上接近于在已经适当增亮的 RAW 图像 ybrawy_{b}^{raw}ybraw上进行去噪:

ybraw=γysraw≃γxs+γn(xs) ,γn(xs)[i]∼N(0,σb2[i]) ,(10)\begin{split} y_{b}^{raw} &=\gamma y_{s}^{raw}\simeq\gamma x_{s}+\gamma n(x_{s})\,, \\ \gamma n(x_{s})[i] &\sim\mathcal{N}(0,\sigma_{b}^{2}[i])\,, \end{split} (10)ybrawγn(xs)[i]=γysraw≃γxs+γn(xs),∼N(0,σb2[i]),(10)

其中 σb2[i]=γλshot(γxs[i])+γ2λread\sigma_{b}^{2}[i]=\gamma\lambda_{shot}(\gamma x_{s}[i])+\gamma^{2}\lambda_{read}σb2[i]=γλshot(γxs[i])+γ2λread,下标 sss 表示短曝光 (short-exposure),lll 表示长曝光 (long-exposure),bbb 表示增亮 (brightened)。因此,增强模型 Fenhance(⋅)F_{enhance}\left(\cdot\right)Fenhance(⋅) 可以表示如下:

f^srgb=Fenhance(ybraw) ,(11)\hat{f}^{srgb}=F_{enhance}\left(y_{b}^{raw}\right)\,,(11)f^srgb=Fenhance(ybraw),(11)

其中 f^srgb\hat{f}^{srgb}f^srgb 是增强模型 Fenhance(⋅)F_{enhance}\left(\cdot\right)Fenhance(⋅) 的预测。等式 (11) 提供了一种灵活的方式来对 RAW 利用进行基准测试,如图 1 (b) 所示。也就是说,ybrawy_{b}^{raw}ybraw 可以用任何合理的图像(RAW/sRGB 图像)和元数据组合替换输入组合模块中的内容。之后,输入被前馈到一个用于低光图像增强的深度网络中。通过具有不同输入的深度网络的性能,我们可以推断 RAW 文件属性对增强的重要性。

E. RAW 基准测试

在此基准测试中,我们比较了几种具有不同输入和引导的 RAW 数据利用方案,以探索 RAW 数据的特性可以为低光增强任务带来多少贡献。通过实验结果分析了不同特性的影响,包括元数据中记录的线性度 (L)、曝光时间 (E)、白平衡参数 (W) 和量化级别 (Q)。

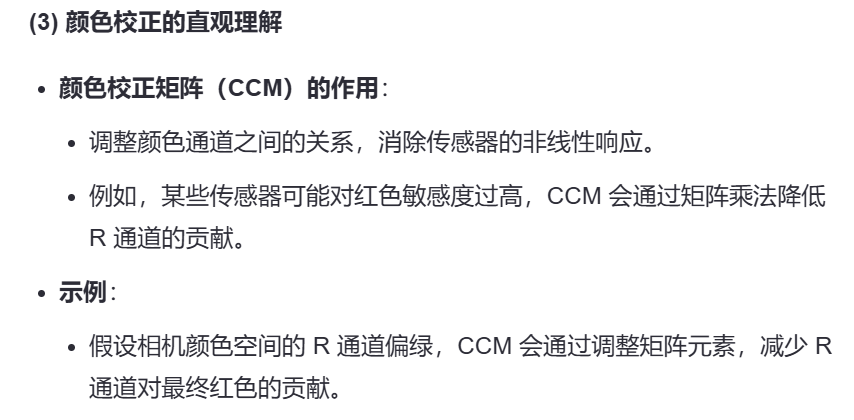

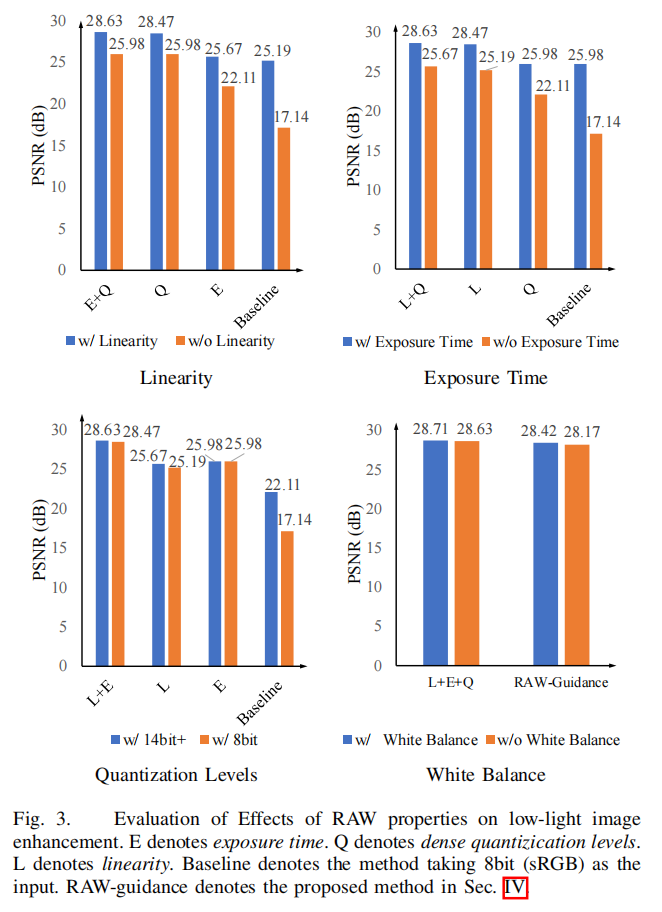

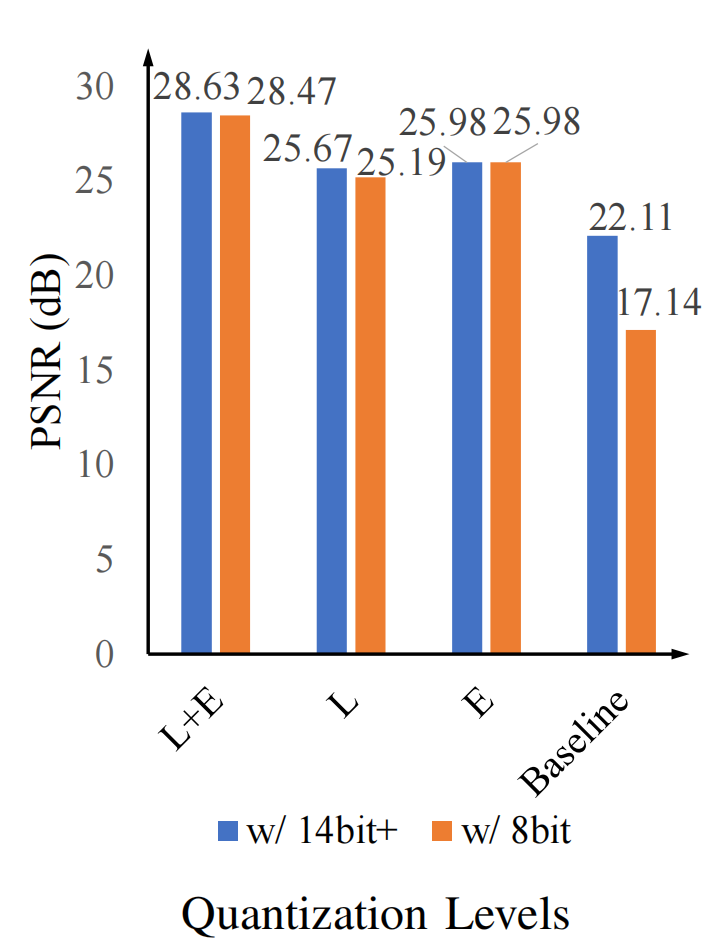

图 3: RAW 属性对低光图像增强影响的评估。E 表示曝光时间 (Exposure time)。Q 表示密集量化级别 (dense quantization levels)。L 表示线性度 (Linearity)。Baseline 表示以 8 位

(sRGB) 作为输入的方法。RAW-guidance 表示第 IV 节提出的方法。

实验设置

采用 SID 数据集进行训练和评估。我们使用 Sony 子数据集,该数据集由配备拜耳传感器的 Sony α7S II 构建。该子集包含 409 对低/正常光 RAW 图像。训练集、测试集和验证集分别包含 280、93 和 36 对图像。

基于第 III-B 节提到的 RAW 文件特性,我们对输入/目标对采用不同的操作,并将它们前馈到相似的架构(即 U-Net [51])中进行性能比较。所有方法都在 SID 上从头开始训练。对于基于 RAW 的方法,训练设置遵循 [1] 的范式,即,将具有拜耳模式的 RAW 数据解包为 4 个通道,对数据进行线性化处理数据,并将其归一化到 [0, 1]。然后,数据被送入 U-Net [51]。

对于基于 sRGB 的方法,相应的 sRGB 图像由 Libraw 处理,其中不采用直方图拉伸 [1],因为它会在处理过程中增亮图像,这远离我们在基准测试和开发新颖 RAW 利用范式中的目标。网络使用 L1 损失进行训练,以正常光 sRGB 图像作为真实值。

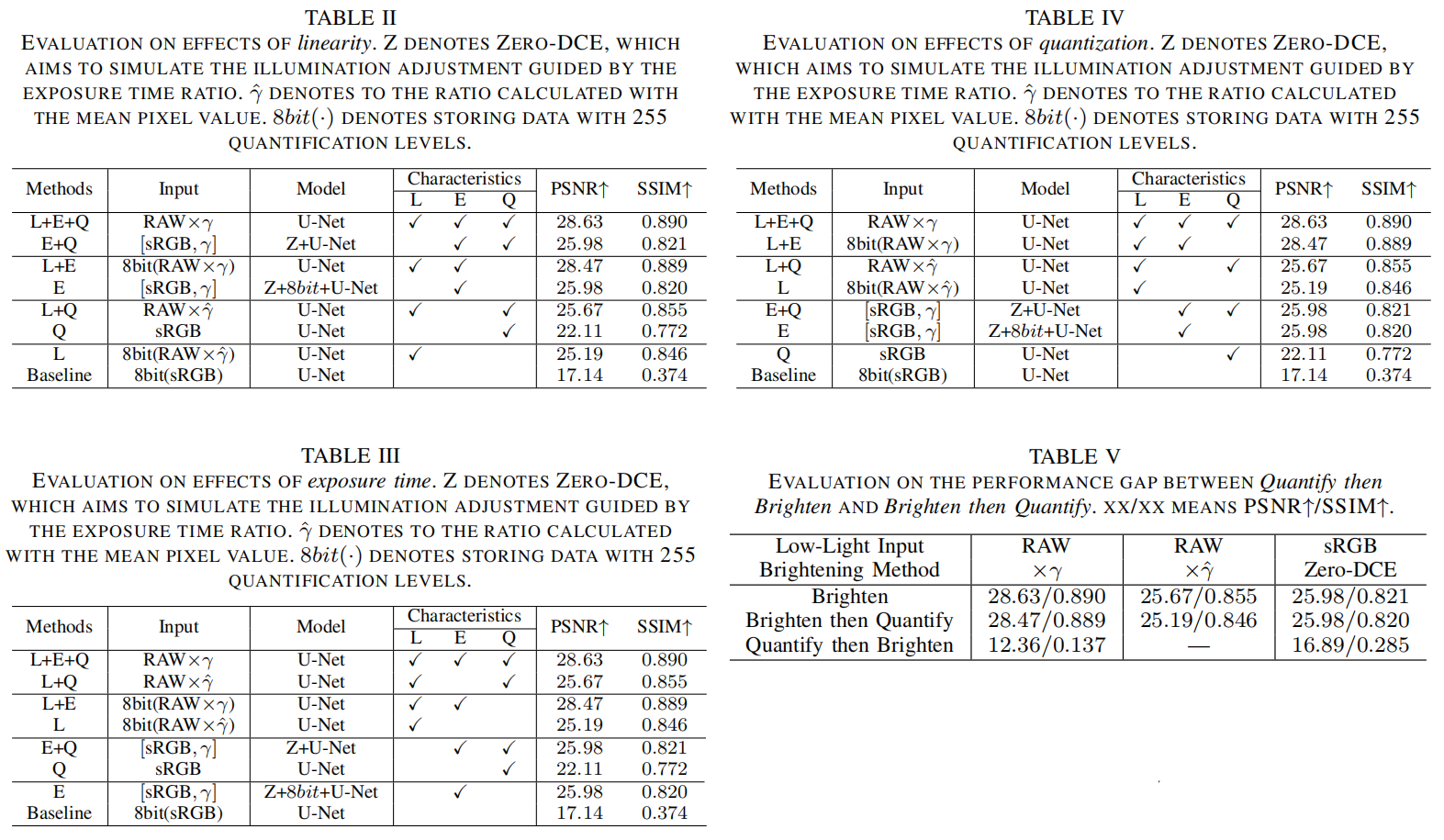

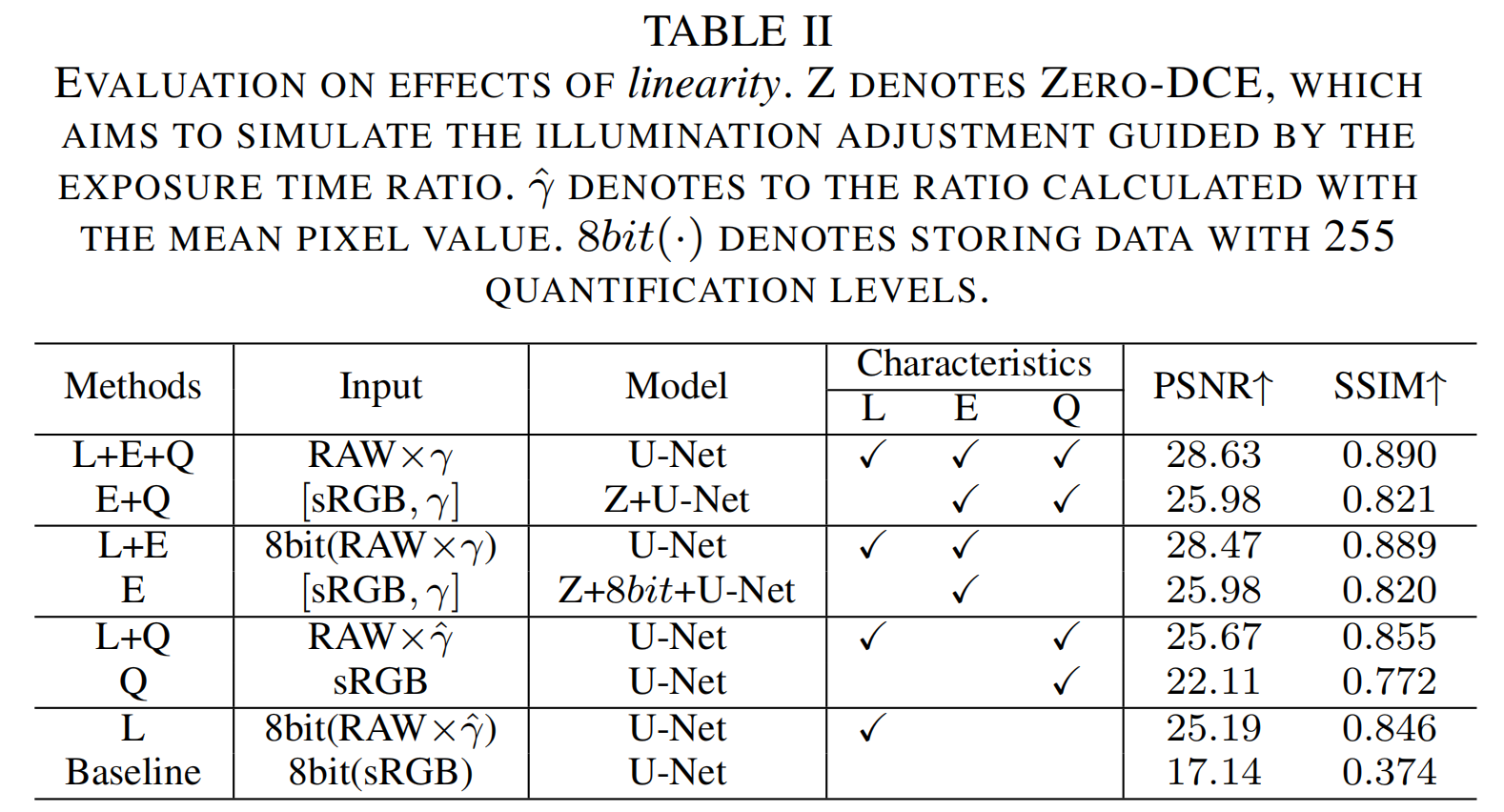

由于篇幅限制,PSNR 和 SSIM 的基准测试结果如表 II-VII 所示。包含更多指标的扩展表格在补充材料的表 I-V 中提供。

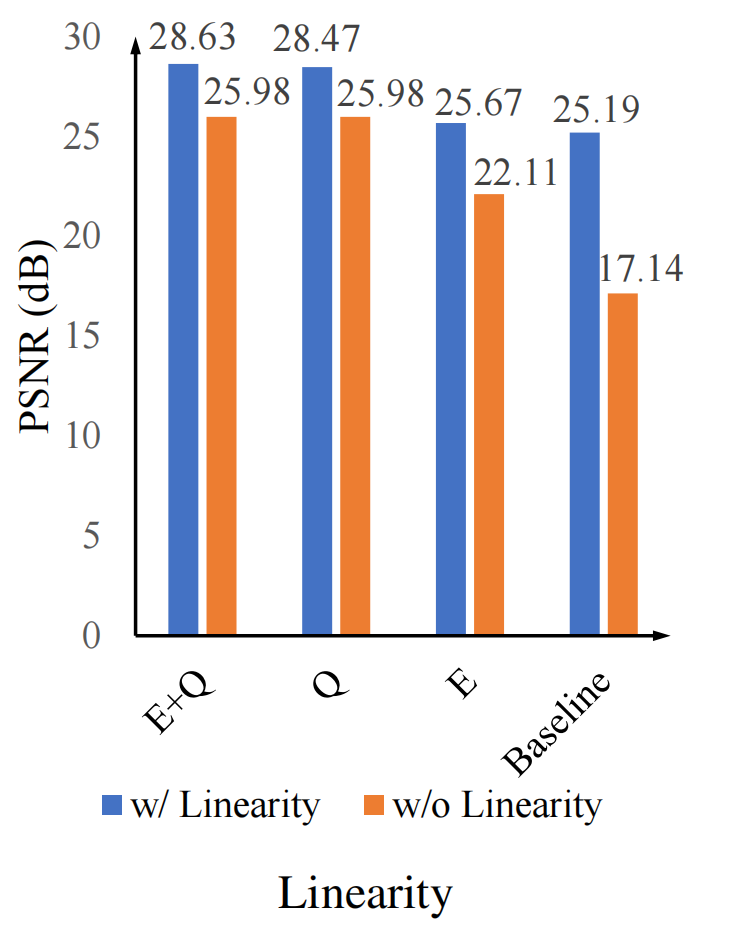

线性度 (Linearity)

我们比较了几组分别在线性域和非线性域预处理信号的版本,如图 3 (a) 和表 II(对应于补充材料中的表 I)所示。对于在非线性 sRGB 域工作的方法,采用 Zero-DCE [41] 在曝光时间比 γ\gammaγ 的引导下调整 sRGB 域中的光照,即以低光输入和比值为输入。结果表明,在线性域工作的方法(其中光照可以通过乘以比值直接调整)显著优于在非线性域工作的方法,在 PSNR 上提升超过 2.49 dB,在 SSIM 上提升超过 0.069,在 NIQE 上提升约 0.7,在 LPIPS 上提升 0.03。结果说明了 RAW 数据的线性度在低光图像增强中的关键作用。

表 II 线性度影响的评估。Z 表示 ZERO-DCE,旨在模拟由曝光时间比 γ\gammaγ 引导的光照调整。γ^\hat{\gamma}γ^ 表示根据平均像素值计算的比值。8bit(·) 表示使用 255 个量化级别存储数据。

图 3: E 表示曝光时间 (Exposure time)。Q 表示密集量化级别 (dense quantization levels)。L 表示线性度 (Linearity)。Baseline 表示以 8 位 (sRGB) 作为输入的方法。

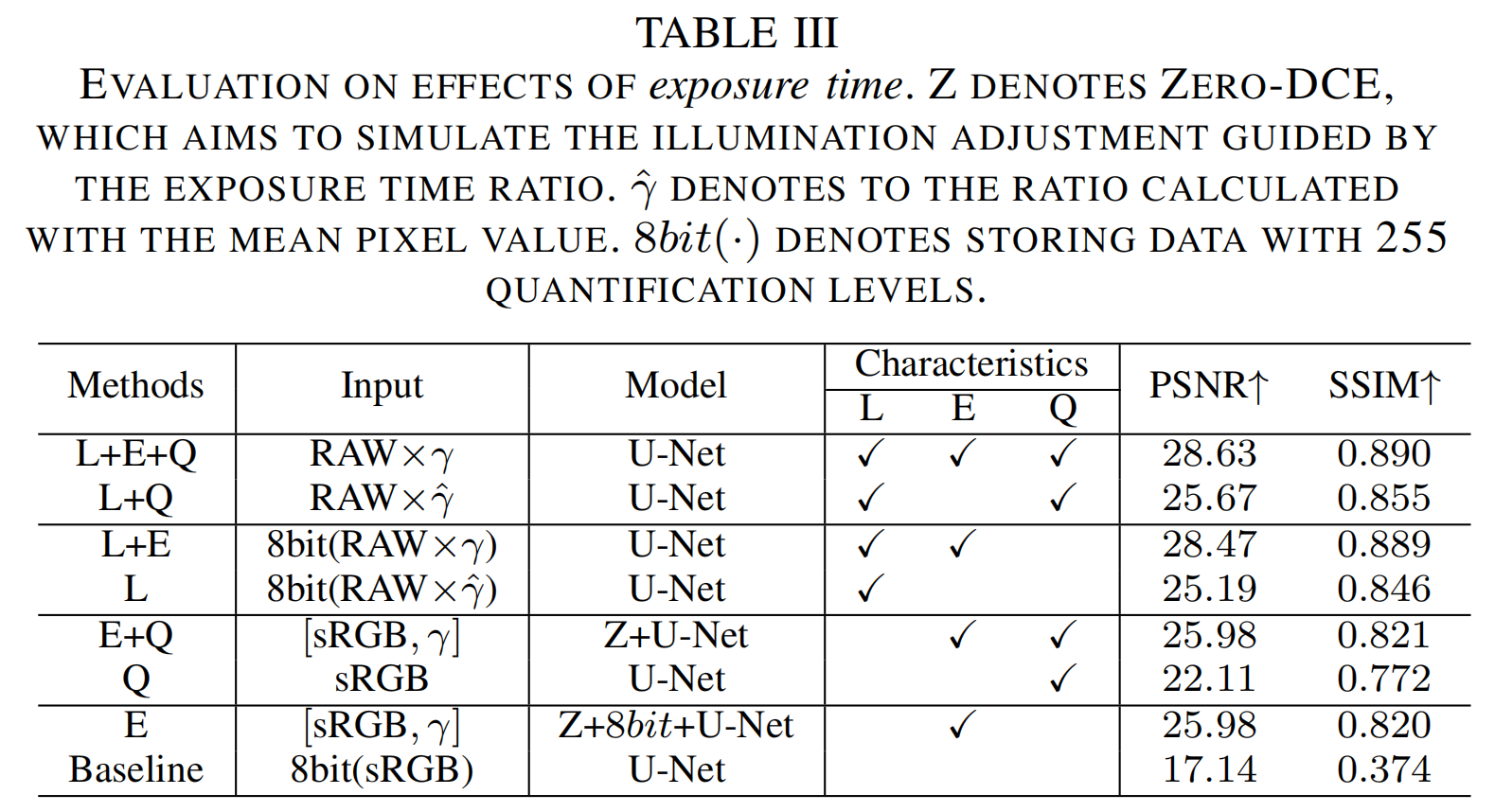

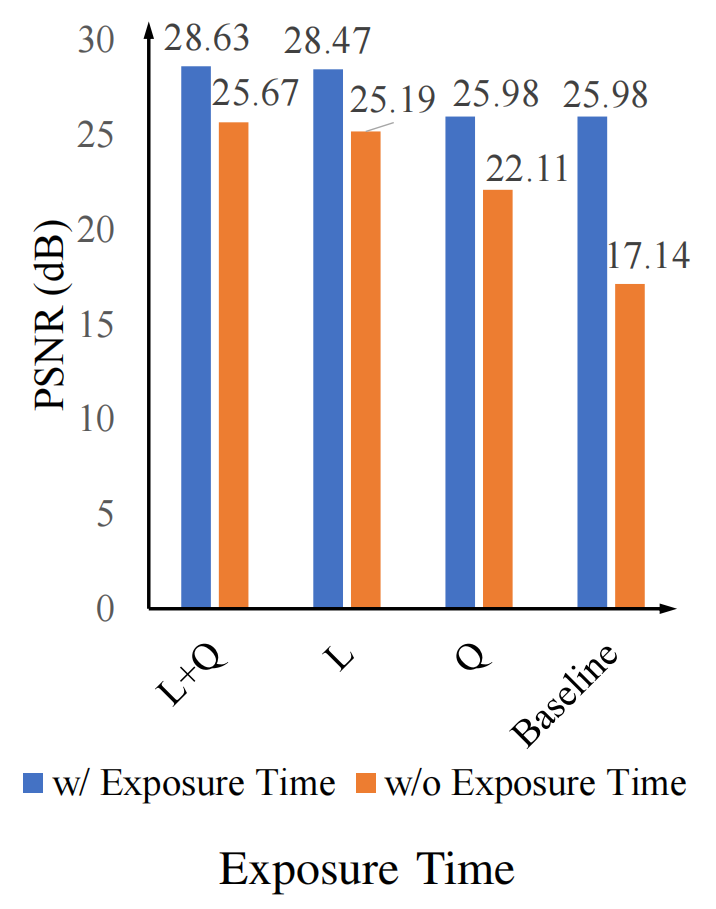

曝光时间 (Exposure Time)

我们还比较了假设获得曝光时间与否的方法,如图 3 (b) 和表 III(对应于补充材料中的表 II)所示。对于没有地面真实曝光时间比 γ\gammaγ 的方法,我们使用短/长曝光线性数据的平均像素值来估计 γ^\hat{\gamma}γ^。观察到,使用地面真实曝光时间比 γ\gammaγ 带来了显著的性能改进,在 PSNR 上提升超过 2.96 dB,在 SSIM 上提升超过 0.035,在 NIQE 上提升约 0.2,在 LPIPS 上提升超过 0.03,这证明了元数据中记录的曝光时间是另一个主导因素。显然,估计的比值 γ^\hat{\gamma}γ^ 使调整后的低光图像产生偏差,出现过曝和暗区,增加了低光增强的模糊性。

表 III 曝光时间影响的评估。Z 表示 ZERO-DCE,旨在模拟由曝光时间比 γ\gammaγ 引导的光照调整。γ^\hat{\gamma}γ^ 表示根据平均像素值计算的比值。8bit(·) 表示使用 255 个量化级别存储数据。

图 3: E 表示曝光时间 (Exposure time)。Q 表示密集量化级别 (dense quantization levels)。L 表示线性度 (Linearity)。Baseline 表示以 8 位 (sRGB) 作为输入的方法。

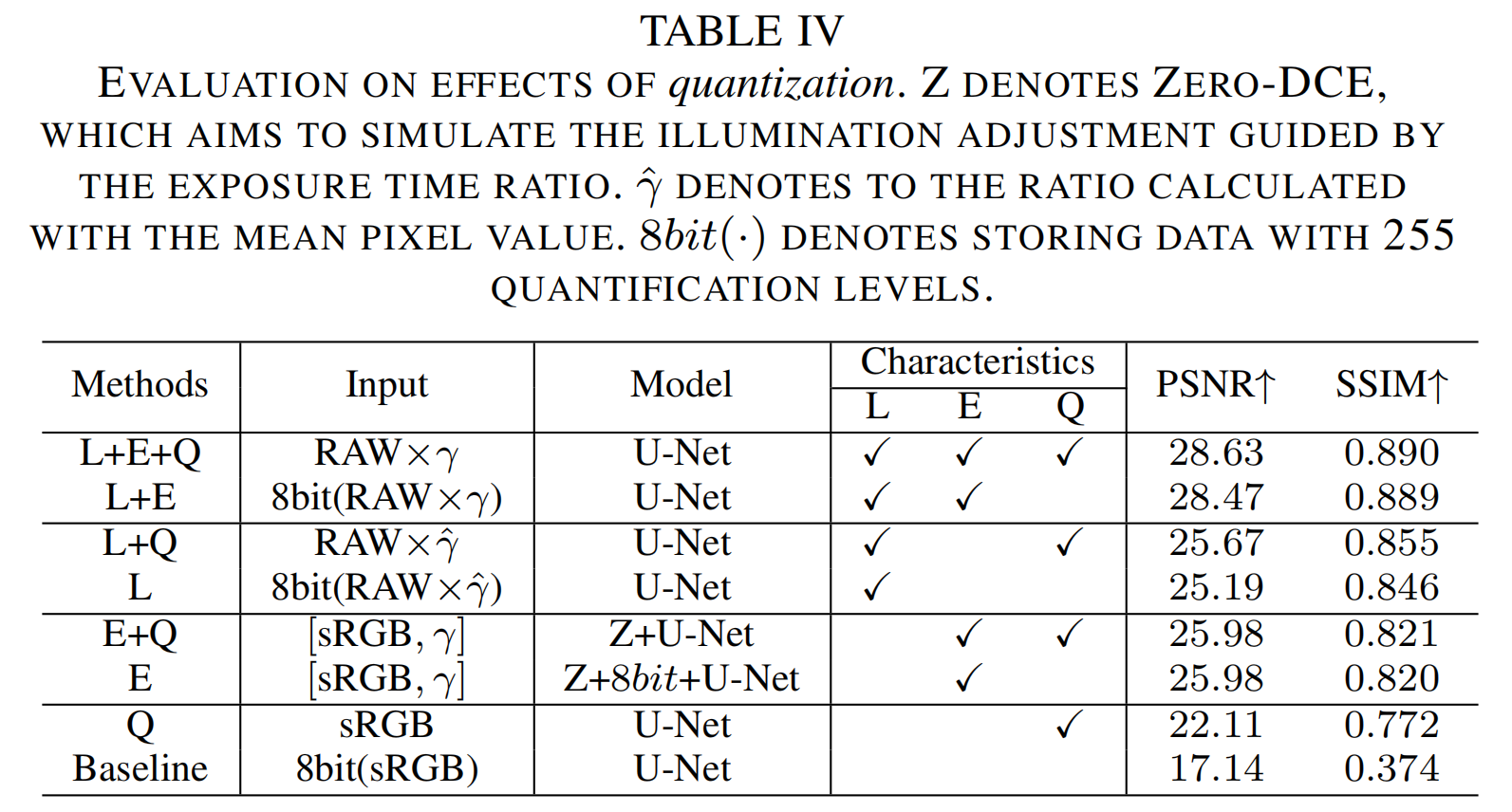

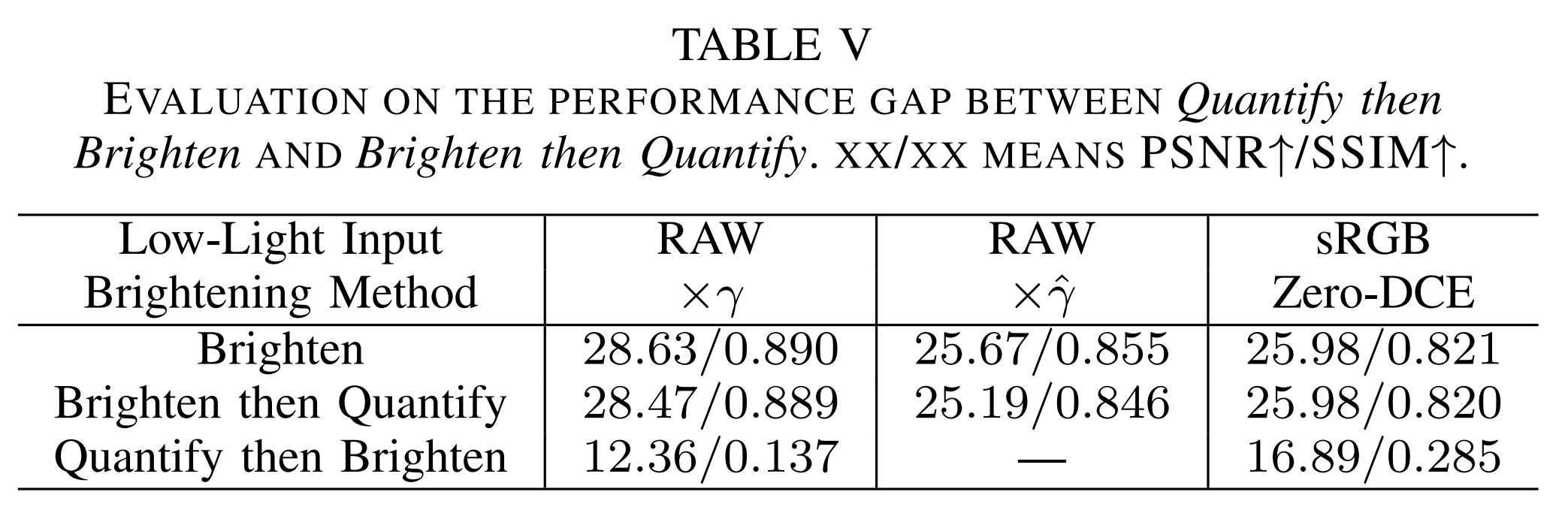

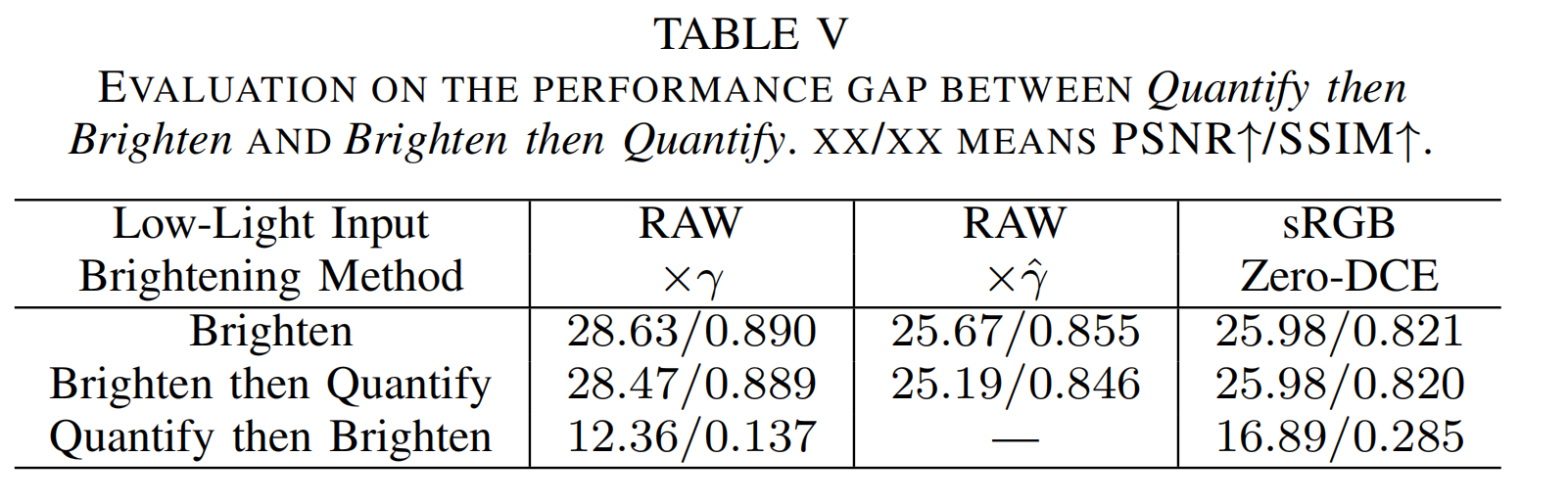

量化 (Quantization)

我们比较了以不同量化级别的图像作为输入的方法,如图 3(c)3(c)3(c) 和表 IV(对应于补充材料中的表 III)所示。观察到,如果量化压缩在增亮之后实施(称为 Brighten then Quantize 策略),更细粒度的量化级别只带来相对较小的增益,如表 IV(对应于补充材料中的表 III)的前三个比较所示,PSNR 提升低于 0.48 dB,其他指标表现相当。然而,如果在增亮之前将数据量化为 8 位格式(称为 Quantize then Brighten 策略),在表 V 中观察到巨大的性能下降。性能差距源于动态范围拉伸,它使得增亮后的暗区具有更细粒度的量化级别并保留更详细的信号。这些结果证明了遵循 Brighten then Quantize 策略压缩低光图像的重要性。

图 3: E 表示曝光时间 (Exposure time)。Q 表示密集量化级别 (dense quantization levels)。L 表示线性度 (Linearity)。Baseline 表示以 8 位 (sRGB) 作为输入的方法。

白平衡 (White Balance)

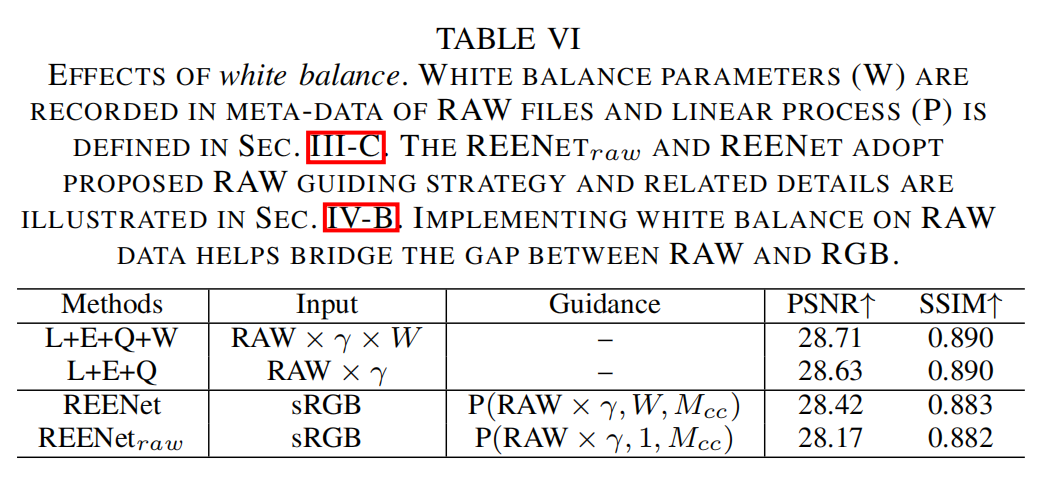

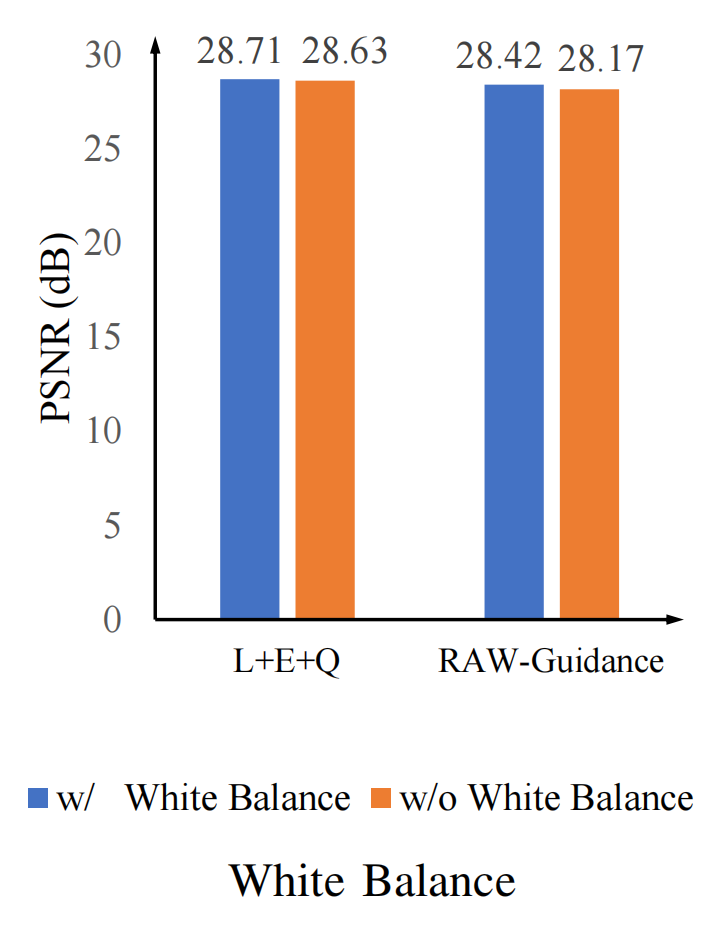

RAW 文件元数据中记录的白平衡参数也有助于低光图像增强。表 VI(对应于补充材料中的表 V)和图 3(d)3(d)3(d) 中的实验结果表明,通过使用白平衡参数预处理 RAW 图像,有可能提高基于 RAW 的方法和所提出的 RAW 引导方法 REENet 的性能。

表 VI 白平衡效果评估。 白平衡参数 (W) 记录在 RAW 文件的元数据中,线性处理 (P)(P)(P) 的定义见第 [III-C] 节。REENet rawr_{aw}raw 和 REENet 采用了所提出的 RAW 引导策略,相关细节在第 [IV-B] 节中说明。在 RAW 数据上实施白平衡有助于弥合 RAW 与 RGB 之间的差距。

图 3: E 表示曝光时间 (Exposure time)。Q 表示密集量化级别 (dense quantization levels)。L 表示线性度 (Linearity)。Baseline 表示以 8 位(sRGB) 作为输入的方法。

在 PSNR 上观察到超过 0.08 dB 的提升,同时 SSIM 和 NIQE 略有改善。在我们的比较中,为了在训练期间利用这些参数,我们用这些参数放大了解包后的 4 通道线性数据。

In our comparisons, to utilize these parameters during training, we amplify the unpacked 4-channel linear data with the parameters.

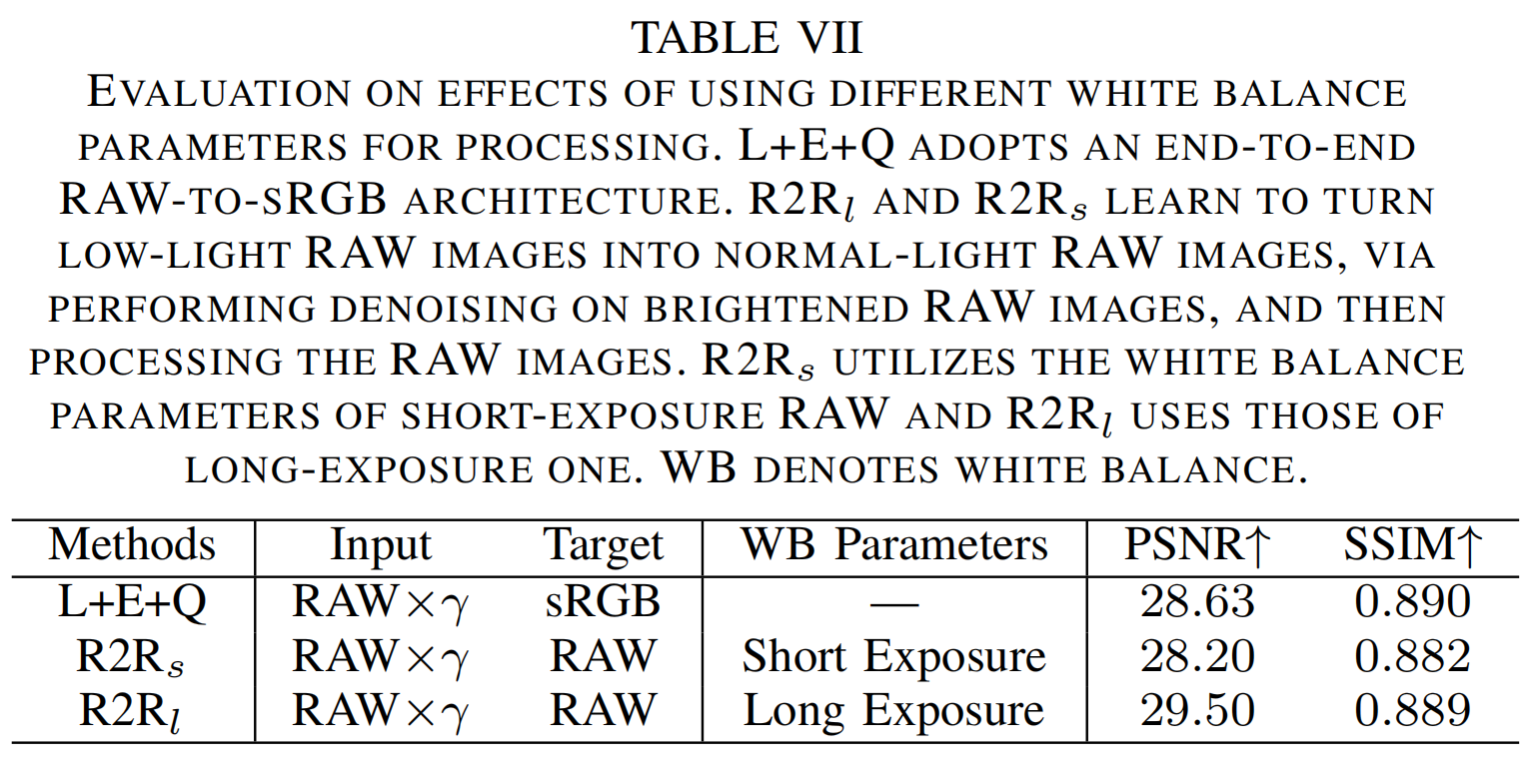

表 VII 使用不同白平衡参数进行处理的效果评估。 L+E+Q 采用端到端的 RAW-to-sRGB 架构。R2Rl_ll 和 R2RS_SS 学习将低光 RAW 图像转换为正常光 RAW 图像,具体通过对增亮后的 RAW 图像进行去噪,然后再处理该 RAW 图像。R2RS_SS 利用短曝光 RAW 的白平衡参数,而 R2Rl_ll 则使用长曝光 RAW 的白平衡参数。WB 表示白平衡(White Balance)。

我们还在表 VII 中研究了 RAW-to-RAW 方法中的相关利用,并找出了预处理能在多大程度上帮助弥合 RAW 和 sRGB 之间的差距。R2Rl{}_{l}l 和 R2Rs{}_{s}s 是两种基于 RAW-to-RAW 的方法。它们都是端到端训练的,目标是真实 RAW 数据,然后使用 Libraw 将它们处理成 sRGB 图像,Libraw 分别使用短曝光和长曝光白平衡参数。观察到,短曝光白平衡参数导致性能下降,而长曝光参数则提高了低光增强性能。性能差距来自两个原因:1) R2Rl{}_{l}l 使用与真实值相同的白平衡参数,这导致重建结果与真实值相似;2) 曝光时间会影响相机中光度测量的准确性,短曝光的光度测量相对于真实值可能不准确 [11]。

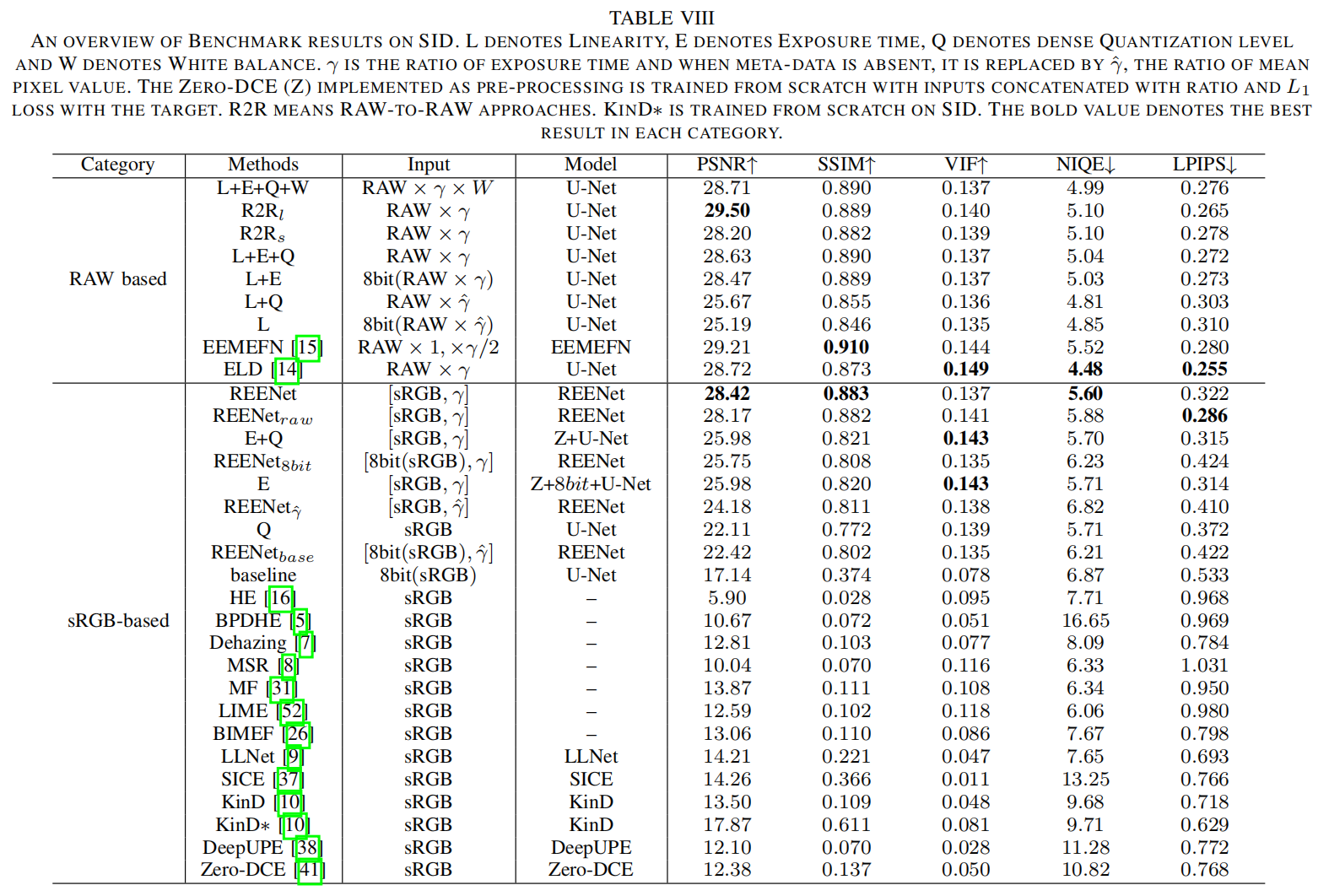

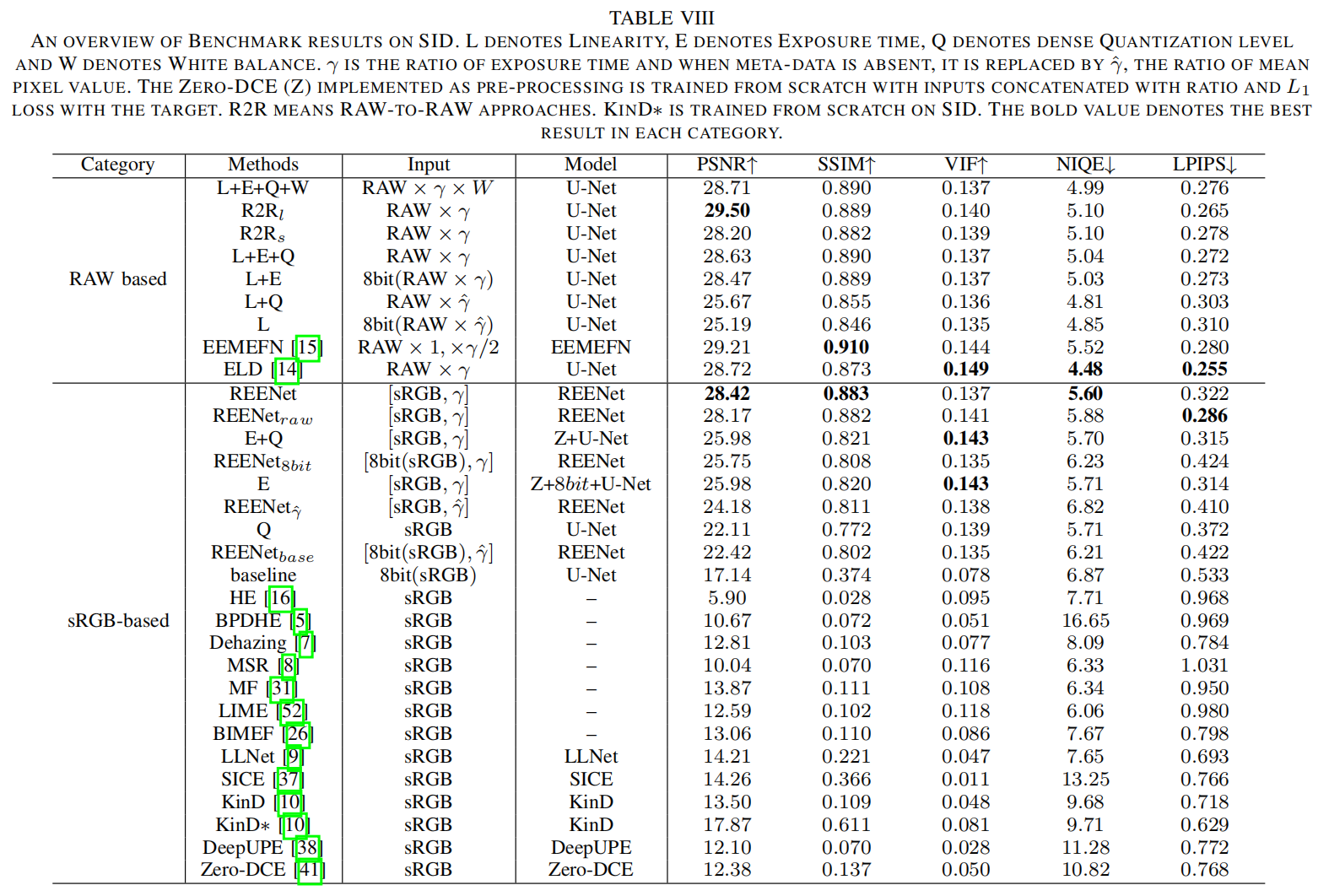

与最先进方法的比较

除了上述基线外,我们还评估了几种最先进的基于 sRGB 的方法,包括 HE [16]、Dehazing [7]、MF [31]、MSR [8]、LIME [52]、BIMEF [26]、BPDHE [5]、LLNet [9]、SICE [37]、KinD [10]、DeepUPE [38] 和 Zero-DCE [41],以及基于 RAW 的方法,包括 EEMEFN [15] 和 ELD [14],在 SID-Sony 数据集上使用各种指标(包括 PSNR、SSIM [53]、VIF [54]、NIQE [55] 和 LPIPS [56])提供了系统的基准测试结果,如表 VIII 所示。

显然,基于 RAW 的方法和基于 sRGB 的方法之间仍然存在巨大的性能差距,这主要是由于缺乏线性度 (linearity) 造成的。在基于 RAW 的方法中,配备了真实元数据的方法显示出更好的性能,而当真实曝光时间标签缺失时,性能下降很多,因为增强模型很难准确预测光照水平。白平衡和采用 Brighten then Quantize 策略的量化效果相对较小,但仍然有益于增强。在基于 sRGB 的方法中,提出的带有 RAW 引导策略的 REENet 显示出优越的性能,当某些特性缺失时,PSNR 也会下降,但其测量值仍然高于其他也以 sRGB 图像作为输入的方法。请注意,REENet8bit{}_{8bit}8bit 遵循传统路径 - Quantize then Brighten,而 E 采用 Brighten then Quantize 策略以获得更好的质量。如果对 E 采用 Quantize then Brighten,即与 REENet8bit{}_{8bit}8bit 相同的设置,PSNR 将降至 16.89 dB,如表 V 所示。

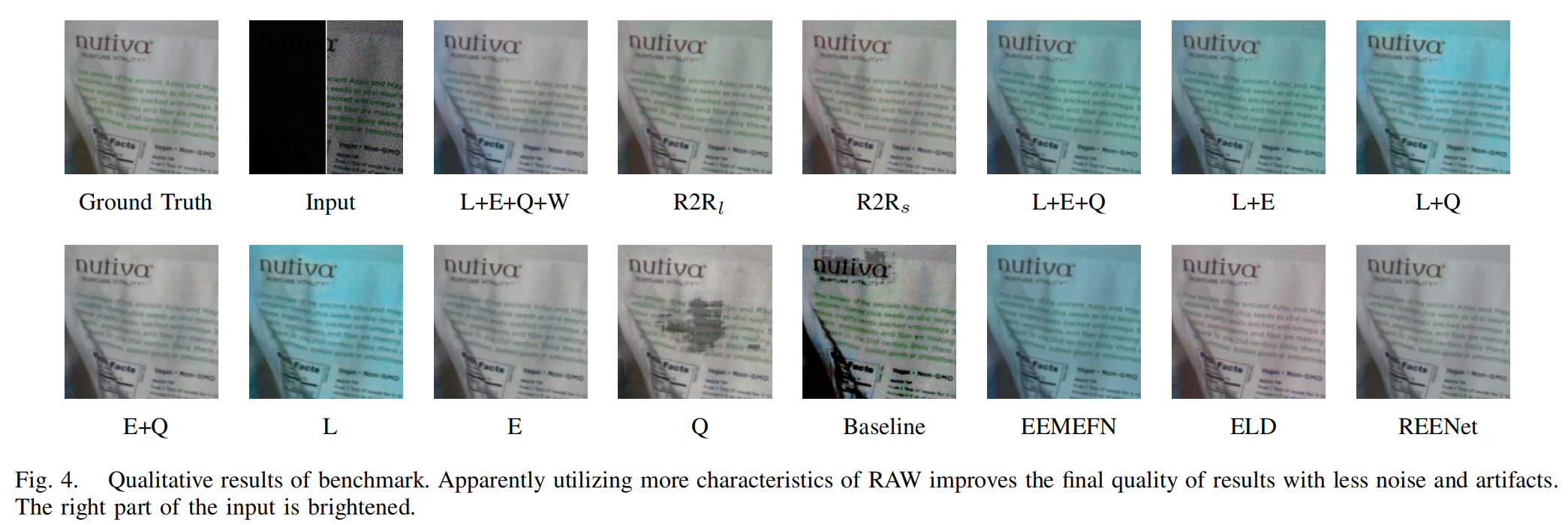

定性评估

相应的定性结果如图 4 所示,我们仅提供相对合理的结果。显然,利用白平衡参数的方法显示出准确的颜色,例如 L+E+Q+W 和 L+E+Q。注意,所有基于 sRGB 的方法都已将白平衡作为处理的一部分应用,这校正了 RGB 通道的权重。线性度和显式曝光时间导致正确的光照,例如 L+E+Q 和 L+Q,并抑制了 Q 和 baseline 中的伪影。更细粒度的量化级别使结果变化很小,例如 L+E+Q 和 L+E。如图所示,EEMEEN 的结果有明显的颜色偏差。ELD 通过使用额外的合成数据获得了更好的视觉质量。相比之下,我们的 REENet 恢复了视觉上令人愉悦的颜色和细节。注意,REENet 在测试阶段不需要 RAW 文件。

图 4: 基准测试的定性结果。显然,利用更多 RAW 特性提高了最终结果的质量,减少了噪声和伪影。输入的右侧部分被增亮了。

表VIII SID 上基准测试结果概述. L 表示线性度 (Linearity),E 表示曝光时间 (Exposure time),Q 表示密集量化级别 (dense Quantization level),W 表示白平衡 (White balance)。γ\gammaγ是曝光时间比,当元数据缺失时,用平均像素值的比值 γ^\hat{\gamma}γ^ 代替。作为预处理实现的 Zero-DCE (Z) 使用输入拼接比值以及与目标的 L1L_{1}L1 损失从头开始训练。R2R 表示 RAW-to-RAW 方法。KinD 在 SID上从头开始训练。粗体值表示每个类别中的最佳结果。

IV. REENet:RAW 引导的曝光增强网络

从基准测试结果中,可以明显观察到 RAW 文件属性在低光增强中发挥的关键作用,尤其是线性度和曝光时间。因此,我们受到启发,构建一个 RAW 引导的曝光增强网络 (REENet) 来充分利用 RAW 文件的特性,同时充分考虑 RAW 文件的优势以及如果我们不希望重建测试过程中的 ISP 流程时 RAW 图像的不可获取性。为了实现这一点,REENet 仅在训练过程中访问 RAW 图像。在训练中 RAW 图像的引导下,REENet 学习将非线性 sRGB 图像投影到线性域,这被证明是比直接在非线性域学习增强图像更好的范式。此外,考虑到逆转整个过程的困难,REENet 在线性 RGB 域中执行增强。我们采用第 III-C 节定义的线性处理来生成线性 RGB 图像。然后,借助 RAW 文件丰富的元数据和线性度,可以大大弥合 sRGB 图像和 RAW 图像之间的差距。

值得注意的是,由于低光增强任务的不适定性,完美的真实值很难定义。在 FEM 中,低光图像增强主要侧重于抑制噪声和以目标(或给定)曝光水平揭示细节信号。尽管真实值图像在提供黄金曝光水平方面可能并不完美,但用长曝光时间捕获的 RAW 图像中的丰富信息也为推导更有效的增强模型提供了有用的指导。

A. 模型架构

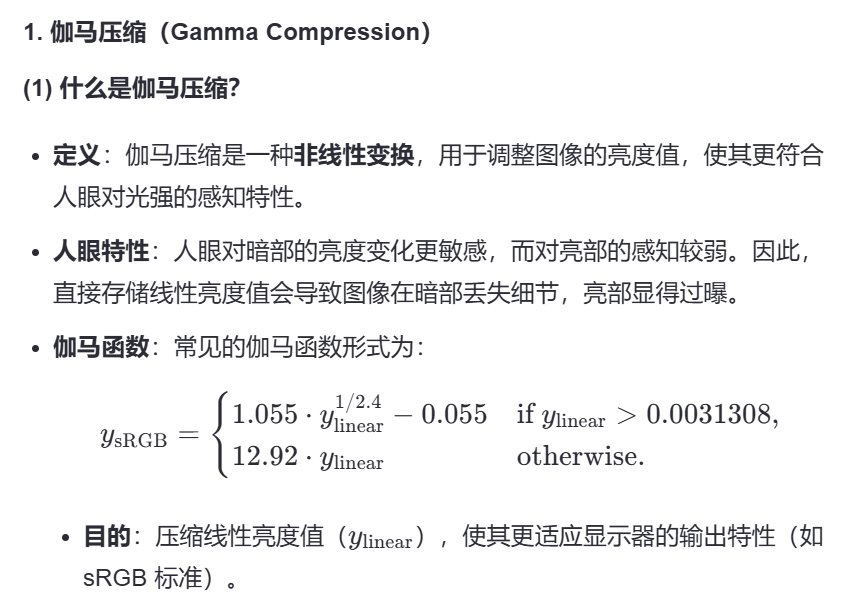

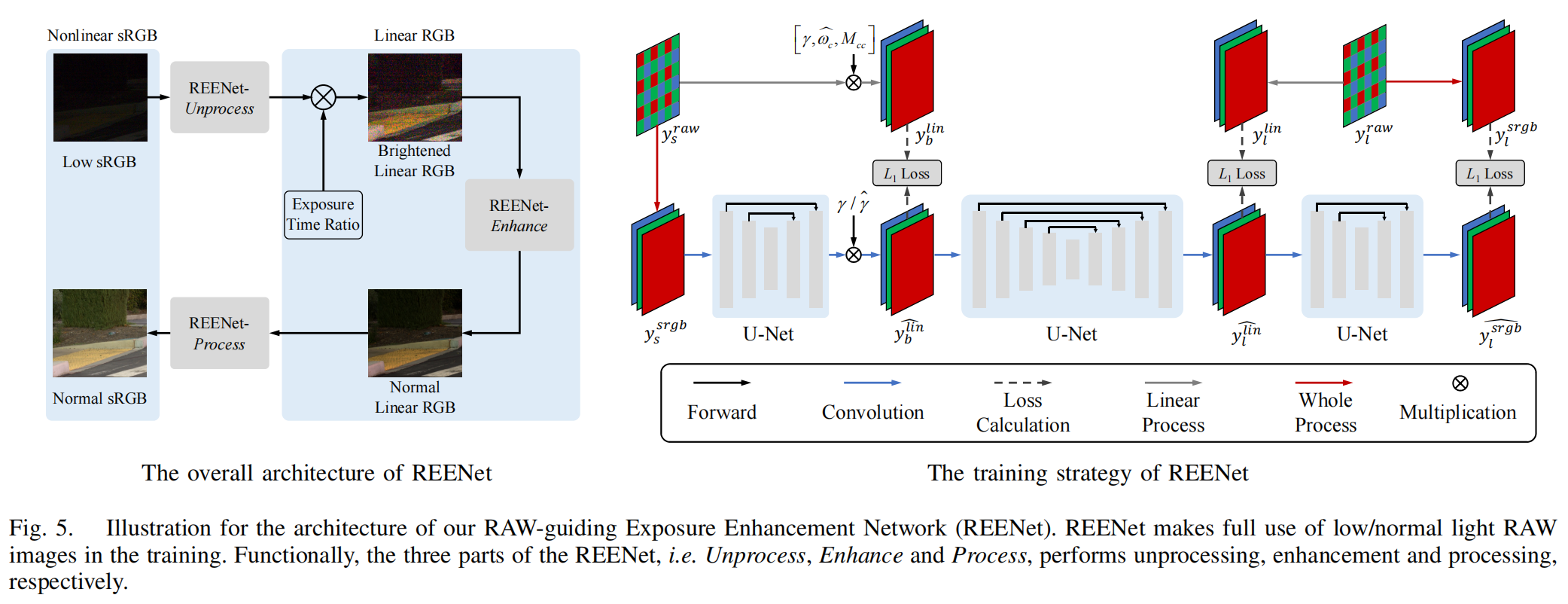

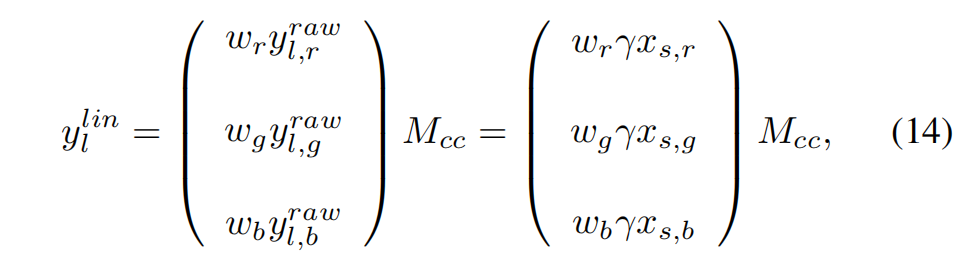

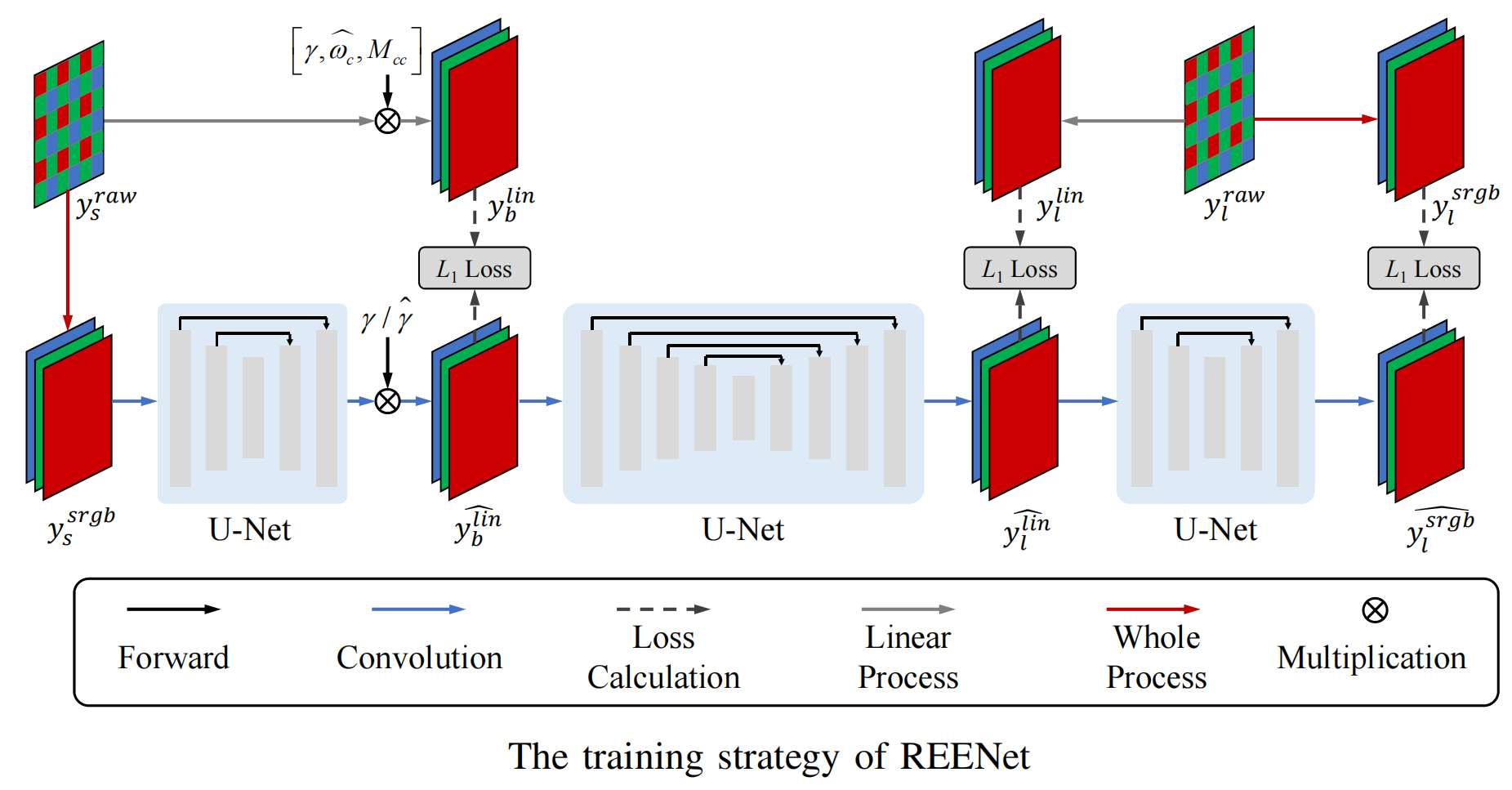

如图 5 (a) 所示。REENet 由三个子模块组成:

图 5: 我们提出的 RAW 引导曝光增强网络 (REENet) 架构示意图。REENet 在训练中充分利用低/正常光 RAW 图像。功能上,REENet 的三个部分,即反处理 (Unprocess)、增强 (Enhance) 和处理 (Process),分别执行反处理、增强和处理。

- 反处理 (Unprocess):将 sRGB 图像投影到线性 RGB 域;

- 增强 (Enhance):抑制增亮图像中的放大噪声和色彩偏差,这些图像通过乘以曝光时间比(真实值或估计值)进行调整;

- 处理 (Process):将增强结果投影回非线性 sRGB 域。

注意,虽然第 III-C 节介绍的流程是简化的,但我们开发的 Unprocess 和 Process 是灵活且通用的框架,用于在线性/非线性域之间转换信号,这有助于弥合图像处理系统中的线性域和 sRGB 域之间的差距。

-

反处理 (Unprocess):将非线性数据转移到线性域。 由于 sRGB 图像不包含元数据,传统的增强方法 [47] 通过手工方法将处理后的非线性 sRGB 图像投影回线性域。因此,设计的反演过程不可避免地与各种实际应用中的真实处理方法存在差距,导致估计不准确。如图 2 所示,当乘以曝光时间比时,这种差距可能会进一步放大。因此,为此采用了一个端到端的卷积神经网络,即 U-Net [51] σ′(⋅)\sigma^{{}^{\prime}}(\cdot)σ′(⋅)。更准确地说,给定处理后的输入 fssrgbf_{s}^{srgb}fssrgb 和线性目标 ysliny_{s}^{lin}yslin,Unprocess 旨在预测一个增亮的线性 RGB 图像:

y^blin=γ′y^slin=γ′σ^′(fssrgb),(12)\widehat{y}_{b}^{lin}=\gamma^{{}^{\prime}}\widehat{y}_{s}^{lin}= \gamma^{{}^{\prime}}\widehat{\sigma}^{{}^{\prime}}(f_{s}^{srgb}), (12)yblin=γ′yslin=γ′σ′(fssrgb),(12)其中,如果在测试阶段短曝光 RAW 图像的元数据可用,则 γ′=γ\gamma^{{}^{\prime}}=\gammaγ′=γ,否则 γ′=γ^\gamma^{{}^{\prime}}=\hat{\gamma}γ′=γ^,并且 fssrgbf_{s}^{srgb}fssrgb 是由 yssrgby_{s}^{srgb}yssrgb 量化为每像素 8 位或 16 位得到的。fssrgbf_{s}^{srgb}fssrgb 和 yssrgby_{s}^{srgb}yssrgb 之间的差距取决于量化级别的数量,其影响已在我们的实验中探讨。

-

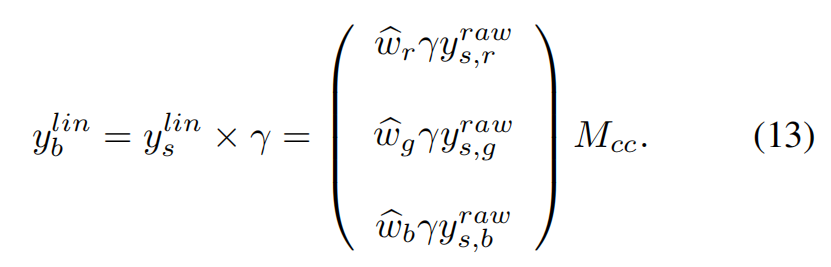

增强 (Enhance):正常光图像重建。 通过乘以曝光时间比增亮的线性 RGB 图像为:

与长曝光的线性 RGB 图像比较:

并且根据等式 (10),Enhance 的目标是抑制噪声(其噪声水平分别为 γ′2λread\gamma^{{}^{\prime}2}\lambda_{read}γ′2λread 和 γ′λshot\gamma^{{}^{\prime}}\lambda_{shot}γ′λshot),并旨在补偿由不准确的白平衡 W^\widehat{W}W 引起的色彩偏差。考虑到卷积网络在图像/视频去噪 [57, 58] 和色彩校正 [1, 11] 方面的出色建模能力,采用 U-Net 来构建 Enhance 的架构。为简单起见,我们用 g(⋅)g(\cdot)g(⋅) 表示拟合的去噪和色彩恢复过程。给定增亮的输入 yslin×γ′y_{s}^{lin}\times \gamma^{{}^{\prime}}yslin×γ′ 和长曝光的线性目标 ylliny_{l}^{lin}yllin,Enhance 旨在估计 y^llin=g^(yslin×γ′)\widehat{y}_{l}^{lin}=\widehat{g}(y_{s}^{lin}\times \gamma^{{}^{\prime}})yllin=g(yslin×γ′)。

-

处理 (Process):将线性数据转移到非线性域。 类似于 Unprocess,使用另一个 U-Net 来建模非线性过程。确切地说,给定长曝光线性输入 ylliny_{l}^{lin}yllin 和相应的非线性 sRGB 目标 ylsrgby_{l}^{srgb}ylsrgb,Process 输出 y^lsrgb=σ^(yllin)\widehat{y}_{l}^{srgb}=\widehat{\sigma}(y_{l}^{lin})ylsrgb=σ(yllin)。

总结一下,我们的 REENet 通过以下方式预测实际应用中输入的曝光时间调整结果:

y^lsrgb=σ^(g^(σ^′(yssrgb)×γ′)),(15)\widehat{y}_{l}^{srgb}=\widehat{\sigma}(\widehat{g}(\widehat{ \sigma}^{{}^{\prime}}(y_{s}^{srgb})\times \gamma^{{}^{\prime}})),(15)ylsrgb=σ(g(σ′(yssrgb)×γ′)),(15)

注意,测试阶段可以在没有 RAW 文件作为输入的情况下工作。

B. 实验结果

训练细节

在训练过程中,由 Libraw 处理的非线性低/正常光 sRGB 图像分别作为输入和真实值。RAW 图像也用作训练引导。采用 Adam 优化器 [59] 和 L1L_{1}L1 损失进行训练。Patch 大小和批量大小分别设置为 512×512 和 1。所有三个子网络的输出结果被裁剪到 [0,1]。REENet 的所有子网络都独立预训练了 3000 个 epoch。我们最初将学习率设置为 10−410^{-4}10−4,2000 个 epoch 后设置为 10−510^{-5}10−5。之后,所有子网络联合训练,学习率为 10−510^{-5}10−5,持续 1000 个 epoch。REENet 在 Intel(R)Xeon(R)E5−26502.20GHzCPUIntel(R) Xeon(R) E5-2650 2.20GHz CPUIntel(R)Xeon(R)E5−26502.20GHzCPU 和 NvidiaRTX2080TiGPUNvidia RTX 2080Ti GPUNvidiaRTX2080TiGPU 上使用 Python 和 Tensorflow 进行训练。由于输入图像具有非常大的分辨率,在测试时如果需要,我们将 4256×2848 的图像裁剪为 2128×1424 的 patch。

与常规方法比较

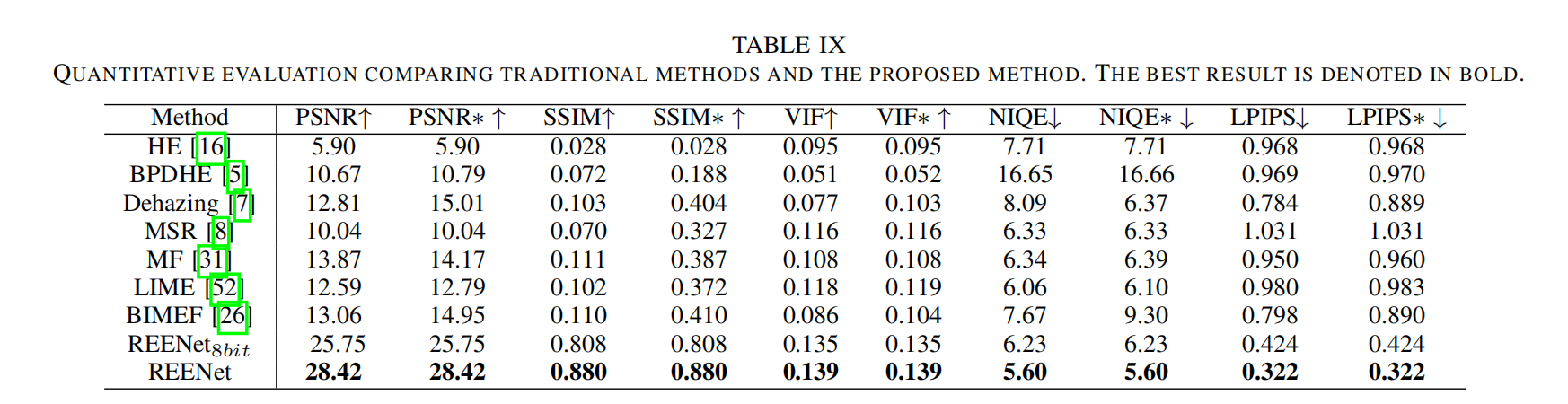

我们的方法与常规方法进行了比较:Dehazing [7]、HE [16]、MSR [8]、MF [31]、BIMEF [26]、LIME [52]、BPDHE [5]。在定量评估中,我们采用 PSNR、VIF [54]、SSIM [53] 和 LPIPS [56] 作为全参考指标,NIQE [55] 作为无参考指标。考虑到有些方法并不旨在产生目标光照,我们使用伽马校正调整这些结果的亮度,其中每张图像选择具有最佳 PSNR 的伽马曲线来产生最终结果。亮度对齐结果的分数用 ∗ 标示。比较结果呈现在表 IX 中。

表 IX 与传统方法比较的定量评估。最佳结果以粗体表示。

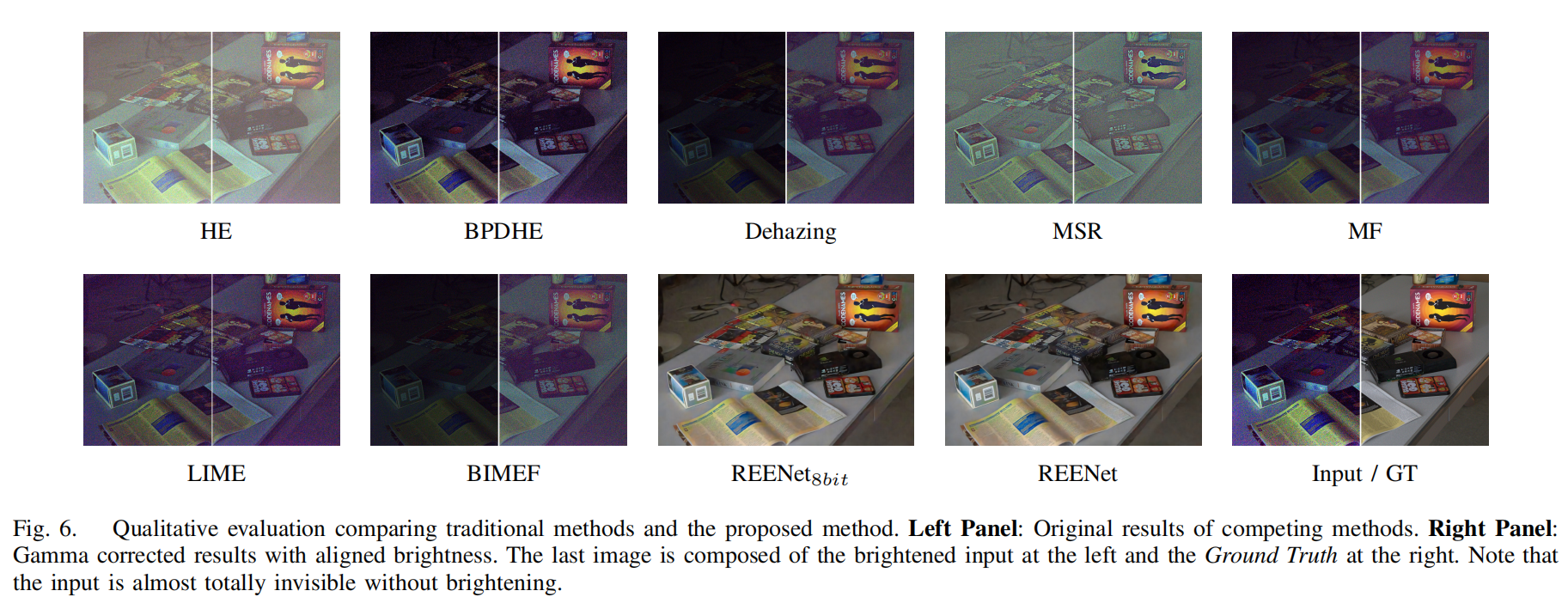

图 6 与传统方法比较的定性评估。左面板:竞争方法的原始结果。右面板:亮度对齐的伽马校正结果。最后一张图像由左侧增亮的输入和右侧的真实值 (GT) 组成。注意,不增亮时输入几乎完全不可见。

与基于学习的方法比较

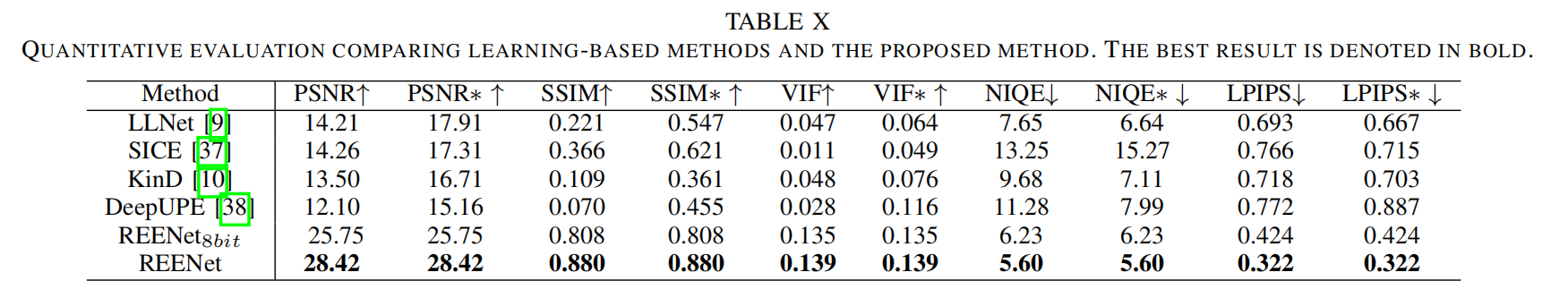

在 SID 数据集上比较了以 sRGB 低光图像作为输入的不同基于学习的方法的性能,包括 SICE [37]、LLNet [9]、DeepUPE [38] 和 KinD [10]。测试 KinD 时,增亮参数设置为允许的最大值 5.0。由于 GPU 内存限制,我们在测试 SICE 时重新缩放了输入图像的分辨率。定量结果如表 X 所示,使用相同的指标设置。

表 X 与基于学习的方法比较的定量评估。最佳结果以粗体表示。

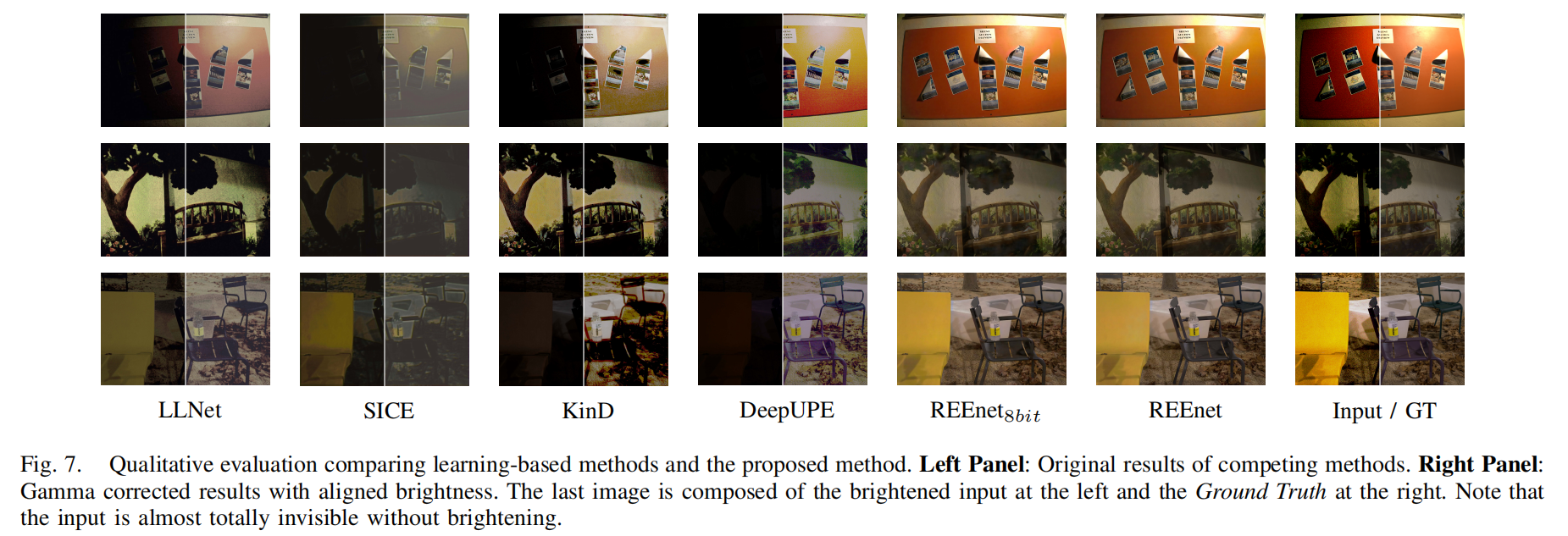

图 7 与基于学习的方法比较的定性评估。左面板:竞争方法的原始结果。右面板:亮度对齐的伽马校正结果。最后一张图像由左侧增亮的输入和右侧的真实值 (GT) 组成。注意,不增亮时输入几乎完全不可见。

结果表明,我们的 REENet 在 SID 数据集的所有指标上都优于常规方法。我们还在图 6 中展示了定性结果。可以看出,常规方法可能会均匀地增亮图像,观察到曝光不足/过度区域。此外,SID 数据集的图像曝光严重不足。因此,增强结果可能包含强烈的噪声、严重的色彩偏差或光照不足。在使用伽马校正调整亮度后,其他方法的结果中仍然存在明显的噪声和色彩偏差。

结果表明,如果所有方法在测试阶段都将处理后的 sRGB 图像作为输入,我们的 REENet 在 SID 数据集上取得了更好的结果。定性结果如图 7 所示。从图 7 可以看出,在没有比值帮助的情况下,这些方法的结果在 SID 上严重曝光不足。相比之下,我们获得了视觉上令人愉悦的结果。结果进一步证明了我们方法的优越性,并显示了曝光时间调整在帮助提高泛化增强性能方面的作用。

用户研究 (User Study)

除了全参考图像质量指标 PSNR、SSIM、VIF、LPIPS 和无参考图像质量指标 NIQE 外,我们还进一步进行了用户研究,以评估不同方法增强结果的图像质量。除了图 6 和图 7 中显示的四种情况外,还从测试集中额外选择了六种情况,总共向参与者展示了 10 种情况。每位受试者被要求从 12 个结果中选择 3 个,这些结果最能匹配目标图像(保真度 Fidelity)并具有最佳的视觉质量(美观度 Aesthetics)。共有 20 名志愿者参与了这项研究,统计了 400 次选择。如图 IV-B 所示,所提出的 REENet 在保真度和美观度方面分别获得了 32.4% 和 30.5% 的最佳平均偏好率,优于其他方法。注意,为了公平比较,我们在此使用 REENet8bit 并对齐其他方法结果的亮度。用户研究定量验证了我们方法的优越性。

消融研究 (Ablation Studies)

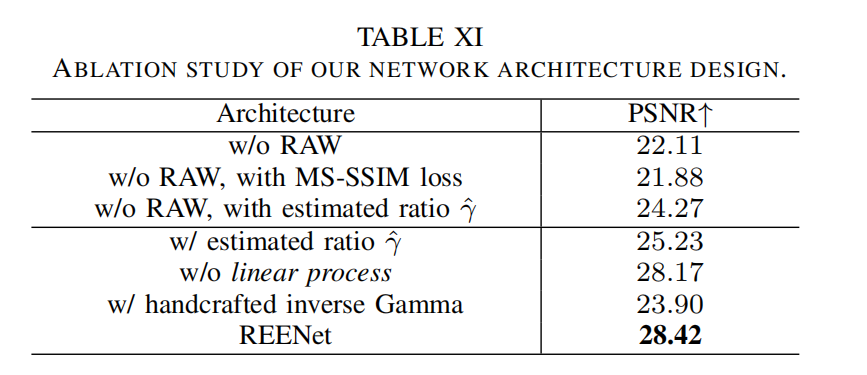

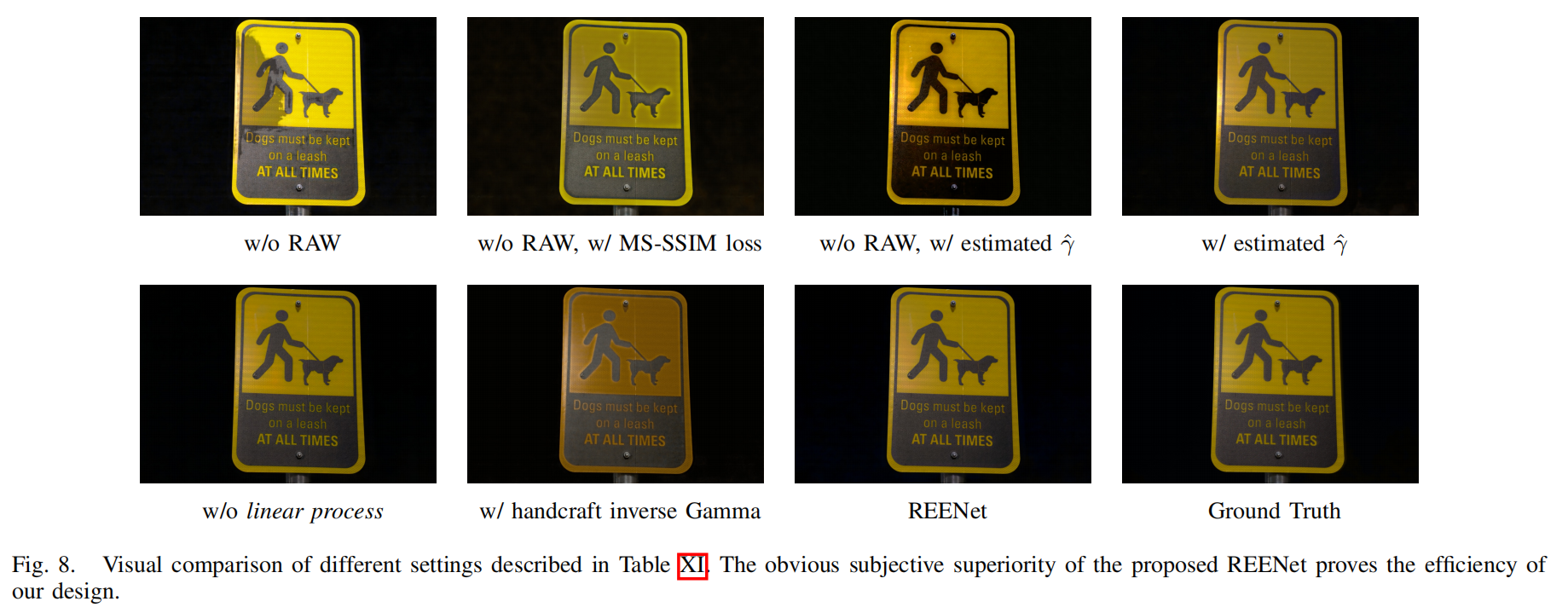

我们首先进行消融研究,以评估我们架构设计的有效性,见表 XI 和图 8。首先,我们考虑几个版本,即(前三个方法)在训练和测试中仅使用处理后的 sRGB 低/正常光对。观察到,即使使用高级损失(即 MS-SSIM)和通过平均像素值估计的曝光时间比 γ^\hat{\gamma}γ^,也获得了非常低的 PSNR。

表 XI 我们网络架构设计的消融研究。

图 8 表 XI 中描述的不同设置的视觉比较。所提出的 REENet 明显的主观优越性证明了我们设计的效率。

使用估计的曝光时间比 γ^\hat{\gamma}γ^ 代替真实值的实验证明了利用元数据的效果。使用原始 RAW 图像的结果反映了采用线性预处理 RAW 图像的重要性。我们可以看到指标的下降,因为所采用的线性处理 (linear process) 在弥合 RAW 图像和处理后的 sRGB 图像之间的差距方面是有效的,这有助于降低模拟整个处理系统的难度。使用手工制作的反伽马算法 [60] 代替 U-Net 作为 Unprocess 模块也会导致性能下降,因为反处理在处理极端黑暗条件时变得不够灵活和有效。

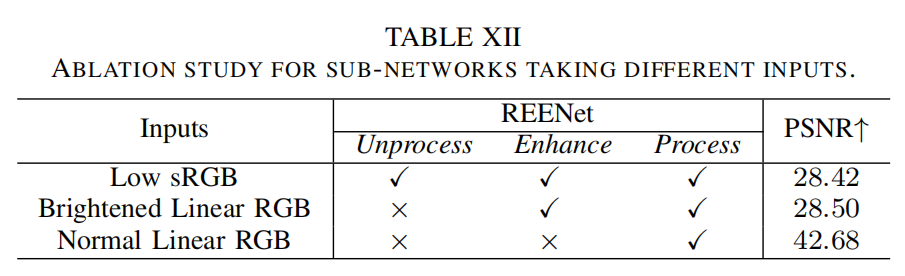

每个子网的定量结果也在表 XII 中提供。这些子网之间的差距显示了我们设计中不同阶段如何影响增强性能。从结果中观察到,Unprocess 和 Process 致力于精确的非线性映射,这导致了指标上的小幅性能下降。第 1-2 行和第 3 行之间的巨大差距表明,从被强烈噪声和色彩偏差严重退化的增亮图像中预测正常光线性 RGB 图像是相当具有挑战性的。

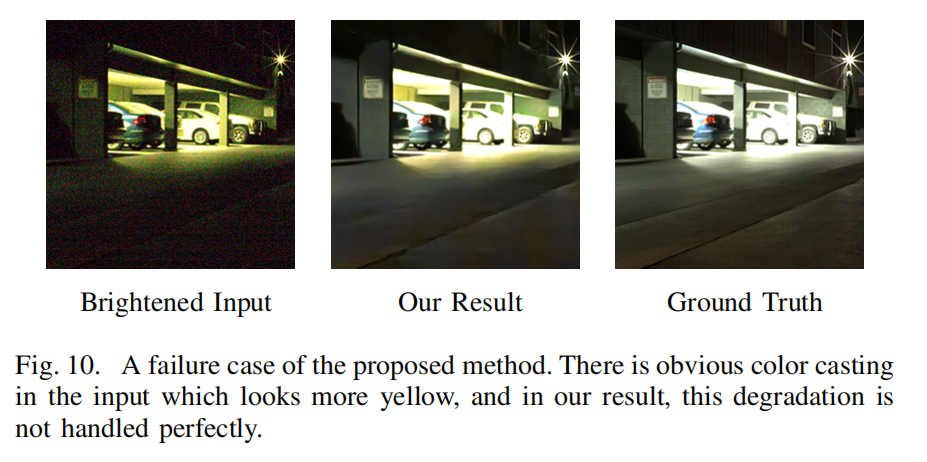

失败案例 (Failure Case)

我们方法的一个失败案例如图 10 所示。一旦输入图像严重退化并带有色彩偏差,提出的 REENet 可以有效地增强光照并抑制噪声,但仍然存在明显的色彩偏差。

局限性 (Limitations)

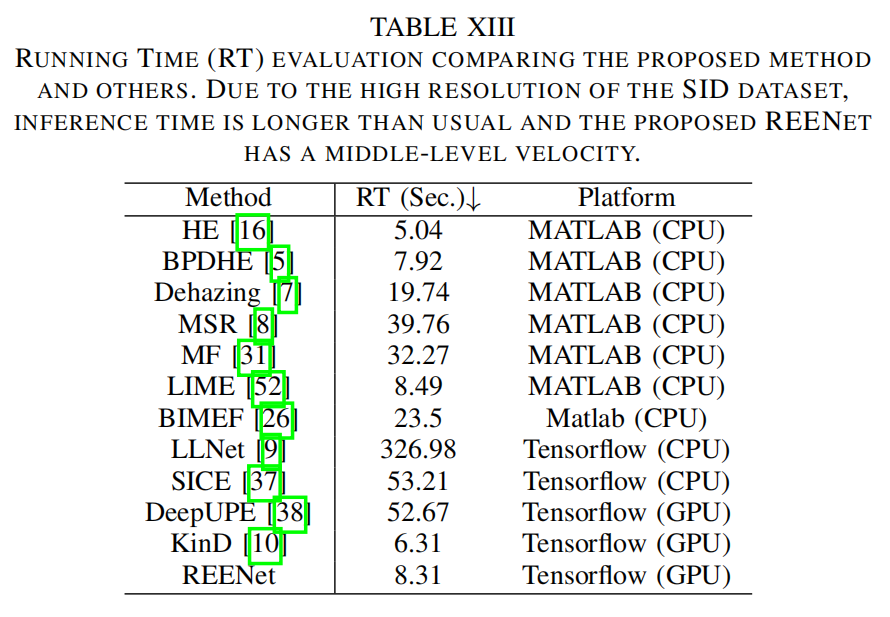

我们比较了不同方法的运行时间,如表 XIII 所示。注意,如果代码支持,我们采用 GPU 来加速运行方法。由于 SID 数据集的高分辨率,推理时间较长,提出的 REENet 具有中等水平的运行时间消耗。

此外,由于在极暗环境中捕获的图像中存在高度相机特定的强烈噪声以及 ISP 的多样性,当直接应用于从另一个相机捕获的低光图像(其噪声模型远离我们的训练集)时,我们的 REENet 无法保证有希望的性能。我们将在未来的工作中解决这个问题。

V. 结论

在本文中,我们首次进行了基准研究工作,详细研究了 RAW 在低光增强中的优越性。详细阐述了 RAW 文件的特性,即线性度、访问元数据、细粒度信息(更丰富的强度和颜色)、显示不便和缺乏效率,并通过定量结果说明了它们对低光增强的影响。为了公平评估,我们采用了一种新颖的视角,在因子化增强模型 (FEM) 中看待低光增强,并获得了一个精确且明确的描述,将该任务的模糊性分解为几个可测量的因子。基于从基准测试结果中获得的有用见解,提出的 REENet 采用 RAW 引导策略,克服了 sRGB 图像的非线性和在许多应用中 RAW 图像不可用所带来的问题,并优于许多最先进的基于 sRGB 的方法。我们的框架仅在训练阶段需要使用 RAW 图像,并在测试时仅需 sRGB 输入即可提供更好的结果,因此我们的结果在训练中尽可能多地吸收了 RAW 的信息,但在实际应用中不依赖于 RAW 输入和调整 ISP 过程。实验结果展示了我们方法的优越性能和我们模型设计的合理性。