DeepSeek R1-0528:深度思考能力的重大跃升与技术突破全解析

引言

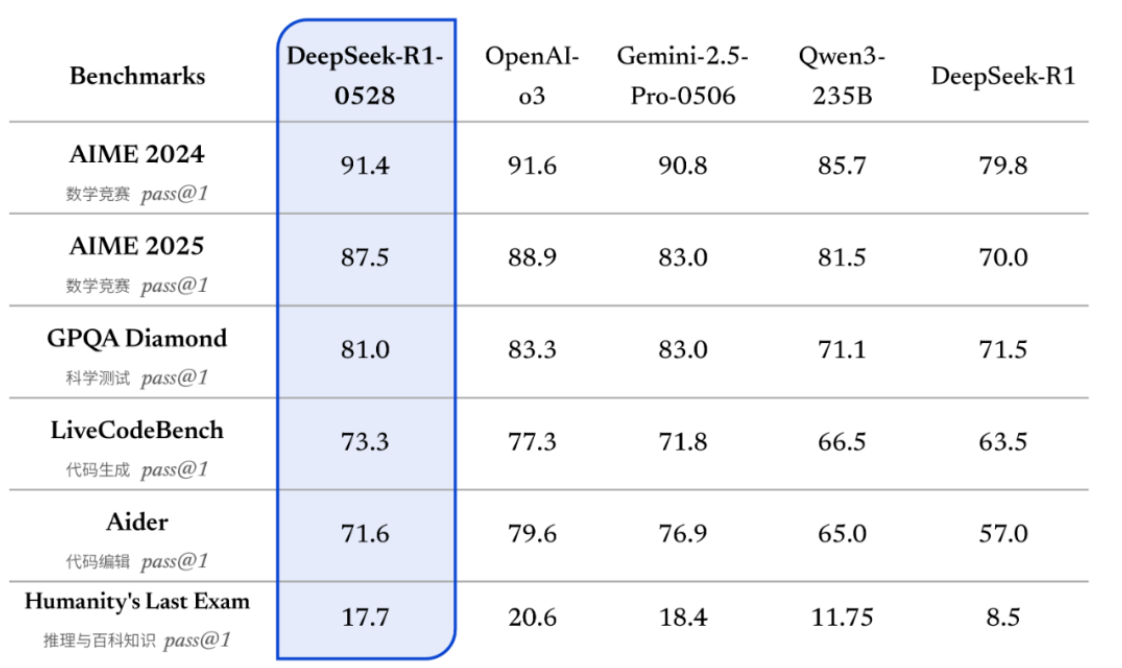

2025年5月28日,DeepSeek再次以其标志性的"深夜发布"方式,悄然推出了R1模型的最新版本——DeepSeek-R1-0528。这次被官方定义为"小版本升级"的更新,实际上带来了令人瞩目的性能提升。新版本不仅在数学、编程与通用逻辑等多个基准测评中取得了国内模型的领先地位,更在整体表现上接近了OpenAI o3和Gemini-2.5-Pro等国际顶尖模型。本文将深入解析这次更新的核心技术改进、性能提升以及对AI行业的深远影响。

技术架构的深度优化

基座模型与后训练强化

DeepSeek-R1-0528延续了其前代版本的技术路线,仍然使用2024年12月发布的DeepSeek V3 Base模型作为基座。然而,这次更新的关键在于后训练过程中投入了更多算力资源,显著提升了模型的思维深度与推理能力。这种策略体现了DeepSeek对技术精进的执着追求,通过优化训练方法而非简单增加参数规模来实现性能突破。

思维链的革命性改进

新版本在思维链处理方面实现了质的飞跃。以AIME 2025测试为例,旧版模型平均每题使用12K tokens,而新版模型平均每题使用23K tokens,几乎翻倍的token使用量表明模型在解题过程中进行了更为详尽和深入的思考。这种改进直接反映在准确率上:AIME 2025测试中,新版模型准确率从旧版的70%提升至87.5%,提升幅度达到17.5个百分点。

核心能力的全面提升

深度思考能力的显著增强

DeepSeek-R1-0528在复杂推理任务中展现出了前所未有的能力。模型在数学、编程与通用逻辑等多个基准测评中均取得了当前国内所有模型中首屈一指的优异成绩。这种提升不仅体现在准确率上,更重要的是模型展现出了更深层次的思维过程和逻辑推理能力。

幻觉问题的大幅改善

在AI模型的实际应用中,"幻觉"问题一直是困扰用户的重要障碍。新版DeepSeek R1针对这一问题进行了专门优化,在改写润色、总结摘要、阅读理解等场景中,幻觉率降低了45~50%左右。这一显著改进使得模型能够提供更为准确、可靠的结果,大大提升了实用性。

创意写作能力的优化升级

在创意写作方面,DeepSeek-R1-0528也实现了重要突破。模型针对议论文、小说、散文等文体进行了进一步优化,能够输出篇幅更长、结构内容更完整的长篇作品,同时呈现出更加贴近人类偏好的写作风格。这种改进让模型的输出更加自然,减少了之前版本中存在的"量子力学元素"等不自然表达。

工具调用与多模态能力

Function Calling功能的集成

DeepSeek-R1-0528新增了工具调用功能支持,虽然不支持在thinking过程中进行工具调用,但这一功能的加入显著扩展了模型的应用场景。在Tau-Bench测评中,模型取得了airline 53.5%、retail 63.9%的成绩,与OpenAI o1-high相当,虽然与o3-High以及Claude 4 Sonnet仍有差距,但已经展现出了强劲的竞争实力。

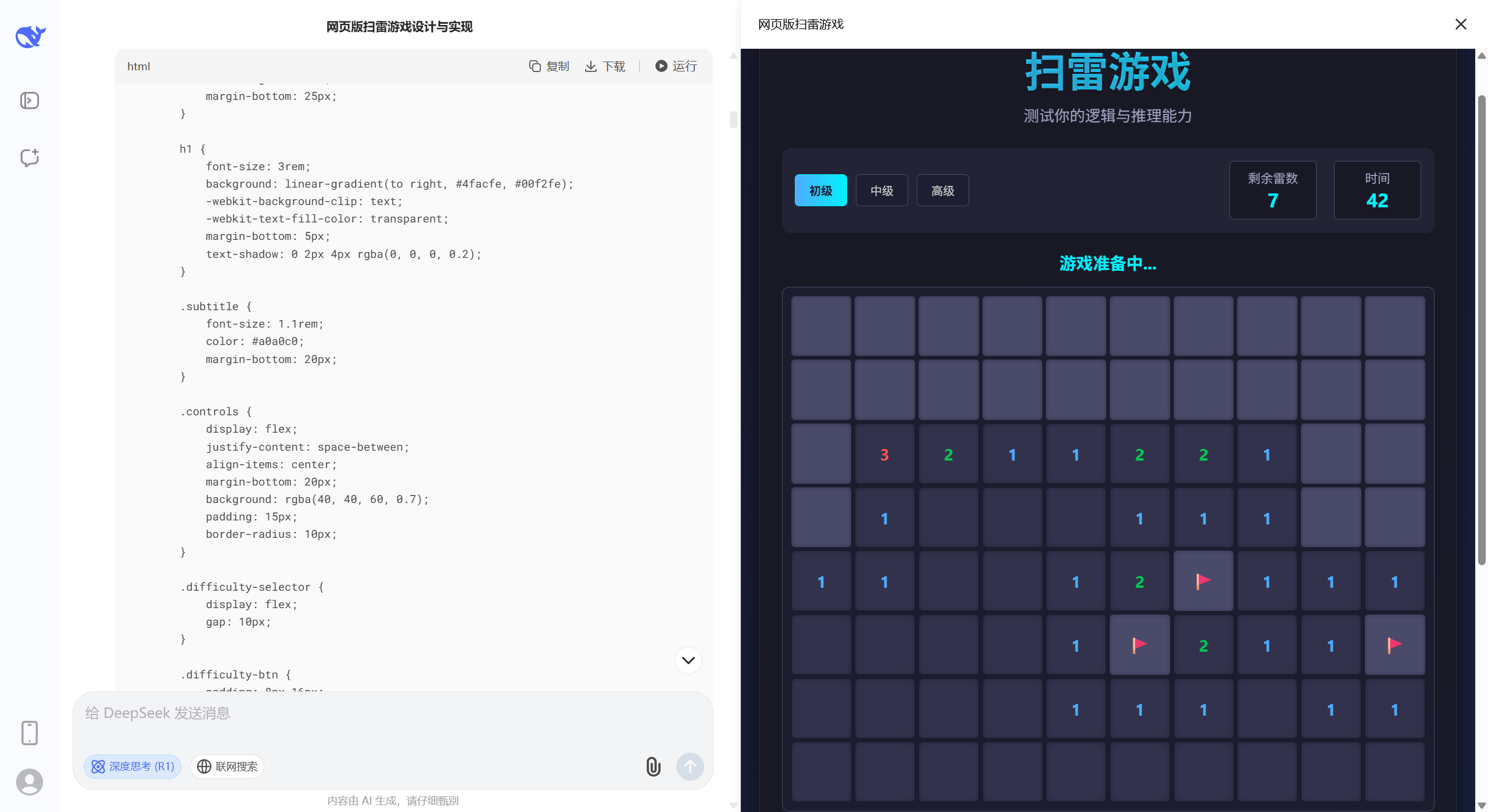

前端开发能力的提升

在前端代码生成方面,DeepSeek-R1-0528展现出了令人印象深刻的能力。模型能够使用HTML/CSS/JavaScript开发现代简约风格的应用程序,生成的代码不仅功能完整,而且设计美观,充分体现了模型在理解用户需求和技术实现方面的进步。下面是我再网页端调用DeepSeek-R1-0528轻松开发扫雷游戏的案例。

开源生态与技术传承

知识蒸馏的创新应用

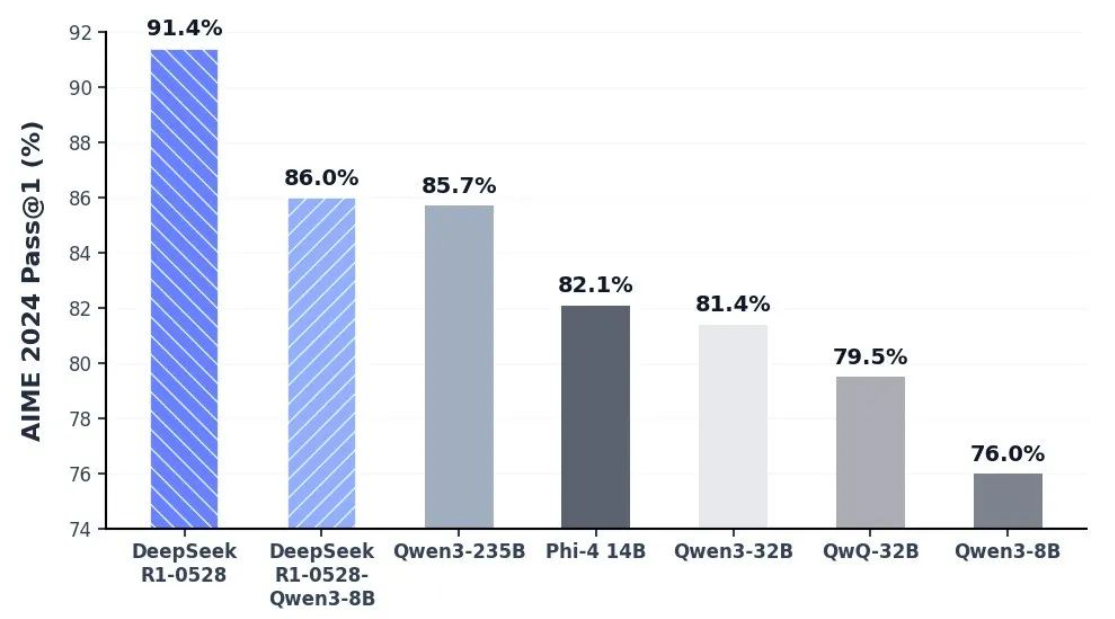

DeepSeek团队通过蒸馏DeepSeek-R1-0528的思维链后训练Qwen3-8B Base,得到了DeepSeek-R1-0528-Qwen3-8B。这个8B参数的小模型在数学测试AIME 2024中仅次于DeepSeek-R1-0528,超越了Qwen3-8B(+10.0%),与Qwen3-235B相当。这一成果充分证明了DeepSeek-R1-0528思维链对于学术界推理模型研究和工业界小模型开发的重要意义。

MIT License的开放策略

与旧版本的DeepSeek-R1保持一致,此次开源仓库(包括模型权重)仍然统一采用MIT License,并允许用户利用模型输出、通过模型蒸馏等方式训练其他模型。这种开放的许可证政策对整个AI开源生态的发展起到了重要的推动作用,体现了DeepSeek对开源社区的持续贡献。

API更新与技术细节

参数调整与功能增强

API已同步更新,接口与调用方式保持不变,确保了向后兼容性。新版R1 API不仅支持查看模型思考过程,还增加了Function Calling和JsonOutput的支持。值得注意的是,官方对max_tokens参数的含义进行了调整:现在max_tokens用于限制模型单次输出的总长度(包括思考过程),默认为32K,最大为64K。

上下文长度的灵活配置

本次R1更新后,官方网站、小程序、App端和API中的模型上下文长度仍为64K。对于需要更长上下文长度的用户,可以通过第三方平台调用上下文长度为128K的开源版本R1-0528模型,这种灵活的配置方案满足了不同用户的需求。

部署与实施便利性

私有化部署的简化流程

DeepSeek-R1-0528与之前的DeepSeek-R1使用同样的base模型,仅改进了后训练方法。这意味着私有化部署时只需要更新checkpoint和tokenizer_config.json(tool calls相关变动),大大简化了升级流程。模型参数为685B(其中14B为MTP层),开源版本上下文长度为128K。

多平台支持与获取方式

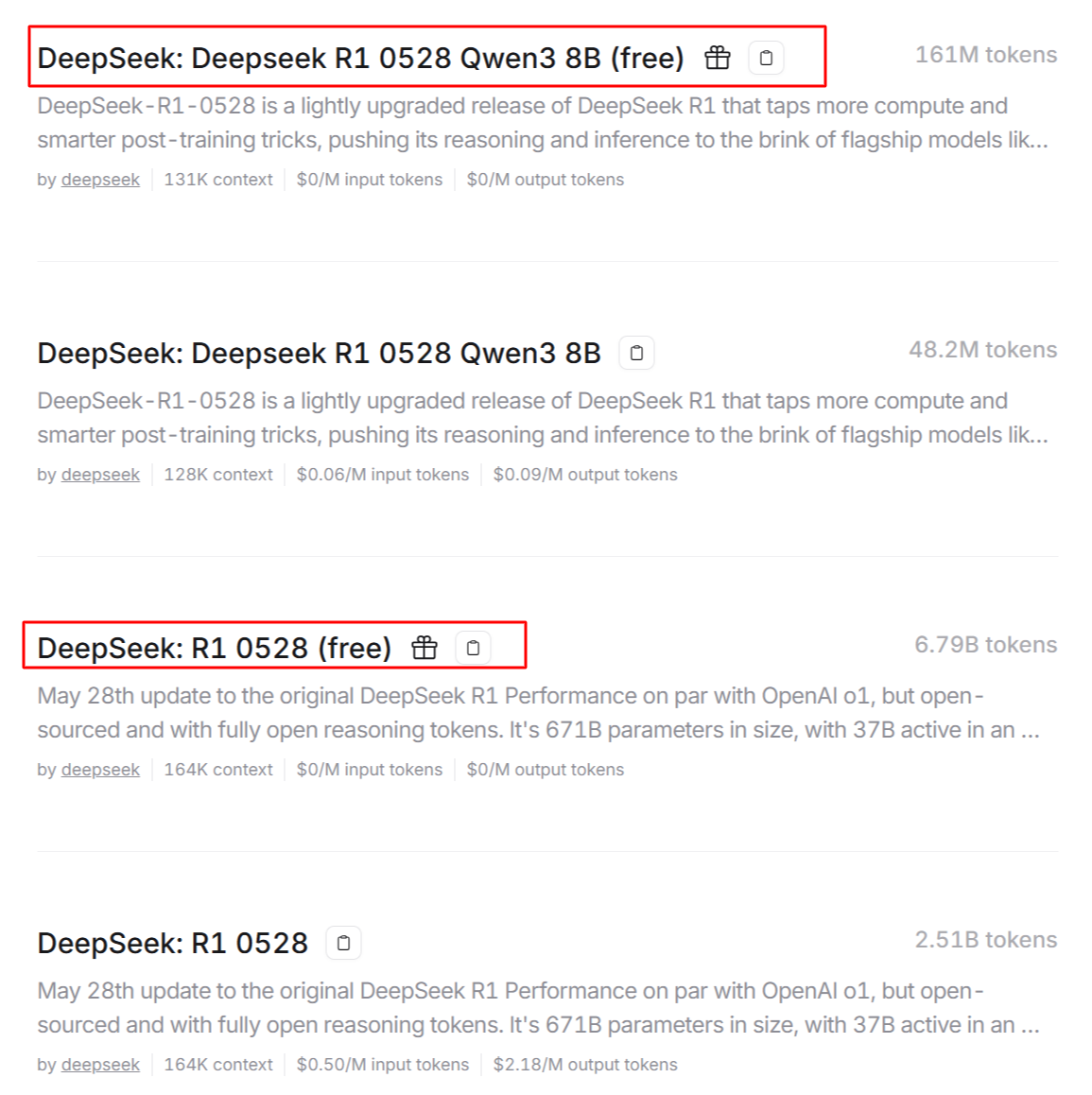

用户可以通过多个平台获取DeepSeek-R1-0528模型权重,包括Model Scope和Huggingface等主流平台。这种多渠道分发策略确保了全球用户都能便捷地获取和使用最新版本的模型。我最常用的模型API供应商OpenRouter也第一时间将DeepSeek-R1-0528添加到模型库中,而且还有免费的选项可以调用。

行业影响与未来展望

开源模型的竞争力提升

DeepSeek-R1-0528的发布再次证明了开源模型在与商业模型竞争中的强大潜力。通过持续的技术优化和创新,开源模型不仅能够达到商业模型的性能水平,还能在某些特定领域实现超越。这种发展趋势对整个AI行业具有重要的启示意义。

技术民主化的推进

通过开源策略和合理的API定价,DeepSeek降低了高性能AI模型的使用门槛,推进了AI技术的民主化进程。这不仅有利于中小企业和个人开发者,也为AI技术在更广泛领域的应用创造了条件。

中国AI技术的全球影响

DeepSeek-R1-0528的成功发布,再次展现了中国AI技术在全球舞台上的强劲实力。从技术创新到开源贡献,中国AI企业正在以实际行动证明其在全球AI发展中的重要地位。

结论

DeepSeek-R1-0528的发布标志着AI推理模型发展的一个重要里程碑。通过深度优化后训练过程,模型在思维深度、推理能力、幻觉控制等多个维度实现了显著提升。特别是在AIME 2025测试中准确率从70%提升至87.5%的突破性表现,充分证明了技术优化的巨大潜力。

这次更新不仅为开发者提供了更强大的工具,为用户带来了更好的体验,更重要的是为整个AI行业展示了开源模型的巨大潜力。通过持续的技术创新和开放的生态建设,DeepSeek正在引领AI技术向更加民主化、实用化的方向发展。

随着AI技术的快速发展,我们有理由相信,像DeepSeek-R1-0528这样的技术突破将继续推动AI在各个领域的深入应用,为人类社会的进步贡献更大的力量。