LLama-Factory使用教程-2025最新版

配套课程《AIGC大模型理论与工业落地实战》;Deepseek相关课程更新中

前置条件:一台可用的gpu服务器、ubuntu操作系统

1. 下载LLama-Factory

1.1. 安装anaconda或者miniconda,创建环境

bash Miniconda3-latest-Linux-x86_64.sh

conda create -n sft python=3.11

conda activate sft1.2. 下载安装LLama-Factory

git clone --depth 1 https://github.com/hiyouga/LLaMA-Factory.git

cd LLaMA-Factory

pip install -e ".[torch,metrics]"2. 启动LLama-Factory图形化界面

llamafactory-cli webui3. 打开图形化界面

访问http://127.0.0.1:7860;或者”服务器IP地址+7860端口”。例如这里的是:http://180.184.146.134:7860/;打开图形化界面

4.下载模型到本地

这里以Qwen2.5-vl-7b-instruct模型为例,因为服务器是国内,从魔塔下载模型参数:

pip install modelscope

modelscope download --model Qwen/Qwen2.5-VL-7B-Instruct --local_dir /data2/users/yszhang/quickllm/qwen2.5-vl-instruct执行上述指令后,模型参数被下载至:/data2/users/yszhang/quickllm/qwen2.5-vl-instruct文件夹:

(base) root@iv-ydg6wcq3ggay8n6dmn75:/data2/users/yszhang/quickllm/qwen2.5-vl-instruct# ll

total 16207084

drwxr-xr-x 3 root root 4096 May 13 09:36 ./

drwxr-xr-x 22 root root 4096 May 26 17:44 ../

drwxr-xr-x 3 root root 4096 May 12 16:36 .cache/

-rw-r--r-- 1 root root 1050 May 12 16:36 chat_template.json

-rw-r--r-- 1 root root 1374 May 12 16:36 config.json

-rw-r--r-- 1 root root 216 May 12 16:36 generation_config.json

-rw-r--r-- 1 root root 1519 May 12 16:39 .gitattributes

-rw-r--r-- 1 root root 1671839 May 13 09:23 merges.txt

-rw-r--r-- 1 root root 3900233256 May 13 09:31 model-00001-of-00005.safetensors

-rw-r--r-- 1 root root 3864726320 May 13 09:36 model-00002-of-00005.safetensors

-rw-r--r-- 1 root root 3864726424 May 12 17:22 model-00003-of-00005.safetensors

-rw-r--r-- 1 root root 3864733680 May 13 09:31 model-00004-of-00005.safetensors

-rw-r--r-- 1 root root 1089994880 May 13 09:26 model-00005-of-00005.safetensors

-rw-r--r-- 1 root root 57619 May 12 16:36 model.safetensors.index.json

-rw-r--r-- 1 root root 350 May 12 16:36 preprocessor_config.json

-rw-r--r-- 1 root root 18574 May 12 16:36 README.md

-rw-r--r-- 1 root root 5702 May 12 17:30 tokenizer_config.json

-rw-r--r-- 1 root root 7031645 May 12 16:40 tokenizer.json

-rw-r--r-- 1 root root 2776833 May 13 09:23 vocab.json

(base) root@iv-ydg6wcq3ggay8n6dmn75:/data2/users/yszhang/quickllm/qwen2.5-vl-instruct# 5. 配置模型和数据

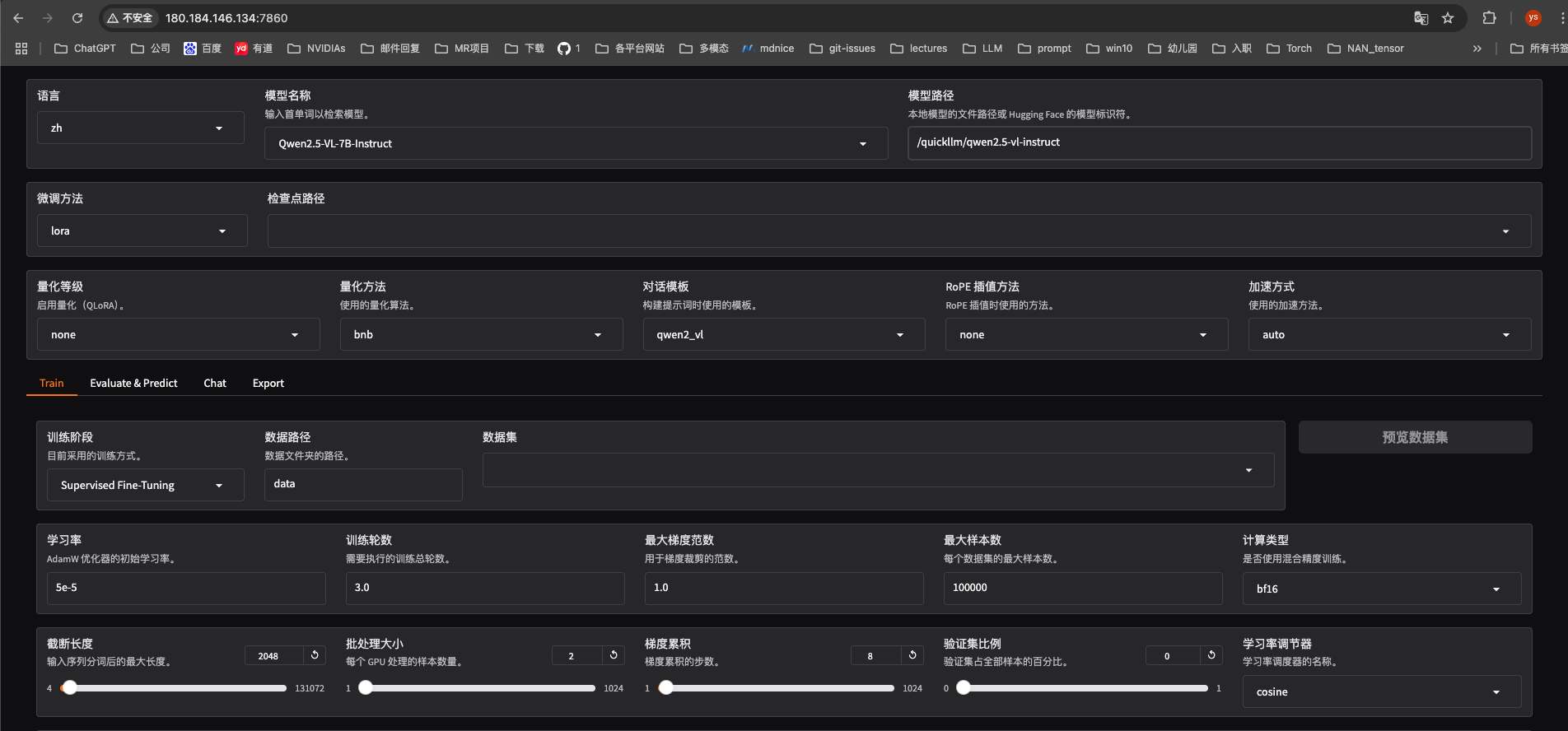

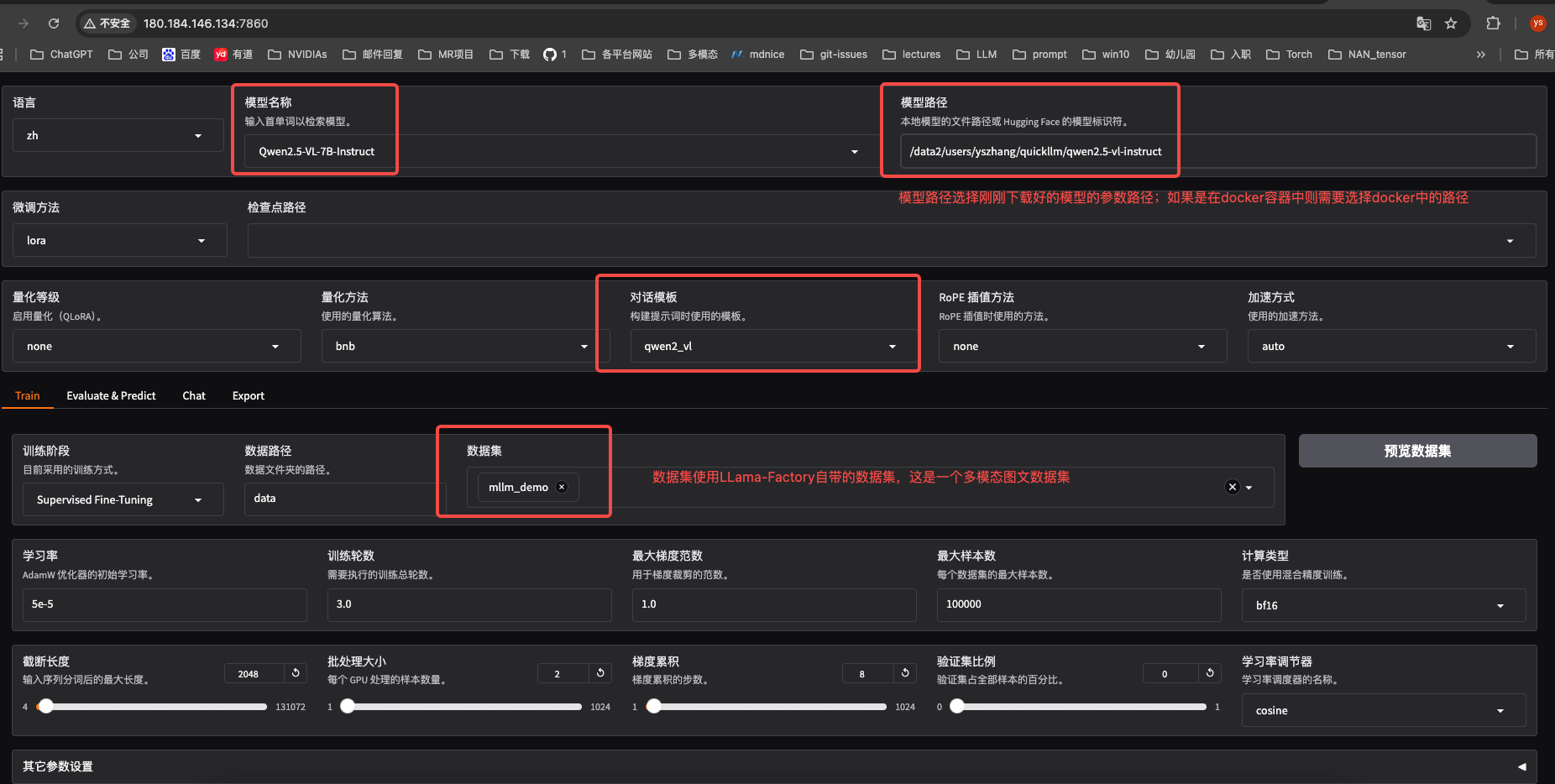

在图形化UI界面设置模型名称、模型路径和数据集,这里我以LLama-Factory中自带的多模态数据集“mllm_demo”数据集为例:

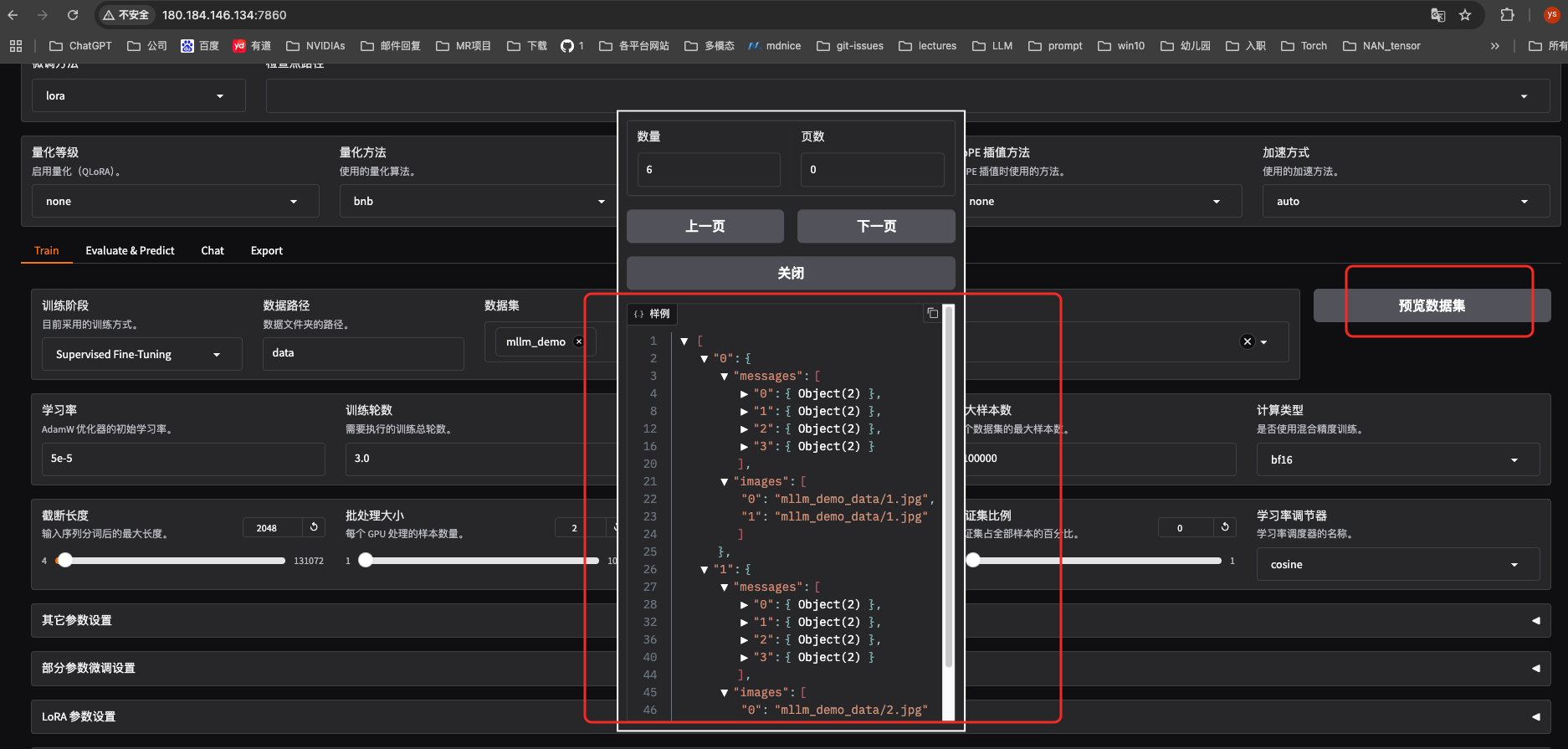

可以选择预览数据集,预览数据结构:

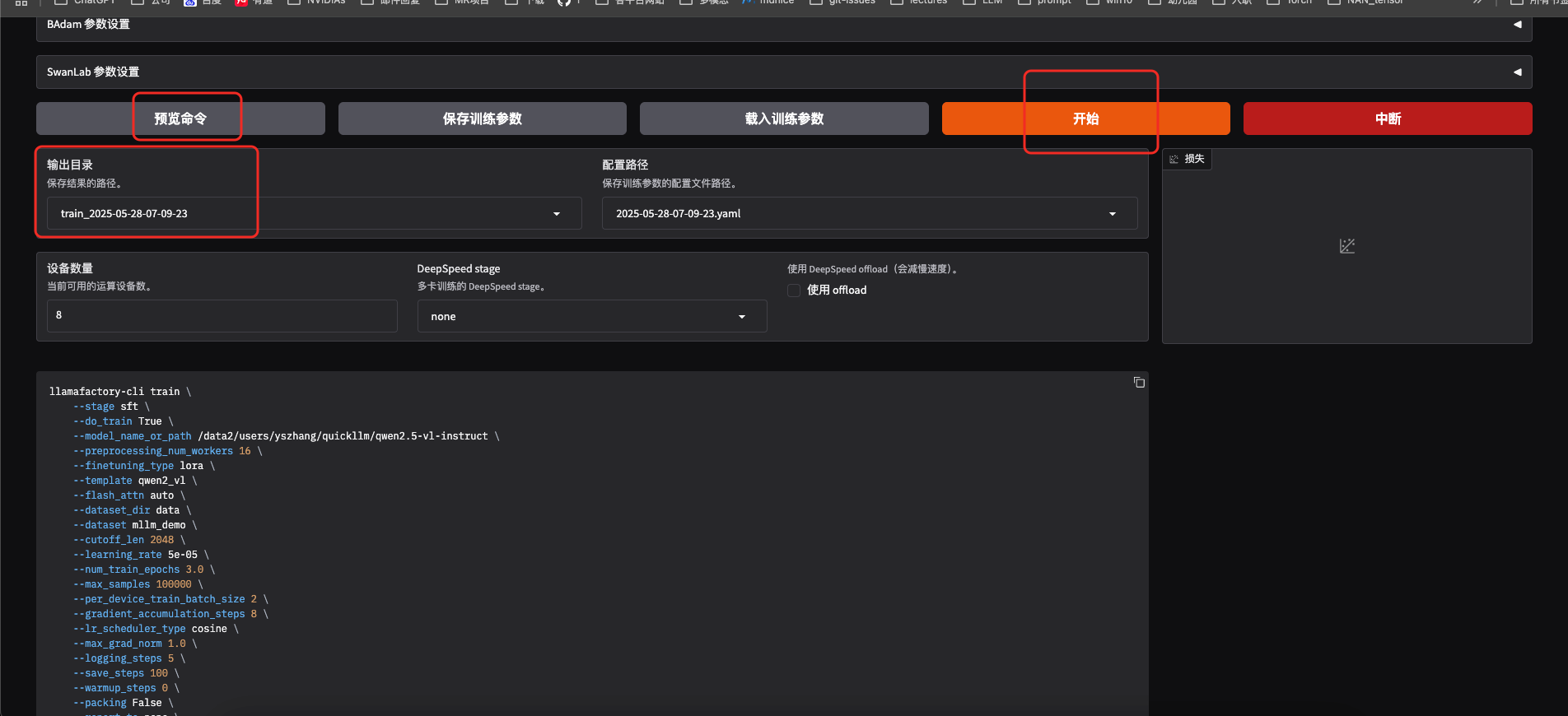

可以选择预览命令查看模型训练的实际指令,输出目录可以选择默认以时间戳命名的路径,确认没问题后点“开始”即可开始训练

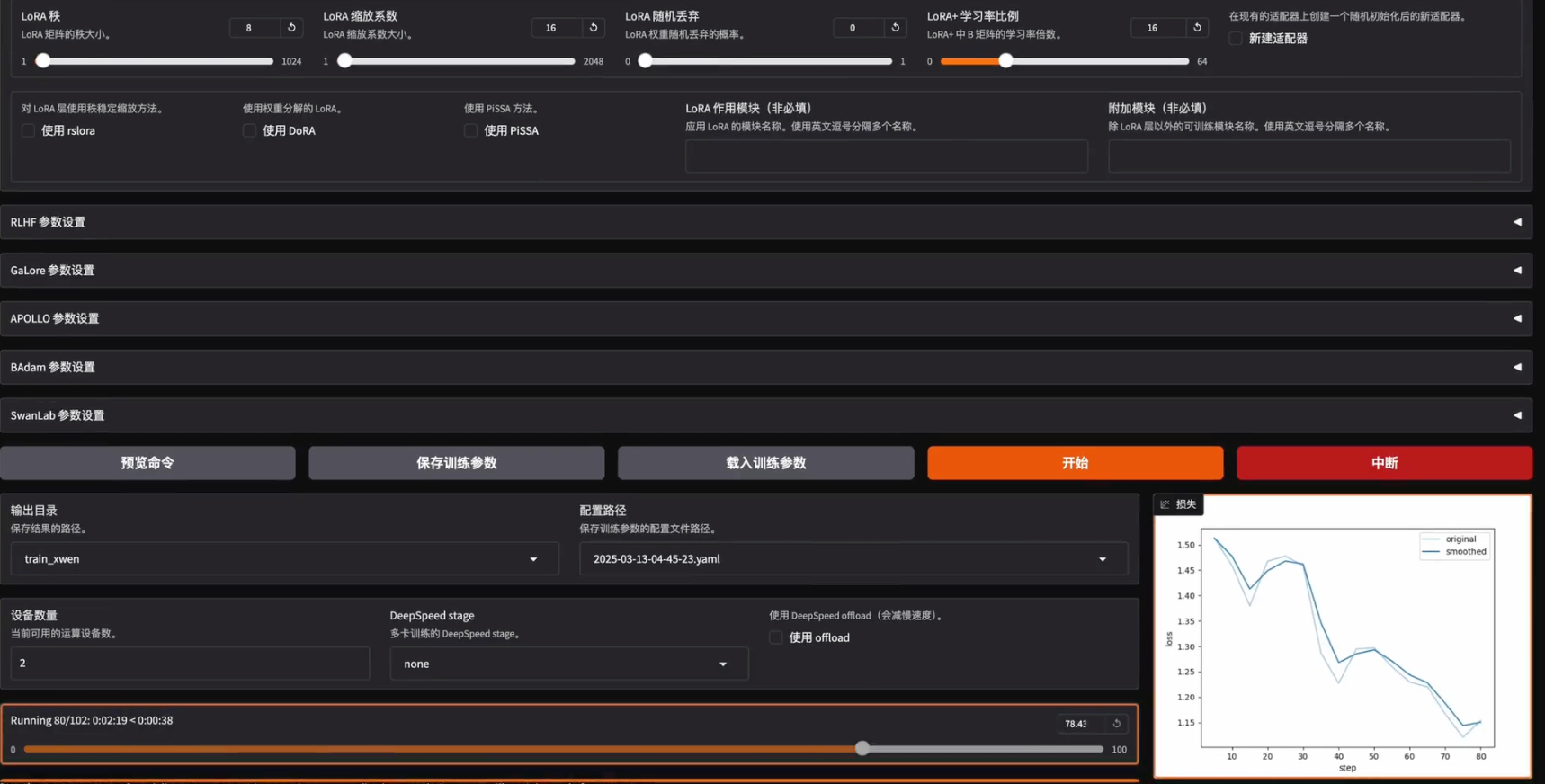

训练时,在右下角可以实时查看loss下降的曲线,非常直观和方便:

6. 对话模型

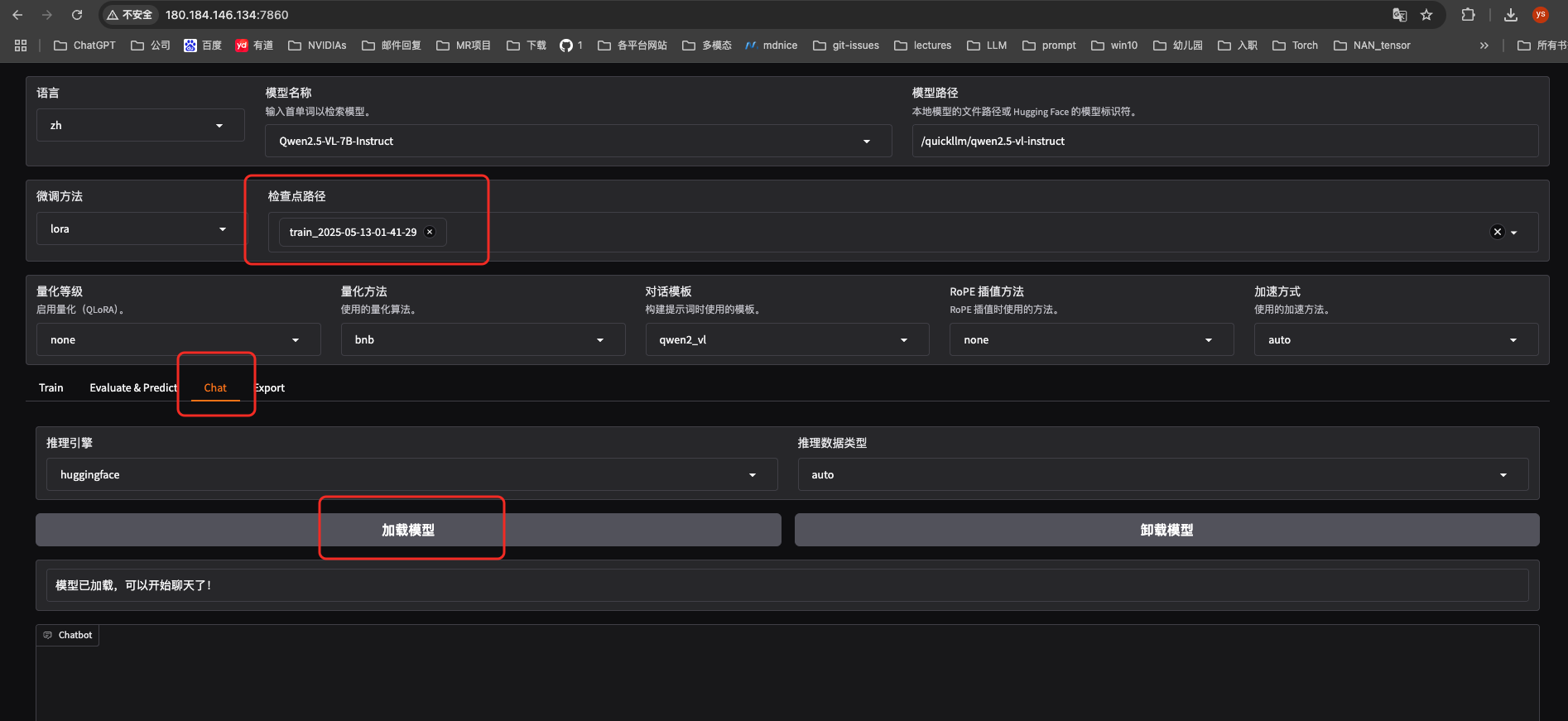

训练好以后可以加载模型的lora参数,进行对话:

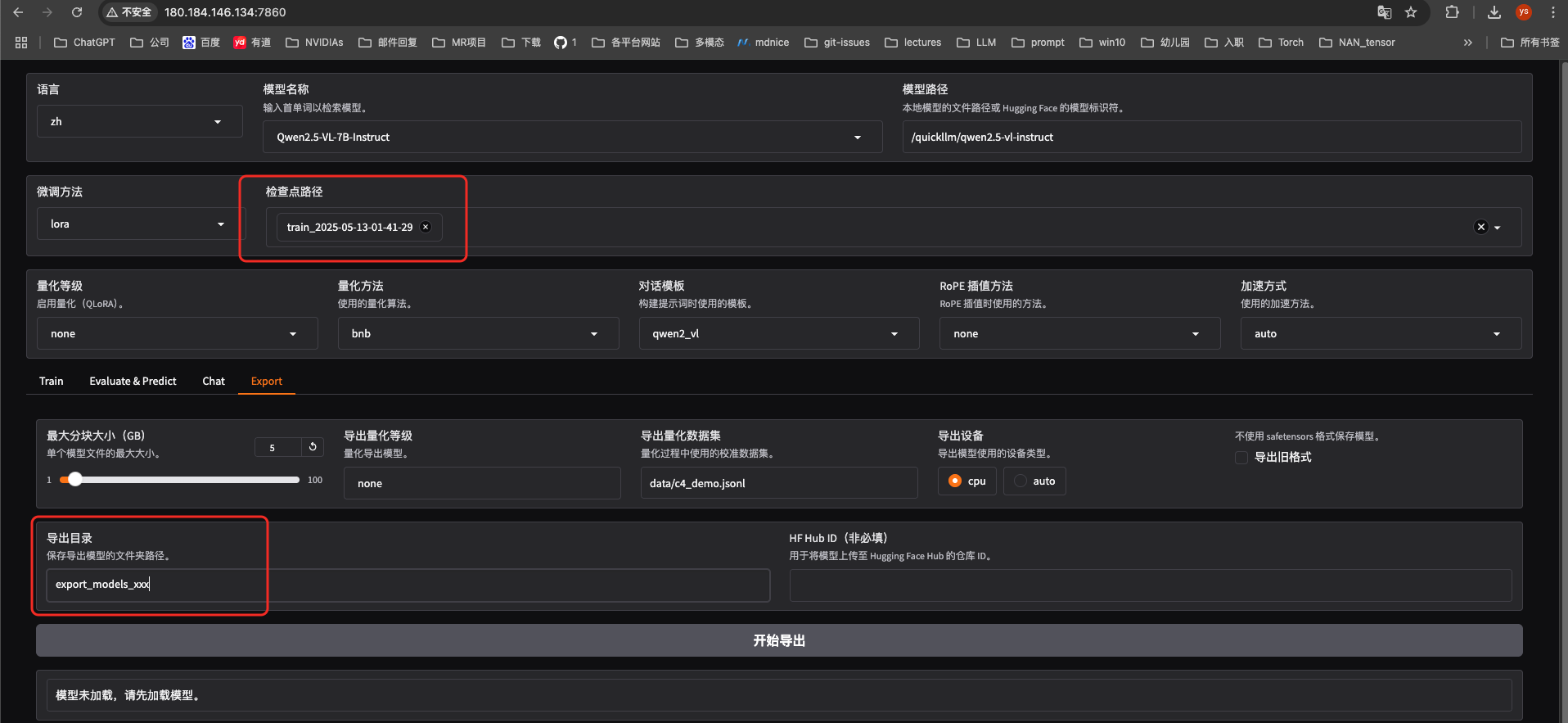

7.融合lora参数,导出模型

训练完成后,可以融合lora参数,导出作为一个新的模型。新的训练好的模型参数结构和原来的模型(例如qwen2.5-vl)结构一致。原来的模型怎么加载,新的模型就怎么加载