<AI>dify本地部署

这边文章详细记录dify的本地部署,其中有些坑很让人头疼.写在博客防止自己忘记步骤,如果有心人看到,希望也能给大家一些解决的启发.

先看看dify的样子

https://cloud.dify.ai/signin

可以注册账号进去使用一下,看一眼咱就可以自己本地部署了

1.dify下载

如果有git的话,直接git拉取下载链接

git clone https://github.com/langgenius/dify.git如果没有git的话直接去dify的github开源库下载

https://github.com/langgenius/dify

下载zip到本地并且解压

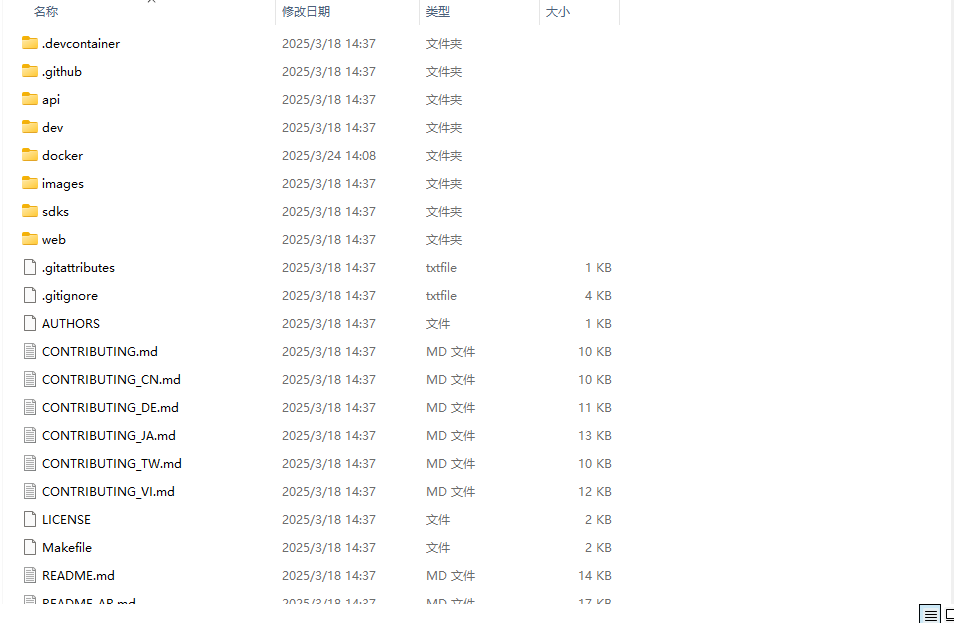

主要文件内容如下

2.docker部署

我们用常用windows系统举例,linux系统方式差不多,windows优势在于有docker desktop桌面版,linux没有,但不影响,能用linux做开发的都会部署.

这里给出第一个建议:

正常部署docker最好使用windows10/11专业版,家庭版.我是教育版,不在官方推荐内但是依旧部署成功,避免不必要的麻烦,建议听官方的.

我们下载docker desktop

https://www.docker.com/products/docker-desktop/

按照正常流程安装即可,注意点选上包含wls2那个选项

这里有一些小问题需要解决:

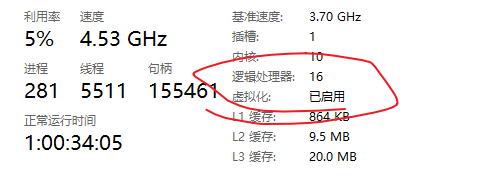

第一:在安装之前,我们最好检查自己电脑是否支持虚拟化,因为docker作为虚拟容器,需要虚拟化驱动作为介质.我们可以打开任务管理器查看

第二:我们要查看系统是否打开虚拟服务

控制面板-程序-启用或者关闭windows功能

![]()

![]()

![]()

![]()

保证这几个打开

进行到这里,docker应该能直接打开出现面板而不会报错

如果遇见报错基本上即出现包含WSL2和Hyper-V这两种错误

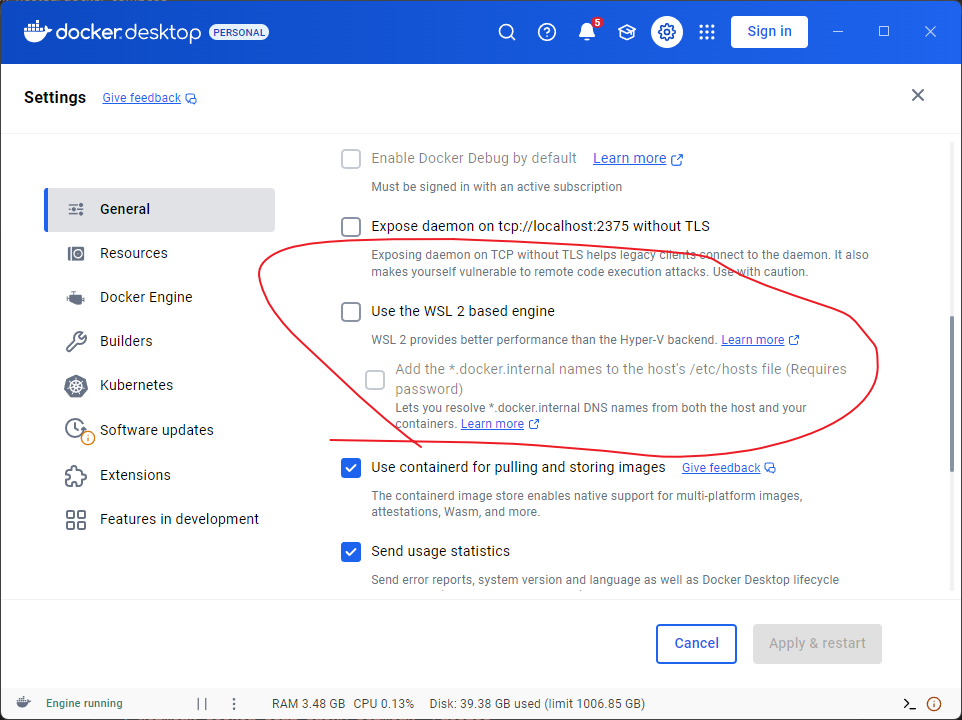

如果你是教育版或者除去专业版和家庭版,我建议你在docker设置里面取消这个选项

因为我在一些资料上看到教育版和其他版本可能不支持WSL2虚拟技术,所以我们只能使用老版Hyper-V,但是不用担心, 大道万千,殊途同归 这两个都是windows的虚拟技术,不影响. 设置之后一定要重启 重启再次查看是否能打开docker,如果没出现弹窗报错那么你应该能成功启动

看到docker engine running的一行大字

再提醒一下 可能有的朋友在自己电脑安装了模拟器(就是雷电,腾讯等手游模拟器那个模拟器),大家只能做一下抉择了,因为他们会默认关闭Hyper-V,导致docker失效.当然,可以再次去程序里面打开重启,当然!如果愿意折腾也可以不用卸载他们.(我的金铲铲T.T)

3.启动dify

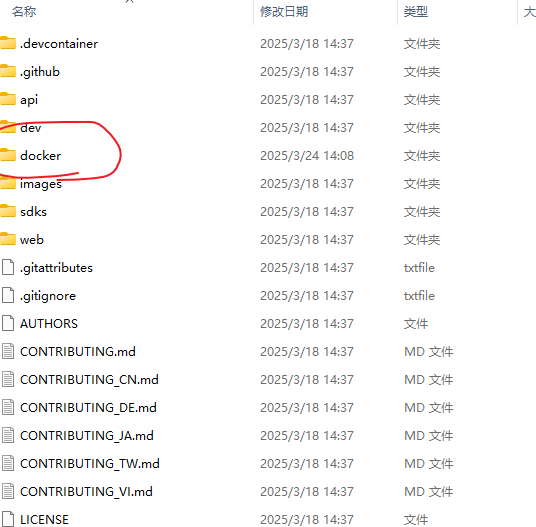

进入到dify的docker目录

这儿...保姆教学

复制环境配置文件

cp .env.example .env代码看看就行,我们原始人手动,右键复制.env.example这个文件命名为.env

然后在docker路径下运行cmd

不会我再教你

命令

docker compose up -d启动docker服务

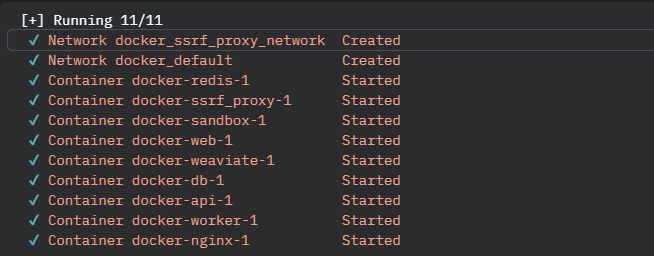

如果一切顺利,你会看到这些

这是下载完毕的样子哈,你肯定会有下载过程的

但是你多半不会很顺利,你可能慢得很

所以我建议你搬个梯子过来,爬梯子可能会快一些

下载完成之后,命令

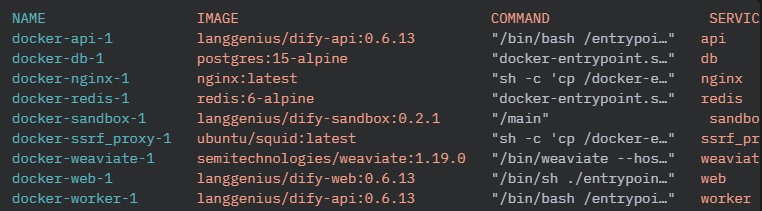

docker compose ps查看运行状况

大致是这样

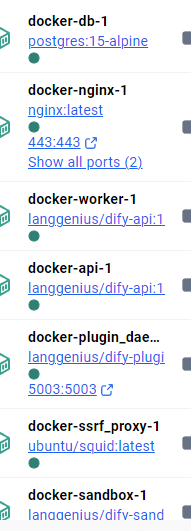

你也可以不用命令,去docker-desktop看(不然这桌面端下着干嘛)

你要保证他全部处于运行状态,哪个不运行,你就点三角让他运行,它要是死不运行,你就把他删了重新下一个他,看他运不运行.

这样的话,你的dify基本部署完成,当然为了预防万一,我们检查且更新一下它们

依旧这个路径下

cd dify/docker

docker compose down

git pull origin main

docker compose pull

docker compose up -d一个一个的来

到这里我们基本部署成功了

接下来打开浏览器

输入localhost,如果你顺利的话,你会进入到登录界面

这个是本地的dify界面,不是线上那个哈,所以你线上的账号用不了

你再点击注册注册一个账号,然后登陆上去.那么你就成功本地部署.

当然,如果你不顺利的话,你打不开网页.

两种:

1.右上角报错error,那么你docker部署有问题,删掉docker里面的东西

docker compose up -d重新来

2.我建议你把你的梯子撤走再试一次,如果没搭梯子,搭一个试一试.

4.dify模型部署

进入到dify里面,我们就可以进行建立自己的大模型了,搭建知识库,创建工作流等.

防止大家不会,我提一嘴

在自己的头像里面找到设置找到模型供应商了就可以上传自己的大模型了.

基本上本地部署dify了,肯定模型也是本地的,模型也是本地的那多半用的就是ollama

不会用ollama的去网上查一下,ez

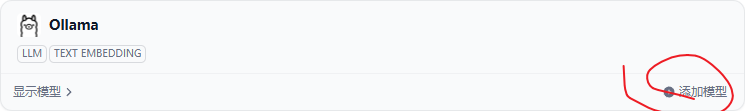

点击ollama,添加模型

大模型选择LLM,

embedding是什么自己去了解,你肯定一定必须会用上的,但是不是现在

输入自己在ollama下载的模型名称(一定是全称)不知道的去cmd看

ollama list基础URL写自己的ip+:11434

类似:http://123.456.789:11434

下面的默认就行.

这样你就有自己的本地的大模型聊天了.去工作室创建一个就行.