链接:GeeeekExplorer/nano-vllm: Nano vLLM

docs:nano-vllm

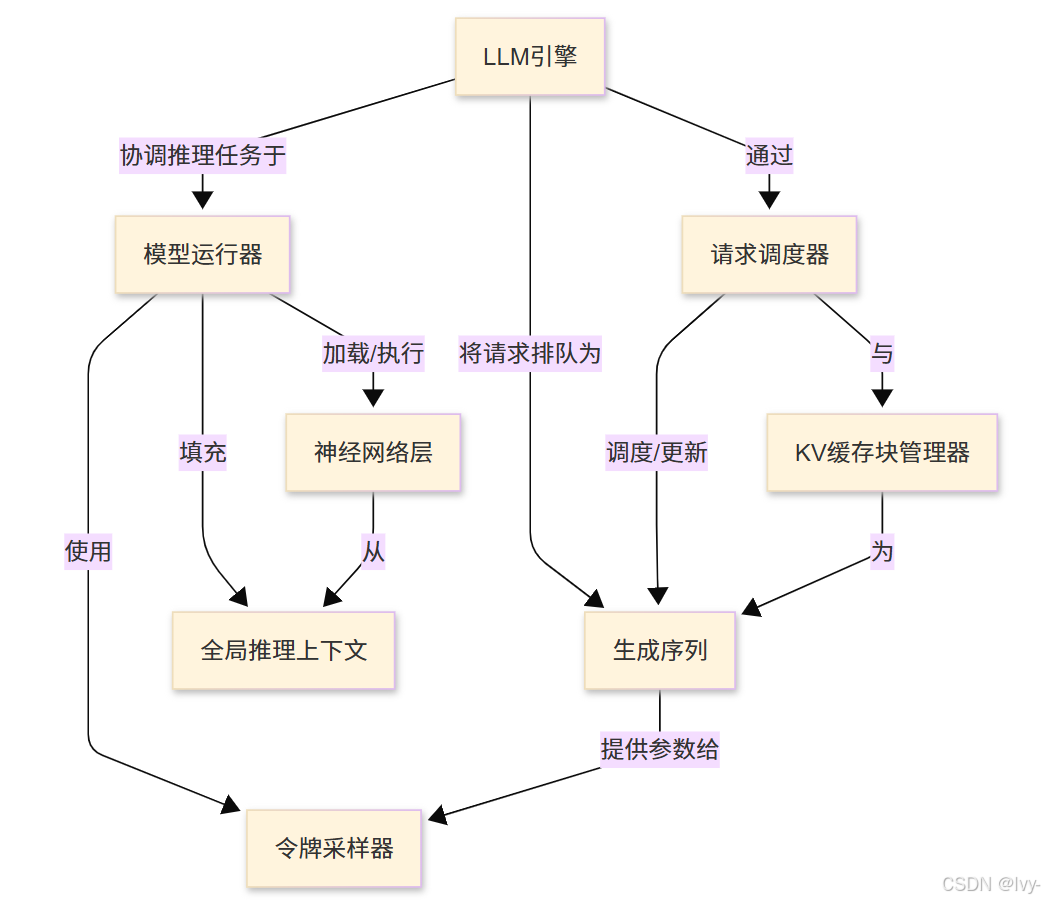

nano-vllm是一个高效的LLM 推理引擎,专门用于通过大型语言模型生成文本。

它就像一个智能工厂,接收用户输入的提示词,智能地管理它们以充分利用GPU资源,然后通过神经网络处理这些提示,快速生成高质量的文本补全。

该系统针对高吞吐量和低延迟进行了优化,即使在多GPU环境下也能高效运行。

可视化

章节

- LLM引擎

- 生成序列

- 请求调度器

- KV缓存块管理器

- 模型运行器

- 神经网络层

- 全局推理上下文

- 令牌采样器

paper 待补全🕳+1