PyTorch 基础详解:tensor.item() 方法

在使用 PyTorch 时经常需要将一个张量(Tensor)中的单个元素取出来,

尤其是在计算损失值(loss)、打印结果或日志记录时。

这时,一个非常常用且高效的函数就是 —— Tensor.item()。

文章目录

- 一、什么是 `tensor.item()`

- 二、函数语法

- 三、使用场景

- 四、基本示例

- 🎯 示例 1:从单个元素的张量中取值

- 🎯 示例 2:整数张量

- 🎯 示例 3:与损失函数结合使用

- 五、注意事项

- ⚠️ 1. 只能用于单元素张量

- ⚠️ 2. 若需要多个元素的 Python 值,请使用 `.tolist()`

- 六、`item()` 与其他取值方式对比

- 七、结合训练循环使用示例

- 八、`item()` 与张量标量的区别

- 九、性能提示

- 📚 十、参考资料

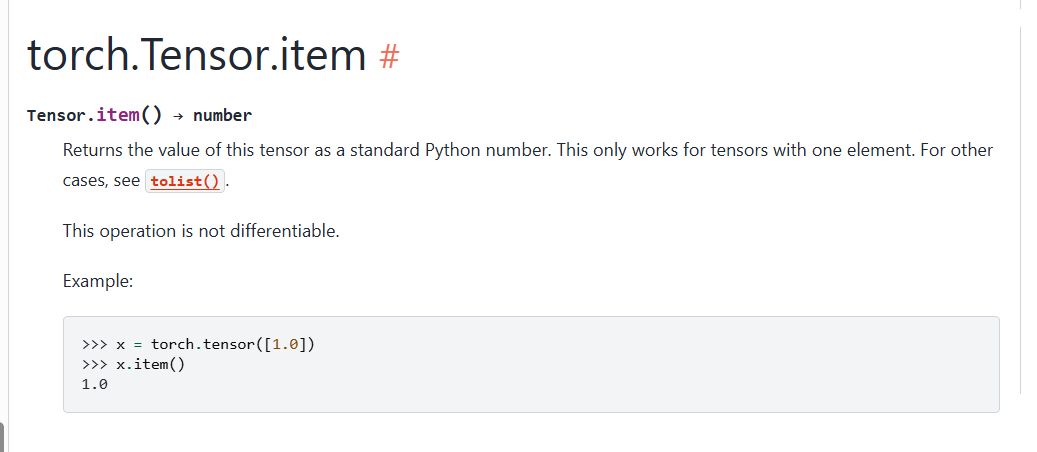

一、什么是 tensor.item()

tensor.item() 是 PyTorch 张量(torch.Tensor)对象的一个方法,

用于 从仅包含一个元素的张量中提取其数值,并将其转换为 Python 的标量类型(如 int 或 float)。

二、函数语法

tensor.item()

参数:

无参数。

返回值:

返回一个 Python 标量(例如 float 或 int),具体取决于张量的数据类型。

三、使用场景

tensor.item() 主要用于以下几种场景:

- 从单元素张量中提取数值

- 打印或记录损失值(loss)

- 与非 PyTorch 库(如 NumPy、Matplotlib、日志系统等)交互时

- 在循环中计算平均值、最小值或其他统计指标

四、基本示例

🎯 示例 1:从单个元素的张量中取值

import torchx = torch.tensor([3.14])

print(x) # 输出:tensor([3.1400])

print(x.item()) # 输出:3.14

这里 x.item() 返回了一个 Python float 类型的标量。

🎯 示例 2:整数张量

x = torch.tensor(7)

print(x.item()) # 输出:7

print(type(x.item())) # <class 'int'>

📘 提示:

item() 会根据张量的数据类型自动返回 int 或 float。

🎯 示例 3:与损失函数结合使用

import torch

import torch.nn as nn# 定义损失函数

criterion = nn.MSELoss()# 假设预测值和目标值

y_pred = torch.tensor([2.5])

y_true = torch.tensor([3.0])# 计算损失

loss = criterion(y_pred, y_true)

print(loss) # tensor(0.2500)

print(loss.item()) # 0.25

💡 在训练模型时,我们通常会使用 loss.item() 将张量形式的损失值转换为 Python 数值进行日志记录。

五、注意事项

⚠️ 1. 只能用于单元素张量

如果张量中有多个元素,调用 .item() 会报错:

x = torch.tensor([1.0, 2.0, 3.0])

x.item() # ❌ RuntimeError: a Tensor with 3 elements cannot be converted to Scalar

✅ 正确做法:

x[0].item() # 取第一个元素的值

⚠️ 2. 若需要多个元素的 Python 值,请使用 .tolist()

如果张量中包含多个元素,应使用 .tolist():

x = torch.tensor([[1, 2], [3, 4]])

print(x.tolist())

# 输出:[[1, 2], [3, 4]]

.tolist() 可以将整个张量转换为嵌套的 Python 列表结构。

六、item() 与其他取值方式对比

| 方法 | 功能 | 返回类型 | 适用场景 |

|---|---|---|---|

.item() | 获取单个元素的值 | Python 标量 (int/float) | 单元素张量 |

.tolist() | 将张量转为 Python 列表 | list | 多元素张量 |

.detach().numpy() | 转为 NumPy 数组 | numpy.ndarray | 用于数值处理 |

tensor.data | 返回张量数据 | torch.Tensor | 内部操作(不推荐直接使用) |

七、结合训练循环使用示例

在模型训练时,通常会看到这样的写法:

for epoch in range(3):optimizer.zero_grad()output = model(inputs)loss = criterion(output, targets)loss.backward()optimizer.step()print(f"Epoch {epoch+1}, Loss: {loss.item():.4f}")

这样可以清晰地输出每个 epoch 的损失值,而不显示 tensor(...) 的格式。

输出:

Epoch 1, Loss: 0.2578

Epoch 2, Loss: 0.1234

Epoch 3, Loss: 0.0987

八、item() 与张量标量的区别

| 特性 | 张量标量 | .item() 提取的值 |

|---|---|---|

| 类型 | torch.Tensor | Python int / float |

| 是否在计算图中 | ✅ 是 | ❌ 否 |

| 是否能反向传播 | ✅ 是 | ❌ 否 |

| 使用场景 | 模型内部计算 | 打印、日志、统计分析 |

示例:

x = torch.tensor(2.0, requires_grad=True)

y = x ** 2

print(y) # tensor(4., grad_fn=<PowBackward0>)

print(y.item()) # 4.0

y 是一个可求导的张量,而 y.item() 返回的是一个普通的 Python 浮点数,不会被计算图追踪。

九、性能提示

.item()是一个轻量级操作,开销非常小。- 但在 GPU 上频繁调用

.item()可能会 导致 CPU-GPU 同步开销增加。

⚠️ 建议只在需要输出、记录时调用,而不是在每次迭代都频繁提取数值。

📚 十、参考资料

- PyTorch 官方文档 – Tensor.item()

- PyTorch 张量操作指南

当你看到打印日志中那一串整洁的数字,

很可能正是.item()在背后默默地工作着。 🧠✨