【循环神经网络基础】

循环神经网络

学习目标

- 能够说出循环神经网络的概念和作用

- 能够说出循环神经网络的类型和应用场景

- 能够说出LSTM的作用和原理

- 能够说出GRU的作用和原理

1. 循环神经网络的介绍

为什么有了神经网络还需要有循环神经网络?

在普通的神经网络中,信息的传递是单向的,这种限制虽然使得网络变得更容易学习,但在一定程度上也减弱了神经网络模型的能力。

特别是在很多现实任务中,网络的输出不仅和当前时刻的输入相关,也和其过去一段时间的输出相关。此外,普通网络难以处理时序数据,比如视频、语音、文本等,时序数据的长度一般是不固定的,而前馈神经网络要求输入和输出的维数都是固定的,不能任意改变。因此,当处理这一类和时序相关的问题时,就需要一种能力更强的模型。

循环神经网络(Recurrent Neural Network,RNN)是一类具有短期记忆能力的神经网络。在循环神经网络中,神经元不但可以接受其它神经元的信息,也可以接受自身的信息,形成具有环路的网络结构。

换句话说:神经元的输出可以在下一个时间步直接作用到自身(作为输入)

通过简化图,我们看到RNN比传统的神经网络多了一个循环圈,这个循环表示的就是在下一个时间步(Time Step)上会返回作为输入的一部分,我们把RNN在时间点上展开,得到的图形如下:

或者是:

在不同的时间步,RNN的输入都将与之前的时间状态有关,tnt_ntn时刻网络的输出结果是该时刻的输入和所有历史共同作用的结果,这就达到了对时间序列建模的目的。

RNN的不同表示和功能可以通过下图看出:

- 图1:固定长度的输入和输出 (e.g. 图像分类)

- 图2:序列输出 (e.g.图像转文字)

- 图3:数列输入 (e.g. 文本分类)

- 图4:异步的序列输入和输出(e.g.文本翻译).

- 图5:同步的序列输入和输出 (e.g. 根据视频的每一帧来对视频进行分类)

2. LSTM和GRU

2.1 LSTM的基础介绍

假如现在有这样一个需求,根据现有文本预测下一个词语,

比如 天上的云朵漂浮在__,通过间隔不远的位置就可以预测出来词语是 天上,但是 对于其他一些句子,可能需要被预测的词语在前100个词语之前,那么此时由于间隔非常大,随着间隔的增加可能会导致真实的预测值对结果的影响变的非常小,而无法非常好的进行预测(RNN中的长期依赖问题(long-Term Dependencies))。那么为了解决这个问题需要LSTM(Long Short-Term Memory网络)LSTM是一种RNN特殊的类型,可以学习长期依赖信息。

在很多问题上,LSTM都取得相当巨大的成功,并得到了广泛的应用。

一个LSTM的单元就是下图中的一个绿色方框中的内容:

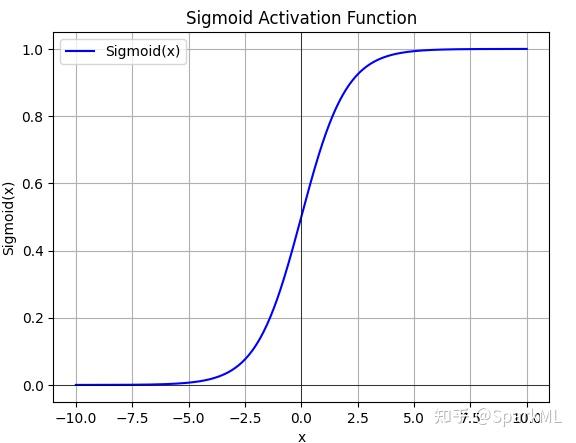

其中 σ\sigmaσ 表示sigmod函数,其他符号的含义:

2.2 LSTM的核心

LSTM的核心在于单元(细胞)中的状态,也就是上图中最上面的那根线。

但是如果只有上面那一条线,那么没有办法实现信息的增加或者删除,所以在LSTM是通过一个叫做 门 的结构实现,门可以选择让信息通过或者不通过。

这个门主要是通过sigmoid和点乘(pointwise multiplication)实现的。

我们都知道,sigmoidsigmoidsigmoid 函数的取值范围是在(0,1)之间,如果接近 0 表示不让任何信息通过,如果接近 1 表示所有的信息都会通过。

sigmoid函数图像:

2.3 逐步理解LSTM

2.3.1 遗忘门

遗忘门通过 sigmoid 函数来决定哪些信息会被遗忘。

在下图就是 ht−1h_{t-1}ht−1 和 xtx_txt 进行合并(concat)之后乘上权重和偏置,通过sigmoid函数,输出0-1之间的一个值,这个值会和前一次的细胞状态(Ct−1C_{t-1}Ct−1) 进行点乘,从而决定遗忘或者保留。

下面公式中的 [ht−1,xt][h_{t-1},x_{t}][ht−1,xt] 表示上一时刻的隐藏状态,xtx_{t}xt 表示当前的输入,表示上一个时间步 ht−1h_{t-1}ht−1的状态值和当前xtx_{t}xt 的输入参数进行合并。

WfW_fWf:遗忘门的权重矩阵

公式:

ft=σ(Wf.[ht−1,xt]+bf)f_{t} = \sigma(W_{f}.[h_{t-1},x_{t}] + b_{f} ) ft=σ(Wf.[ht−1,xt]+bf)

上面公式解释,这里包含几个部分:

- ht−1h_{t-1}ht−1:上一时刻的隐藏状态(记忆中的“总结”)

- xtx_txt:当前时刻的输入(新的信息)

- [ht−1,xt][h_{t-1}, x_t][ht−1,xt]:把它们拼接成一个向量,concat合并

- WfW_fWf:遗忘门的权重矩阵

- bfb_fbf:偏置项(bias)

- σ\sigmaσ:sigmoid 函数,输出范围在 (0,1)

那么 W f W_f Wf 到底是什么?

- 它是一个 可学习的参数矩阵,在模型训练过程中会不断更新。

- 作用:把输入 [ht−1,xt][h_{t-1}, x_t][ht−1,xt] 映射到 “遗忘门” 的维度。

- 大小:取决于隐藏层单元数。例如,若隐藏层维度是 nnn,而 [ht−1,xt][h_{t-1}, x_t][ht−1,xt] 的长度是 mmm,那么 WfW_fWf 的大小就是 (n×m)(n \times m)(n×m)。

换句话说,WfW_fWf 决定了:

- 当前输入 xtx_txt 和过去记忆 ht−1h_{t-1}ht−1 对遗忘门的影响有多大。

- 例如,某些词(比如语气词“啊、呢”)可能对语义没什么帮助,WfW_fWf 学习后会让遗忘门输出接近 0 → 把它遗忘。

- 而像 “苹果” “银行” 这种关键字,可能输出接近 1 → 保留下来。

通俗类比

你可以把 WfW_fWf 理解成 “注意力调节旋钮”:

- 它根据 “旧记忆” 和 “新输入” 的组合,决定当前要忘记多少旧的信息。

- 模型训练时,就像不断调整旋钮,让它学会哪些信息应该记住,哪些要忘掉。

✅ 总结:

- WfW_fWf 是遗忘门的 权重矩阵,是模型要学习的参数。

- 它的作用是把 [ht−1,xt][h_{t-1}, x_t][ht−1,xt] 转换成一个“遗忘分数”,用 sigmoid 压缩到 0~1 之间,指导模型在更新记忆时“忘掉多少旧信息”。

2.3.2 输入门

在 LSTM 里,输入门的作用是控制 “新信息” 进入记忆单元的多少。

它不像遗忘门那样管理旧记忆,而是决定哪些新的内容值得写进 “ 长期记忆本子 ”。

下一步就是决定哪些新的信息会被保留,这个过程有两步:

- 一个被称为

输入门的sigmoid 层决定哪些信息会被更新 tanh会创造一个新的候选向量C~t\widetilde{C}_{t}Ct,后续可能会被添加到细胞状态中。- 双曲正切函数tanhtanhtanh

例如:

我昨天吃了苹果,今天我想吃菠萝,在这个句子中,通过遗忘门可以遗忘苹果,同时更新新的主语为菠萝。

现在就可以更新旧的细胞状态Ct−1C_{t-1}Ct−1为新的CtC_{ t }Ct 了。

更新的构成很简单就是:

- 旧的细胞状态和遗忘门的结果相乘。

- 然后加上 输入门和tanh相乘的结果。

输入门的作用:

-

作用:决定 哪些新的信息需要写入记忆单元。

-

解释:

- iti_tit(输入门系数):输入门的 “开关系数” ,决定新信息要不要写入(0~1)。

- C~t\tilde{C}_tC~t:一个候选的新信息向量(由 tanh 生成,值在 -1~1),取值范围在 [−1,1][-1, 1][−1,1]。

最终新的记忆会由旧记忆和新信息结合起来:

Ct=ft∗Ct−1+it∗C~tC_t = f_t * C_{t-1} + i_t * \tilde{C}_t Ct=ft∗Ct−1+it∗C~t

- ftf_tft:遗忘门输出,表示“旧记忆保留多少”。

- Ct−1C_{t-1}Ct−1:上一步的细胞状态。

- it∗C~ti_t * \tilde{C}_tit∗C~t:新的信息,经过输入门筛选后写入。

WiW_iWi —— 输入门的权重矩阵

-

作用:控制“哪些新信息可以进入记忆”。

-

细节:

- WiW_iWi 把拼接后的向量 [ht−1,xt][h_{t-1}, x_t][ht−1,xt] 映射到一个和 记忆单元维度相同的向量。

- 经过 sigmoid 压缩到 0∼10 \sim 10∼1,形成 输入门系数 iti_tit。

- iti_tit 相当于一个“过滤器/开关”,逐元素决定是否允许某一维的新信息写入。

👉 类比:

想象你在做笔记,WiW_iWi 就像是你的“注意力分配规则”,它决定哪些内容值得写进笔记,哪些应该忽略。

WCW_CWC —— 候选记忆的权重矩阵

-

作用:生成 候选的新信息向量 C~t\tilde{C}_tC~t。

-

细节:

- WCW_CWC 同样接收 [ht−1,xt][h_{t-1}, x_t][ht−1,xt],但它的任务不是做“开关”,而是 生成新的候选内容。

- 经过 tanh\tanhtanh 压缩,范围在 [−1,1][-1, 1][−1,1],得到可能写入记忆单元的新信息。

👉 类比:

这就像你在读书时,看到一段内容,你脑子里会先把它整理成一个 “候选笔记”。但这个候选笔记 是否写进本子,要看输入门 iti_tit 是否允许。

2.3.3 输出门

最后,我们需要决定什么信息会被输出,也是一样这个输出经过变换之后会通过sigmoid函数的结果来决定那些细胞状态会被输出。

步骤如下:

- 前一次的输出和当前时间步的输入的组合结果通过sigmoid函数进行处理得到OtO_tOt

- 更新后的细胞状态 CtC_tCt 会经过tanh层的处理,把数据转化到(-1,1)的区间

- tanh 处理后的结果和 OtO_tOt 进行相乘,把结果输出同时传到下一个 LSTM 的单元

2.4 GRU,LSTM的变形

GRU(Gated Recurrent Unit),是一种LSTM的变形版本, 它将遗忘和输入门组合成一个“更新门”。它还合并了单元状态和隐藏状态,并进行了一些其他更改,由于他的模型比标准LSTM模型简单,所以越来越受欢迎。

在GRU(门控循环单元)公式中,图像中的各个符号代表以下含义:

- ht−1h_{t-1}ht−1:前一个时间步的隐状态(即时间步 t−1t-1t−1 时的GRU单元输出)。

- xtx_{t}xt:当前时间步 ttt 的输入。

- Wz,Wr,WW_z, W_r, WWz,Wr,W:这些是更新门(ztz_tzt)、重置门(rtr_trt)和候选隐状态(h~t\tilde{h}_th~t)的权重矩阵,它们是训练过程中学习得到的参数。

- rtr_trt:当前时间步 ttt 的重置门,控制上一时刻隐状态的遗忘程度。

- ztz_tzt:当前时间步 ttt 的更新门,控制上一时刻隐状态和候选隐状态的融合程度。

- h~t\tilde{h}_th~t:当前时间步 ttt 的候选隐状态,表示可能的新的隐状态。

- σ\sigmaσ:Sigmoid 激活函数,用于产生0到1之间的值。它被应用于重置门 rtr_trt 和更新门 ztz_tzt。

- tanh\tanhtanh:双曲正切激活函数,输出范围在-1到1之间。它被应用于候选隐状态 h~t\tilde{h}_th~t。

GRU的公式结合这些元素来计算时间步 ttt 的新隐状态 hth_tht,公式如下:

ht=(1−zt)∗ht−1+zt∗h~th_t = (1 - z_t) * h_{t-1} + z_t * \tilde{h}_t ht=(1−zt)∗ht−1+zt∗h~t

该公式表示GRU的最终输出,其中更新门 ztz_tzt 控制着多少新的候选隐状态 h~t\tilde{h}_th~t 被与上一时刻的隐状态 ht−1h_{t-1}ht−1 结合。

LSTM内容参考地址:https://colah.github.io/posts/2015-08-Understanding-LSTMs/

3. 双向LSTM

单向的 RNN,是根据前面的信息推出后面的,但有时候只看前面的词是不够的, 可能需要预测的词语和后面的内容也相关,那么此时需要一种机制,能够让模型不仅能够从前往后的具有记忆,还需要从后往前需要记忆。此时双向LSTM就可以帮助我们解决这个问题

由于是双向LSTM,所以每个方向的LSTM都会有一个输出,最终的输出会有2部分,所以往往需要concat的操作