(论文速读)DEA-Net:基于细节增强卷积和内容引导注意力的单幅图像去雾

论文题目:DEA-Net: Single Image Dehazing Based on Detail-Enhanced Convolution and Content-Guided Attention(基于细节增强卷积和内容引导注意力的单幅图像去雾)

期刊:IEEE TRANSACTIONS ON IMAGE PROCESSING(TIP # if = 13.3)

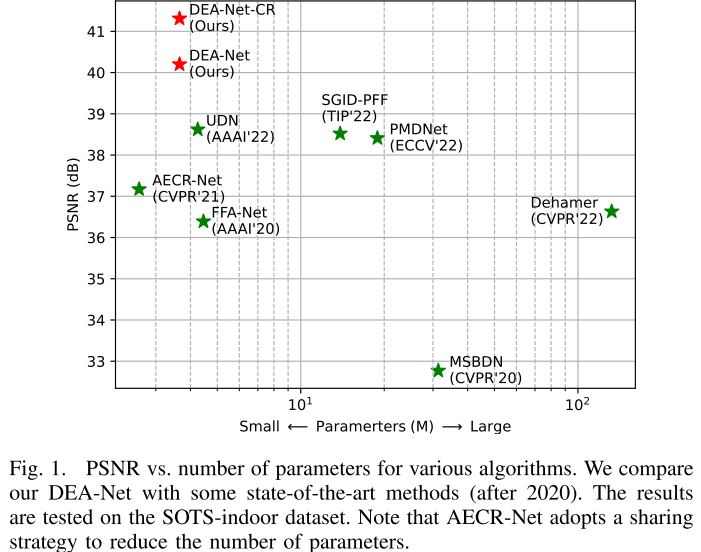

摘要:单幅图像去雾是一个具有挑战性的不适定问题,它从观测到的雾霾图像中估计出潜在的无雾图像。现有的一些基于深度学习的方法致力于通过增加卷积的深度或宽度来提高模型的性能。卷积神经网络(CNN)结构的学习能力仍未得到充分的研究。本文提出了一种由细节增强卷积(DEConv)和内容引导注意(CGA)组成的细节增强注意块(DEAB)来增强特征学习,从而提高去雾性能。具体来说,decv包含差分卷积,它可以整合先验信息来补充原始信息,增强表示能力。然后通过使用重参数化技术,将DEConv等效地转换为普通卷积,以减少参数和计算成本。通过为每个信道分配唯一的空间重要性图(SIM), CGA可以注意到特征中编码的更多有用信息。此外,提出了一种基于cga的混合融合方案,有效地融合特征,辅助梯度流。通过结合上述组件,我们提出了用于恢复高质量无雾图像的细节增强注意力网络(DEA-Net)。大量的实验结果证明了我们的DEA-Net的有效性,通过仅使用3.653 M参数将PSNR指数提高到41 dB以上,优于最先进的(SOTA)方法。

DEA-Net的源代码:https://github.com/cecret3350/DEA-Net

DEA-Net:基于细节增强卷积和内容引导注意力单图像去雾网络

引言

雾霾天气下拍摄的照片往往存在对比度低、颜色失真、细节模糊等问题,不仅影响视觉效果,还会严重影响计算机视觉系统的性能。单图像去雾作为一个经典的计算机视觉问题,旨在从单张雾霾图像中恢复清晰的场景。

现有方法的局限性

普通卷积的不足

传统的去雾方法大多采用标准卷积进行特征提取,但存在明显局限:

- 频率偏好问题:普通卷积倾向于强调低频信息而忽略高频信息

- 缺乏先验约束:在没有任何约束的情况下搜索解空间,限制了表达能力

- 细节恢复不足:对于去雾任务关键的边缘和纹理细节处理能力有限

雾霾非均匀性挑战

雾霾分布具有显著的非均匀特性:

- 图像级非均匀性:同一图像中不同区域的雾霾浓度差异很大

- 特征级非均匀性:不同通道的特征图中雾霾信息分布不均

现有的注意力机制主要关注图像级的非均匀性,而忽略了特征级的差异,无法为每个通道提供专门的处理策略。

DEA-Net:创新的解决方案

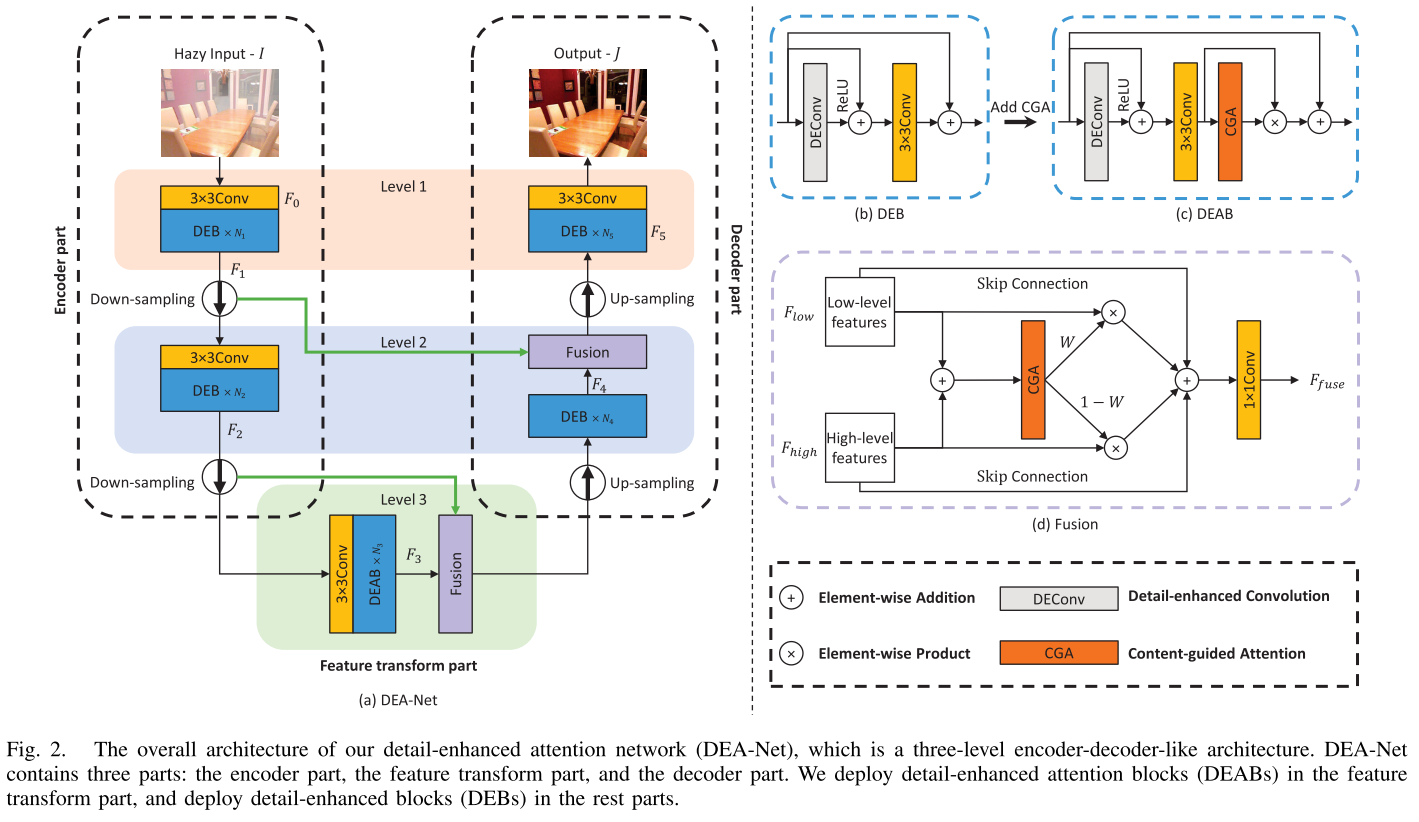

整体架构

DEA-Net采用三级编码器-解码器架构,包含三个主要组件:

- 编码器部分:多尺度特征提取

- 特征变换部分:核心的DEAB(细节增强注意力块)

- 解码器部分:特征融合与图像重建

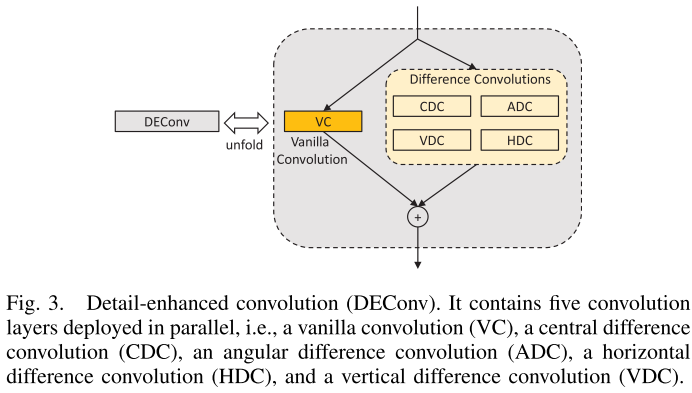

核心创新1:细节增强卷积(DEConv)

设计理念

DEConv通过并行部署五个卷积层来同时处理低频和高频信息:

DEConv = 普通卷积 + 中央差分卷积 + 角度差分卷积 + 水平差分卷积 + 垂直差分卷积

差分卷积的优势

- 梯度先验编码:水平和垂直差分卷积显式编码梯度信息

- 高频信息增强:有效提取边缘、纹理等高频细节

- 互补性设计:差分卷积与普通卷积形成互补,兼顾低频和高频信息

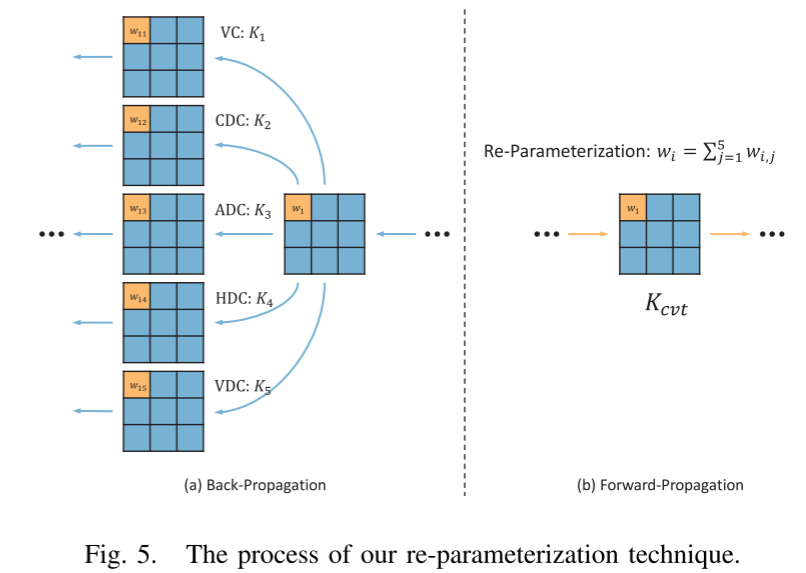

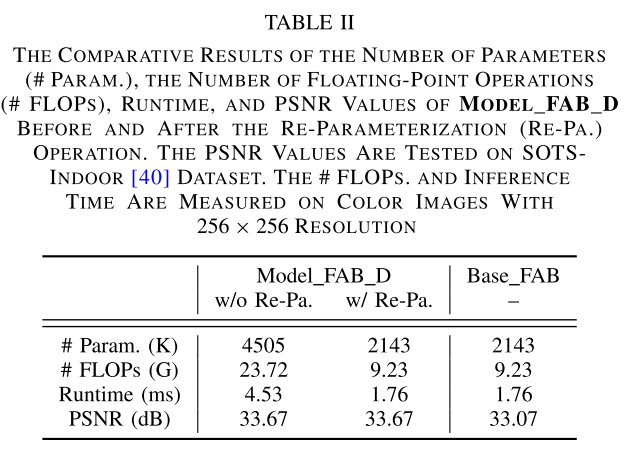

重参数化技术

为了避免增加计算开销,DEConv采用重参数化技术:

训练阶段:五个卷积并行计算,分别更新参数 推理阶段:将五个卷积核合并为单个等效卷积核

这种设计确保了DEConv在不增加推理成本的情况下获得更强的表示能力。

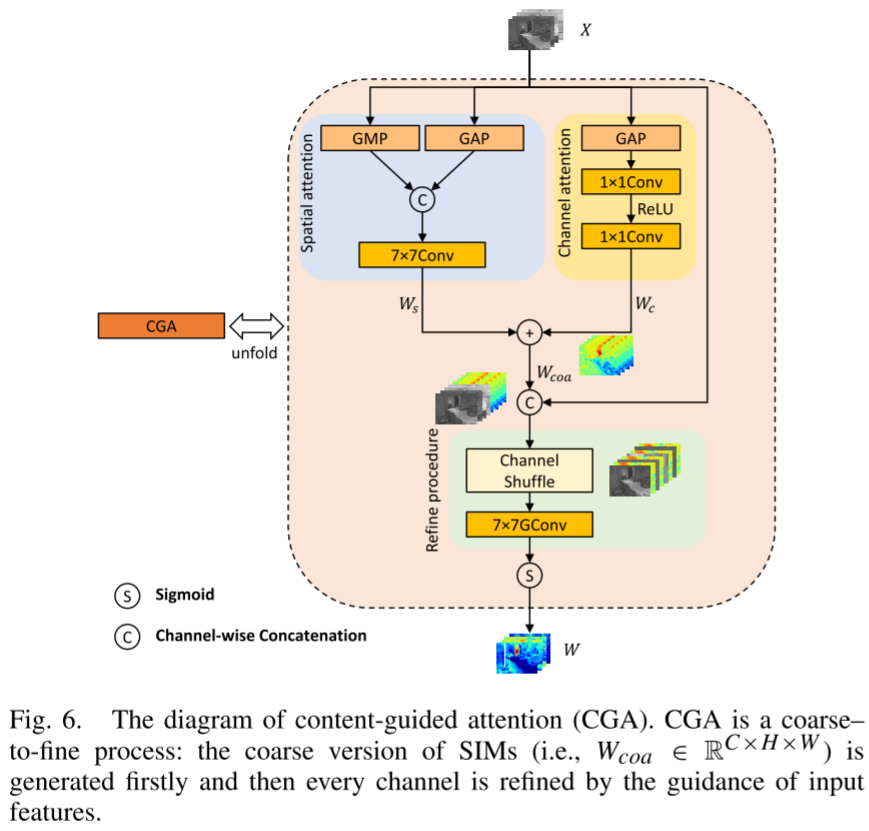

核心创新2:内容引导注意力(CGA)

粗到精的两步设计

CGA采用创新的两步注意力生成机制:

第一步:粗糙注意力生成

- 结合通道注意力和空间注意力

- 生成初始的空间重要性图

第二步:内容引导精细化

- 利用输入特征的内容信息

- 为每个通道生成专门的空间重要性图

通道特异性处理

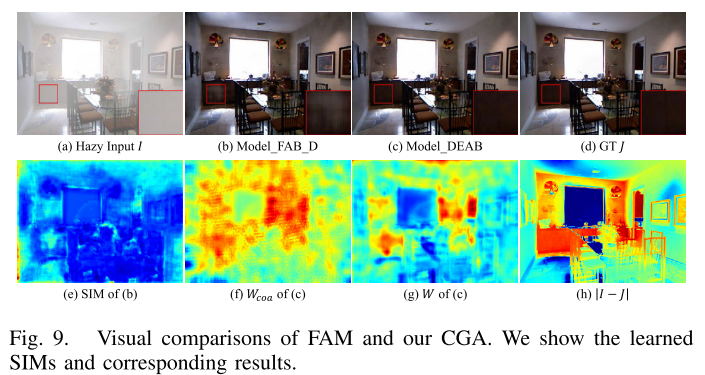

传统方法使用单一的空间重要性图处理所有通道,而CGA为每个通道生成专门的权重图:

传统方法:W_spatial ∈ R^(H×W) → 所有通道共享

CGA方法:W ∈ R^(C×H×W) → 每通道专门权重

这种设计能够更好地处理不同通道中雾霾信息的差异。

核心创新3:CGA基础混合融合方案

感受野不匹配问题

编码器的浅层特征和解码器的深层特征具有不同的感受野:

- 浅层特征:小感受野,丰富的低级信息

- 深层特征:大感受野,抽象的高级语义

简单的加法或连接操作无法很好地融合这些特征。

自适应权重融合

CGA基础融合方案通过学习空间权重实现自适应融合:

F_fuse = C_1×1(F_low · W + F_high · (1-W) + F_low + F_high)

其中W是通过CGA学习得到的空间权重,实现了特征的自适应加权融合。

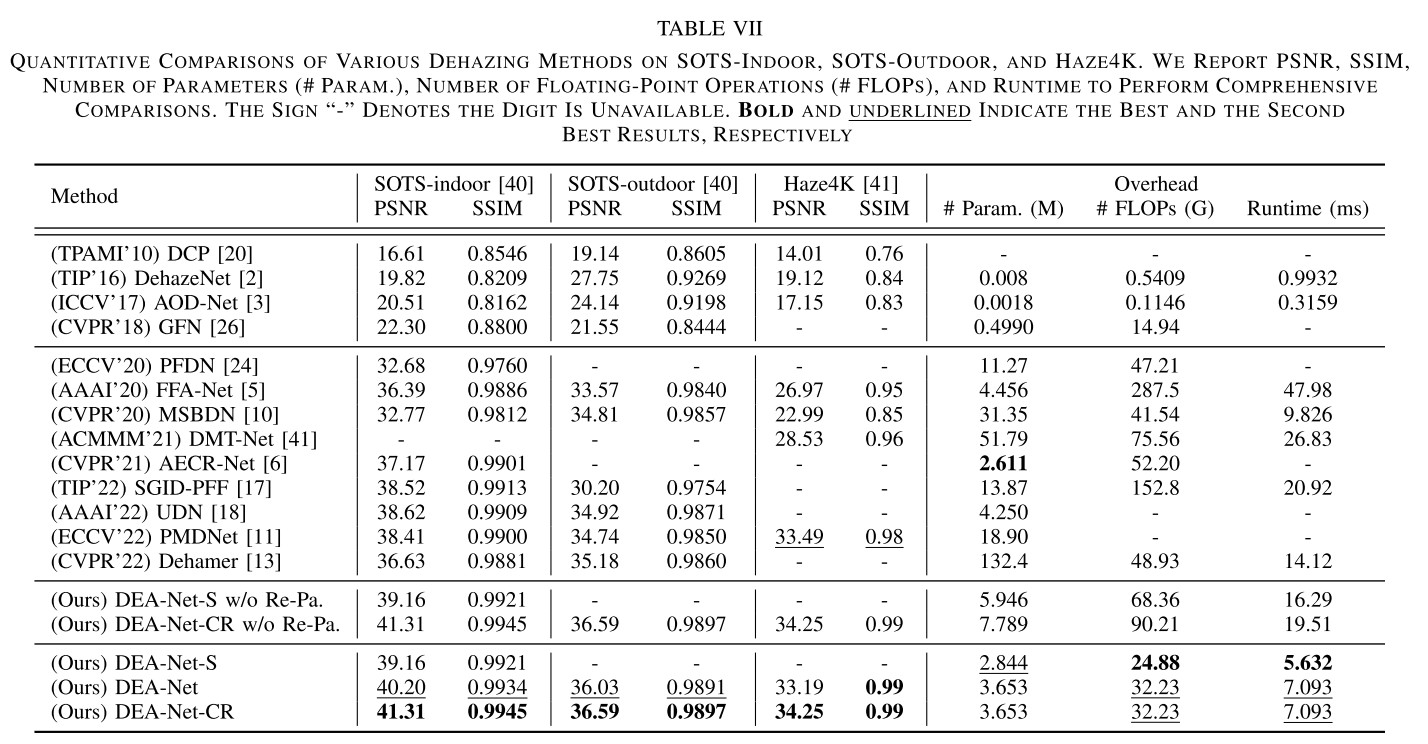

实验验证

数据集和评估指标

- 训练数据:RESIDE数据集(ITS和OTS)

- 测试数据:SOTS-indoor、SOTS-outdoor、Haze4K

- 评估指标:PSNR、SSIM、参数量、FLOPs、推理时间

定量结果

DEA-Net在多个数据集上取得了最佳性能:

| 数据集 | PSNR (dB) | SSIM | 参数量 (M) |

|---|---|---|---|

| SOTS-indoor | 41.31 | 0.9945 | 3.653 |

| SOTS-outdoor | 36.59 | 0.9897 | 3.653 |

| Haze4K | 33.19 | 0.9869 | 3.653 |

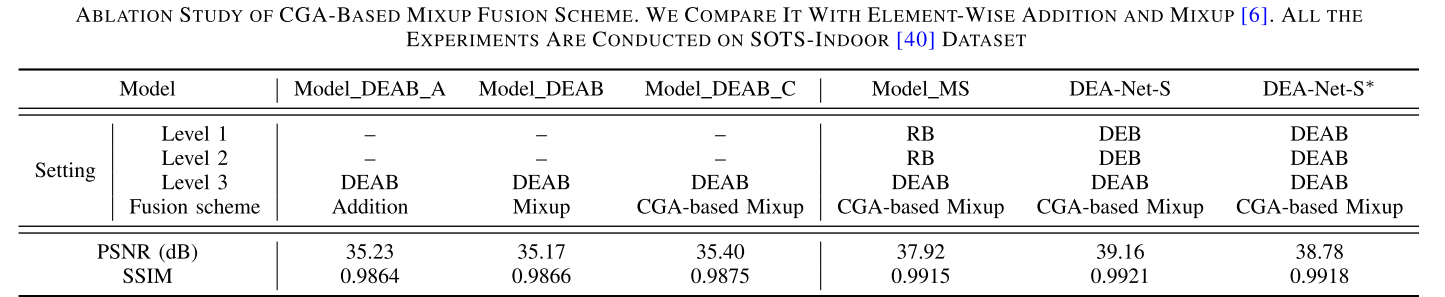

消融实验

详细的消融实验验证了各组件的有效性:

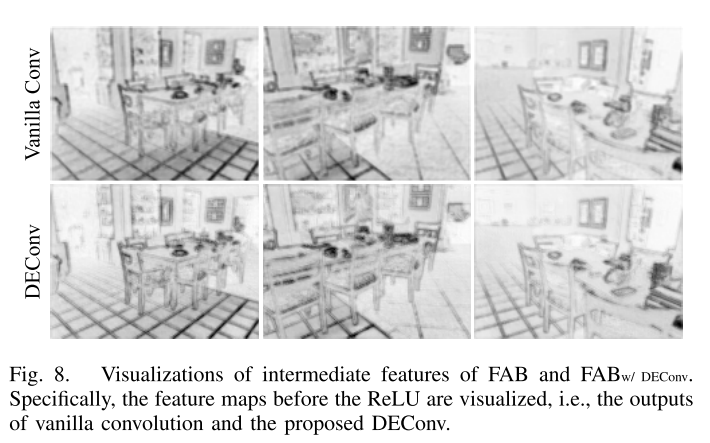

DEConv的贡献:相比普通卷积提升0.6 dB PSNR

CGA的贡献:相比传统FAM提升1.5 dB PSNR

融合方案的贡献:CGA基础融合优于简单加法和mixup

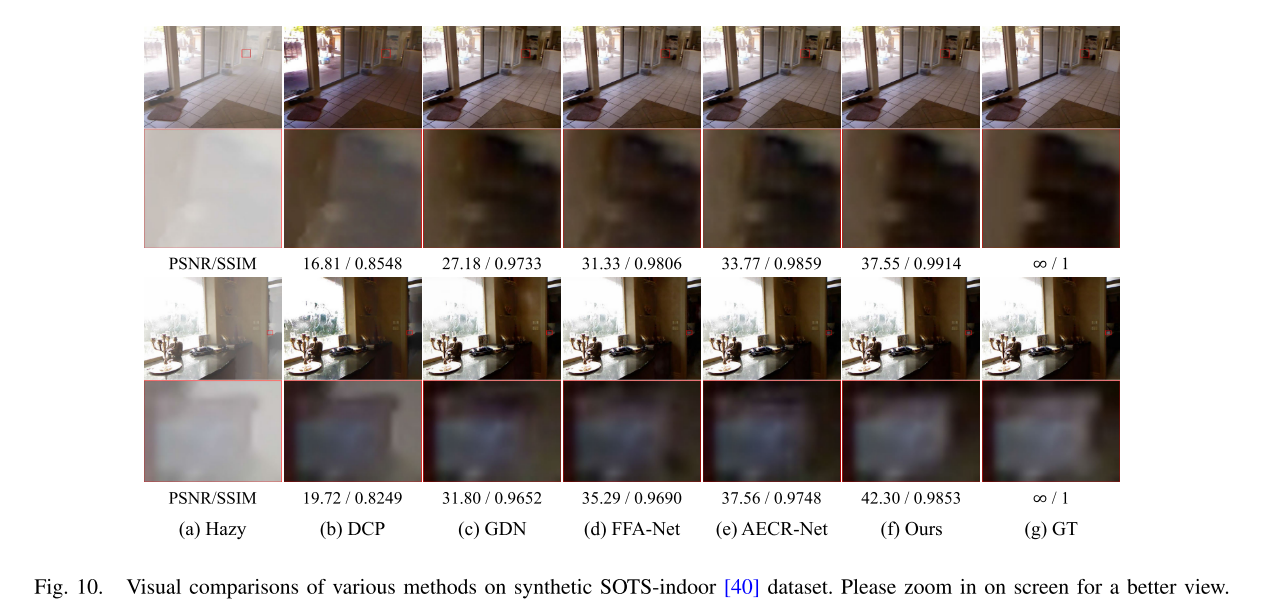

视觉效果对比

从视觉效果来看,DEA-Net能够:

- 更好地恢复边缘和纹理细节

- 减少雾霾残留

- 保持自然的颜色和对比度

- 在真实雾霾图像上表现出色

技术创新的意义

对去雾领域的贡献

- 首次引入差分卷积:将差分卷积引入图像去雾任务,为该领域提供了新的技术路径

- 通道特异性注意力:提出了处理特征级雾霾非均匀性的有效方案

- 高效网络设计:在保持高性能的同时实现了参数和计算的高效性

技术可拓展性

DEA-Net的核心组件具有良好的可拓展性:

- DEConv:可应用于其他图像恢复任务

- CGA:作为通用注意力机制可插入各种网络

- 融合方案:适用于需要多尺度特征融合的任务

结论

DEA-Net通过巧妙的网络设计解决了单图像去雾中的关键技术挑战。细节增强卷积、内容引导注意力和改进的特征融合方案共同构成了一个高性能、高效率的去雾框架。

这项工作不仅在技术上取得了突破,更重要的是为图像去雾和其他图像恢复任务提供了新的研究思路。随着相关技术的进一步发展,我们可以期待更加强大和实用的图像去雾解决方案。