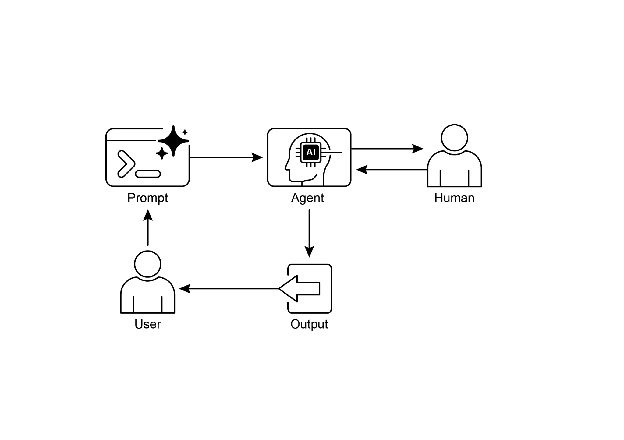

Google 智能体设计模式:人机协同(HITL)

核心思想

- HITL 模式(Human-in-the-Loop,HITL)强调将人类认知优势(判断力、创造力、细致理解)与AI 的计算能力结合。

- 在高风险、复杂或模糊场景中,完全自主的 AI 并不可靠,HITL 提供了安全、道德、有效的保障。

- 目标不是替代人类,而是增强人类能力,形成协作生态系统。

HITL 的关键方面

-

人类监督

- 通过日志、仪表板等方式监控 AI 输出,确保合规与安全。

-

干预与纠正

- 当 AI 出错或遇到模糊情况时,人类可介入,提供缺失数据或修正。

-

学习的人类反馈

- 人类反馈用于改进模型(如 RLHF),影响 AI 的学习轨迹。

-

决策增强

- AI 提供分析与建议,人类做最终决策。

-

人机协作

- 常规任务由 AI 处理,复杂谈判或创造性问题由人类主导。

-

升级策略

- 规定 AI 何时、如何将任务交给人类,避免超出能力范围的错误。

优势与注意事项

-

优势

- 提升准确性、安全性与道德合规性

- 提供持续改进机制

- 适用于敏感行业(金融、法律、医疗等)

-

注意事项

- 可扩展性不足:人类无法处理海量任务 → 需混合模式(自动化+HITL)

- 依赖专家知识:如代码审查、法律判断等需专业背景

- 隐私问题:敏感数据需匿名化,增加流程复杂性

实际应用与用例

- 内容审核:AI 过滤大部分内容,模糊案例交由人工审核。

- 自动驾驶:AI 处理常规驾驶,复杂情况交还人类。

- 金融欺诈检测:AI 标记可疑交易,人类分析师最终裁定。

- 法律文件审查:AI 初筛,人类律师确认上下文与法律含义。

- 客户支持:常规问题由 AI 处理,复杂或情绪化问题转人工。

- 数据标注:人类提供高质量标注,持续改进模型。

- 生成式 AI:人类编辑审查 AI 输出,确保符合品牌与质量标准。

- 自主网络管理:AI 监控网络,关键决策交由人类批准。

变体:Human-on-the-Loop

- 人类设定总体策略,AI 执行即时操作。

- 案例:

- 自动金融交易:人类设定投资规则,AI 实时执行交易。

- 呼叫中心:人类经理设定升级规则,AI 实时处理客户请求。

关键要点

- HITL 是负责任 AI 部署的基石。

- 在高风险、复杂或模糊任务中不可或缺。

- 提供持续改进与道德保障。

- 缺点:可扩展性不足、依赖专家、隐私挑战。

结论

- HITL 模式确保 AI 与人类价值观、安全规范保持一致。

- 在内容审核、医疗诊断、金融、法律、自动驾驶等领域具有广泛应用。

- 随着 AI 进步,HITL 将继续作为核心设计模式,保证 AI 的可信度与有效性。