AI大事记9:从 AlexNet 到 ChatGPT——深度学习的十年跃迁(下)

2 从 AlexNet 到 GPT

2.1 技术演进的关键节点

AlexNet 的成功开启了深度学习技术爆发式发展的序幕。从 2012 年到 2025 年,深度学习技术经历了多个关键发展阶段,每个阶段都代表着技术范式的重大突破。

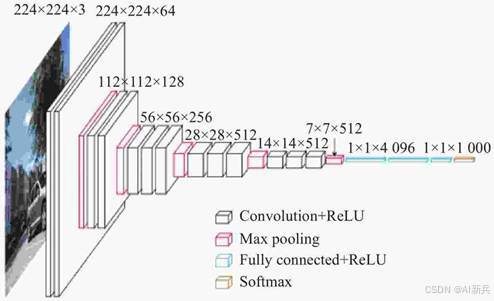

2012-2015 年是深度学习在计算机视觉领域的快速发展期。AlexNet 的成功直接催生了一系列后续模型的诞生。2014 年,牛津大学的 VGG 团队提出了 VGGNet,通过使用小尺寸的 3×3 卷积核堆叠出 16-19 层的更深网络,进一步证明了网络深度对性能提升的重要性。

图 3 VGGNet

同年,Google 提出的 GoogLeNet 引入了 Inception 模块,允许网络同时学习多个不同大小的特征,并通过大量使用 1×1 卷积核来降低参数数量。2015 年,微软研究院的何恺明团队提出了 ResNet(残差网络),通过引入残差连接解决了极深网络的训练难题,使得构建超过 100 层的网络成为可能。

2017 年是深度学习架构的重大转折点。这一年,Google 团队提出了 Transformer 架构,引入了革命性的自注意力机制(Self-Attention)。与传统的循环神经网络(RNN)和卷积