网站备案 二级域名学会网站建设项目

摘要:基于自注意力机制的Transformer架构已成为序列建模任务的事实标准。然而,其核心计算原语的时间复杂度随序列长度呈平方级增长(O(N²)),在处理长上下文时形成显著瓶颈。本文提出门控联想记忆(Gated Associative Memory,GAM)网络——一种用于序列建模的全新全并行架构,其时间复杂度相对于序列长度呈线性(O(N))。GAM模块采用两条并行路径替代自注意力层:因果卷积路径高效捕获局部位置相关上下文,并行联想记忆检索路径建模全局内容相关模式。这两条路径通过门控机制动态融合,使模型能够针对每个标记灵活组合局部与全局信息。我们从头实现GAM架构,并在WikiText-2基准测试中与标准Transformer模型和现代线性时间复杂度基线模型(Mamba)展开严格对比分析,同时在TinyStories数据集上与Transformer进行对比。实验表明,GAM的训练速度始终更快,超越两个基线模型,且在所有数据集上均取得更优或相当的最终验证困惑度,展现出作为高效序列建模替代方案的巨大潜力。Huggingface链接:Paper page,论文链接:2509.00605

研究背景和目的

研究背景:

在自然语言处理(NLP)和深度学习领域,序列建模是一项核心任务,广泛应用于语言建模、机器翻译、文本生成等多个方面。长期以来,基于自注意力机制的Transformer架构因其能够捕捉序列中任意位置间的复杂依赖关系而成为序列建模的主流方法。然而,自注意力机制的计算复杂度随序列长度的平方增长(O(N^2)),这在处理长序列时成为显著瓶颈,限制了其在高分辨率文档摘要、基因组数据分析、长视频流处理等需要处理极长序列场景中的应用。

为了解决这一问题,近年来研究者们提出了多种“高效Transformer”模型,试图通过稀疏化、低秩分解、核化等方法近似自注意力矩阵,以降低计算复杂度。尽管这些方法在一定程度上缓解了计算压力,但往往引入了架构复杂性或在表达能力上做出了妥协。与此同时,一些研究重新审视了循环神经网络(RNNs)及其变体(如LSTMs、GRUs),这些模型天然具有线性计算复杂度(O(N)),但其顺序处理特性使得在现代硬件上难以并行化,导致训练时间较长。

在此背景下,状态空间模型(SSMs)特别是如Mamba这样的线性时间模型,通过引入选择机制和硬件感知的并行扫描算法,展示了优异的性能。然而,这些模型重新引入了某种形式的递归,可能限制其在某些场景下的应用。因此,探索一种既具备线性计算复杂度又完全可并行化且不依赖递归的新型序列建模架构,成为当前研究的重要方向。

研究目的:

本研究旨在提出一种全新的序列建模架构——门控关联记忆网络(Gated Associative Memory, GAM),该架构旨在解决Transformer模型在处理长序列时的计算瓶颈问题。具体目标包括:

- 设计线性复杂度架构:开发一种计算复杂度为O(N)的序列建模架构,使其能够高效处理长序列数据。

- 实现完全并行化:确保新架构在现代加速器上能够完全并行化,避免递归设计,从而提高训练效率。

- 捕捉局部与全局上下文:通过结合局部上下文建模(如位置依赖的句法关系)和全局上下文建模(如内容依赖的语义模式),提升模型对序列信息的全面捕捉能力。

- 验证架构有效性:在标准语言建模任务上,通过对比实验验证GAM架构相对于传统Transformer和现代线性时间基线模型(如Mamba)在训练速度和建模性能上的优势。

研究方法

1. 架构设计:

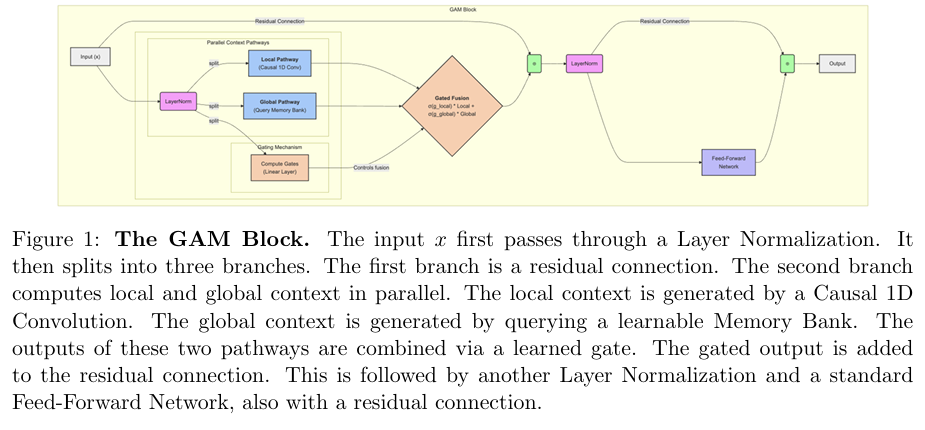

GAM网络由L个相同的GAM块堆叠而成,每个GAM块替代了Transformer中的多头自注意力子层。GAM块的核心创新在于其并行双路径设计:

- 局部上下文路径:采用一维因果卷积高效捕捉局部位置依赖的上下文信息。因果卷积通过不对称填充确保信息仅从过去流向未来,适用于序列建模。

- 全局上下文路径:引入并行关联记忆检索机制,通过学习一个记忆库来同时检索所有标记的全局内容依赖模式。每个标记的表示与记忆库中的所有槽进行点积相似度评分,通过softmax函数得到注意力加权的全局上下文。

- 门控融合机制:局部和全局上下文路径的输出通过一个可学习的门控机制动态融合,允许模型根据每个标记的需要灵活分配资源。

2. 实现细节:

- 初始化与参数设置:所有模型使用相似的规模和超参数进行构建,以确保公平比较。例如,GAM模型采用6层结构,嵌入维度为512,关联记忆库包含512个槽,因果卷积核大小为3。

- 训练配置:所有模型在单个NVIDIA T4 GPU上从头开始训练5个epoch,使用AdamW优化器,学习率为3×10^-4,批次大小为32。采用线性预热和余弦衰减的学习率调度器,并应用梯度裁剪。

3. 评估指标:

- 准确性:通过验证集上的困惑度(PPL)衡量模型的语言建模性能,困惑度越低表示模型越好。

- 效率:通过每个训练epoch的平均墙钟时间衡量模型的训练速度。

研究结果

1. 效率分析:

实验结果表明,GAM架构在训练速度上显著优于传统Transformer和现代线性时间基线模型Mamba。在WikiText-2数据集上,GAM的平均epoch时间比Mamba快7.8%,比Transformer快11.1%。这种效率优势在处理更大规模的数据集(如TinyStories)时依然保持,GAM比Transformer快10.5%。这主要得益于GAM完全并行化、非递归的设计,充分利用了现代GPU的并行处理能力。

2. 缩放基准测试:

通过系统增加序列长度进行的缩放基准测试显示,GAM架构的计算和内存需求随序列长度线性增长,而Transformer则呈现平方级增长。在序列长度超过2048时,Transformer因内存不足而失败,而GAM仍能稳定运行。这验证了GAM在处理长序列时的显著优势。

3. 性能分析:

在建模性能方面,GAM在两个数据集上均取得了优于基线模型的结果。在WikiText-2上,GAM的最终验证困惑度为882.57,明显低于Transformer的918.99和Mamba的1017.54。在TinyStories上,GAM也取得了更低的最终困惑度(23.15 vs. Transformer的23.55)。这表明GAM的架构设计不仅提高了计算效率,还增强了模型的表达能力。

4. 消融研究:

消融研究验证了GAM架构中各组件的重要性。移除门控机制导致困惑度显著上升,表明动态融合局部和全局上下文的重要性。仅使用全局路径或局部路径的模型性能均不如完整架构,进一步证明了双路径设计的优势。

研究局限

尽管GAM架构在效率和性能上均取得了显著成果,但本研究仍存在一些局限:

- 模型规模与数据集大小:当前实验在中等规模的模型和数据集上进行,未来需要在更大规模的模型和更广泛的数据集上验证GAM的扩展性和性能极限。

- 任务多样性:当前研究主要关注语言建模任务,未来需要探索GAM在其他序列建模任务(如机器翻译、文本生成)上的应用效果。

- 记忆库的解释性:尽管关联记忆库在模型中起到了关键作用,但其学习到的模式和知识的解释性仍是一个开放问题。未来研究可以深入分析记忆库中的内容,以更好地理解模型的工作机制。

未来研究方向

基于当前研究的成果和局限,未来研究可以从以下几个方面展开:

- 扩展模型规模和数据集:在更大规模的模型和更广泛的数据集上训练和评估GAM,以探索其性能极限和扩展性。

- 多任务学习:探索GAM在多任务学习场景下的应用,通过共享记忆库和局部上下文路径,实现不同任务间的知识迁移和共享。

- 记忆库解释性:深入研究关联记忆库中的内容,通过可视化、聚类等方法分析模型学习到的模式和知识,提高模型的可解释性。

- 长序列应用:在需要处理极长序列的任务(如高分辨率文档摘要、基因组数据分析)上评估GAM的性能,以验证其在实际应用中的优势。

- 硬件优化:针对特定硬件平台优化GAM的实现,进一步提高其并行化效率和计算性能,以满足实际应用的需求。

通过这些未来研究方向,可以进一步推动GAM架构的发展和应用,为序列建模领域带来更加高效和强大的解决方案。