RCNN系列边界框回归损失函数

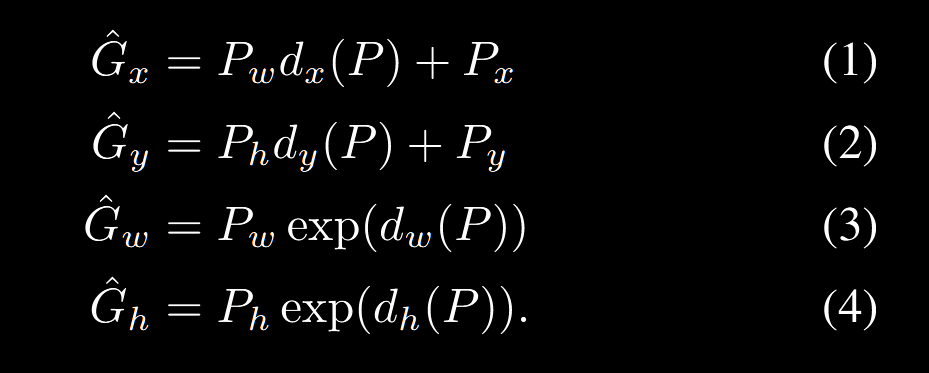

以上4个公式是RCNN论文附录C中的。

笔者一开始有点认不出这个公式是怎么来的,但是细想一下,也比较自然。

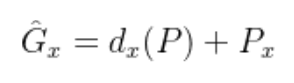

对于公式(1),如果改写成如下:

候选框x坐标+回归值=预测值,是不是更自然?

但就像神经网络中的各种normalization一样,如果能够保证dx稳定在-1到1之间,训练效果就会更好,因此就用这个归一化后的值乘以Pw,就变成公式(1)了

公式(2)同理

对于公式(3)和(4),原理类似:

1.实现尺度不敏感(Scale-Invariant)的回归

2.保证预测的宽高为正值