【跟我学YOLO】YOLO26:YOLO Vision 2025 最新发布的端到端视觉 AI 新突破

欢迎关注『跟我学 YOLO』系列

【跟我学YOLO】YOLO26:Ultralytics 在 YOLO Vision 2025 最新发布

- 0. YOLO26:Ultralytics 在 YV25 发布的端到端视觉 AI 新突破

- 1. 设计理念:让视觉 AI 更简单、更普惠

- 2. YOLO26概览:从检测到分割的全能模型

- 2.1 核心原则

- 2.2 支持的视觉任务

- 2.3 支持的部署平台

- 3. YOLOL26 架构创新:端到端推理与轻量化升级

- 3.1 YOLOL26 架构的创新设计

- 3.2 YOLOL26 的性能指标

- 3.3 YOLOL26 的边缘性能

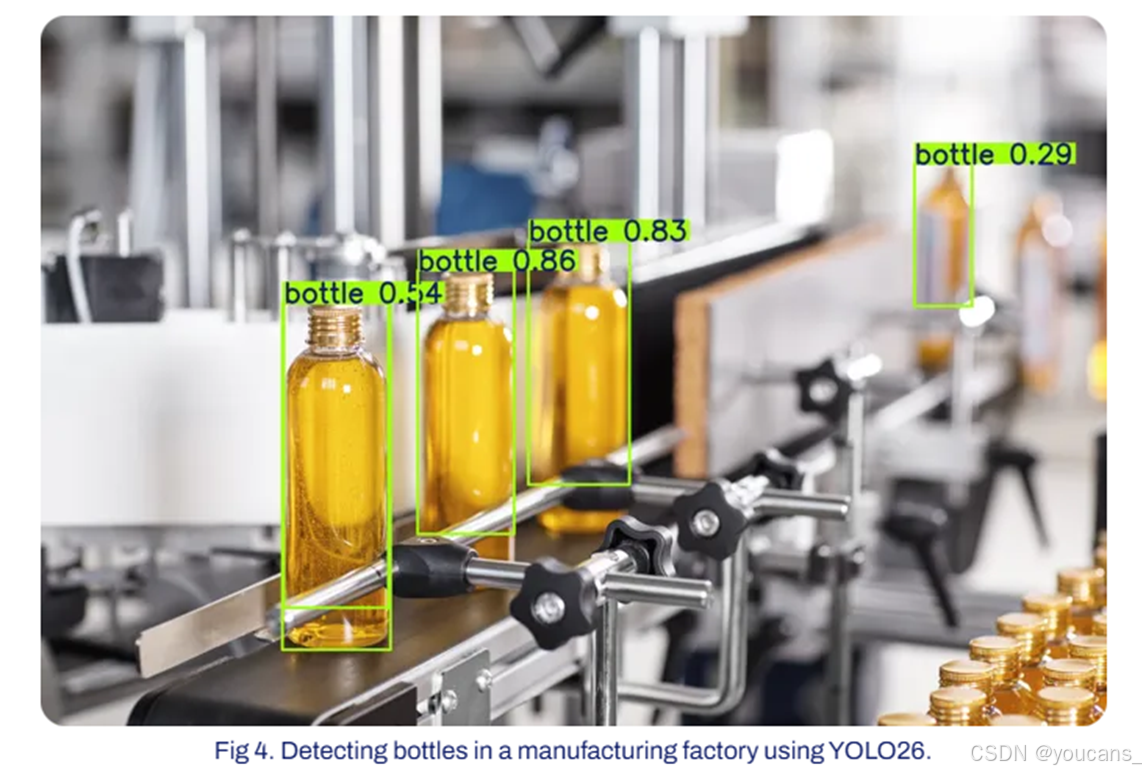

- 4. 应用场景:从机器人到制造业

0. YOLO26:Ultralytics 在 YV25 发布的端到端视觉 AI 新突破

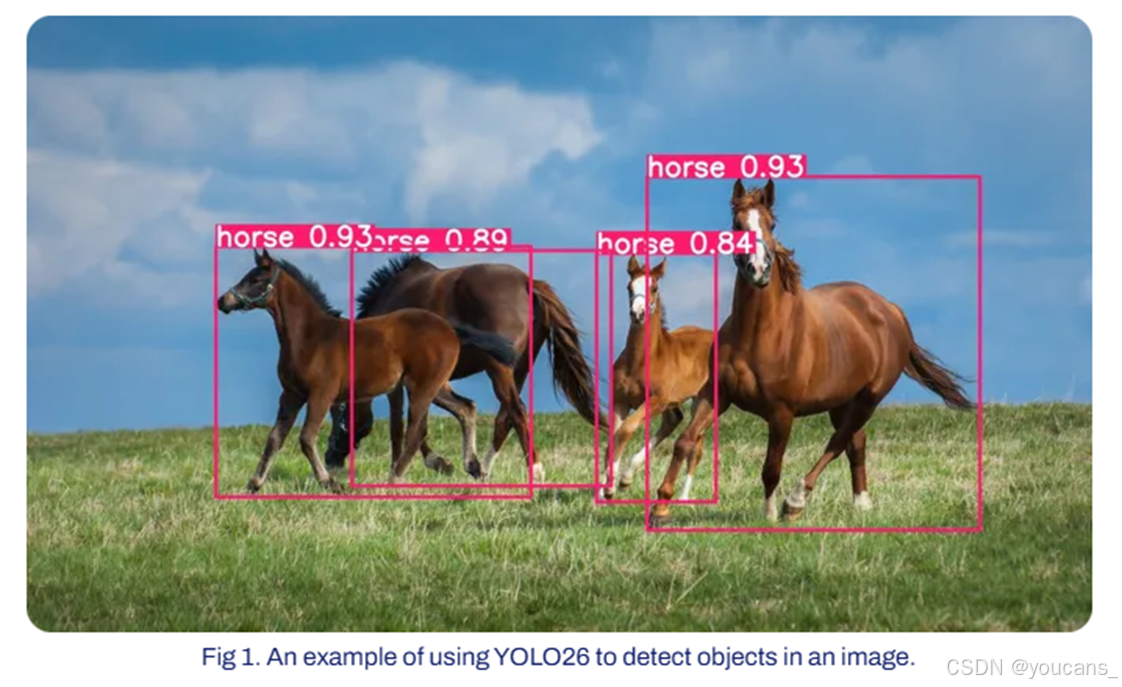

YOLO26 来了!

9 月 25 日,在伦敦举行的年度盛会 YOLO Vision 2025(YV25)上,Ultralytics 创始人兼 CEO Glenn Jocher 正式宣布了 Ultralytics YOLO 模型系列的最新突破——Ultralytics YOLO26!

YOLO26 是一款 更快、更轻、更准、易部署 的 Vision AI 产品,它不仅延续了 YOLO 系列一贯的速度与易用性,还在端到端架构、训练优化和多任务支持上带来了革命性突破。

YOLO26简化了模型设计的各个方面,并增加了新的增强功能,同时还继续提供用户熟悉的Ultralytics YOLO模型功能。例如,Ultralytics YOLO26 易于使用,支持一系列计算机视觉任务,并提供灵活的集成和部署选项。

简而言之,Ultralytics YOLO26 是一款更好、更快、更小的 Vision AI 模型。在正式发售(10 月底开放)之前,让我们来全面解析 YOLO26 的功能与优势。

1. 设计理念:让视觉 AI 更简单、更普惠

Ultralytics 从成立起就有两大使命:

- 普及 AI 技术 ——让所有人都能无障碍使用。

- 保持尖端性能 ——不断突破视觉模型的速度与精度极限。

随着 边缘计算 的兴起,用户越来越希望在智能相机、无人机或移动设备上实现实时视觉推理。这对模型提出了新的要求:更轻、更快,同时保证精度。YOLO26 正是在这一背景下诞生的。

Glenn Jocher 在发布会上表示:

“最大的挑战之一,就是在保持卓越性能的同时,让用户最大化利用 YOLO26 的简单性与高效性。”

2. YOLO26概览:从检测到分割的全能模型

YOLO26 是YOLO 系列实时物体检测器的最新产品,专为边缘和低功耗设备而设计。它采用精简设计,消除了不必要的复杂性,同时集成了有针对性的创新技术,以提供更快、更轻和更方便的部署。

2.1 核心原则

YOLO26 的架构遵循三个核心原则:

- 简单:YOLO26 是一个原生的端到端模型,无需非最大抑制(NMS)即可直接生成预测结果。由于省去了这一后处理步骤,推理变得更快、更轻便,也更容易部署到现实世界的系统中。这一突破性方法由清华大学的王敖在YOLOv10中首创,并在 YOLO26 中得到进一步发展。

- 部署效率:端到端设计省去了管道的整个阶段,大大简化了集成、减少了延迟,并使不同环境下的部署更加稳健。

- 训练优化:YOLO26 引入了MuSGD 优化器,它是SGD和Muon的混合体,灵感来自 Moonshot AI 在 LLM 训练中取得的Kimi K2突破。该优化器具有更高的稳定性和更快的收敛速度,将语言模型中的优化技术应用到了计算机视觉领域。

这些创新结合在一起,使模型系列在小型物体上实现了更高的精度,提供了无缝部署,在 CPU 上的运行速度提高了 43%,从而使 YOLO26 成为迄今为止在资源有限的环境中最实用、最易部署的YOLO 模型之一。

2.2 支持的视觉任务

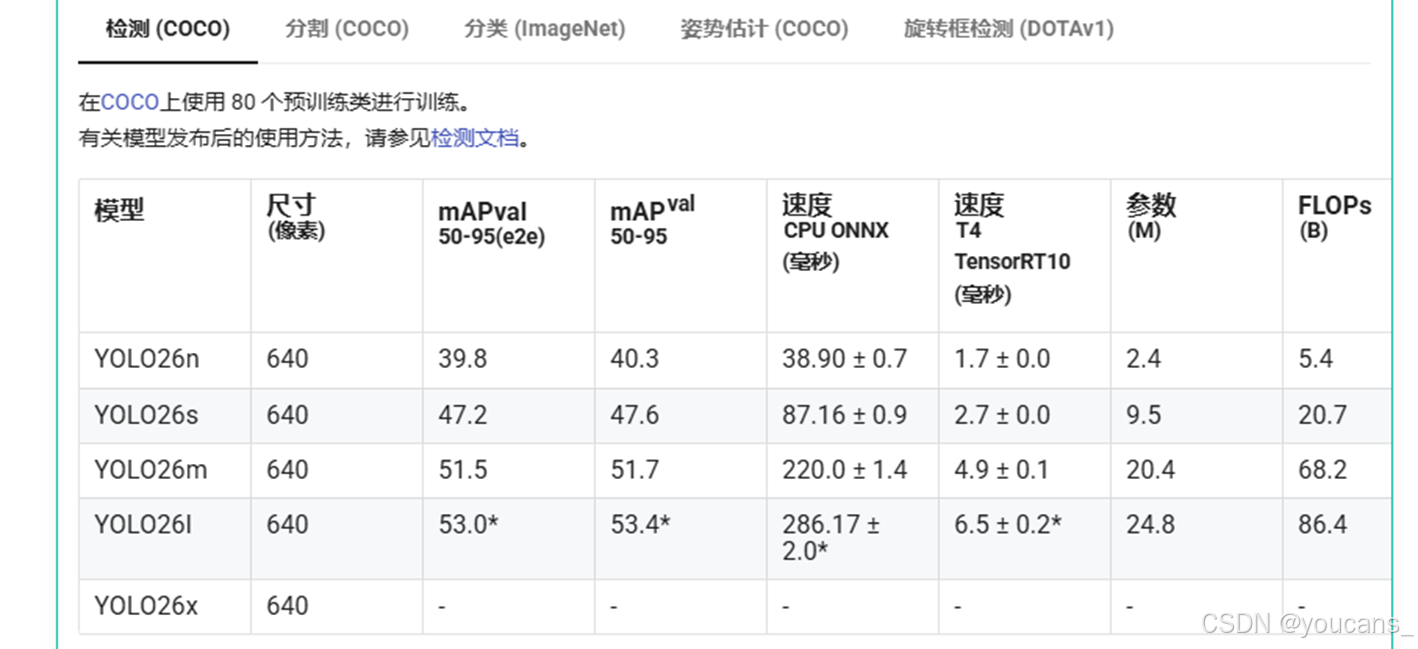

YOLO26 提供 五种不同的型号,用户可根据任务规模自由选择。

YOLO26 支持的计算机视觉任务概览:

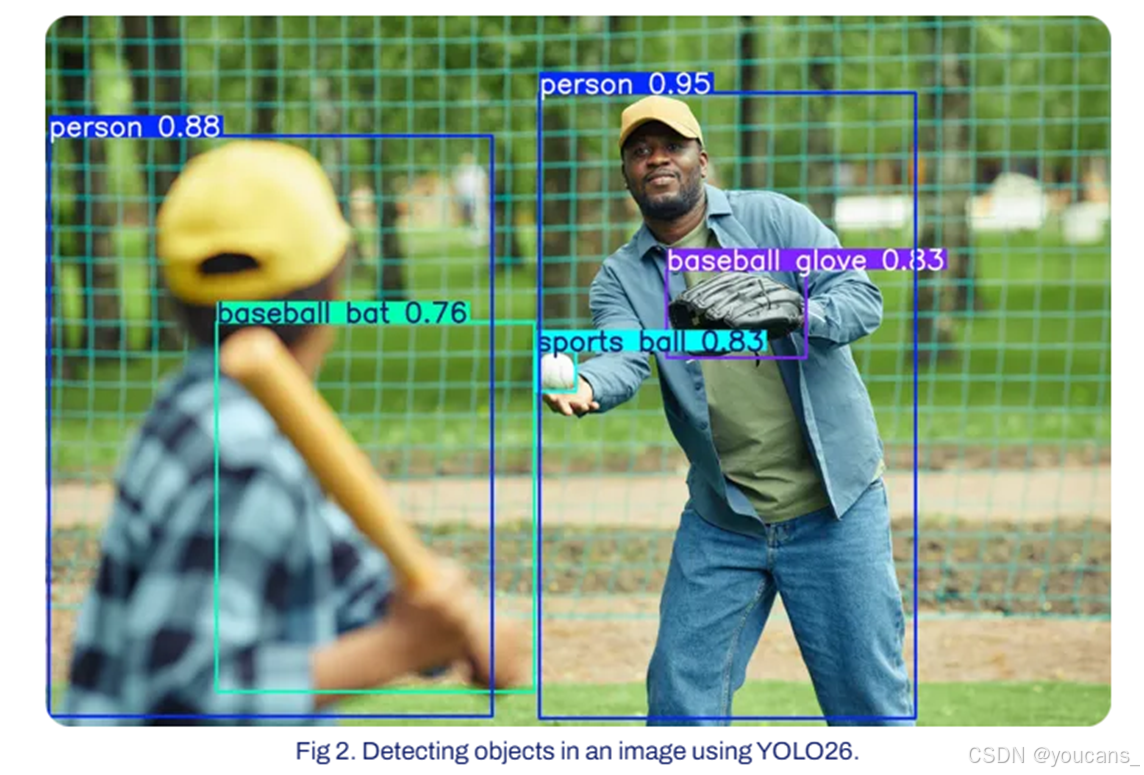

- 目标检测:比检测更进一步,YOLO26 可以在识别的每个对象周围生成像素完美的边界。

- 实例分割:生成像素级边界,更好地理解物体形状。

- 图像分类:该模型可分析整幅图像,并将其归入特定类别或标签。

- 姿态估计:YOLO26 可以检测关键点,并估算人类和其他物体的姿态。

- 定向边界框 (OBB):可以检测任何角度的物体,尤其适用于航拍、无人机和卫星图像。

- 目标跟踪:YOLO26 可用于跟踪视频帧或实时流中的物体。

无论是轻量级边缘设备,还是企业级 AI 系统,YOLO26 都能无缝适配。

2.3 支持的部署平台

无论是移动应用程序、智能相机还是企业系统,部署 YOLO26 都非常简单灵活。Ultralytics Python软件包支持不断增加的导出格式,这使得YOLO26很容易集成到现有的工作流程中,并与几乎所有平台兼容。

YOLO26 的另一大亮点是部署友好性。通过 Ultralytics Python 软件包,用户可以轻松导出多种格式:

- TensorRT(GPU 加速最大化)

- ONNX(跨平台兼容性强)

- CoreML(适配 iOS)

- TFLite(适配 Android 与边缘设备)

- OpenVINO(优化英特尔硬件性能)

部署的另一个关键是确保模型在资源有限的设备上高效运行。这就是量化的作用所在。得益于其简化的架构,YOLO26 完美支持 INT8 量化 与 FP16 半精度推理,在保证精度的前提下进一步减小模型体积、提升速度。这意味着 YOLO26 不仅能在服务器集群中高速运行,也能在手持设备、智能相机等边缘环境中稳定工作。

3. YOLOL26 架构创新:端到端推理与轻量化升级

3.1 YOLOL26 架构的创新设计

YOLO26 的架构进行了创新设计:

- DFL 移除:通过移除分布焦点损失(DFL)模块,简化了模型的设计,该模块以前会减慢推理速度并限制边界框回归。。

- 端到端(E2E)/无 NMS:跳过了传统的非最大值抑制(NMS)步骤,直接输出最终预测结果,无需非最大抑制(NMS)后处理,使部署更轻便。

- ProgLoss & STAL:渐进损失平衡(ProgLoss)提升训练稳定性并提高准确性,小目标感知标签分配(STAL)增强小目标检测能力。

- MuSGD 优化器:结合 SGD 与 Muon 优势,灵感来自 Moonshot AI 在 LLM 训练中的 Kimi K2 突破,提高了训练收敛性并提升了整体性能。

这些改进让 YOLO26 的 nano 版本在标准 CPU 上的速度提升 43%,特别适合移动应用程序、智能相机和其他对速度和效率要求极高的边缘设备。。

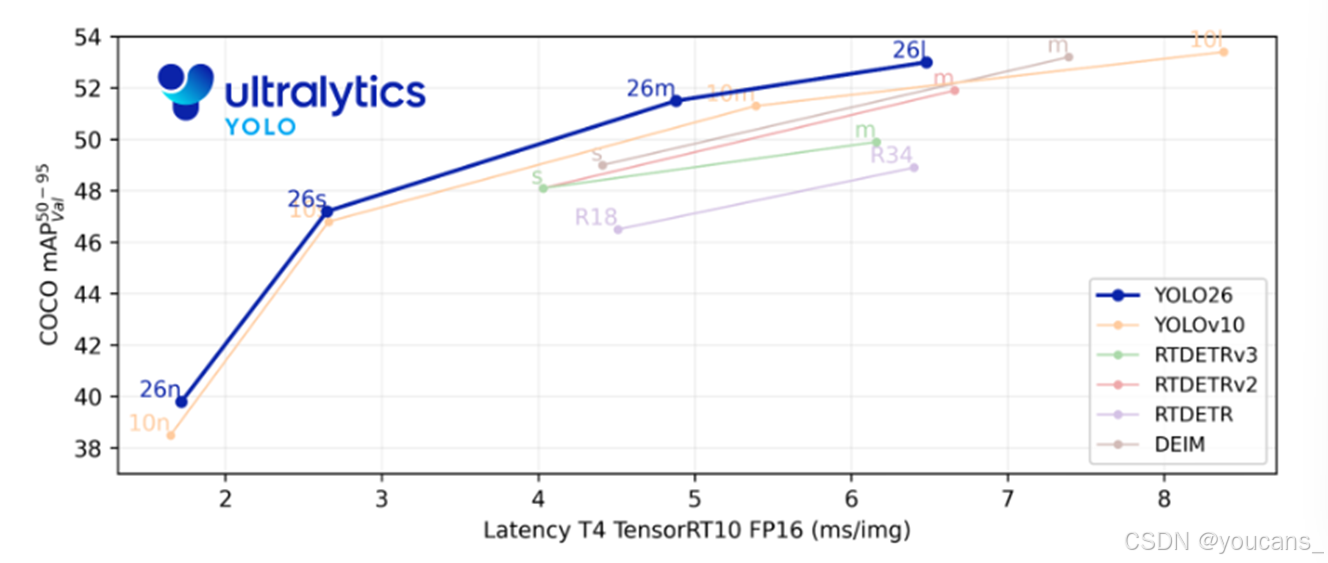

3.2 YOLOL26 的性能指标

3.3 YOLOL26 的边缘性能

YOLO26 具有最先进的边缘性能:

- CPU 推理速度最多可提高 43

- 缩小模型尺寸,减少内存占用

- 简化架构以实现兼容性(无 DFL、无 NMS)

- 灵活的导出格式,包括TensorRT、ONNX、CoreML、TFLite 和OpenVINO

4. 应用场景:从机器人到制造业

YOLO26 的轻量化和高精度,使其在多个行业展现潜力:

- 机器人:YOLO26 可以帮助机器人实时解读周围环境。这使得导航更加顺畅,物体处理更加精确。它还能使机器人与人的协作更加安全。

- 制造业:自动化缺陷检测,与人工检测相比,它可以更快、更准确地自动识别生产线上的缺陷。

- 智能交通:在低功耗硬件上实现实时监控与预警。

- 无人机与遥感:通过 OBB 检测复杂角度的地面物体。

简而言之,YOLO26 的普适性让它成为 边缘 AI 与企业级系统的桥梁。

六、主要收获

YOLO26 并不是简单的“版本升级”,而是一次理念革新:

它通过 端到端简化、架构优化 和 训练创新,为计算机视觉带来了全新的速度与灵活性。

在 YV25 发布会上,Ultralytics 向我们展示了一个清晰的愿景:视觉 AI 的未来属于更轻量化、更智能、更普惠的模型。

YOLO26 正是这一愿景的重要里程碑。

👉 想第一时间体验 YOLO26?关注 Ultralytics GitHub 仓库,加入全球开发者社区,共同推动计算机视觉的发展。

【本节完】

如果您在研究中使用了 YOLO26,请引用原作:

@software{yolo26_ultralytics,author = {Glenn Jocher and Jing Qiu},title = {Ultralytics YOLO26},version = {26.0.0},year = {2025},url = {https://github.com/ultralytics/ultralytics},orcid = {0000-0001-5950-6979, 0000-0003-3783-7069},license = {AGPL-3.0}

}

版权声明:

欢迎关注『跟我学YOLO』系列

转发必须注明原文链接:

【跟我学YOLO】YOLO26:YOLO Vision 2025 最新发布的端到端视觉 AI 新突破

Copyright 2025 by youcans@Xidian

Crated:2025-09