InternVL3.5 开源:革新多模态架构,重塑感知与推理的边界

InternVL3.5 开源:革新多模态架构,重塑感知与推理的边界

近日,上海人工智能实验室正式向全球开源其新一代多模态大模型——书生·万象 InternVL 3.5。本次开源的模型实现了从单纯感知理解到实体交互能力的重大跨越,标志着多模态人工智能进入了新的发展阶段。

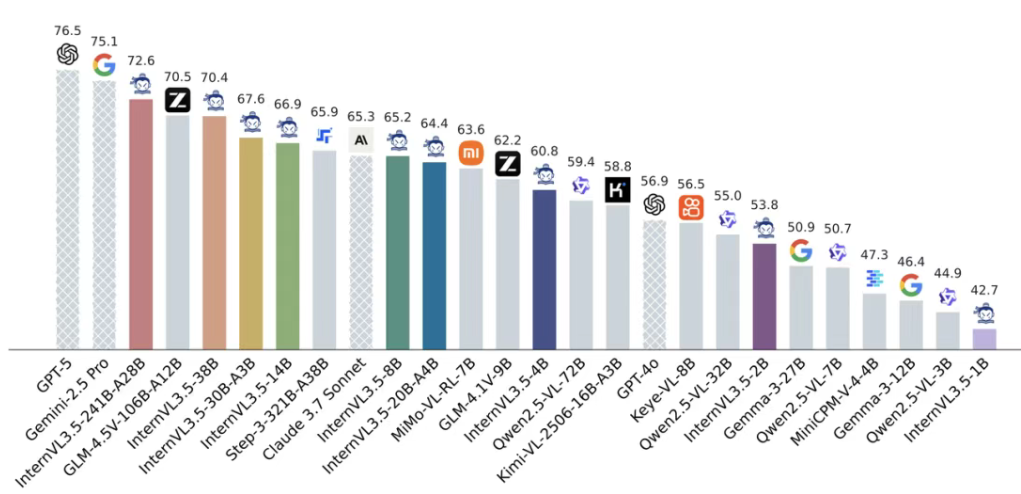

该模型通过创新的训练架构和算法突破,在通用多模态感知、复杂情境推理和文本理解等核心能力方面均展现出卓越性能。其旗舰模型在多学科综合推理评估中表现突出,位列全球开源模型领先地位。

更值得关注的是,新一代模型在多项特色能力上取得显著进展:

- 具备先进的图形用户界面理解与操作能力,支持跨平台自动化任务执行

- 在具身空间感知方面展现出色表现,为智能体导航与交互提供强大支撑

- 在矢量图形理解与生成任务中实现突破性进展

这些突破使 InternVL 3.5 不再是传统意义上的"观察者",而是能够真正理解环境、进行实体交互的智能体。该模型可自主完成文件管理、文档处理等日常办公任务,还能为机器人提供强大的视觉感知与决策能力,在智能制造、智能办公等领域展现出广阔应用前景。

作为上海人工智能实验室书生大模型体系的重要组成,InternVL 系列已在全球范围内获得广泛应用和认可。此次开源的 InternVL 3.5 将进一步推动多模态人工智能技术的发展,为科研机构和产业界提供更强大的基础模型支持,加速人工智能技术在各领域的创新应用。

核心亮点

上海人工智能实验室最新开源的 InternVL 3.5 多模态大模型展现出以下核心亮点:

一、全尺度模型开源,覆盖多元应用场景

提供从 10 亿到 2410 亿参数的九种规格模型,包含稠密模型与混合专家模型(MoE)架构,成为首个支持 GPT-OSS 语言基座的开源多模态模型,满足不同算力环境与任务复杂度需求。

二、多项基准测试表现卓越

旗舰模型在多学科推理、多模态感知及文本推理三大核心维度实现突破:

- 在多学科综合推理基准中位列开源模型榜首

- 多模态感知能力超越主流商业模型

- 文本推理成绩达到开源模型领先水平

三、创新级联强化学习框架

采用"离线预热-在线精调"两阶段训练策略,通过混合偏好优化与自研 GSPO 算法,在提升训练稳定性的同时显著降低计算成本。全系列模型推理性能较上一代平均提升 16 分,241B 模型在数学推理等复杂任务中表现尤为突出。

四、突破性部署优化技术

通过动态视觉分辨率路由(ViR)技术,实现语义区域自适应压缩,减少 50% 视觉 token 的同时保持任务性能;采用解耦部署框架(DvD),将视觉编码与语言生成并行处理,使 38B 模型在高分辨率场景下吞吐效率提升 4 倍,延迟降低 75%。

五、轻量化模型保持高性能

轻量版模型在视觉序列长度减少 50% 的情况下,仍能维持接近完整的性能表现,为资源受限场景提供高效解决方案。

六、智能体能力实现跨越

在三大核心应用场景取得突破性进展:

- **GUI交互:**在界面元素定位任务中超越同类模型,支持跨系统自动化操作

- **具身智能:**在空间推理测试中超过顶级商业模型,展现卓越的路径规划能力

- **矢量图形:**在理解与生成任务中刷新开源纪录,可专业应用于设计创作与工程解析领域

InternVL 3.5 通过技术创新实现了从"感知理解"到"实体交互"的能力跨越,为智能办公、智能制造等领域的应用落地提供了强大技术支撑。

社区地址

-

OpenCSG社区:

https://opencsg.com/models/AIWizards/InternVL3_5-38B -

Hugging Face社区:

https://huggingface.co/OpenGVLab/InternVL3_5-241B-A28B

关于 OpenCSG

OpenCSG 是全球领先的开源大模型社区平台,致力于打造开放、协同、可持续的 AgenticOps生态。核心产品 CSGHub 提供模型、数据集、代码与 AI 应用的一站式托管、协作与共享服务,具备业界领先的模型资产管理能力,支持多角色协同和高效复用。