超表面赋能结构光三维重建 | 实现超大视场高精度实时重建

原文信息

原文标题:“Super-Large Field-of-View, High-Accurate and Real-Time 3D Scene Reconstruction Based on Metasurface-Enabled Structured Light”

第一作者:Zhengren Zhan

通讯作者:Zhengren Zhan

三维场景重建主流技术对比分析

光学技术在传感探测领域中具有核心地位,而三维场景重建(即构建真实空间数字模型)的实现主要依赖三类技术,各技术的原理与局限如下:

1.纯视觉技术:通过摄像机采集目标场景的多视角图像,利用图像与现实空间的几何关系提取深度值,再经特征匹配与点云拼接获取全场景三维信息。但其短板在于摄像机对光照条件敏感,易导致深度信息精度不足。

2.激光雷达(LIDAR)技术:通过测量激光脉冲的发射 - 接收时间间隔,计算目标的距离、角度等参数。该技术需依赖复杂的系统结构,此前文献中已提及超表面在激光雷达系统中的应用可实现体积缩减。

3.结构光技术:伴随衍射光学的发展,该技术可无需机械扫描直接在空间生成随机点阵,有效弥补纯视觉与激光雷达的技术短板。但当前结构光技术仍面临系统厚度大、视场角小的关键问题。

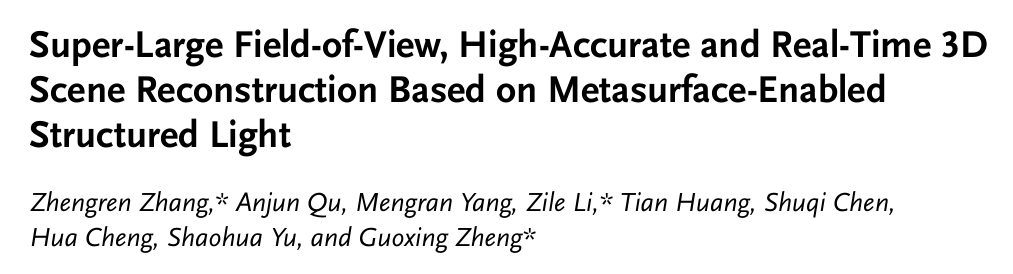

使用超表面投影随机点阵列重建的3D场景(来自原文)

超表面 - 结构光融合的三维重建方案设计

为突破结构光技术的现有瓶颈,作者团队提出超表面与结构光的融合方案,具体实现流程如下:

1.超表面投影设计:设计专用超表面,可将约 20000 个随机点投影至 4π 全空间范围;

2.深度信息计算:结合双目视觉技术与立体匹配算法,实时计算动态图像的深度信息,生成三维点云;

3.场景重建执行:通过连续帧的点云拼接完成增量点云重建,两台相机同步扫描捕获空间场景,再利用实时映射算法构建对应的三维点云与表面模型。

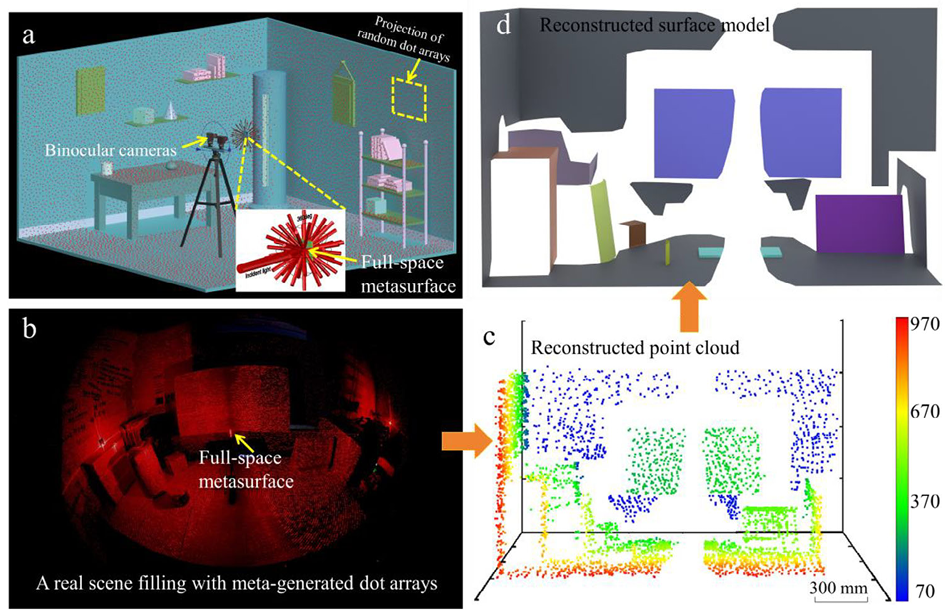

超表面结构(来自原文)

超表面核心参数与设计优化

选用基于几何相位的非晶硅纳米块作为超表面单元,通过调整单元转角实现相位调制。单元具体尺寸参数为:长度 250nm、宽度 120nm、高度 280nm,单元中心间距 300nm。

1.视场角(FOV):亮点的最大衍射角 θ 可达 85.3°,对应单次透射 / 反射空间的 FOV 为 170.6°,整体衍射点可覆盖 4π 全空间;

2.亮点比例设计:目标投影图案需 10000 个亮点,通过优化设计使亮点占所有可控点的比例约为 25%;

3.散斑抑制:超表面单个周期包含 200×200 个单元(间距 300nm),共设计 5×5 个周期以减少激光散斑。

衍射图案与相位算法

目标衍射图案的设计直接影响重建效果:若重建场景中存在规则形状物体,均匀光点阵列可能避开物体边缘导致轮廓信息丢失,而随机点阵列可在保证点数充足的前提下,使部分光点覆盖物体边缘,保留边缘细节。该随机点阵列对应的相位分布通过 Gerchberg-Saxton(GS)算法求解获得。

技术优势与前沿应用展望

与传统激光点云三维重建技术相比,基于超表面的结构光技术具有两大核心优势:一是显著提升视场角覆盖范围,二是在系统集成性上表现出突出优势。该技术为实时虚拟现实(VR)、全息通信、数字城市建设等前沿领域的发展奠定基础,未来有望在上述领域拓展更广泛的应用场景,具备广阔的技术应用潜力。

OAS 光学软件的超表面设计功能非常便捷,该功能将构建更为高效、精准的超表面设计流程,进一步推动光学领域的发展。OAS 光学软件已在超表面设计中展现卓越效能,为科研人员和工程师提供技术保障。