flume事务机制详解:保障数据可靠性的核心逻辑

flume事务机制详解:保障数据可靠性的核心逻辑

在数据采集过程中,“不丢数据、不重数据” 是核心需求。Flume 之所以能在分布式环境下保证数据可靠性,关键在于其内置的事务机制。Flume 通过在 “Source → Channel” 和 “Channel → Sink” 两个阶段分别引入事务,确保数据的原子性操作,即使出现故障也能通过回滚恢复数据。本文将深入解析 Flume 的事务原理、流程及核心保障机制。

为什么需要事务?

Flume 作为数据流转的中间件,需应对各种异常场景(如网络波动、组件崩溃、资源不足等)。事务的核心作用是:

-

原子性:确保一组数据要么全部成功处理,要么全部失败回滚,避免部分数据丢失或重复;

-

可靠性:通过临时缓冲和状态校验,在故障发生时恢复数据,保证数据最终一致性;

-

容错性:允许组件在故障后重启,通过事务日志或偏移量恢复未完成的操作。

Flume 事务的两大阶段

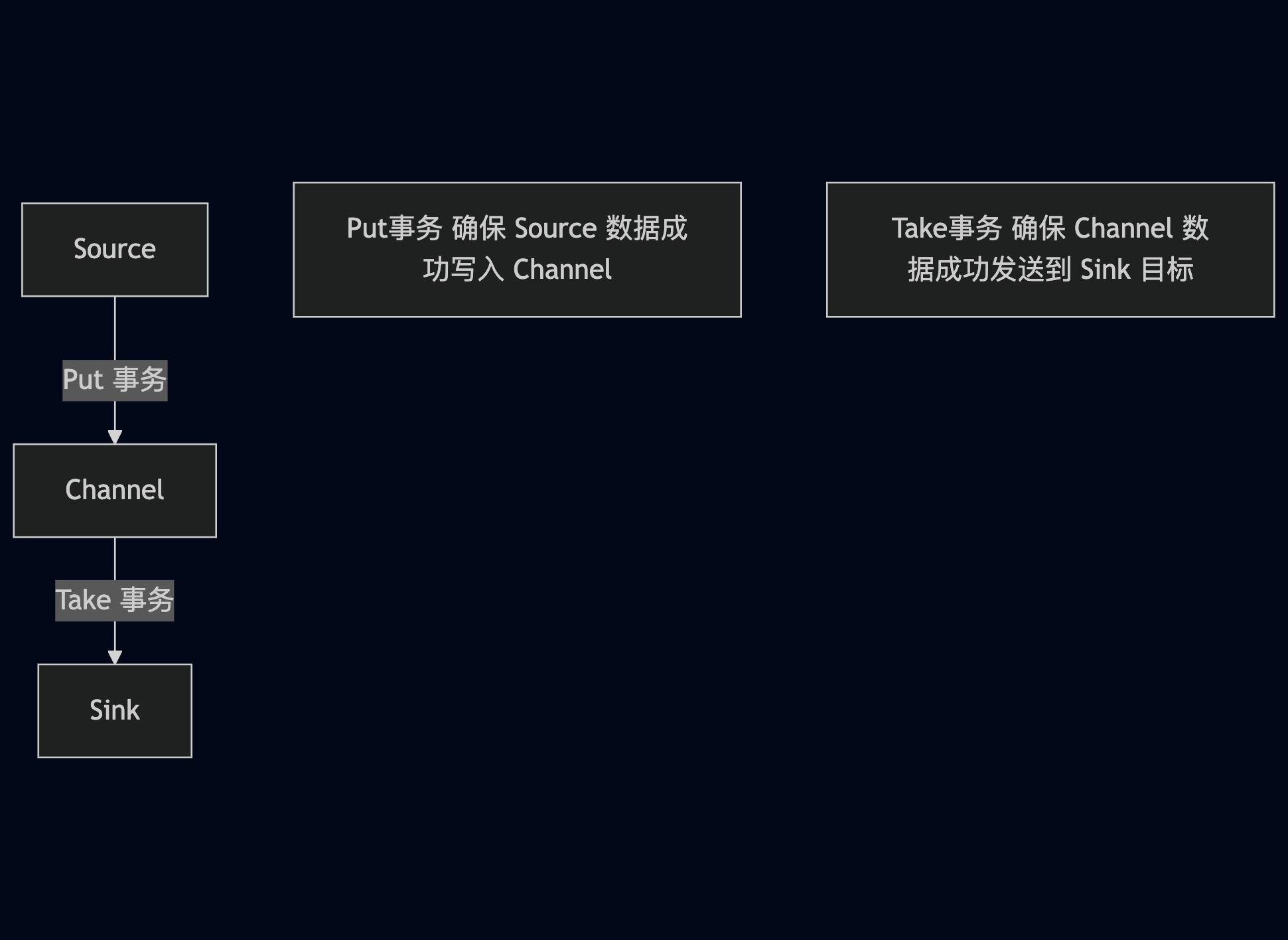

Flume 的事务机制贯穿数据流转的全流程,分为Put 事务(Source → Channel)和Take 事务(Channel → Sink),两个阶段独立保障数据可靠性。

第一阶段:Put 事务(Source → Channel)

Put 事务发生在 Source 向 Channel 写入数据的过程,确保 Source 采集的数据能可靠存入 Channel。

事务流程

Put 事务通过 “临时缓冲 → 校验 → 提交 / 回滚” 三个步骤保障原子性,具体流程如下:

1. doPut:数据写入临时缓冲区putlist

- Source 从数据源(如文件、Kafka)采集一批数据,封装为 Event 集合;

- 将 Event 临时存入 Source 内部的putList 缓冲区(内存中的临时列表),此时数据尚未写入 Channel;

- 目的:避免直接写入 Channel 时因突发故障(如 Channel 满)导致数据丢失。

2. doCommit:校验并提交数据到 Channel

- Source 调用 Channel 的

put()方法,尝试将 putList 中的所有 Event 写入 Channel; - Channel 校验自身状态(如内存 / 磁盘空间是否充足、是否可达):

- 校验通过:Channel 成功接收所有 Event,putList 清空,事务提交;

- 校验失败:触发

doRollback回滚操作。

3. doRollback:失败时回滚数据

- 若 Channel 写入失败(如内存不足、磁盘故障),

doRollback被调用; - putList 中的数据保留不清除,Source 可在后续重试时重新提交这批数据;

- 回滚后,Source 会根据配置的重试策略(如

restartThrottle)再次发起 Put 事务。

关键保障机制

- 临时缓冲(putList):数据先存入内存缓冲区,而非直接写入 Channel,避免写入过程中因 Channel 故障导致数据丢失;

- 批量提交:Source 通常批量处理 Event(如

batchSize=1000),减少事务次数,提升效率; - Channel 可靠性:不同 Channel 对 Put 事务的支持不同:

Memory Channel:依赖内存缓冲,故障时数据可能丢失(适合非核心场景);File Channel/Kafka Channel:通过磁盘或 Kafka 持久化存储,即使崩溃也能恢复 putList 数据。

第二阶段:Take 事务(Channel → Sink)

Take 事务发生在 Sink 从 Channel 读取数据并发送到目标存储(如 HDFS、Kafka)的过程,确保 Channel 中的数据能可靠送达目标。

事务流程

Take 事务通过 “临时读取 → 发送校验 → 提交 / 回滚” 三个步骤保障原子性,具体流程如下:

1. doTake:从 Channel 读取数据到临时缓冲区

- Sink 调用 Channel 的

take()方法,从 Channel 中读取一批 Event,存入 Sink 内部的takeList 缓冲区; - 此时 Channel 会标记这些 Event 为 “待处理” 状态(但未删除),确保即使 Sink 故障,数据仍在 Channel 中;

- 目的:避免数据从 Channel 读取后、发送到目标前因故障导致丢失。

2. doCommit:确认数据发送成功后提交

- Sink 将 takeList 中的 Event 发送到目标存储(如 HDFS 写入、Kafka 生产);

- 目标存储返回成功响应(如 HDFS 写入确认、Kafka 生产者

acks=1确认); - Sink 调用

doCommit,Channel 清除 “待处理” 状态的 Event,takeList 清空,事务完成。

3. doRollback:发送失败时回滚数据

- 若数据发送失败(如目标存储不可达、网络超时),

doRollback被调用; - Channel 将 “待处理” 状态的 Event 恢复为 “可用” 状态,允许 Sink 后续重新读取;

- takeList 中的数据保留,Sink 会根据重试策略再次发起 Take 事务。

关键保障机制

- 临时缓冲(takeList):数据从 Channel 读取后先存入 takeList,发送成功才删除 Channel 中的数据,避免 “已读未发” 场景下的数据丢失;

- 状态标记:Channel 对 Event 标记 “待处理” 状态,区分已读取但未提交的数据,支持故障恢复;

- 幂等性设计:部分 Sink(如 HDFS Sink)支持幂等写入(通过文件名唯一标识),即使因回滚导致重复发送,也不会产生重复数据。

事务失败的常见场景与恢复

Flume 事务通过回滚机制处理各类故障,以下是常见失败场景及恢复逻辑:

场景 1:Put 事务失败(Source → Channel)

- 失败原因:Channel 内存 / 磁盘不足、Channel 崩溃、网络分区(如 Kafka Channel 不可达);

- 恢复逻辑:

- putList 保留未提交数据,Source 触发

doRollback; - Source 根据配置的重试间隔(如

restartThrottle=5000ms)重新发起 Put 事务; - 若重试多次失败,部分 Source 会记录失败日志并暂停,避免无限重试消耗资源。

- putList 保留未提交数据,Source 触发

场景 2:Take 事务失败(Channel → Sink)

- 失败原因:目标存储(如 HDFS、Kafka)不可用、网络超时、数据格式错误;

- 恢复逻辑:

- takeList 保留未发送数据,Sink 触发

doRollback; - Channel 将 “待处理” Event 恢复为 “可用” 状态;

- Sink 重试 Take 事务,重新读取并发送这批数据,直至成功或达到最大重试次数。

- takeList 保留未发送数据,Sink 触发

场景 3:组件崩溃(如 Flume Agent 重启)

- 恢复逻辑:

- 若使用

File Channel或Kafka Channel:Channel 会通过磁盘日志或 Kafka 主题恢复未提交的 Event; - 若使用

Memory Channel:未提交的 putList/takeList 数据会丢失(因此核心场景不推荐 Memory Channel); - Source 和 Sink 重启后,通过事务日志或偏移量(如 Kafka 的 consumer offset)恢复未完成的事务。

- 若使用

不同 Channel 对事务的支持差异

Channel 是事务的核心载体,不同类型的 Channel 对事务的实现方式和可靠性保障不同,选择时需结合业务需求:

| Channel 类型 | 事务实现方式 | 数据可靠性 | 适用场景 |

|---|---|---|---|

| Memory Channel | 内存缓冲 + 无持久化日志 | 低 | 测试环境、非核心数据、对性能要求高 |

| File Channel | 磁盘日志 + 检查点(Checkpoint) | 高 | 核心数据、需完全不丢数据的场景 |

| Kafka Channel | 依赖 Kafka 主题的持久化机制 | 高 | 分布式环境、需高可用的场景 |

推荐实践

- 核心数据:优先选择

File Channel或Kafka Channel,通过持久化保障事务恢复; - 非核心数据:可使用

Memory Channel提升性能,但需接受故障时的数据丢失风险; - 高吞吐场景:

Kafka Channel支持分布式部署,适合大规模集群下的事务缓冲。

参考文献

- flume事务