《实际项目》空调水系统群控方案

不废话了 写一大堆LLM生成的文案没用 直接放方案框架

数据来之不易。。。

负荷预测–群控第一步,预测未来项目所需制冷量

以下从模型整体架构、各关键技术(LSTM、注意力机制、遗传算法 )及它们在流程里的协同作用,为你详细拆解方案:

一、模型整体流程与角色分工

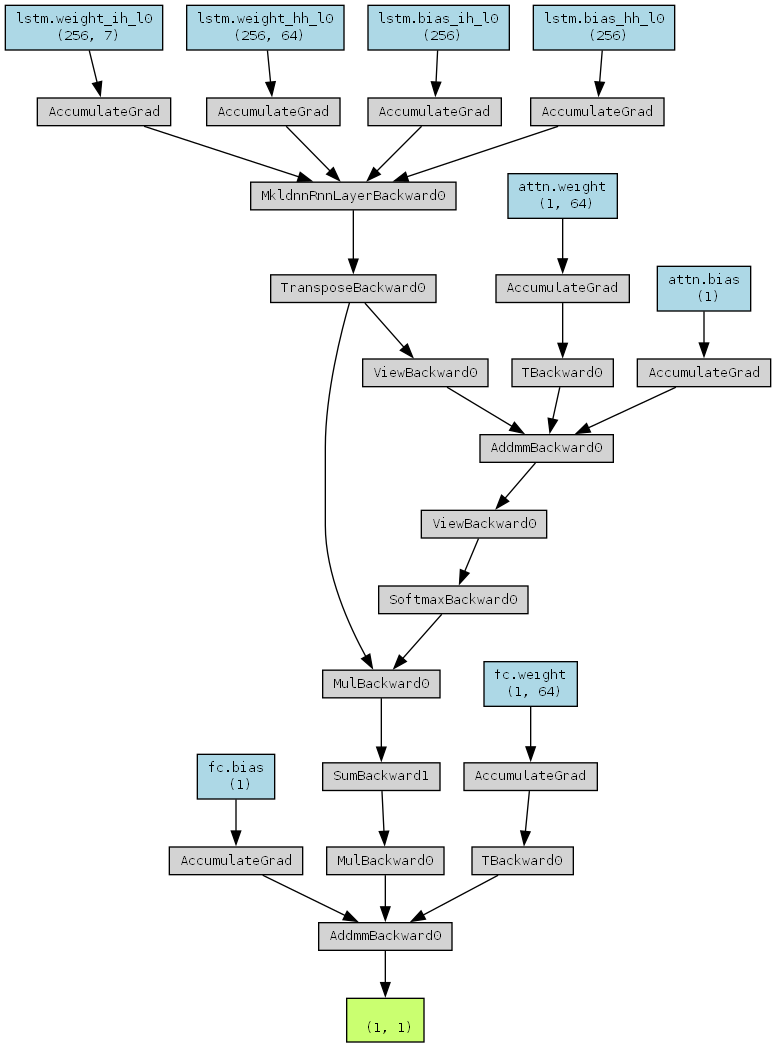

这是一个基于深度学习的预测/优化模型反向传播(Backward)计算图,核心目标是通过反向传播更新网络参数(如LSTM权重、注意力机制参数等 ),实现精准预测或优化。流程可大致分为:

- 参数初始化与前向传播依赖:浅蓝色方框是模型参数(如

lstm.weight_ih_l0等 ),它们在前向传播中参与计算,反向传播时要计算梯度(AccumulateGrad负责累加梯度用于参数更新 )。 - 反向传播计算流:从最终输出(绿色

(1,1))反向,通过各类Backward操作(如MulBackward0是乘法操作反向、SoftmaxBackward0是Softmax反向 ),逐层计算参数梯度,调整模型参数。

二、LSTM(长短期记忆网络)详解

- 作用:处理序列数据,捕捉负荷预测等场景中数据的时序依赖关系(比如历史负荷、气象数据随时间的变化规律 )。

- 参数与计算:

lstm.weight_ih_l0(输入到隐藏层权重,维度(256,7))、lstm.weight_hh_l0(隐藏层到隐藏层权重,维度(256,64)):前向传播时,用这些权重对输入序列、隐藏状态做线性变换,计算门控(输入门、遗忘门、输出门 )和候选隐藏状态。lstm.bias_ih_l0、lstm.bias_hh_l0:为线性变换添加偏置,让模型更灵活拟合数据。反向传播时,MltdnnRnnLayerBackward0等操作会基于前向结果,计算这些权重和偏置的梯度,后续AccumulateGrad累加梯度用于更新。

三、注意力机制(Attention)详解

- 作用:让模型聚焦序列中对预测/优化更关键的部分。比如负荷预测里,突出某些时刻(如上下班前 )的历史数据影响,提升模型对关键信息的捕捉能力。

- 参数与计算:

attn.weight(维度(1,64))、attn.bias(维度(1)):前向传播时,用这些参数对LSTM输出等特征做变换,计算注意力得分(通过Softmax等操作得到权重分布 ),加权聚合特征。- 反向传播中,

TBackward0(转置操作反向 )、AddmmBackward0(矩阵乘法反向 )等配合,计算注意力参数梯度,AccumulateGrad处理梯度更新,让模型后续更精准关注关键信息。

四、协同逻辑

- LSTM打底:处理时序数据,挖掘历史依赖,为注意力机制提供含时序信息的特征。

- 注意力机制强化:对LSTM输出加权,突出关键时序信息,让模型更聚焦对预测/优化重要的数据片段。

简言之,LSTM负责时序建模,注意力机制强化关键信息共同支撑起方案的精准预测与高效调控能力,反向传播流程则保障模型参数在数据驱动下持续迭代优化 。

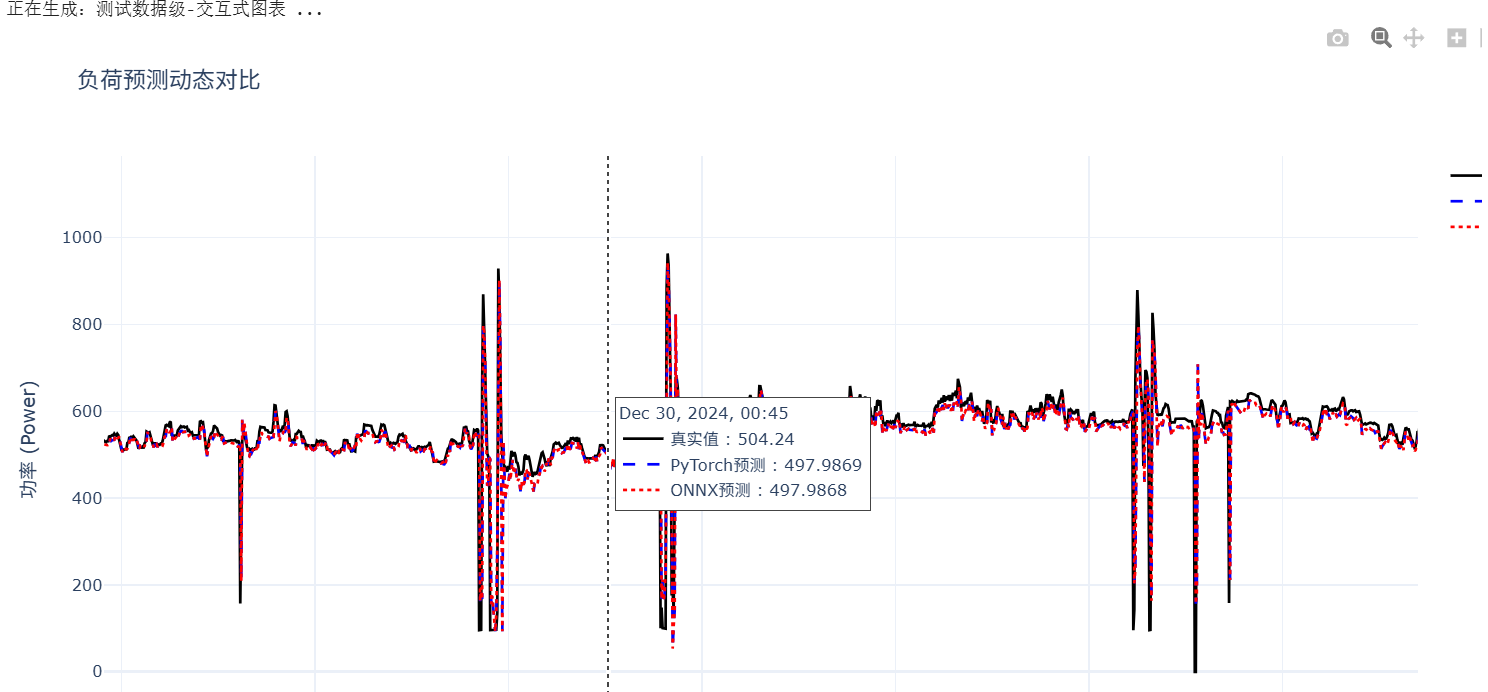

五、可视化结果

下一章,各设备的模型建立(机理模型)。。。未完待续