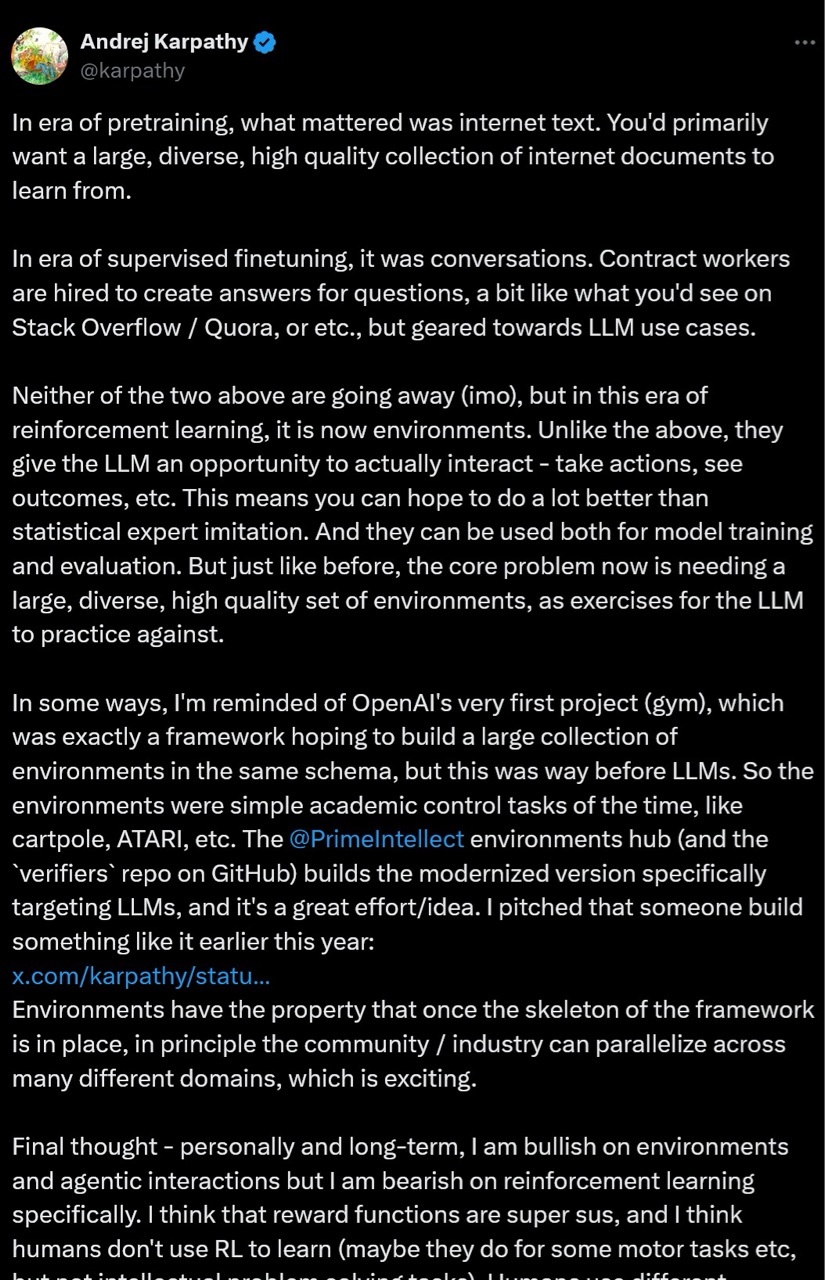

Vibe Coding 概念提出者 AndrejKarpathy 谈强化学习。

在预训练时代,关键在于互联网文本。你最需要的是一大批量、多样化且高质量的互联网文档,供模型从中学习。

在监督微调(SFT)时代,核心则是对话数据。人们雇佣合同工人为问题撰写答案,类似于你在 Stack Overflow 或 Quora 上看到的内容,但专门针对大语言模型(LLM)的应用场景进行优化。

我认为以上两个阶段都不会消失,但在当前的强化学习时代,关键要素变成了“环境”(environments)。与前两者不同,环境能让大语言模型真正地进行交互——采取行动、观察结果等。这意味着我们有望超越简单的“统计专家行为模仿”,实现更深层次的学习。这些环境既可用于模型训练,也可用于模型评估。但和之前类似,现在核心的挑战在于:我们需要大量、多样化且高质量的环境,作为 LLM 练习的“习题集”。

从某种意义上说,这让我想起了 OpenAI 最早的项目——Gym。那正是一个旨在构建大量统一格式环境的框架,只不过当时远早于大语言模型的兴起,因此那些环境大多是当时简单的学术控制任务,比如倒立摆(cartpole)、ATARI 游戏等。而 PrimeIntellect 的“环境中心”(environments hub),以及其 GitHub 上的 verifiers 仓库,则构建了一个面向现代 LLM 的升级版框架,这是一个非常出色的尝试和构想。今年早些时候,我也曾提议有人来构建类似的东西。

环境的一个重要特性是:一旦框架的基本结构搭建完成,原则上社区和产业界就可以在不同领域并行开发,这令人非常振奋。

最后一点思考——就个人而言,从长期来看,我非常看好“环境”以及“具身智能体式交互”(agentic interactions)的发展前景,但我对“强化学习”(reinforcement learning, RL)本身持谨慎态度(看跌)。

我认为奖励函数(reward functions)存在严重问题,而且我相信人类在学习时并不主要依赖强化学习(也许在某些运动控制类任务中会用到,但在智力型问题解决中并非如此)。人类使用的是更强大、更高效的其他学习范式,而这些范式尚未被充分发明或规模化应用。

不过,目前已有一些初步的设想和雏形(例如,“系统提示学习”这一概念,即把模型更新从权重调整转移到提示词/上下文本身,之后可选择性地将知识“蒸馏”回权重中——这个过程有点像睡眠对大脑的作用)。