如何在自己的电脑上部署Deepseek,Deepseek本地部署

为什么要部署本地 DeepSeek?

在本地部署 DeepSeek 有以下几个优势:

1、隐私性高:数据都在本地运行,无需上传到云端,避免数据泄露风险。

2、稳定性强:不受网络波动影响,模型运行更加稳定。

3、可定制性强:可以根据需求调整模型参数,满足个性化需求。

怎么部署本地大模型?

在本地部署 DeepSeek 只需要以下三步:

1、安装 Ollama。

2、下载 DeepSeek 模型。

3、使用 DeepSeek:这里我们使用 ChatBox 客户端操作 DeepSeek(此步骤非必须)。

Ollama、DeepSeek 和 ChatBox 之间的关系如下:

Ollama 是“大管家”,负责把 DeepSeek 安装到你的电脑上。

DeepSeek 是“超级大脑”,住在 Ollama 搭建好的环境里,帮你做各种事情。

ChatBox 是“聊天工具”,让你更方便地和 DeepSeek 交流。

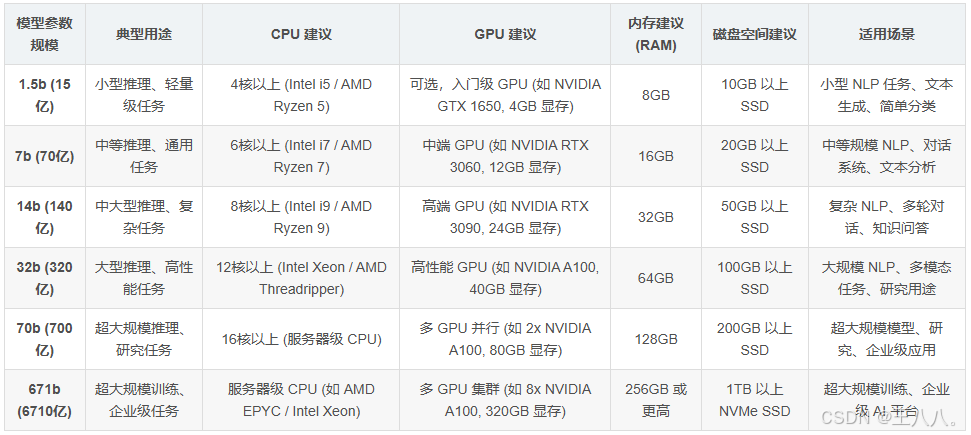

一、部署前准备

1.1 硬件要求

二、部署流程

2.1 安装 Ollama 框架

Ollama 是一个开源的大型语言模型服务工具。它的主要作用是帮助用户快速在本地运行大模型,简化了在 Docker 容器内部署和管理大语言模型(LLM)的过程。

2.1.1 下载安装包

访问 Ollama官网 → 选择对应系统版本下载(Windows用户建议安装到C盘)

下载完成后双击运行安装包,下一步下一步即可。

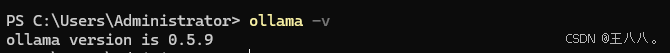

2.1.2 验证是否安装成功

win+R键打开 cmd命令行,执行命令:

ollama -v

如果显示 Ollama版本号,说明安装成功。

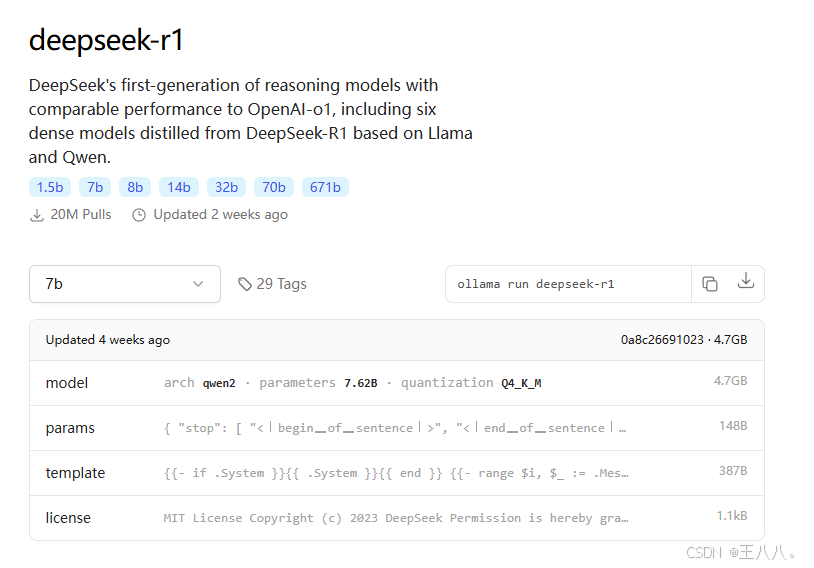

2.2 选择 deepseek 大模型版本

安装成功以后,在官网搜索 deepseek,选择 deepseek-r1,如图所示:

DeepSeek 不同参数版本介绍:

根据你本地电脑的配置选择合适的参数,运行代码如下:

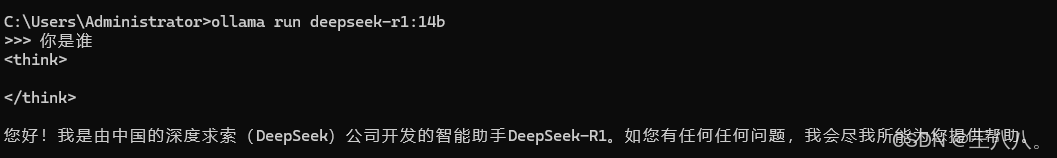

ollama run deepseek-r1:14b

等待下载完毕后就可以愉快的在本地使用大模型了,如图所示:

但是目前是使用命令窗口进行对话的,用命令行进行对话很不方便,可以使用一些 UI 工具来更方便的和 deepseek 进行交互。需要美化对话界面的小伙伴可以接着往下看:

2.3 ChatBox 使用示例

这里我们使用 ChatBox 调用 DeepSeek 进行交互,其他工具使用方式类似。ChatBox 官网地址:https://chatboxai.app/zh。

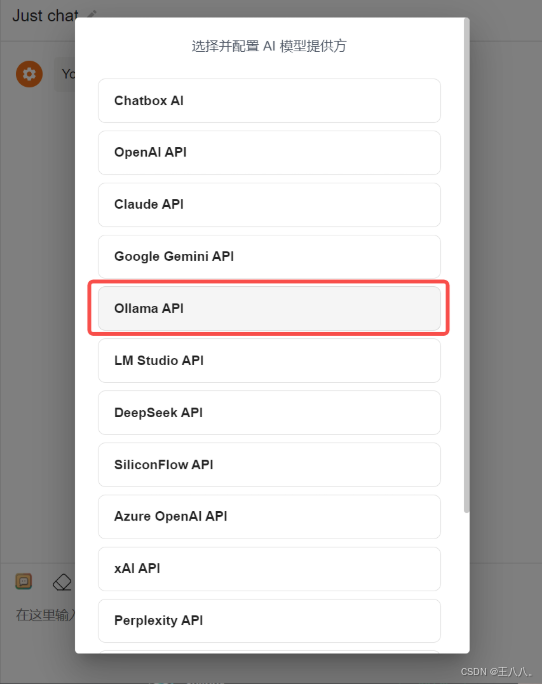

下载自己操作系统的安装包,进行安装。安装完 Chatbox 之后就是配置 DeepSeek 到 Chatbox 了,如下界面所示:

配置 AI 模型提供方,这里选择 Ollama,如图:

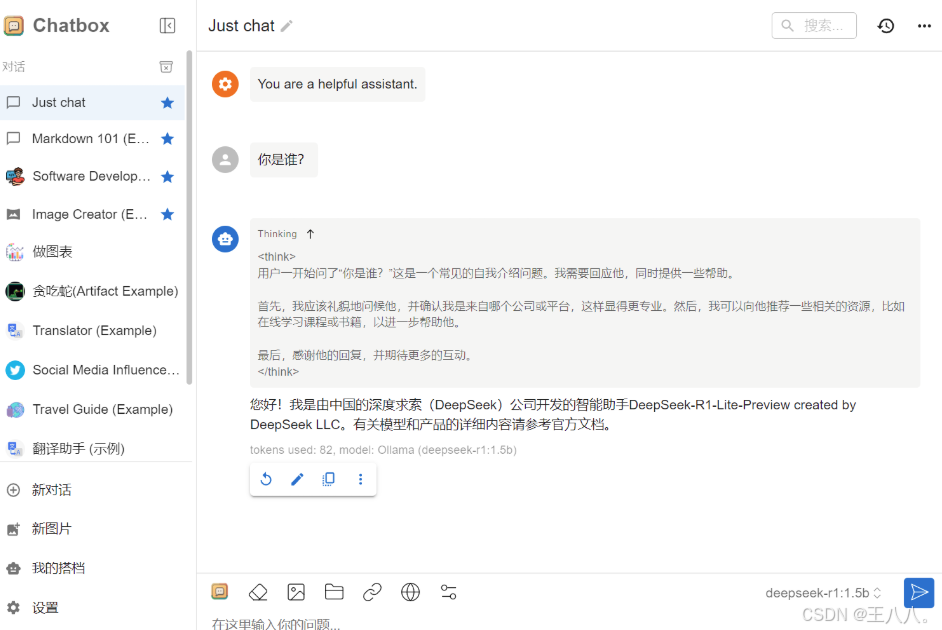

选择 deepseek 模型

配置完成以后就可以在界面上和本地 deepseek 模型进行聊天交互了,如图:

三、最后

至此,已完成了 DeepSeek-R1 的本地部署,小白也能轻松搞定,快来试试吧,开启你的本地大模型之旅!