售价2.5 万元的 Jetson Thor,能否开启人形机器人商业化新局面?

2025年8月25日,专为物理AI和人形机器人打造,且被黄仁勋称作是“推动物理AI和通用机器人时代的终极超级计算机”的NVIDIA Jetson AGX Thor 开发者套件和 NVIDIA Jetson T5000 模块开始全面上市。

其中,Jetson AGX Thor开发者套件定价3499美元(约合人民币2.50万元);Jetson T5000购买1000片以上,单价为2999美元(约合人民币2.15万元),现已通过全球NVIDIA 授权经销商发售。

Jetson AGX Thor开发者套件

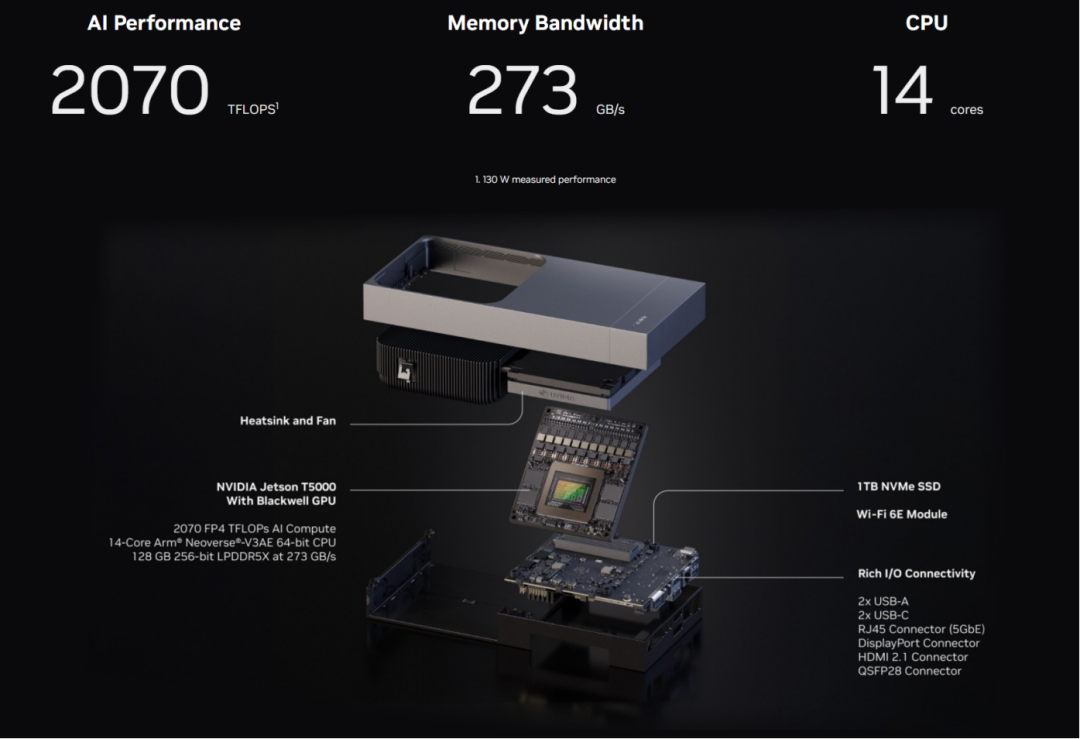

Jetson Thor开发者套件内含Jetson T5000模块、具备丰富接口的参考载板、带风扇的主动式散热器以及电源适配器。

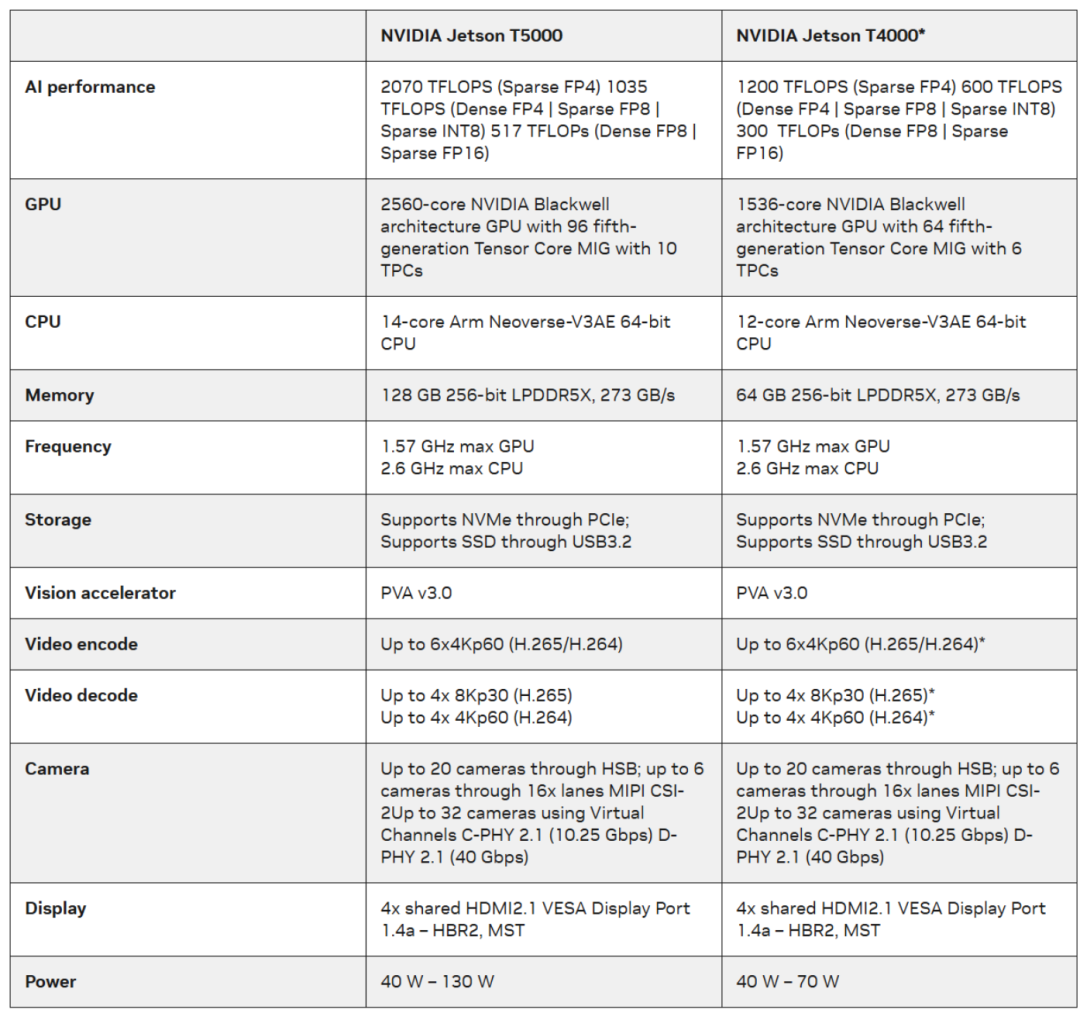

NVIDIA Jetson AGX Thor 开发者套件模块规格

NVIDIA Jetson AGX Thor 开发者套件载板规格

一、NVIDIA Jetson Thor 是物理AI和人形机器人的终极平台?

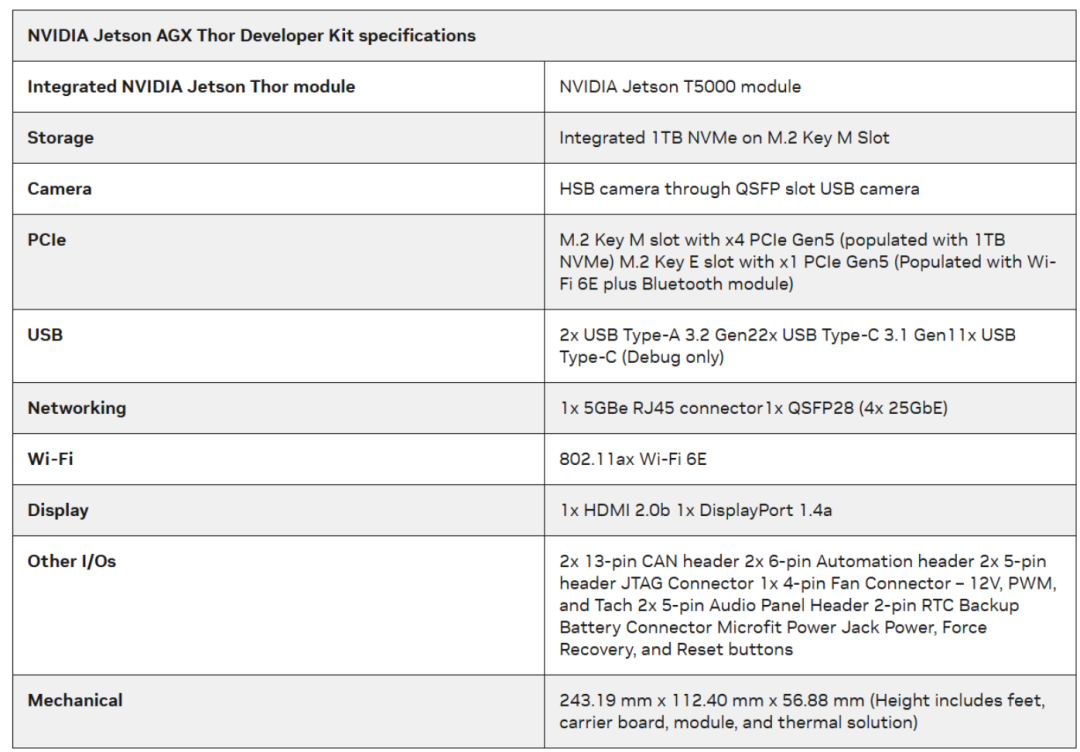

1. 构建一个典型的人形机器人需要四个基本层

1)硬件抽象层:集成所有关键的传感和驱动模块,使机器人能够感知环境并与物理世界进行交互。

2)实时控制框架(100Hz~1KHz):实现对机器人运动的精准低延迟控制,其中最小化延迟对于确保安全灵敏的运行至关重要。

3)感知和规划层(30Hz):赋予机器人环境理解、抓取与运动规划、移动、物体识别及定位能力,使其能有效与周围环境互动。与实时控制不同,该层级允许稍长的处理时间,以确保缜密准确的决策。

4)高级推理层(1~5Hz):支持场景理解、复杂任务规划和自然语言交互等高级功能,该层级可以接受较长处理时间,以支持深度推理与自适应能力。

构建人形机器人需要一系列硬件和软件组件

2. Jetson AGX Thor 平台基本性能

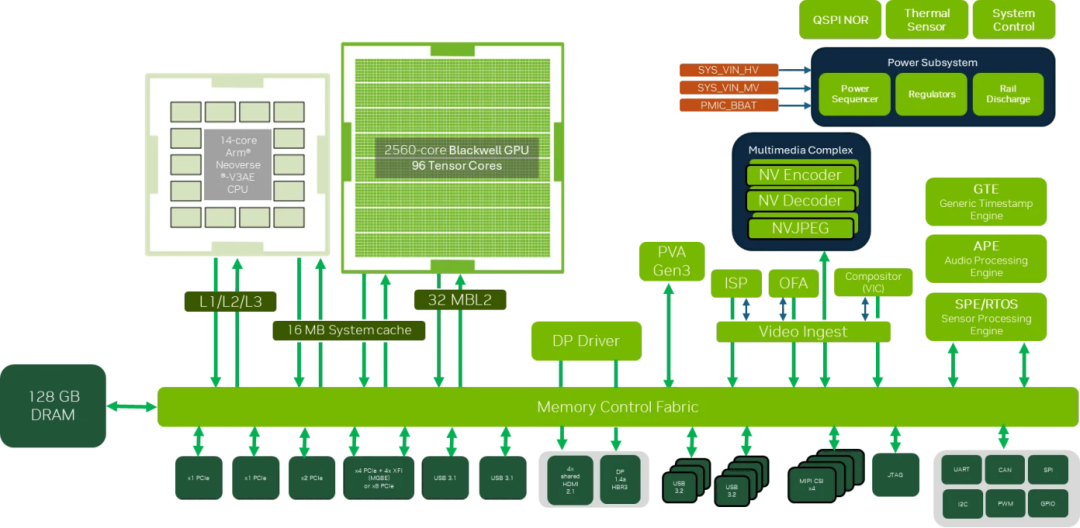

NVIDIA Jetson AGX Thor平台搭载NVIDIA Blackwell架构GPU和128 GB内存(带宽为273 GB/s),可提供高达2070 TFLOPS的FP4精度AI算力(1035 TFLOPS的FP8精度),可顺畅运行最新生成式AI模型。

Jetson Thor借助全新Blackwell多实例GPU(MIG)技术以及强大的14核Arm Neoverse-V3AE CPU,助力加速低延迟实时应用。该套件还包含一系列加速器:第三代可编程视觉加速器(PVA)、双编码器与解码器、光流加速器等。

针对高速传感器融合需求,开发者套件提供丰富的I/O选项,包括支持4x25GbE的QSFP接口(插槽)、多千兆有线RJ45连接器、多个USB端口及其他扩展接口。其设计可实现与现有人形机器人平台的无缝集成,通过有线连接方式快速启动原型设计。

1)Transformer 引擎 和 FP4 支持

基于NVIDIA Blackwell架构的Jetson Thor引入了原生FP4量化技术,通过新一代Transformer引擎动态切换FP4与FP8精度以实现最优性能。

通过结合4位权重、更高内存带宽的激活值处理,Thor显著加速生成式AI工作负载中的预填充(prefill)与解码(decoding)阶段。

2)多实例GPU技术

Jetson Thor率先引入MIG架构(多实例GPU),支持将单一GPU划分为具有专属资源的隔离实例。该技术通过为关键工作负载预留计算资源,同时并行处理低时效性(对时间敏感度较低)任务,确保性能可预测性——这一特性对混合关键度的机器人应用尤为关键。

NVIDIA Jetson Thor 模块的组件

3)与上一代Jetson AGX Orin平台对比

相较于上一代产品Jetson AGX Orin,Jetson AGX Thor AI算力提升高达7.5倍,能效提升3.5倍,CPU性能提升3.1倍,I/O吞吐量提升10倍。

与上一代Jetson AGX Orin平台性能对比

二、Jetson AGX Thor推动边缘式AI的发展

1. 生成式推理和多模态传感器处理对物理AI至关重要

生成式推理模型对于机器人平台具有关键意义,它们能模拟可能的动作序列、预测行动后果、处理语言或视觉线索,并灵活生成高层规划或底层运动策略。这使得机器人系统在现实环境中具备更高的灵活性、适应性,以及接近人类水平的鲁棒推理能力。

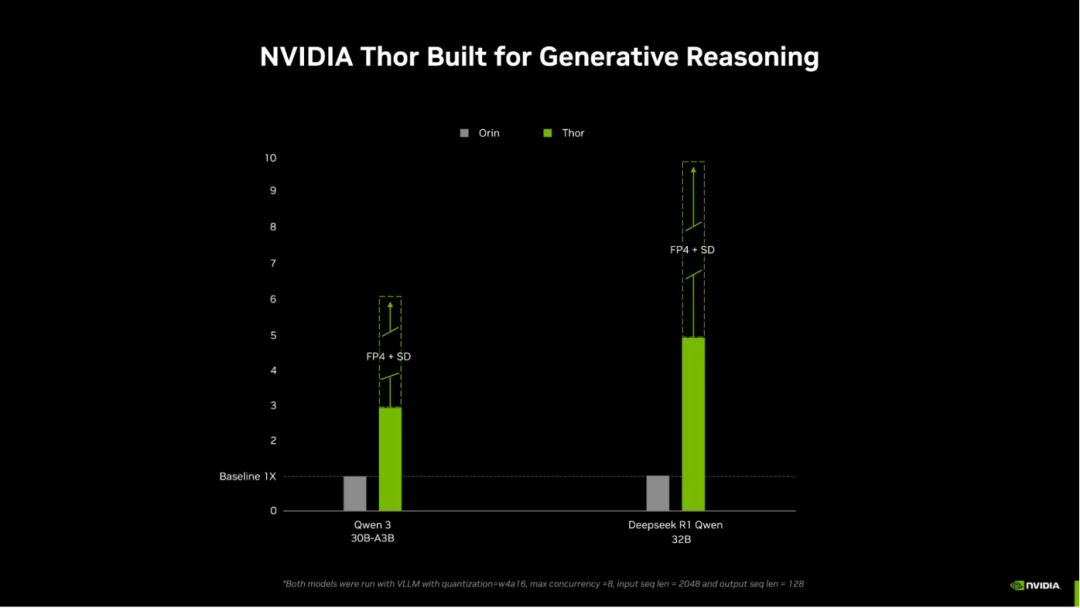

NVIDIA Jetson Thor在生成式推理领域的处理能力实现显著提升。DeepSeek R1 Qwen32B模型的在Jetson Thor上的推理速度较Jetson Orin提升高达5倍。其次,搭载FP4量化及基于Eagle的推测解码技术后,Qwen2.5-VL-7B模型在Jetson Thor上的推理速度较采用W4A16(4位权重、16位激活值)配置的Jetson Orin提升高达3.5倍。

与 Jetson Orin 相比,Jetson Thor 的生成推理速度提高了 5 倍

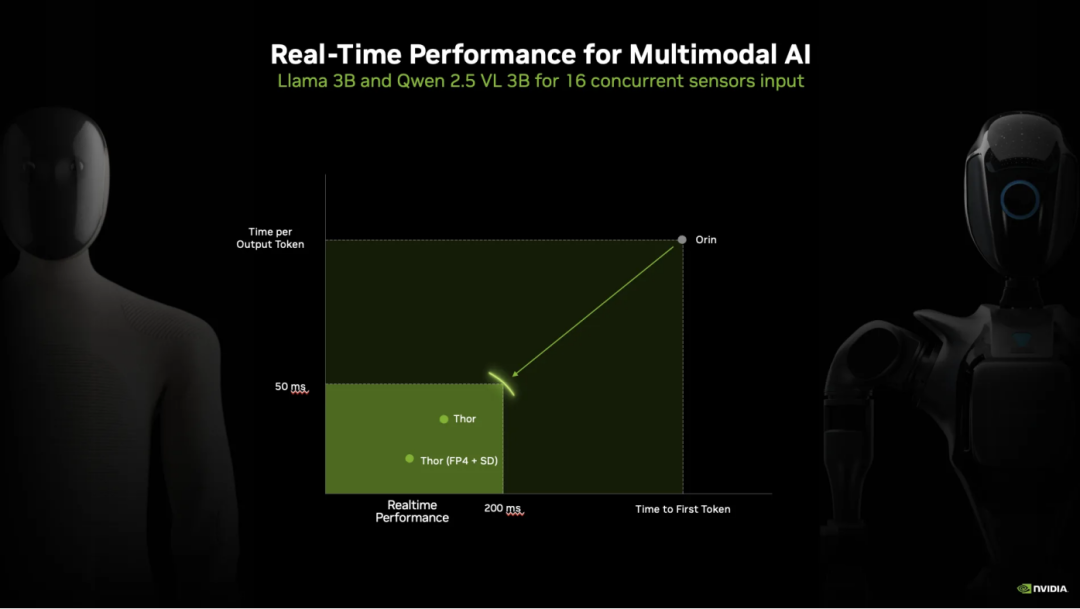

另外,Jetson Thor可以处理多个生成式AI模型与大量多模态传感器输入,并提供实时响应能力。如下图所示,该平台同时运行Qwen2.5-VL-3B视觉语言模型(VLM)和Llama 3.2 3B大语言模型(LLM),可并行处理16个请求。

两个模型的首个Token生成时间(TTFT)均远低于200毫秒,输出单Token耗时(TPOT)均低于50毫秒——这两项指标均是衡量系统响应能力的关键指标。

Jetson Thor 在处理多个生成式 AI 模型和大量多模态传感器输入时提供实时响应能力

Jetson Thor充分发挥Blackwell架构原生FP4支持优势,并支持推测解码等先进技术。该技术通过较小规模的草案模型提出Token候选,再由较大模型进行验证,在保持精度的同时显著加速生成式AI推理,最终实现更快速、更高质量的输出。

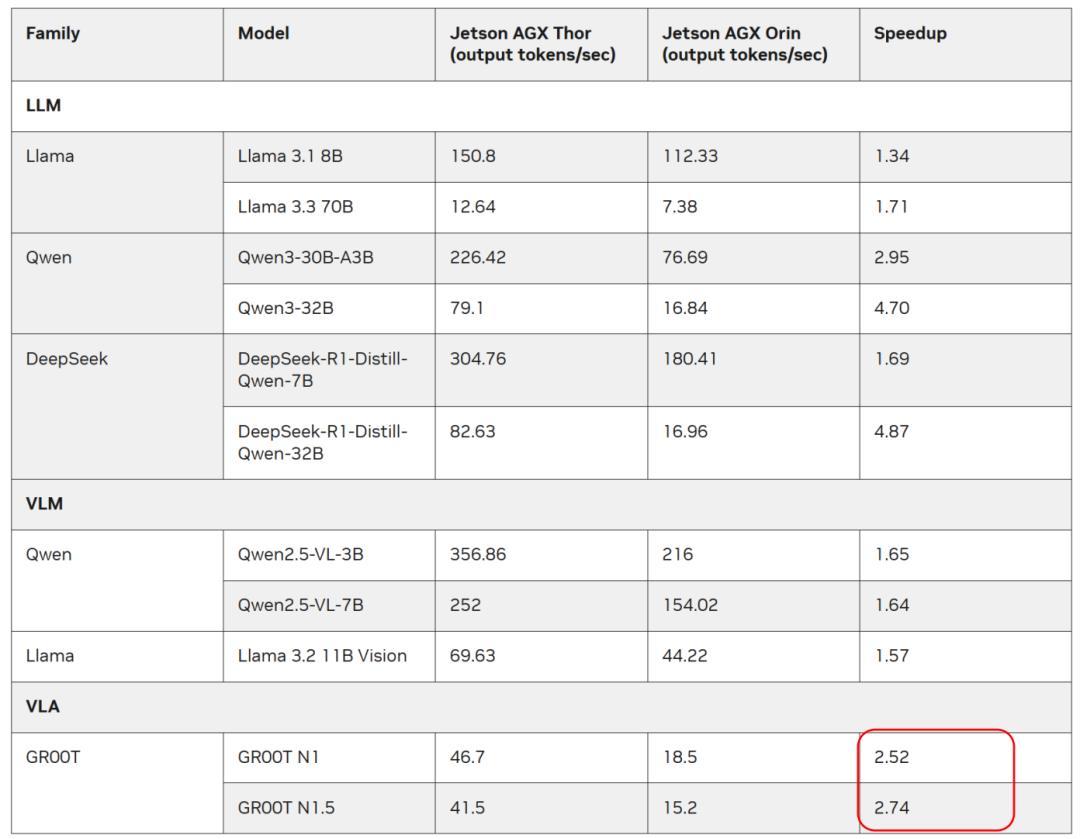

如下表所示,在LLM、VLM和VLA等生成式AI模型上,Jetson Thor的加速性能较Jetson Orin实现较大幅度的提升。例如在GR00T N1和GR00T N1.5的VLA模型测试中,Jetson Thor分别实现了2.52和2.74倍的性能提升。

Jetson Thor 和 Jetson AGX Orin 的基准测试

备注:基准测试的配置信息如下 —— 序列长度:2048,输出序列长度:128;最大并发数:8;LLM(大语言模型)和 VLM(视觉语言模型)通过 VLLM 框架运行,VLA 模型通过 TensorRT 框架运行;功耗模式:Jetson AGX Thor 与 Jetson AGX Orin 均设为 MAXN 模式。

2. Jetson AGX Thor对AI框架和生成式AI模型的支持

Jetson AGX Thor属于全新类型的机器人计算机,其架构经过彻底重构,专为驱动下一代人形机器人而设计。该平台支持广泛的生成式AI模型,涵盖从VLA模型(如NVIDIA Isaac GR00T N1.5)到所有主流大LLM和VLM,助力实现AI模型在边缘端实时运行,最大程度减少对云端的依赖。

另外,为实现无缝的云边协同体验,Jetson Thor支持运行面向物理AI应用的NVIDIA AI全栈软件,包括用于机器人技术的NVIDIA Isaac、面向视觉智能体AI的NVIDIA Metropolis,以及处理传感器数据的NVIDIA Holoscan。同时,还可通过NVIDIA智能体AI工作流在边缘侧构建AI智能体。

通过Jetson软件栈优化实现现实应用所需的低延迟与高性能,Jetson Thor以高实时性能支持所有主流生成式AI框架与推理模型。这些模型包括Cosmos Reason、DeepSeek、Llama、Gemini和Qwen等通用模型,以及Isaac GR00T N1.5等机器人专用模型,使开发者能够轻松进行本地实验和推理部署。

Jetson Thor 支持多种 AI 框架和生成式 AI 模型

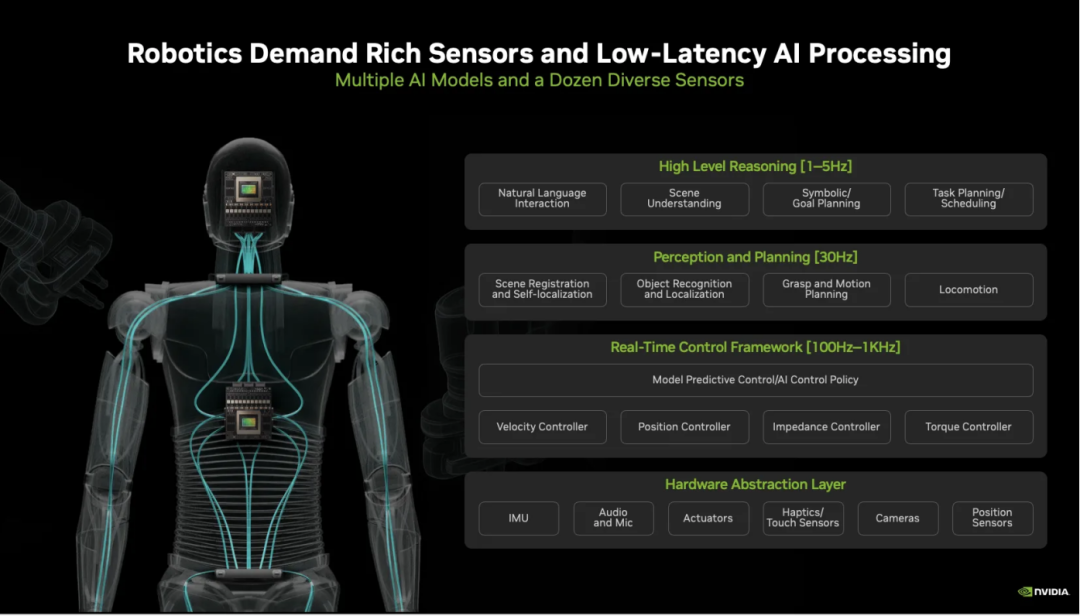

三、Jetson AGX Thor的实际场景应用

1)银河通用:在2025WRC展会现场,银河通用展示了搭载英伟达Jetson Thor芯片的Galbot—— 为现场观众提供智能零售服务和工业场景搬运工作。据悉,这是全球首次完成基于该芯片的机器人真机工作演示。

2)优必选:宣布在全新一代工业人形机器人Walker S2 上率先部署了NVIDIA Isaac Sim 及 Jetson AGX Thor,该机器人号称是全球首款具备自主换电能力的人形机器人,在智能制造及物流领域展现出卓越的类人移动和操作能力。

3)Agility Robotics: 已将NVIDIA Jetson集成至其第五代机器人 Digit 中,并计划采用 Jetson Thor 作为第六代 Digit 机器人的机载计算平台。这一升级将提升 Digit 的实时感知与决策能力,支撑其实现更复杂的 AI 技能与行为。目前 Digit 已实现商业化部署,在仓库及制造场景中执行堆叠、装载、码垛等物流作业任务。

4)波士顿动力公司:正将Jetson Thor 集成至其人形机器人 Atlas 中。这一集成将使 Atlas 得以利用此前仅服务器级设备才具备的计算能力、AI 工作负载加速能力、高带宽数据处理能力,以及设备端大容量内存。

另外,智元机器人、宇树科技、众擎机器人等人形机器人公司也已经率先采用了Jetson Thor。除了人形机器人之外,Jetson Thor 还将加速各类机器人应用的发展 —— 例如手术辅助机器人、智能拖拉机、配送机器人、工业机械臂以及视觉 AI 智能体 —— 通过在设备端对规模更大、复杂度更高的 AI 模型进行实时推理,为这些应用提供有效的支撑。

Jetson Thor应用领域