CVPR中深度学习新范式:通用性、鲁棒性与多模态的创新突破

来gongzhonghao【图灵学术计算机论文辅导】,快速拿捏更多计算机SCI/CCF发文资讯~

分享一个深度学习领域正在迅速升温的前沿方向:通用性与鲁棒性的深度神经网络架构创新。随着大模型在视觉、文本乃至多模态任务中的广泛应用,体现出深度学习正从高精度走向高可靠、强泛化、跨模态融合的未来趋势。

本文精选三篇CVPR代表性论文,带你一览深度学习范式创新的最新进展与落地思路,助力大家把握研究和应用新机遇。

SURE: SUrvey REcipes for Building Reliable and Robust Deep Networks

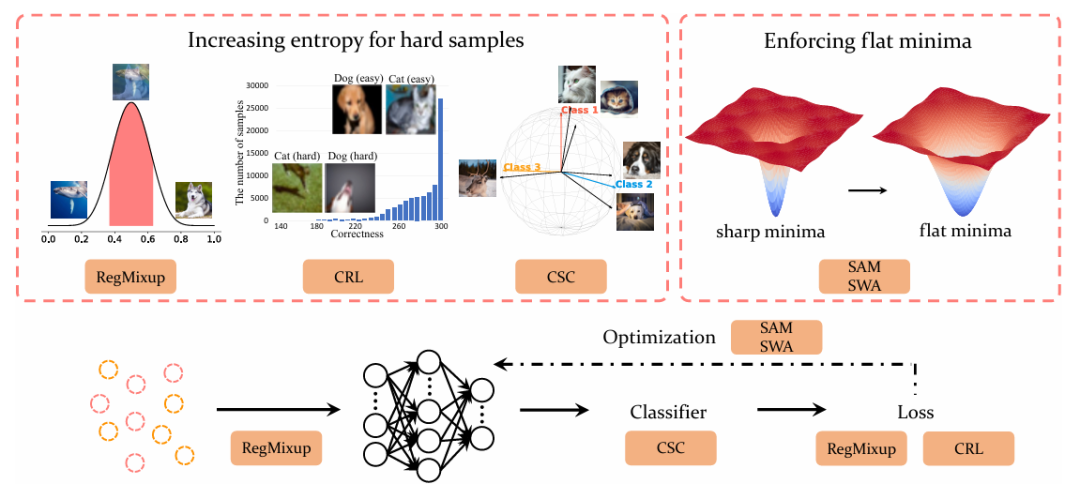

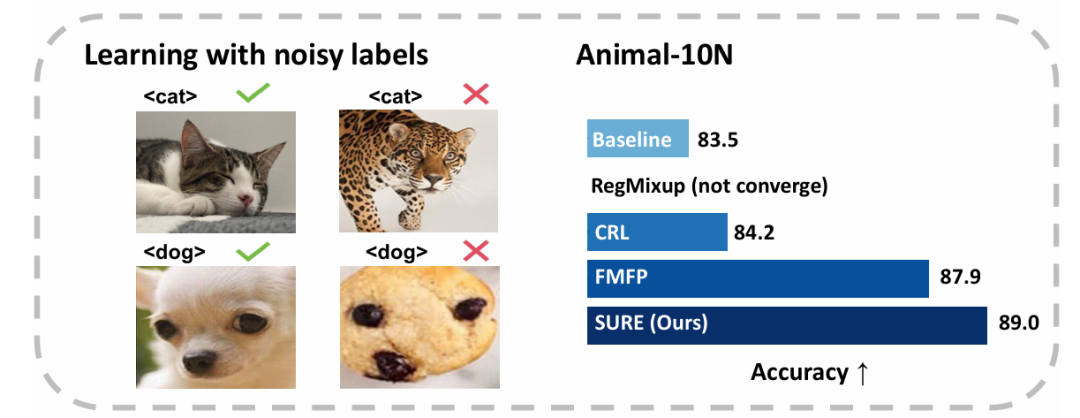

方法:文章首先系统梳理并分析影响深度网络不确定性表现的关键因素,并提出SURE框架将多种不确定性估计技术(如贝叶斯方法、集成学习和校准机制)协同集成。随后,SURE在训练阶段动态调整模型结构和损失函数,以兼顾准确性和不确定性度量,提升整体鲁棒性。最后,作者在多个标准数据集上进行了大规模实验,证明SURE在不确定性估计准确性、模型稳定性和泛化能力上均优于现有主流方法。

创新点:

首创性地整合多种主流不确定性估计技术,包括贝叶斯深度学习、模型集成和校准方法,在统一框架下协同优化。

设计了分层次、多粒度的评估机制,系统地量化和比较各类方法在不同数据分布和任务场景下的表现。

提出了针对深度网络脆弱性的新型鲁棒性测试标准,有效推动了模型在极端或异常输入下的可靠性增强。

总结:这篇文章聚焦于提升深度神经网络在实际环境下的可靠性和鲁棒性,通过提出SURE框架,系统性地解决了当前模型在不确定性估计方面存在的准确性不足和稳定性问题,为安全、可信的深度学习应用奠定坚实基础。

SD-DiT: Unleashing the Power of Self-Supervised Discrimination in Diffusion Transformer

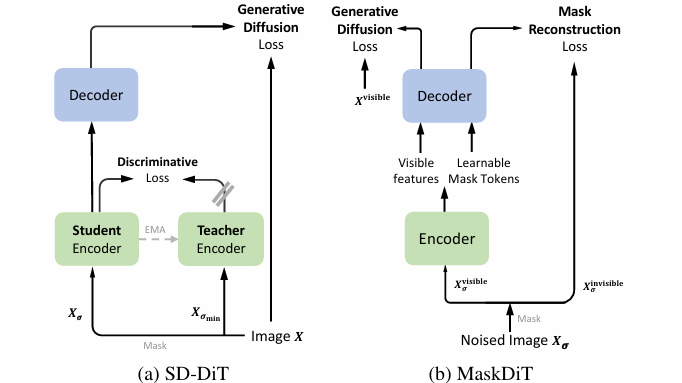

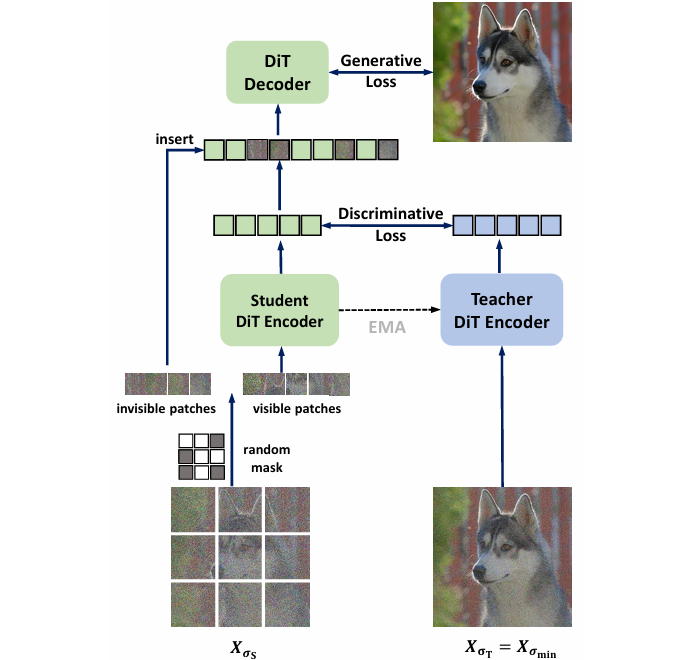

方法:文章首先构建了一个教师-学生判别网络,通过自监督方式指导学生网络学习更丰富的特征表示,在扩散过程的每一阶段提升生成质量。随后,作者结合多层次判别信号,将判别损失与原始扩散损失动态融合,从而在训练过程中实现稳定性与多样性的双重提升。最后,SD-DiT在多个主流生成任务和大规模数据集上进行了系统实验,结果显示该方法在图像质量、泛化能力和训练效率方面均优于现有的扩散Transformer模型。

创新点:

引入教师-学生自监督判别框架,将判别学习融入扩散模型训练流程,提升生成样本的分辨率和多样性。

结合动态自监督目标与分层特征引导,显著增强了模型对复杂数据分布的适应性和泛化能力。

优化模型架构和训练策略,在保证高效推理的同时,显著降低了计算资源消耗。

总结:这篇文章针对当前扩散Transformer(DiT)模型在训练效率和生成能力上的瓶颈,提出了SD-DiT方法,通过引入自监督判别机制,极大激发了模型在高质量图像生成和推理上的潜力。

纠结选题?导师放养?投稿被拒?对论文有任何问题的同学,欢迎来gongzhonghao【图灵学术计算机论文辅导】,获取顶会顶刊前沿资讯~

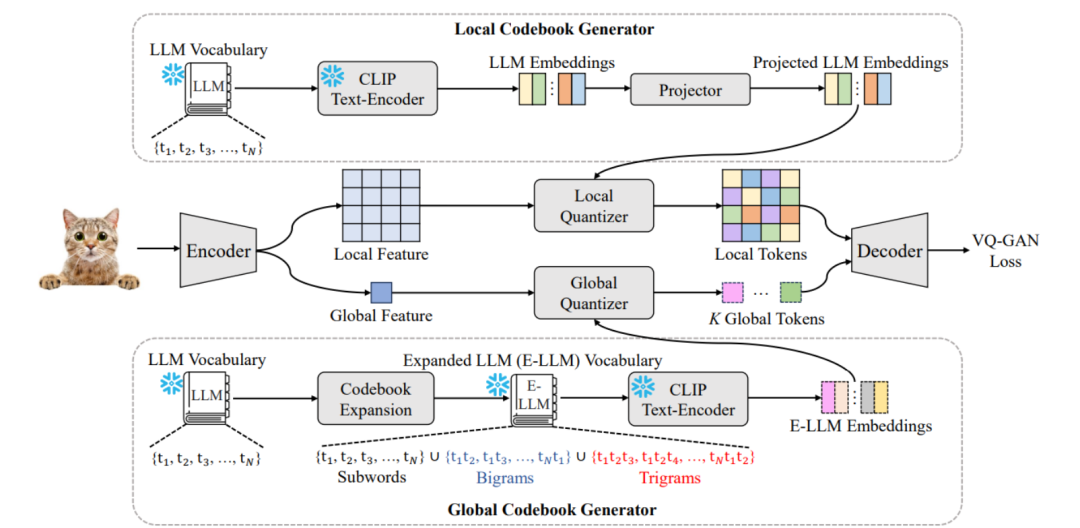

Beyond Text: Frozen Large Language Models in Visual Signal Comprehension

方法:文章首先设计了一种创新的视觉信号编码器,将原始图像信息转化为可被冻结大型语言模型理解的Token序列,保证了语义和细节的完整传递。随后,作者利用冻结的LLM通过自然语言推理机制,对视觉Token进行去噪和修复决策,实现了端到端的无微调视觉任务处理。最后,在多项视觉基准任务上进行实验,结果显示该方法不仅简化了多模态模型训练流程,还在图像质量提升和泛化能力上达到了业界领先水平。

创新点:

提出V2T Tokenizer方法,实现了视觉数据到语言模型输入的高保真映射,使冻结LLM具备视觉感知能力。

展现了无需对语言模型本身进行微调,仅通过前端视觉适配即可完成复杂视觉理解任务,降低了多模态系统的资源成本。

在图像去噪和修复任务中,首次实现了与专业视觉模型相媲美的性能,验证了跨模态迁移的可行性与高效性。

总结:这篇文章突破性地探索了如何让冻结的大型语言模型直接理解和处理视觉信号,通过设计高效的视觉到文本转换机制,实现了无需微调即可在图像去噪和修复等任务上展现强大表现,为多模态AI打开了新局面。

关注gongzhonghao【图灵学术计算机论文辅导】,快速拿捏更多计算机SCI/CCF发文资讯~