YOLOv3 技术深度解析:从理论到实践的完整指南

前言:在智能视觉时代,目标检测已成为深度学习领域最具实用价值的核心技术之一。而 YOLO以其端到端的高效结构与卓越的实时性能,成为工程落地与学术研究中的明星算法。

本专栏 《YOLO目标检测最强通关秘籍》 从算法原理、模型设计到实验复现与工程部署,系统梳理 YOLO 系列的技术演进与关键创新,让复杂的模型调优和实战部署变得更系统。

一、YOLOv3 的技术背景与发展历程

在目标检测领域,YOLO 系列模型的出现标志着从传统的两阶段检测方法向单阶段检测方法的重大转变。YOLOv3 作为该系列的第三代产品,继承了前两代模型的核心思想,同时在多个维度上实现了显著的技术突破。

Joseph Redmon 在 2018 年发布的 YOLOv3 论文中,将其描述为"一种增量式改进",但这种谦逊的表述掩盖了其在实际应用中的巨大进步。相比于 YOLOv2,YOLOv3 在保持高效推理速度的同时,显著提升了检测精度,特别是在小目标检测方面取得了突破性进展。

1. 技术演进的核心驱动力

YOLOv3 的设计理念围绕着解决前代模型的核心痛点展开。YOLOv2 虽然在速度上表现出色,但在处理多尺度目标时仍然存在明显不足,特别是对小目标的检测精度有限:

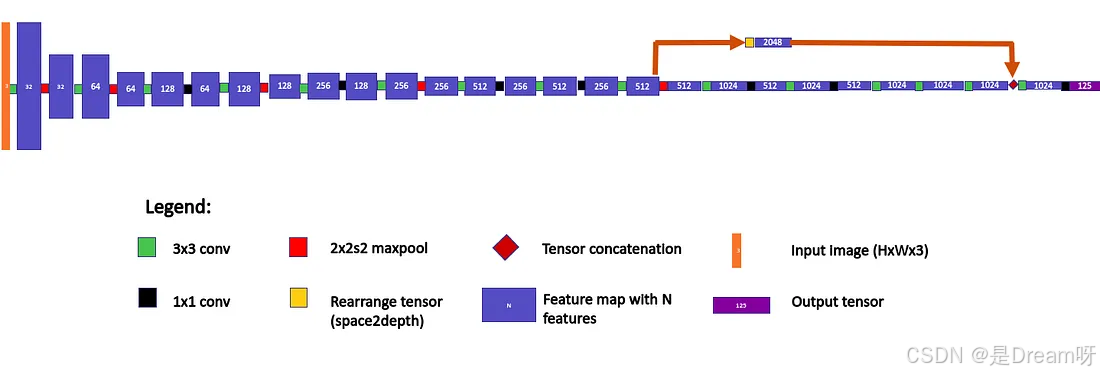

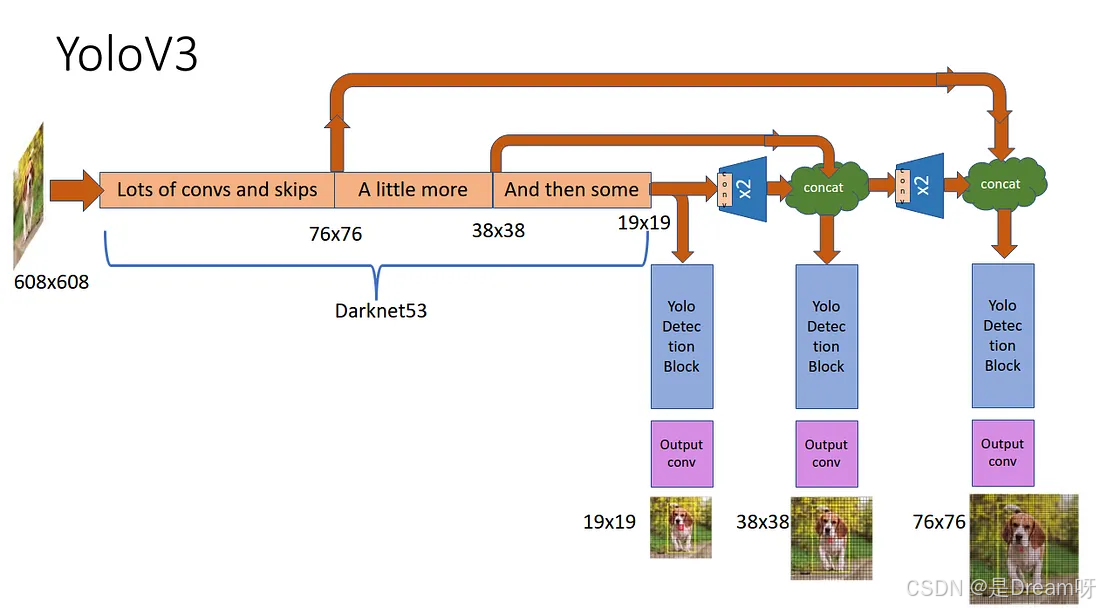

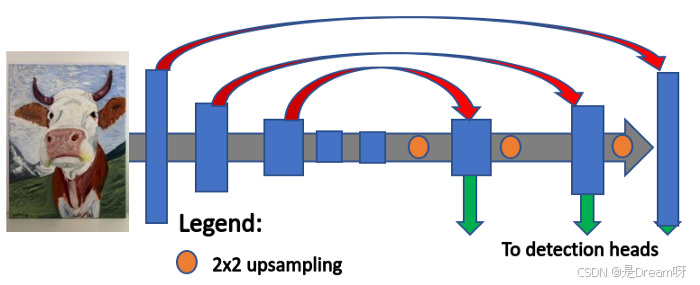

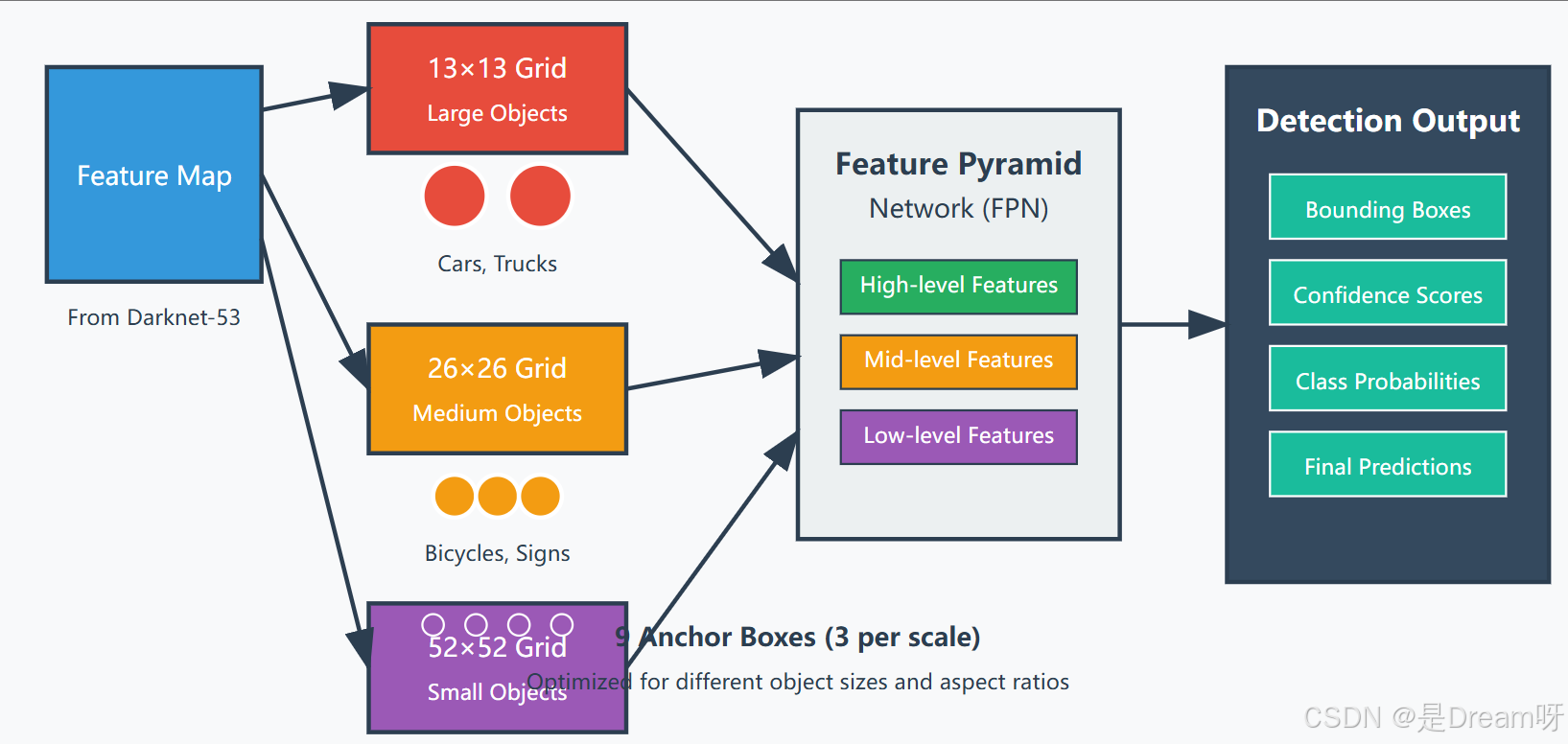

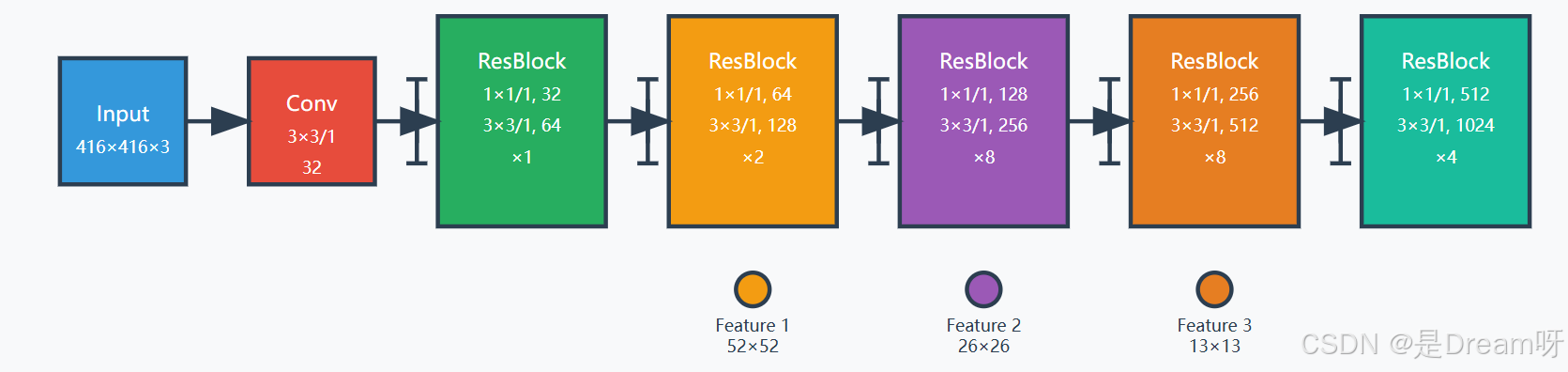

受 ResNet 和 FPN(特征金字塔网络)架构的启发,YOLO-V3 特征提取器称为 Darknet-53(它有 52 个卷积),包含跳过连接(如 ResNet)和 3 个预测头(如 FPN)——每个预测头以不同的空间压缩处理图像。

YOLOv3 通过引入多尺度预测机制,从根本上解决了这一问题。这种多尺度设计的灵感来源于特征金字塔网络(FPN)的思想:

参考上面的 YOLO-V3 插图,FPN 拓扑允许 YOLO-V3 学习不同大小的物体:与其他检测块相比,19x19 检测块具有更宽的上下文和较差的分辨率,因此它专门用于检测大型物体,而 76x76 块专门用于检测小物体。每个检测头都有一组单独的锚点刻度。

但 YOLOv3 将其与 YOLO 的单次检测框架巧妙结合。通过在三个不同尺度上进行预测,模型能够同时捕获图像中的大、中、小目标,这种设计使得检测性能得到了全面提升。

2. 架构设计的哲学思考

YOLOv3 的架构设计体现了深度学习中"深度与效率"平衡的艺术。新采用的 Darknet-53 骨干网络包含 53 个卷积层,相比于 YOLOv2 的 19 层有了显著增加。这种深度的增加并非盲目追求,而是基于对特征表示能力的深度思考。

# Darknet-53 的核心残差块设计

class DarknetBottleneck(nn.Module):def __init__(self, in_channels):super().__init__()hidden_channels = in_channels // 2self.conv1 = nn.Conv2d(in_channels, hidden_channels, 1, bias=False)self.bn1 = nn.BatchNorm2d(hidden_channels)self.conv2 = nn.Conv2d(hidden_channels, in_channels, 3, padding=1, bias=False)self.bn2 = nn.BatchNorm2d(in_channels)self.activation = nn.LeakyReLU(0.1)def forward(self, x):residual = xout = self.activation(self.bn1(self.conv1(x)))out = self.bn2(self.conv2(out))out += residualreturn self.activation(out)

这段代码展示了 Darknet-53 中残差块的核心实现。每个残差块采用 1×1 卷积降维,3×3 卷积特征提取,然后通过跳跃连接将输入直接加到输出上。这种设计不仅缓解了深层网络的梯度消失问题,还通过减少参数数量保持了模型的计算效率。

二、YOLOv3 的核心技术创新

1. 多尺度预测机制的深度剖析

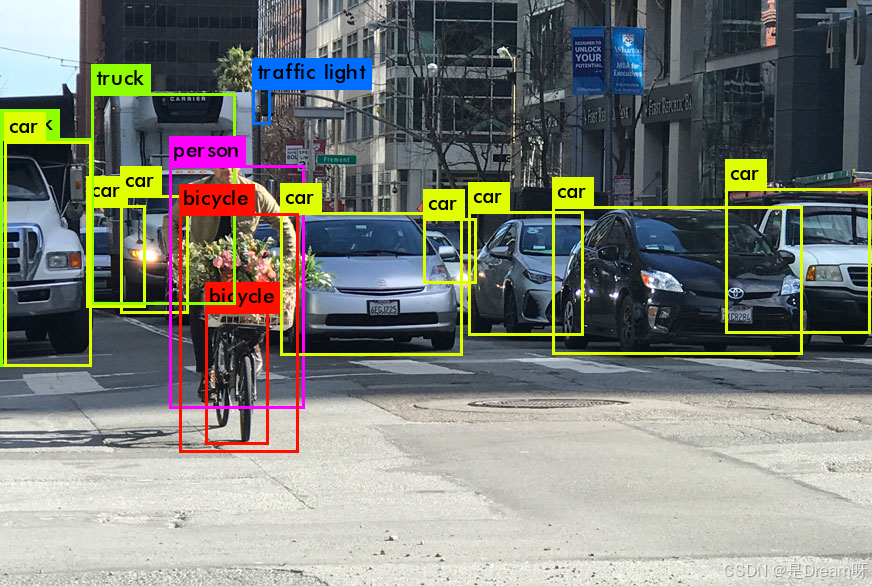

YOLOv3 最重要的创新在于其多尺度预测机制。模型在三个不同的尺度上进行目标检测:13×13、26×26 和 52×52 的特征图。这种设计的精妙之处在于每个尺度都有其特定的检测职责。

13×13 的粗糙特征图主要负责检测大目标,其较大的感受野能够捕获丰富的语义信息,适合识别占据图像较大区域的目标。26×26 的中等特征图处理中等大小的目标,在细节保留和语义理解之间找到最佳平衡点。而 52×52 的精细特征图专注于小目标检测,保持了足够的空间分辨率来捕获细小目标的特征。

class YOLOv3DetectionHead(nn.Module):def __init__(self, num_classes=80, anchors=None):super().__init__()self.num_classes = num_classesself.num_anchors = 3# 三个不同尺度的检测头self.detect_13 = self._make_detection_layer(1024, 512) # 大目标self.detect_26 = self._make_detection_layer(768, 256) # 中目标self.detect_52 = self._make_detection_layer(384, 128) # 小目标def _make_detection_layer(self, in_channels, out_channels):return nn.Sequential(nn.Conv2d(in_channels, out_channels, 1),nn.BatchNorm2d(out_channels),nn.LeakyReLU(0.1),nn.Conv2d(out_channels, self.num_anchors * (5 + self.num_classes), 1))

这种多尺度设计的核心在于特征图之间的信息传递。高层特征图通过上采样与低层特征图进行融合,使得每个检测层都能同时利用深层的语义信息和浅层的细节信息。这种特征金字塔结构有效提升了模型对不同尺度目标的检测能力。

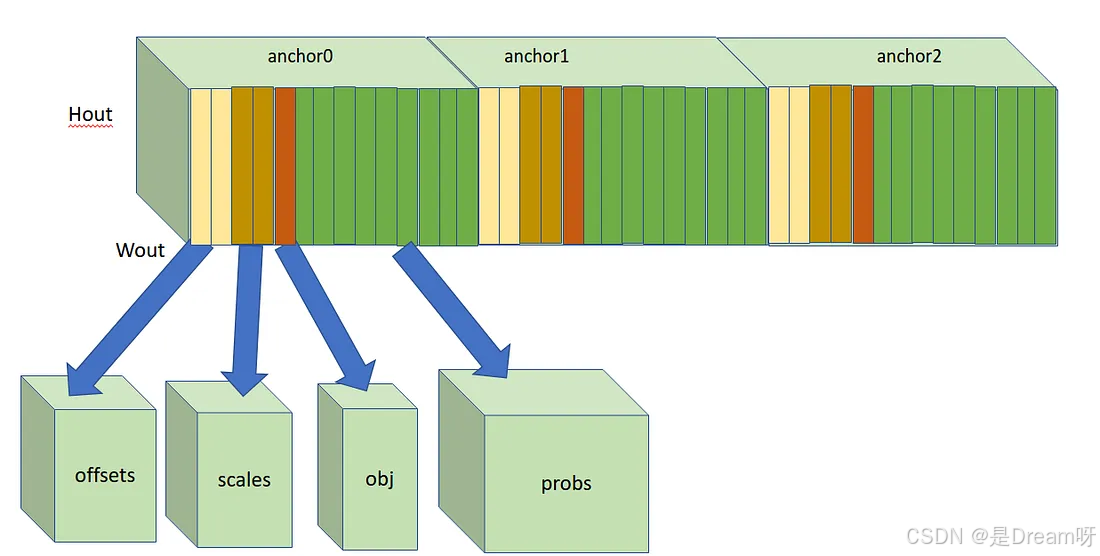

2. 先验框机制的优化策略

YOLOv3 继承了 YOLOv2 的先验框(anchor)机制,但在具体实现上进行了重要优化。每个尺度使用 3 个先验框,总共 9 个先验框覆盖了从小到大的各种目标尺寸。这些先验框的尺寸通过 K-means 聚类在训练集上自动确定,确保了对真实目标分布的最佳适应。

先验框的使用显著简化了边界框回归的难度。模型不再需要从零开始预测边界框的位置和大小,而是基于预定义的先验框进行微调。这种设计使得训练过程更加稳定,收敛速度也得到了明显提升。

3. 损失函数的精妙设计

YOLOv3 的损失函数设计体现了其在目标检测任务中的深度思考。整个损失函数包含三个主要部分:坐标损失、置信度损失和分类损失。

def yolo_loss(predictions, targets, anchors, num_classes):# 坐标损失:使用均方误差xy_loss = F.mse_loss(pred_xy, target_xy, reduction='sum')wh_loss = F.mse_loss(pred_wh, target_wh, reduction='sum')# 置信度损失:区分有目标和无目标的网格obj_loss = F.binary_cross_entropy(pred_conf[obj_mask], target_conf[obj_mask])noobj_loss = F.binary_cross_entropy(pred_conf[noobj_mask], target_conf[noobj_mask])# 分类损失:支持多标签分类cls_loss = F.binary_cross_entropy(pred_cls[obj_mask], target_cls[obj_mask])total_loss = xy_loss + wh_loss + obj_loss + noobj_loss + cls_lossreturn total_loss

置信度损失的设计特别值得关注。YOLOv3 使用二元交叉熵而非 softmax,这使得模型能够处理多标签分类问题。在某些场景下,一个目标可能同时属于多个类别,这种设计提供了更大的灵活性。

三、Ultralytics YOLOv3 的优化与增强

1. Ultralytics 版本的技术改进

Ultralytics 团队在原始 YOLOv3 的基础上进行了多项优化,形成了 YOLOv3-Ultralytics 版本。这个版本不仅保持了原版的核心特性,还在易用性、性能和扩展性方面进行了显著提升。

主要改进包括更灵活的数据加载机制、更高效的训练流程、更完善的评估指标体系以及更好的模型导出支持。这些改进使得 YOLOv3 在实际应用中更加便捷和高效。

2. YOLOv3u 的革命性创新

YOLOv3u 代表了 Ultralytics 对 YOLOv3 的深度重构。最重要的创新在于引入了 YOLOv8 的无锚点检测头,这是一个颠覆性的设计变化。

传统的锚点机制虽然有效,但也带来了一些问题:锚点的设计需要先验知识,对数据分布敏感,且增加了模型的复杂度。YOLOv3u 通过采用无锚点检测头,彻底解决了这些问题。

class AnchorFreeHead(nn.Module):def __init__(self, num_classes, in_channels):super().__init__()self.num_classes = num_classesself.cls_convs = nn.Sequential(nn.Conv2d(in_channels, in_channels, 3, padding=1),nn.BatchNorm2d(in_channels),nn.ReLU(inplace=True))self.reg_convs = nn.Sequential(nn.Conv2d(in_channels, in_channels, 3, padding=1),nn.BatchNorm2d(in_channels),nn.ReLU(inplace=True))self.cls_pred = nn.Conv2d(in_channels, num_classes, 3, padding=1)self.reg_pred = nn.Conv2d(in_channels, 4, 3, padding=1)def forward(self, x):cls_feat = self.cls_convs(x)reg_feat = self.reg_convs(x)cls_score = self.cls_pred(cls_feat)bbox_pred = self.reg_pred(reg_feat)return cls_score, bbox_pred

这种无锚点设计的核心在于直接预测目标的中心点位置和边界框大小,而不依赖于预定义的锚点。这种方法不仅简化了模型结构,还提高了对不同形状和大小目标的检测能力。

3. 模型变体的多样化选择

Ultralytics 提供了多个 YOLOv3 变体,每个变体都针对特定的应用场景进行了优化:

- YOLOv3u:标准版本,平衡了精度和速度

- YOLOv3-tinyu:轻量级版本,适合资源受限的环境

- YOLOv3-sppu:增强版本,集成了空间金字塔池化模块

这种多样化的选择使得用户能够根据具体需求选择最适合的模型版本。

四、实际应用与部署实践

1. 模型训练的最佳实践

在实际应用中,YOLOv3 的训练需要考虑多个方面。首先是数据准备,需要确保训练数据的质量和多样性。数据增强技术在这里发挥了重要作用,通过随机裁剪、旋转、翻转等方法增加数据的多样性。

from ultralytics import YOLO# 加载预训练模型

model = YOLO("yolov3u.pt")# 配置训练参数

results = model.train(data="custom_dataset.yaml",epochs=100,imgsz=640,batch_size=16,lr0=0.01,weight_decay=0.0005,mosaic=1.0,mixup=0.1

)

这段代码展示了如何使用 Ultralytics 框架训练 YOLOv3u 模型。关键参数包括学习率、权重衰减、数据增强策略等,这些参数的合理设置对模型性能有着直接影响。

2. 推理优化策略

在部署阶段,推理速度和精度的平衡是关键考虑因素。YOLOv3 提供了多种优化策略,包括模型量化、剪枝和知识蒸馏等。

# 模型推理示例

model = YOLO("yolov3u.pt")

results = model("image.jpg", conf=0.5, iou=0.45)# 结果处理

for result in results:boxes = result.boxesif boxes is not None:for box in boxes:x1, y1, x2, y2 = box.xyxy[0]confidence = box.conf[0]class_id = box.cls[0]print(f"目标: {class_id}, 置信度: {confidence:.2f}")

这个推理示例展示了如何使用训练好的模型进行目标检测。置信度阈值和 IoU 阈值的设置对检测结果的质量有重要影响。

3. 性能评估与优化

模型性能的评估需要综合考虑多个指标,包括 mAP(平均精度均值)、FPS(每秒帧数)、模型大小等。在实际应用中,需要根据具体场景的需求在这些指标之间找到最佳平衡。

五、技术对比与未来展望

1. 与其他检测算法的比较

YOLOv3 在目标检测领域的地位可以通过与其他主流算法的比较来体现。相比于 R-CNN 系列的两阶段方法,YOLOv3 在速度上有明显优势,虽然在精度上可能略有不足,但这种权衡在许多实际应用中是可以接受的。

与同期的 SSD 算法相比,YOLOv3 在小目标检测方面表现更好,这主要得益于其多尺度预测机制。而与后续的 YOLOv4、YOLOv5 等版本相比,YOLOv3 虽然在某些指标上可能落后,但其简洁的架构和成熟的生态系统仍然使其在许多场景下具有实用价值。

2. 技术发展趋势

从 YOLOv3 到后续版本的发展轨迹可以看出目标检测技术的几个重要趋势:

- 无锚点设计:YOLOv3u 的无锚点检测头代表了这一趋势的开始

- 自适应训练策略:更智能的学习率调整和数据增强策略

- 模型轻量化:在保持精度的同时减少模型大小和计算量

- 多任务学习:同时处理检测、分割、分类等多个任务

3. 应用前景与挑战

YOLOv3 及其变体在实际应用中面临着既有机遇也有挑战。机遇在于其成熟的技术架构和丰富的生态系统为各种应用提供了坚实基础。挑战则来自于日益复杂的应用场景对模型性能的更高要求。

在边缘计算、实时监控、自动驾驶等领域,YOLOv3 的高效性使其仍然具有重要价值。同时,随着硬件性能的提升和算法优化的进步,YOLOv3 在这些领域的应用前景将更加广阔。

结语

YOLOv3 作为目标检测领域的重要里程碑,不仅在技术上实现了多项突破,更在实际应用中证明了其价值。从多尺度预测机制到无锚点设计的演进,从 Darknet-53 的深度架构到 Ultralytics 的工程优化,每一个技术细节都体现了深度学习在目标检测任务中的不断进步。

理解 YOLOv3 的技术原理和实现细节,不仅有助于我们更好地应用这一技术,更能为我们在目标检测领域的进一步探索提供坚实的理论基础。随着技术的不断发展,YOLOv3 所代表的设计理念和技术思路仍将继续影响着这一领域的发展方向。

文末送书

参与方式

免费包邮送三本! Dream送书活动——第六十七期:《华为仓颉语言编程从入门到精通》、《DeepSeek源码深度解析》

参与方式:

1.点赞收藏文章

2.在评论区留言:人生苦短,我用Python!(多可评论三条)

3.随机抽取3位免费送出!

4.截止时间: 2025-07-23

上期中奖名单:Sunlightʊə、守护者170、羑悻的小杀马特.(请中奖者私信我)

本期推荐1:《华为仓颉语言编程从入门到精通》《华为仓颉语言编程从入门到精通》

华为仓颉语言编程从新手到专家实战宝典:系统讲解 + 项目实战 + 多媒体教学资源,构建从入门到精通的完整学习路径,助力成为鸿蒙开发专家。

京东:https://item.jd.com/15006134.html

实战讲解:通过实际项目案例帮助读者掌握仓颉的使用技巧,提升实践能力。

配套资源丰富:460页教学PPT + 490分钟实战讲解视频,全栈级仓颉开发教程,助你快速掌握鸿蒙生态核心语言。

仓颉与华为技术生态深度结合:从基础语法到实战应用,用仓颉开启华为智能开发新时代。

高效编码:帮助开发者提升编码效率,特别是在大规模数据处理和高性能计算场景中。

前瞻性技术:探索仓颉语言在未来技术发展中的应用潜力,展现其在人工智能、云计算等领域的前景。

内容简介

华为自研的仓颉语言作为一款面向全场景应用开发的现代编程语言,通过现代语言特性的集成、全方位的编译优化和运行时实现,以及开箱即用的工具链支持,为开发者打造了友好的开发体验和卓越的程序性能。

本书循序渐进地讲解了仓颉语言的核心知识,并通过具体实例的实现过程演练了开发仓颉语言程序的关键方法和流程。全书共 19 章,分别讲解了从仓颉语言的基础语法、数据结构、面向对象编程、网络编程到多线程与并发处理等内容,最后通过实战项目——圆角图片视图库的开发,系统展示了仓颉语言的核心语法知识和实际应用技巧。

本书通俗易懂而不失技术深度,案例丰富,实用性强,涵盖了华为开发技术的最新动态和实践案例,同时涵盖了其他同类图书中很少涉及的开发工具与平台介绍。本书适合华为仓颉编程语言的初学者和进阶读者作为自学教程,也可作为培训学校和各大院校的相关专业的教学参考书。

本期推荐2:《DeepSeek源码深度解析》《DeepSeek源码深度解析》

DeepSeek源码底层逻辑与架构哲学:从架构设计到实战部署,解密MoE内核与多模态融合,赠送67GB学习资源,快速掌握从源码阅读到二次开发的全流程技能。

京东:https://item.jd.com/15021762.html

1.源码逐层拆解:从架构设计到工程实现策略,全面驾驭DeepSeek技术生态。

2.解密MoE内核与多模态融合:涵盖文本、视觉及跨模态数据处理,探索MoE技术实现高效的模型训练和推理的精髓。

3.核心算法解读:逐步解析关键算法与数据流处理过程,从源码层面深入探讨模型训练、推理和优化的实现细节。

4.实战指导:案例驱动的实战讲解,带领读者快速掌握从源码阅读到二次开发的全流程技能。

内容简介

本书是一本系统讲解DeepSeek源码及其核心实现原理的技术指南,内容覆盖了从基础概念到高级应用的全流程知识。全书共7章,结构层层递进。第1章对DeepSeek进行了全面概述,帮助读者构建对DeepSeek系统的整体认知。第2章聚焦于环境搭建、代码获取与模型部署接入,为后续深入研究提供基础。第3章深入探讨了MoE(混合专家模型)的基本原理、功能模块与优化技术。第4章详细解析了DeepSeek-V3模型的架构知识,并通过测试验证展示了系统的实际效果。第5章围绕统一多模态大模型展开,介绍了Janus系列架构、核心技术及工具模块。第6章针对高分辨率图像场景,探讨了结合MoE、细粒度特征提取与视觉/语言适配器的多模态模型的知识。第7章聚焦DeepSeek-R1推理大模型,展示了DeepSeek在推理性能与自我进化方面的探索。

本书适合人工智能工程师、深度学习研究者、AI产品开发人员及高校师生阅读。无论您是希望夯实开源模型基础,还是寻找前沿实战案例,本书都将为您提供全面而深入的参考与指导。