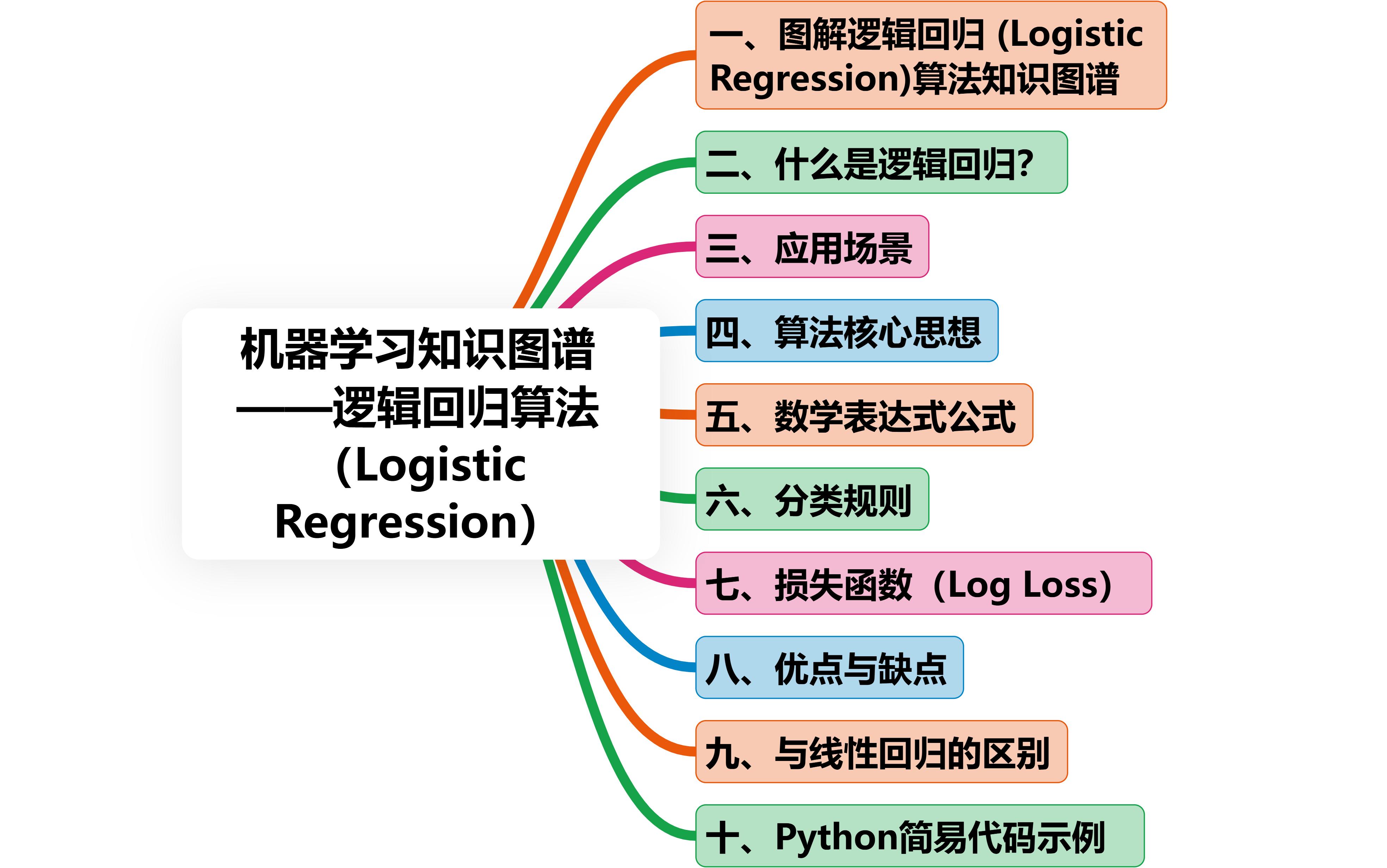

机器学习知识图谱——逻辑回归算法(Logistic Regression)

目录

一、图解逻辑回归 (Logistic Regression)算法知识图谱

二、什么是逻辑回归?

三、应用场景

四、算法核心思想

五、数学表达式公式

六、分类规则

七、损失函数(Log Loss)

八、优点 与 缺点

九、与线性回归的区别

十、Python 简易代码示例

一、图解逻辑回归 (Logistic Regression)算法知识图谱

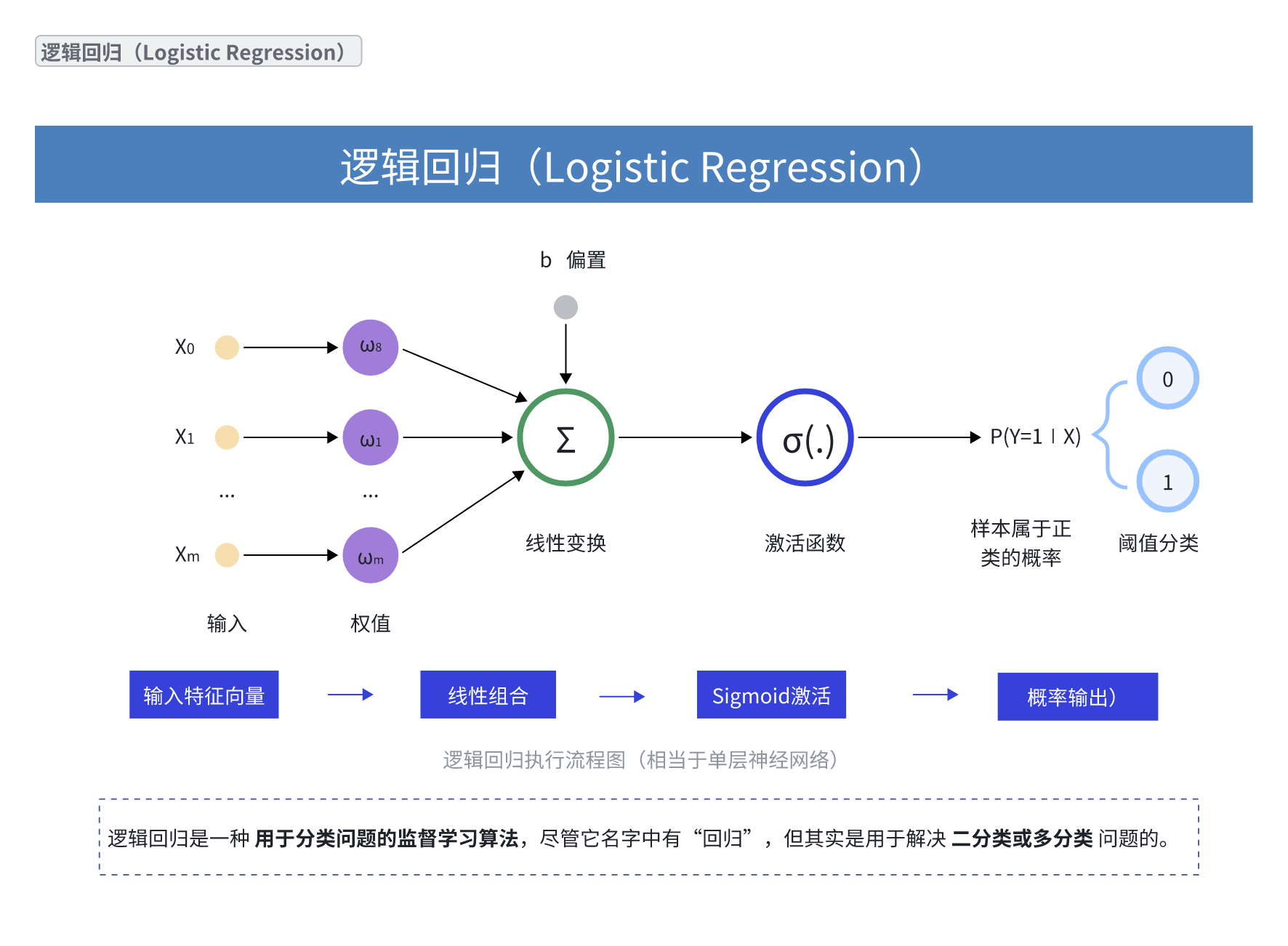

这张图片详细展示了逻辑回归 (Logistic Regression) 的执行流程图,它也可以被视为一个单层神经网络。

以下是流程图的各个组成部分和它们代表的含义:

1.输入 (Input):

-

X0,X1,…,Xm: 这些是输入特征向量。通常 X0 默认为1,用于与偏置项 b 相乘,使其能融入线性组合中。

2.权重 (Weights):

-

ω0,ω1,…,ωm: 这些是与每个输入特征相对应的权重。模型训练的目标就是找到最佳的权重值。

3.线性变换 (Linear Transformation):

-

中间的绿色圆圈内是求和符号 Σ。

-

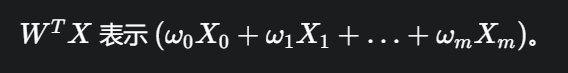

Z=WTX+b: 这里进行了输入特征与对应权重的线性组合,并加上偏置项 b。

-

b 是偏置项 (Bias),它允许决策边界不经过原点。

-

-

这一步本质上是一个线性模型的输出。

4.激活函数 (Activation Function):

-

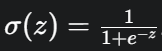

紫色的圆圈内是 σ(⋅),这代表 Sigmoid 激活函数。

-

Sigmoid 函数将线性变换的输出 Z 映射到一个介于 0 到 1 之间的概率值。

-

其数学表达式通常为

。

5.概念输出 (0-1) / 概率输出 P(Y=1∣X):

-

激活函数的输出是样本属于正类(通常为 1)的概率,表示为 P(Y=1∣X)。

-

这个概率值可以用于阈值分类:如果 P(Y=1∣X) 大于某个预设的阈值(例如 0.5),则预测样本属于正类(1),否则预测为负类(0)。

底部的流程概括:

-

输入特征向量 → 线性组合 → Sigmoid激活 → 概率输出 (0-1)

整个流程图清晰地阐释了逻辑回归从接收输入特征到计算概率并最终进行分类的整个过程,它是一个简单但功能强大的用于二分类问题的线性模型。<