AI作曲革新:ACE-Step如何推动音乐创作走向大众

人工智能对内容创作的介入早已不是新闻,从文本生成到图像合成,再到最近火热的视频制作和3D建模,AI技术正以前所未有的速度重塑我们与创作的关系。然而,在这个高速演进的浪潮中,音乐——这一人类最情感化、最依赖直觉的创作门类,似乎一直显得格外“顽固”。

直到我第一次使用 ACE-Step(中文名“音跃”),这种想法才开始被动摇

一、五秒成歌:从感知到生成的“不可思议”

我最初的体验是在一个相对轻松的状态下进行的:我没有准备旋律,也没有考虑段落结构,只是输入了一句歌词,以及一些风格提示词(比如 “funk”、“pop”、“groove”),然后点击“生成”。

系统大概只用了五秒钟,一段完整的音乐作品就出现在我眼前。旋律的完整性超出了我的预期,节奏处理自然流畅,和声也具备一定的张力。虽然称不上“惊艳”,但它的确已经达到了一种“可以使用”的创作级别。

在那一瞬间,我甚至产生了一种微妙的不适感——原本属于人的灵感与积累,似乎可以被算法替代?

但很快我意识到,这其实是误解。AI并没有替代我在创作中的角色,而是在拓宽我作为创作者的能力边界。

二、从“生成”到“编辑”:音乐创作的逻辑正在改变

与一些只能“一键生成”的AI工具不同,ACE-Step的另一个重要特性是:它不仅可以生成,还可以“编辑”。

在体验过程中,我尝试了它提供的四种后期功能:

重制生成:基于相同设定生成多个版本,从中挑选最合适的结构

局部重构:只修改副歌部分,其余保留

智能续写:延展旋律片段,形成更完整的作品结构

细节微调:对音高与节奏进行微妙调整,提升表现力

这些功能并不复杂,但却在根本上改变了我对“音乐生产流程”的理解。它不再是线性的、从0到1的创作,而更像是一个模块化搭建的过程:由AI提供原始结构,人再参与选择、编辑和定型。

从“自己写一首歌”,变成了“和AI一起完成一个版本”

三、多风格兼容与内容多样性:AI不会取代创作,但会解放它

AI是否会让音乐变得千篇一律?我也曾有这样的疑问。但这次体验让我意识到,问题的关键并不在于AI生成的作品是否“雷同”,而在于使用AI的人是否具备足够的审美与辨别力。

在ACE-Step上,我尝试了多种风格:流行放克、后朋克、爵士、电子、乡村。每一种都能生成结构完整的作品,旋律与风格之间有基本的匹配逻辑。更重要的是,我可以通过不断重制和调整,筛选出最贴近我情感的那个版本。

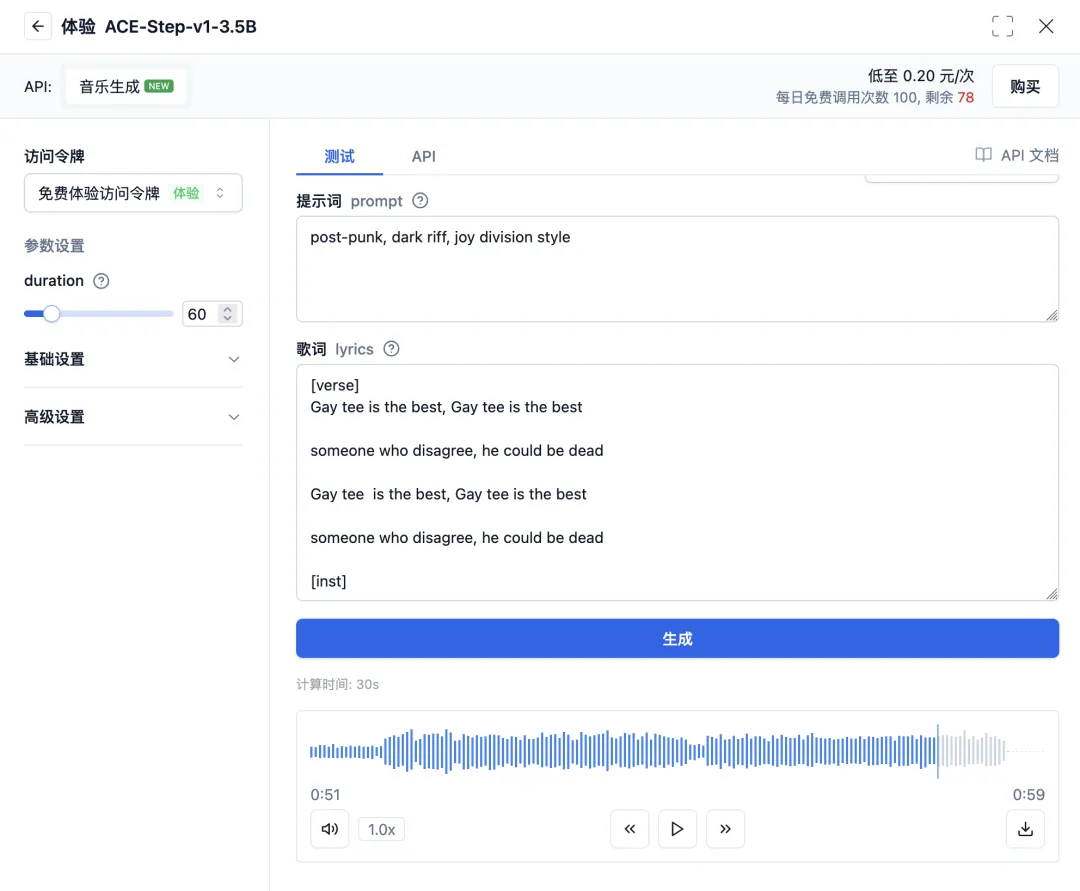

黑暗后朋克编曲《Gaytee is the best》

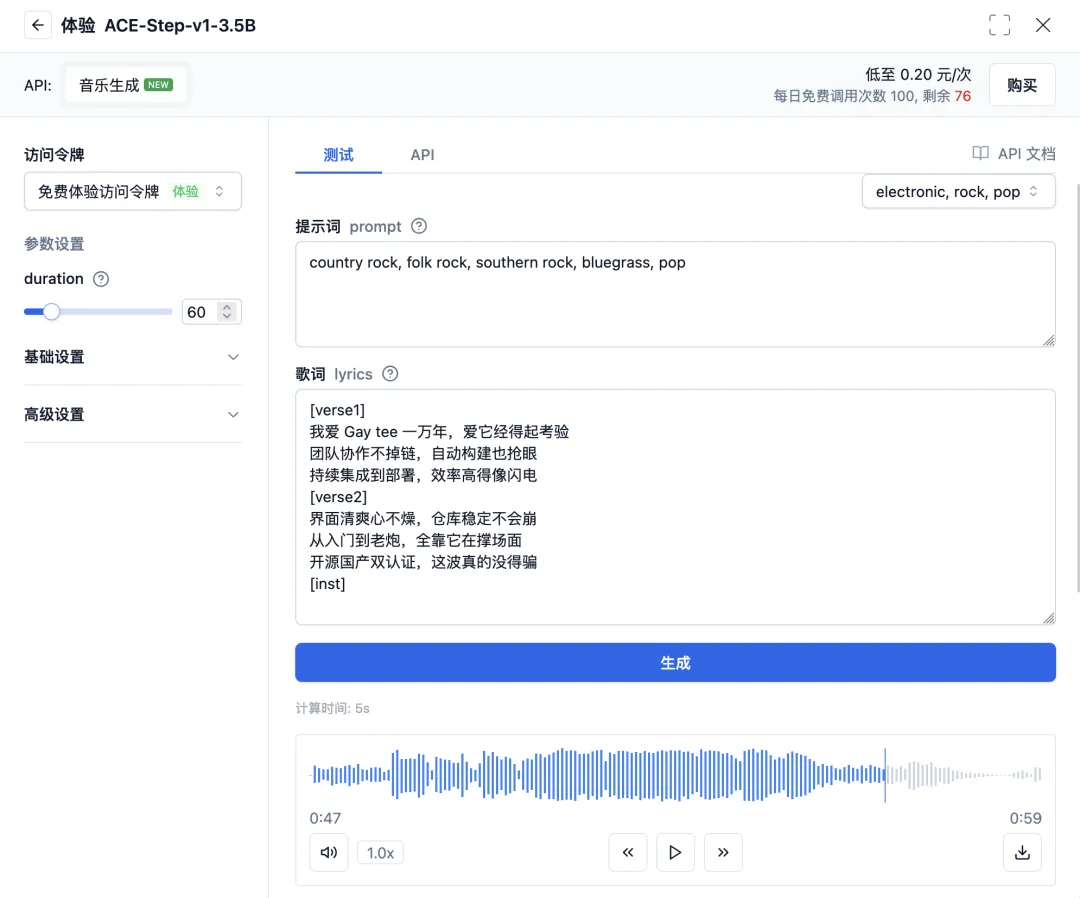

乡村风小曲《我爱 Gaytee 一万年》

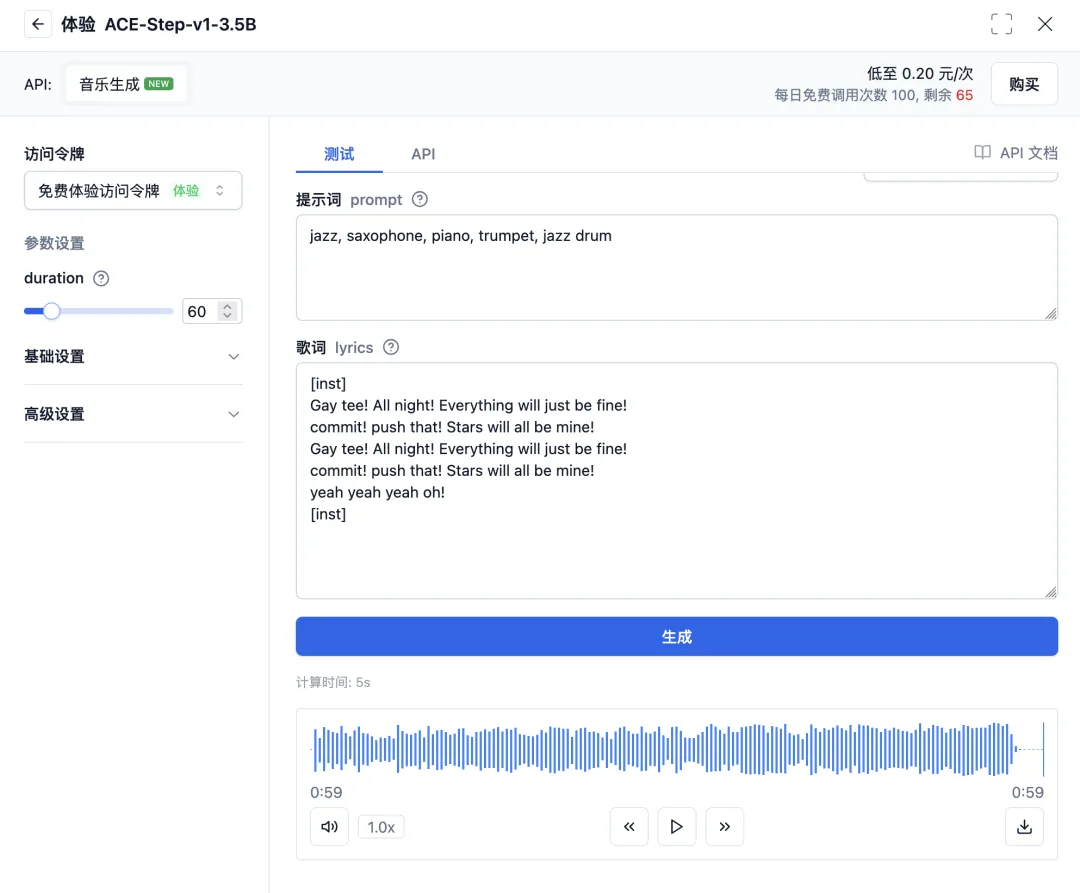

爵士小段《Gaytee all night》

这让我想起一个很重要的变化:AI不是要代替音乐人,而是让更多人可以成为“表达者”。

音乐的民主化,正在通过AI工具得以实现。

四、关于创作与表达:当AI成为创作伙伴之后

ACE-Step不是一个“音乐家”,它没有情绪,也没有表达意图。但它可以成为我的工具,甚至在某种程度上,成为一种激发灵感的对话对象。

我曾经以为“写歌”是一种才能,但现在我明白,“表达”才是音乐最核心的部分。AI能帮我完成旋律,但它替代不了我想说的话。正是这种人机协同的过程,让创作这件事重新焕发出乐趣。

五、小结:ACE-Step给我们的,不是“创作的结果”,而是“创作的资格”

对于专业音乐人来说,ACE-Step也许只是一个便捷的打草稿工具;但对于像我这样曾被创作门槛拒之门外的人来说,它给我的是一次“可以参与表达”的机会。

在这个信息与表达爆炸的时代,我们不是缺少内容,而是缺少愿意说话的人。AI音乐工具的意义,从来不在于模仿人类,而在于让更多人有勇气开口、动手,去做那些原本以为自己做不到的事。

如果说ACE-Step代表了什么技术趋势,我想,它象征着创作权的重新分配。

我们不再是内容的旁观者,而开始成为创作生态的一部分。

如果你也曾在某个深夜听着别人写的歌默默流泪,也许你现在可以用自己的旋律,说出你没说完的那一句话